【G検定対策】誤差逆伝播法とは?AIの反省会…

AIを学び始めると

- 重み

- 損失関数

- 勾配降下法

- 学習率

など、多くの用語が登場します。

しかし、実際には、それぞれは独立した知識ではありません。

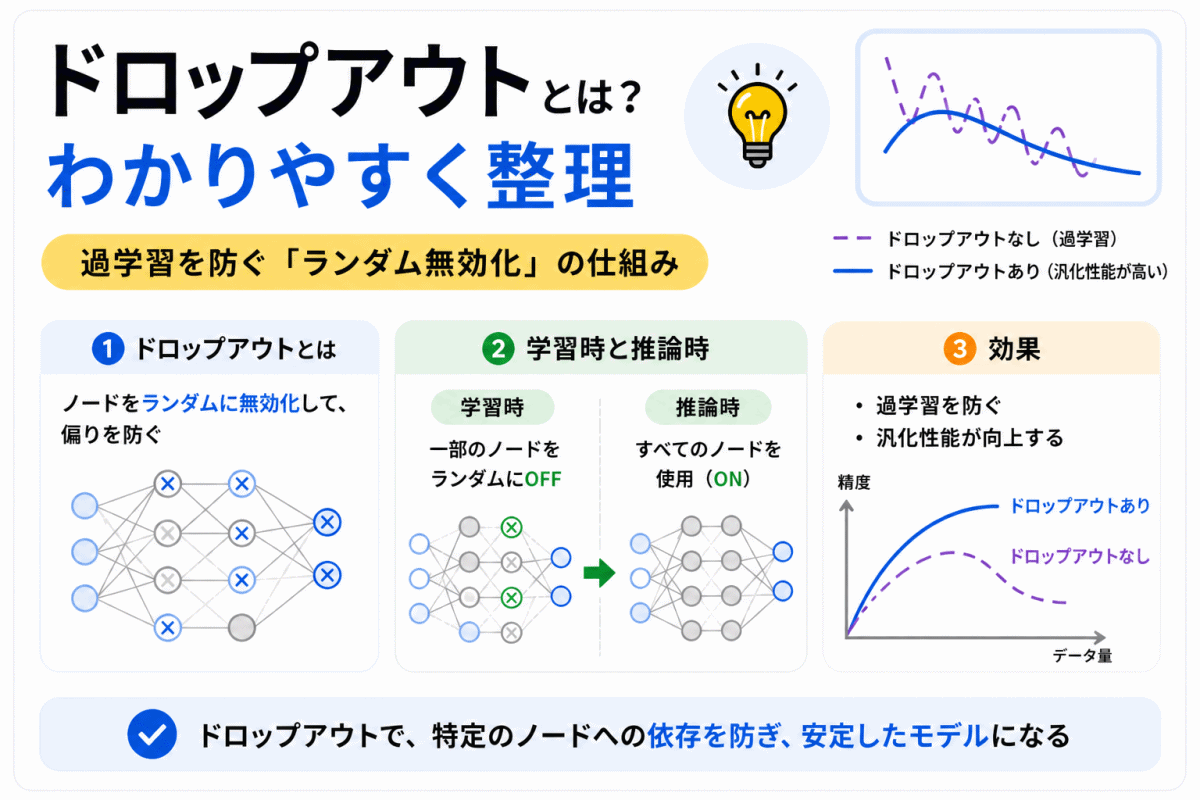

AI内部では「予測して、間違えて、修正する」という流れが起きています。

そして、その中で非常に重要なのが「どこが悪かったのかを後ろから調べる」仕組みです。

それが「誤差逆伝播法」です。

G検定では

- 勾配降下法との関係

- 重み更新との関係

- ニューラルネットワーク内部理解

として問われやすい重要テーマです。

しかし、多くの解説では

- 微分

- 数式

- 偏微分

- 連鎖律

から入るため、「結局何をしているのかわからない」という状態になりやすいです。

この記事では数式暗記ではなく「AI内部で何が起きているのか」を流れで理解できるよう整理していきます。

一言でいうと…

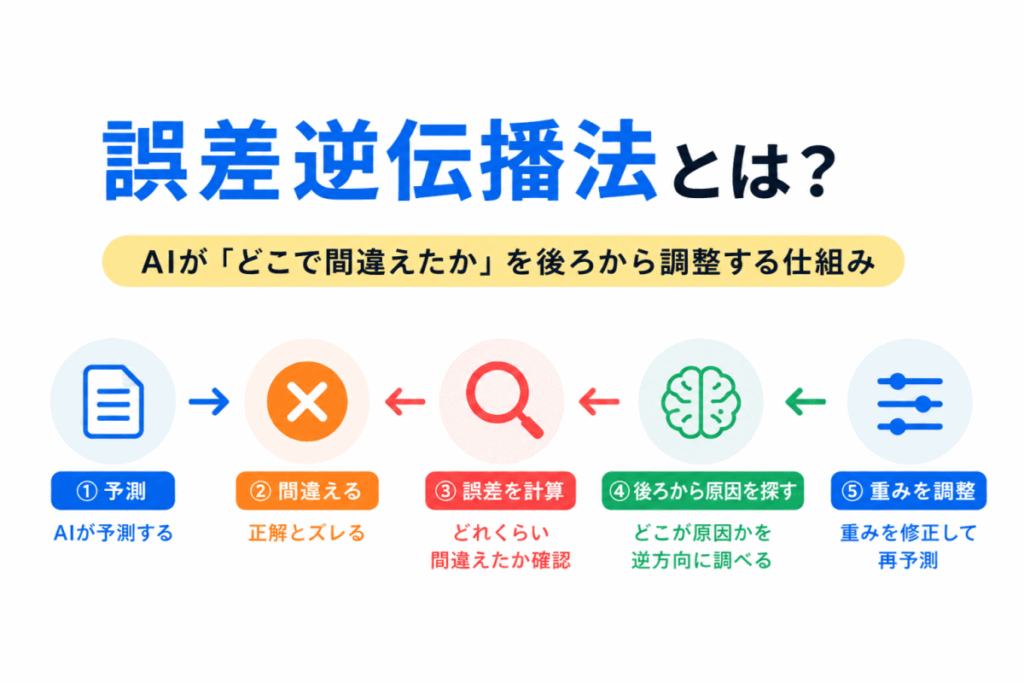

「AIがどこを間違えたかを後ろから調べる仕組み」です。

AIは予測後「どのくらい間違えたか」を確認します。

しかし、それだけでは学習できません。

重要なのは「どの重みを直せば改善するか」です。

その原因を後ろからたどるのが 誤差逆伝播法 です。

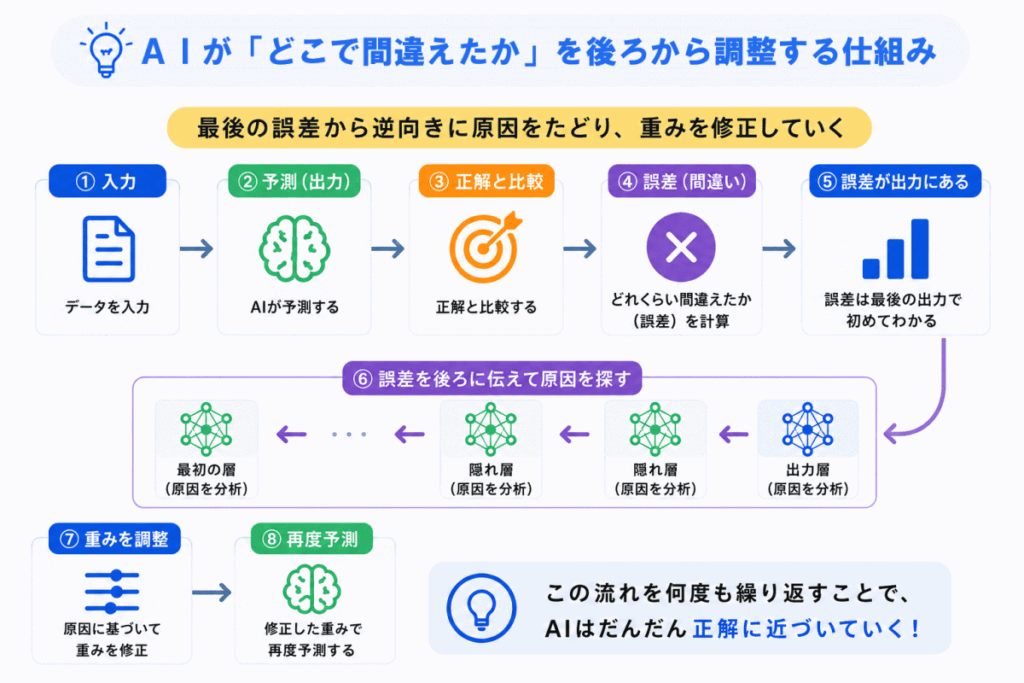

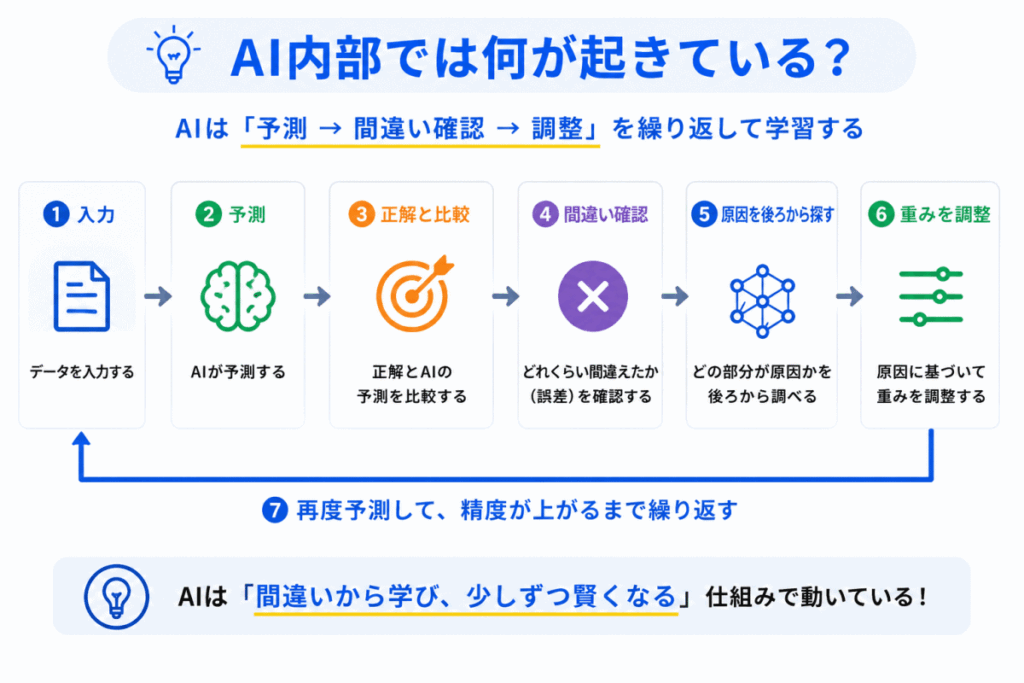

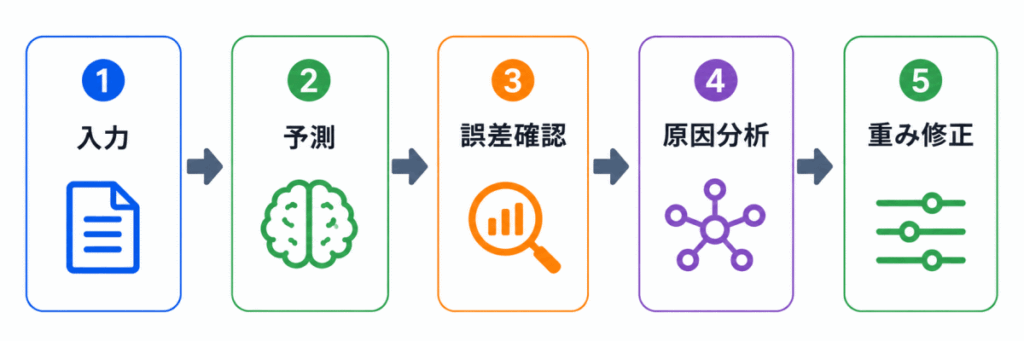

AI内部では何が起きている?

AI内部では、次の流れが起きています。

入力

↓

予測

↓

正解と比較

↓

誤差発生

↓

【原因を後ろから調査】 ← ココ が誤差逆伝播法

↓

重み修正

↓

再予測

この中で「誤差の原因を後ろから調べる」部分が「誤差逆伝播法」です。

AIは最終的な出力で発生した誤差を見て「どの重みが原因だったのか」を逆方向へたどっていきます。

ここで重要なのが「最後の誤差から逆向きに原因を探す」という考え方です。

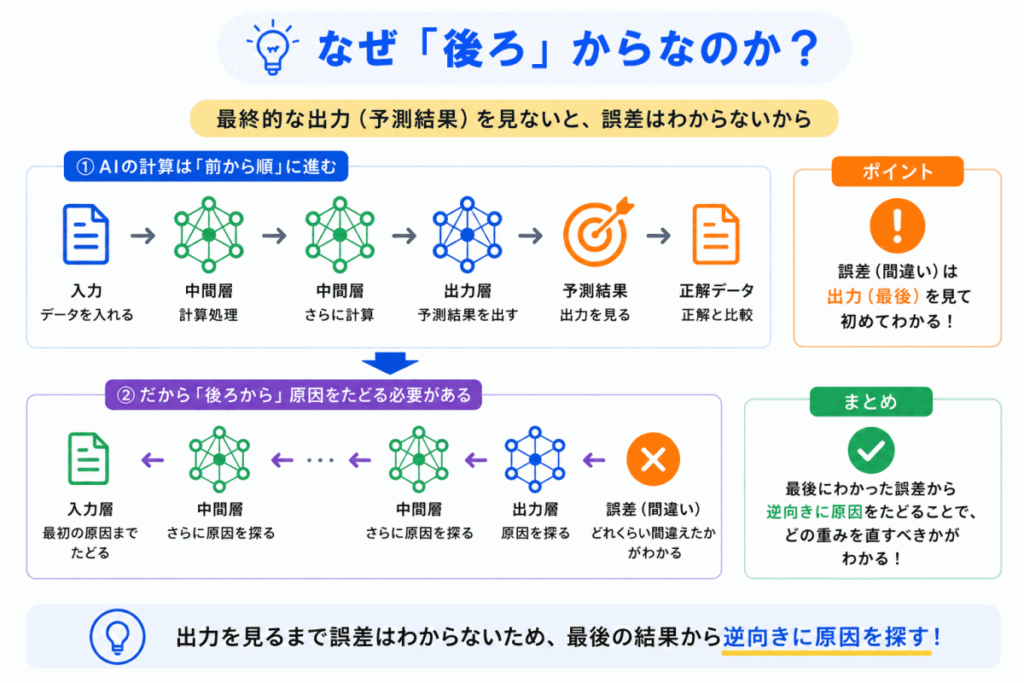

なぜ「後ろから」なの?

ニューラルネットワークは

入力

↓

中間層

↓

出力

という順番で計算します。

しかし「最終的にどれだけ間違えたか」は、最後の出力を見ないとわかりません。

つまり 最後に誤差が発生する のです。

だから「最後の誤差」から逆向きに原因を探す 必要があります。

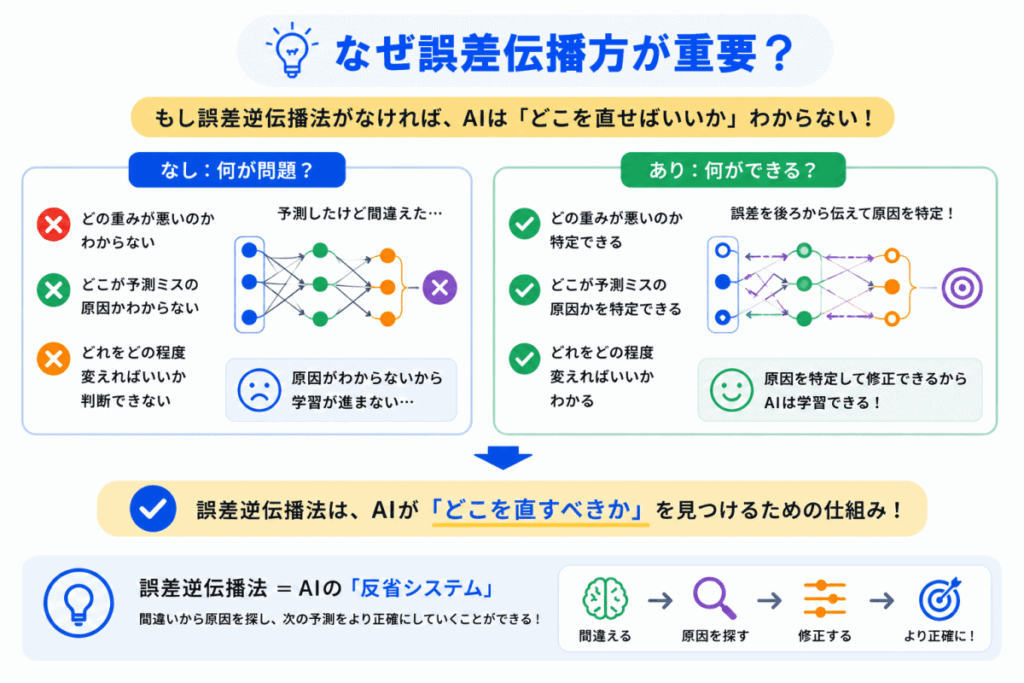

なぜ誤差逆伝播法が重要?

もし誤差逆伝播法がなければ、AIは「どこを修正すればいいかわからない」状態になります。

つまり

- どの重みが悪い?

- どこが予測ミス原因?

- どれをどの程度変える?

が判断できません。

誤差逆伝播法は AIの「反省システム」のような役割です。

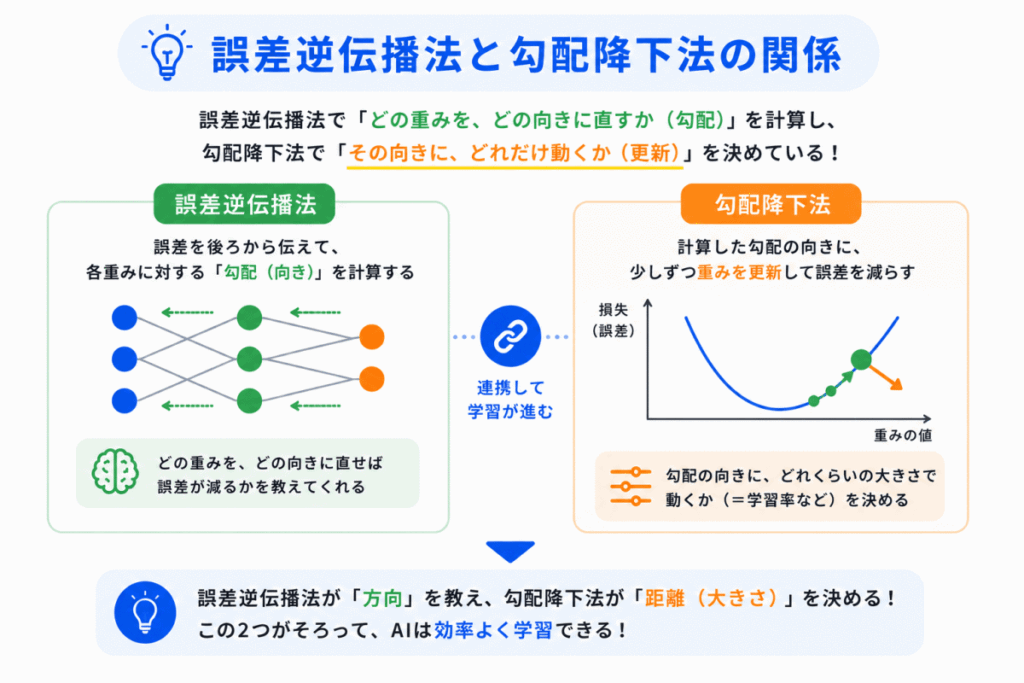

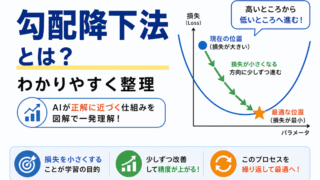

勾配降下法との関係

ここは非常に混同しやすいポイントです。

つまり

誤差逆伝播法 → 「どこを直す?」

勾配降下法 → 「どう直す?」

という関係です。

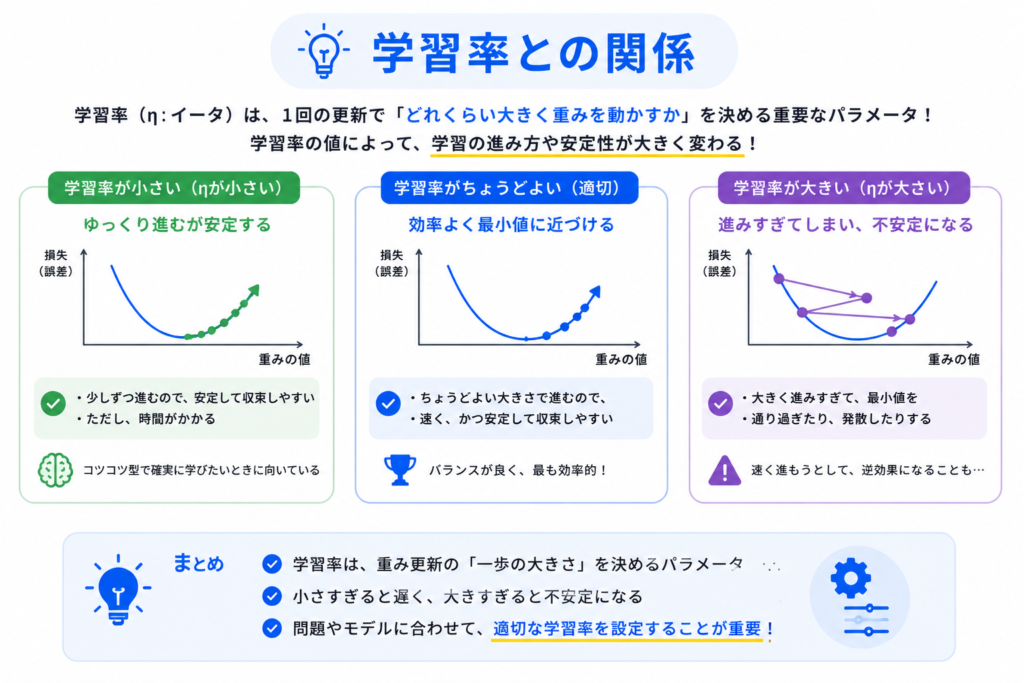

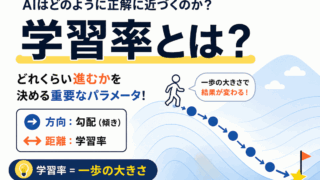

学習率との関係

誤差逆伝播法で「どの方向へ修正するか」がわかります。

しかし「どのくらい修正するか」は別問題です。

そこで登場するのが 学習率 です。

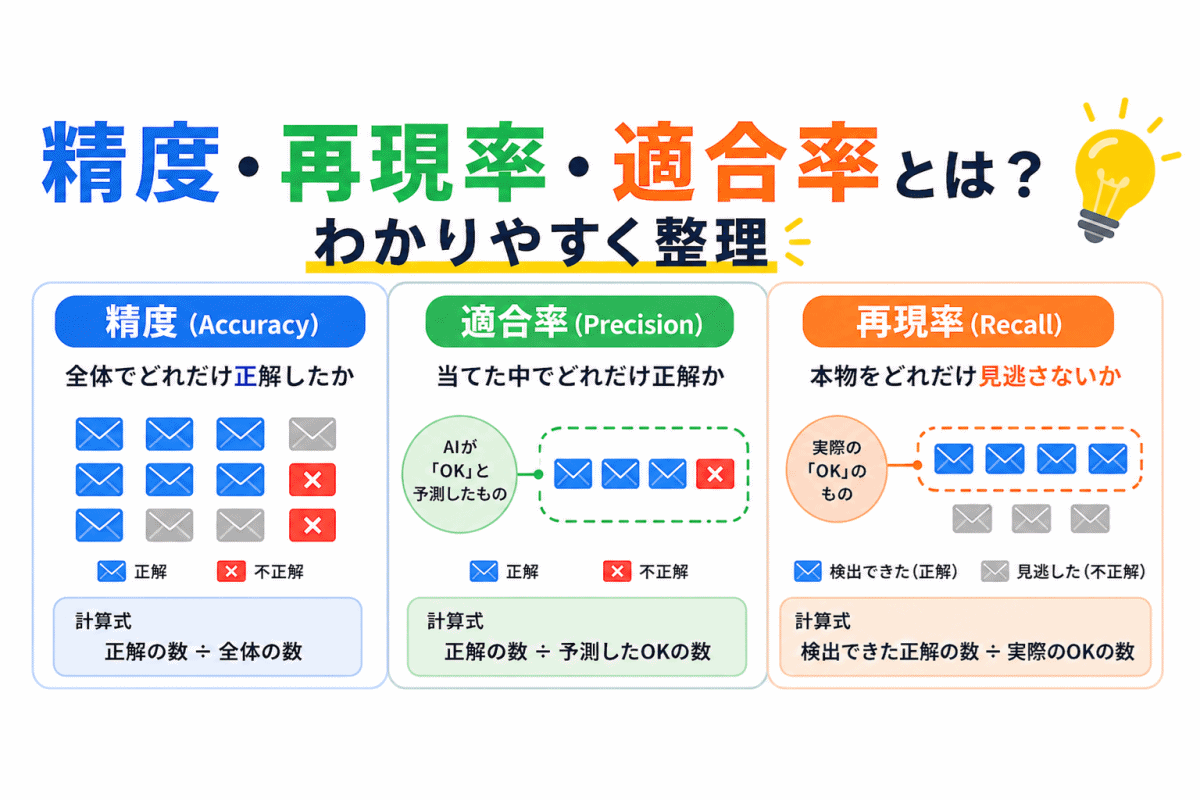

整理すると下の表になります。

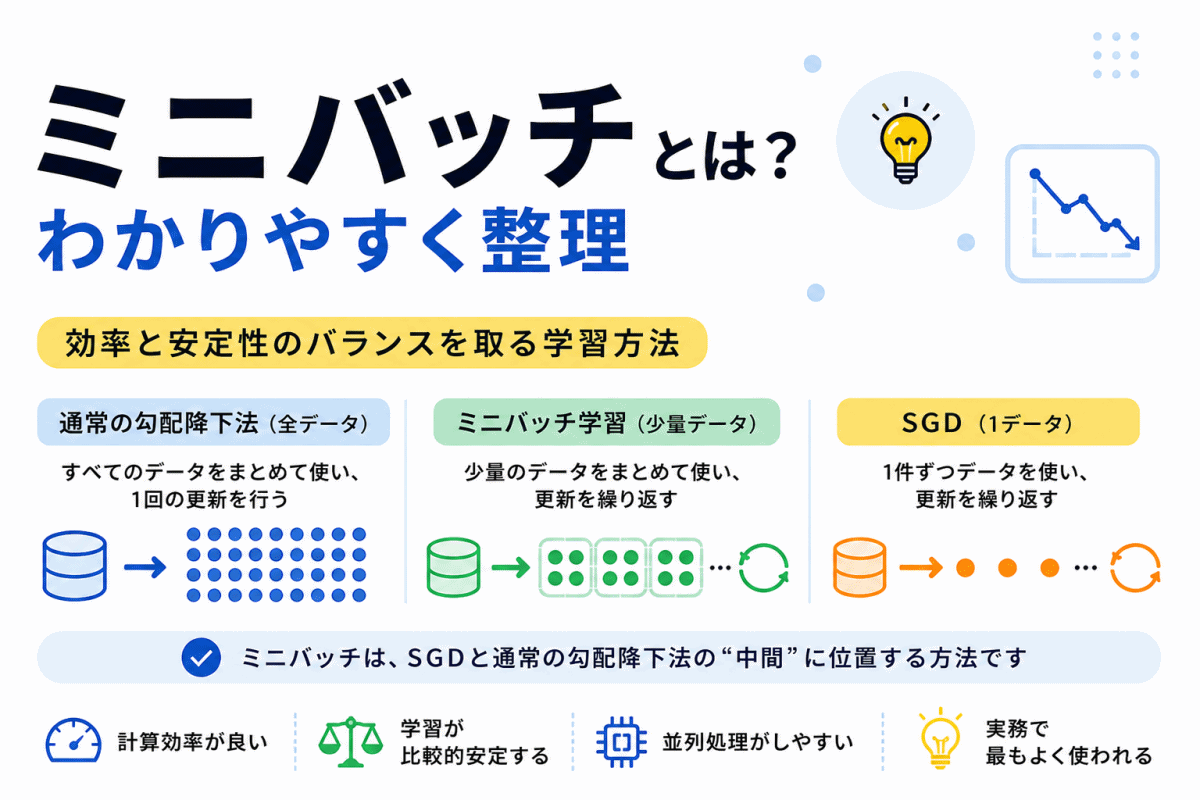

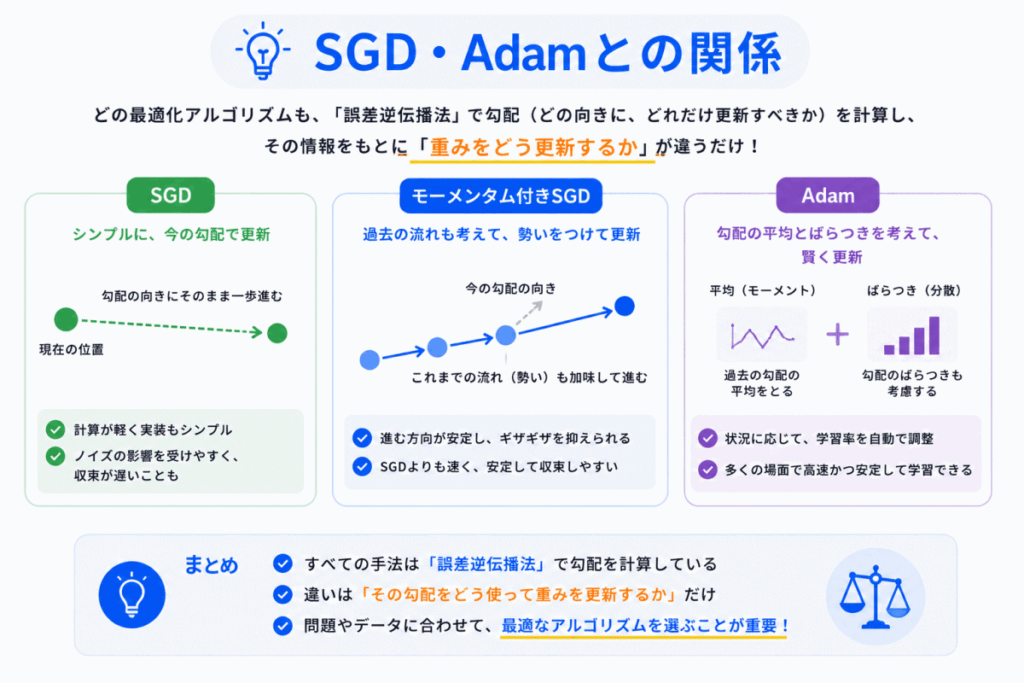

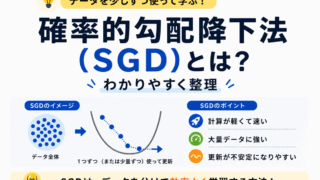

SGD・Adamとの関係

SGDやAdamは「重み更新を効率化する工夫」です。

つまり

誤差逆伝播法

↓

勾配情報取得

↓

SGD / Adam が更新

という流れになります。

ここも「全部別物」として覚えると混乱しやすいです。

実際は AI学習の流れの中でつながっている のです。

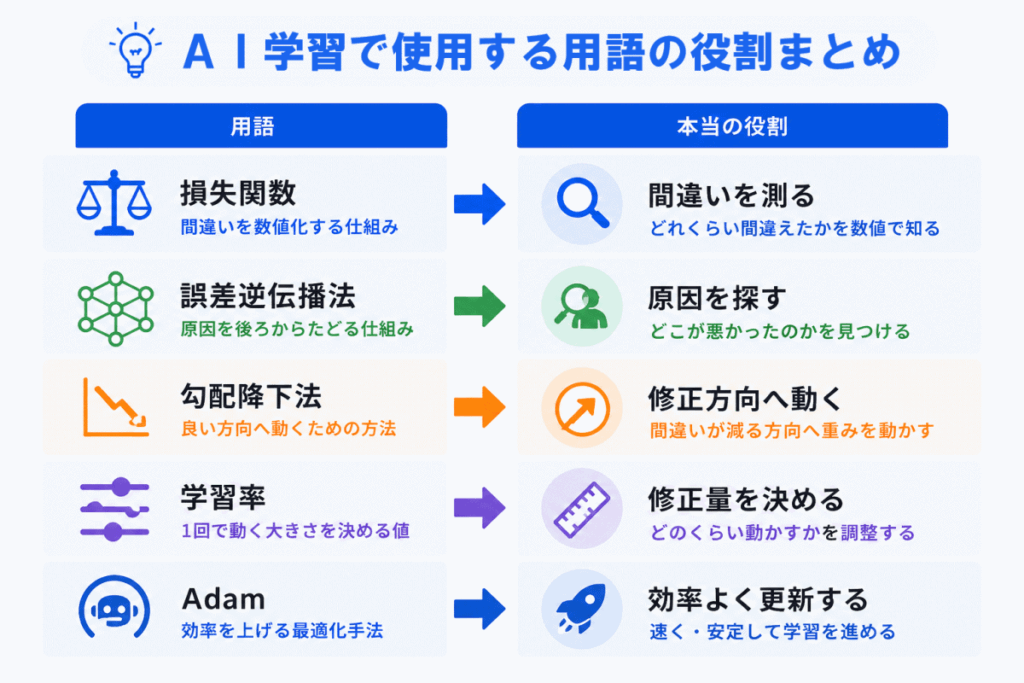

なぜ混同しやすい?

AIの学習をはじめたばかりの人が混乱しやすい理由は 『全部「重み調整」に見える』からです。

ここまで登場した用語をまとめると下の表になります。

「役割分担」で整理すると理解しやすくなります。

G検定ではどう問われる?

G検定では

- 誤差を逆方向へ伝える

- 重み更新に利用される

- ニューラルネットワーク学習

- 勾配降下法との関係

などが問われやすいです。

特に「勾配降下法との違い」は重要です。

「AIが反省している」と考えると理解しやすい

誤差逆伝播法は「AIの反省」として考えると理解しやすいです。

AIは

- 予測する

- 間違える

- 原因を探す

- 修正する

を繰り返しています。

つまり「失敗から学習する仕組み」なのです。

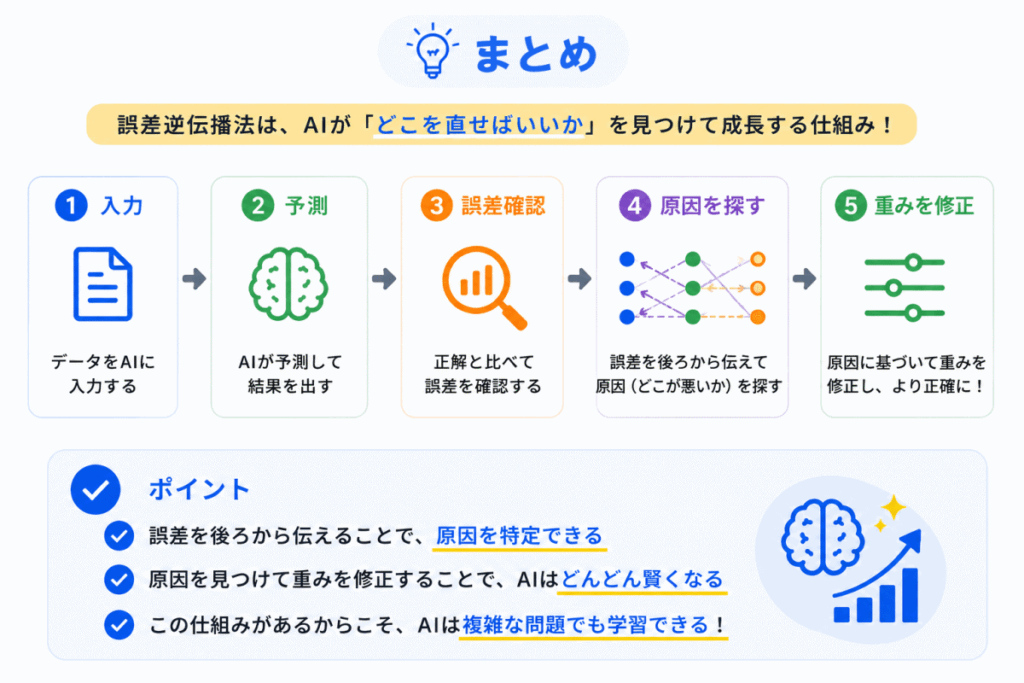

まとめ

誤差逆伝播法は「AIがどこを間違えたかを逆方向に調べる仕組み」です。

繰り返しになりますが、誤差逆伝播法を使用したAIは下記の順で学習しています。

入力

↓

予測

↓

誤差確認

↓

原因分析

↓

重み修正

この中で誤差逆伝播法は「どこを修正すればよいか」を見つける役割を持っています。

また

- 損失関数

- 勾配降下法

- 学習率

- SGD

- Adam

とも深くつながっています。

つまり「AI学習の中心部分」とも言える重要テーマです。

ここを理解できると

- なぜAIが学習できるのか

- なぜ重みが変わるのか

- なぜ深層学習が成立するのか

が一気につながって見えてきます。

次は

- 勾配消失問題

- ニューラルネットワーク内部

- 深層学習の難しさ

へ進むと、さらにAI内部理解が深まります。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

この記事の中でも登場した、勾配降下法、学習率、SGD、Adamの詳細を整理しています。

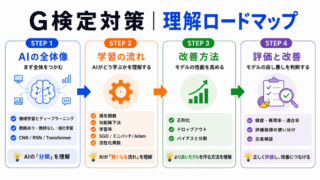

G検定の概要を理解しやすい流れで確認できるように整理しました。

不合格体験記です。私のような失敗をしないように確認しましょう。