【G検定対策】ミニバッチ学習とは?わかりやすく整理

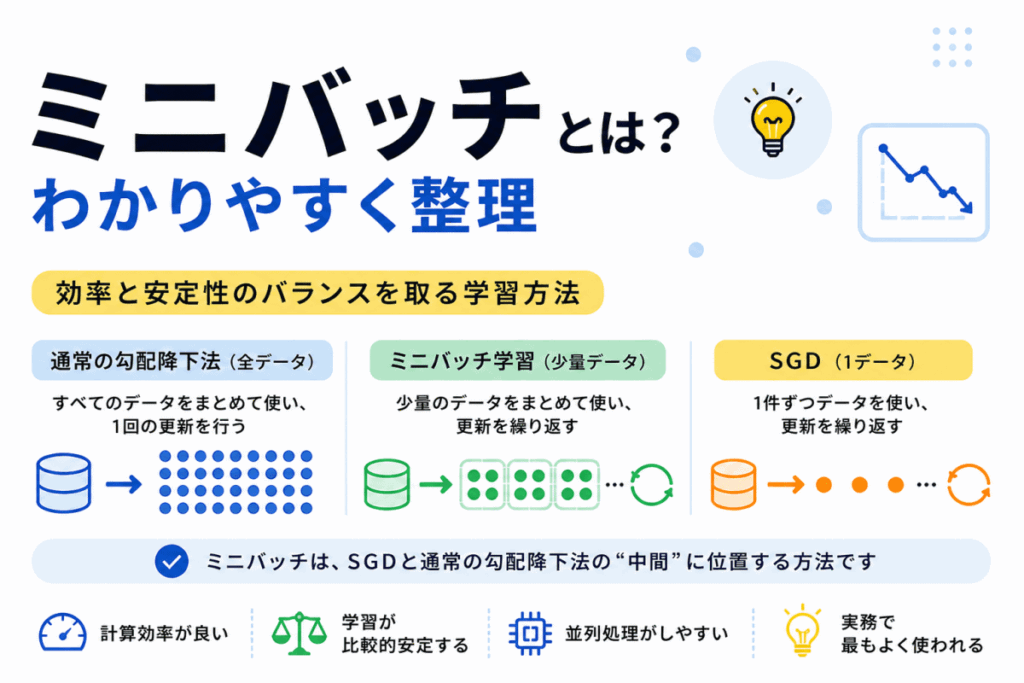

ミニバッチ学習は AIの学習を効率よく進める ために最もよく使われる手法のひとつです。

勾配降下法やSGDの特徴を理解したうえで、このミニバッチを押さえることで、学習方法の全体像がクリアになります。

この記事ではミニバッチの仕組みやメリット・デメリットを図解でわかりやすく整理します。

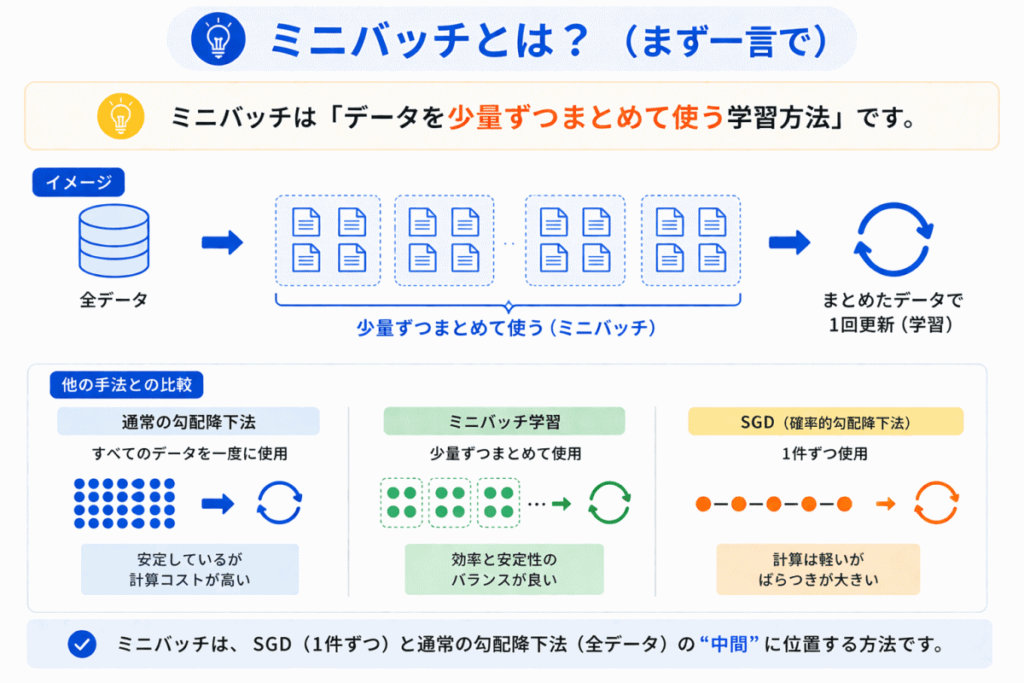

ミニバッチとは?

ミニバッチは

データを少量ずつまとめて使う学習方法

データを少量ずつまとめて使う学習方法

→ SGDは1件ずつ、通常法は全データを使用

通常法(勾配降下法)とSGDの

中間に位置する手法

中間に位置する手法

です。

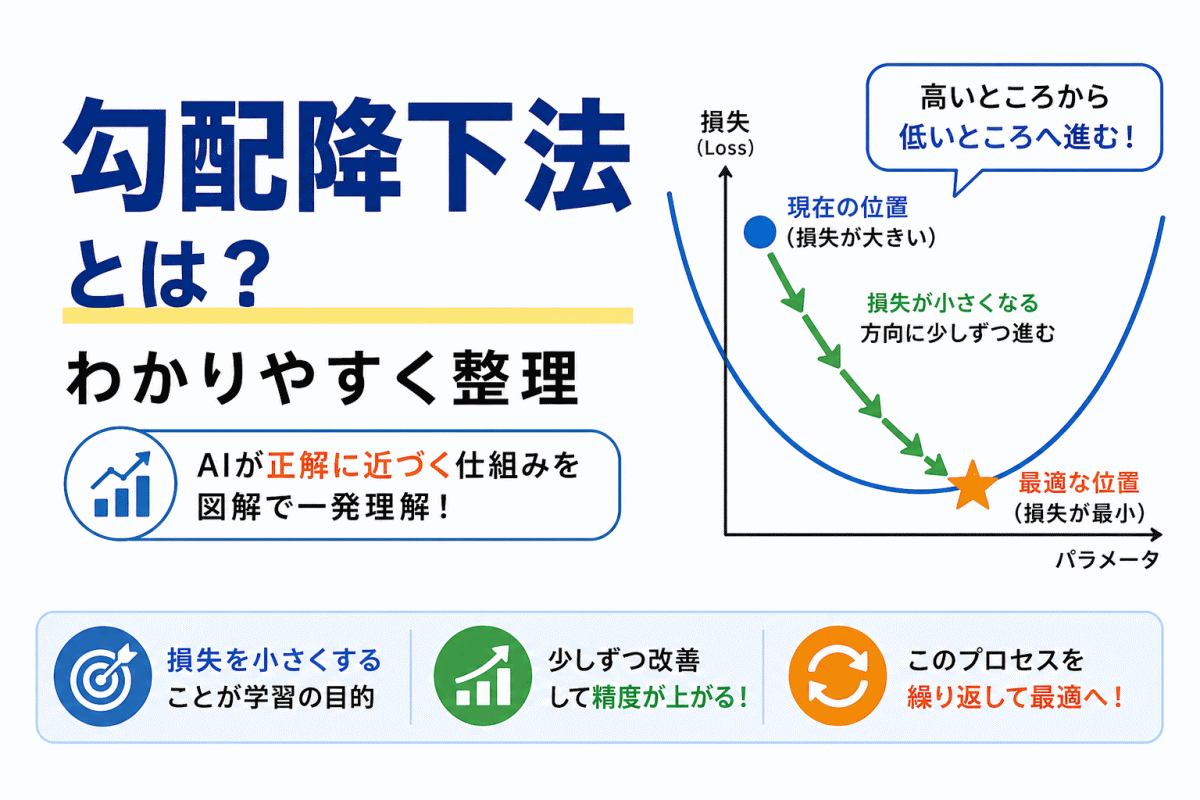

勾配降下法を整理した記事です。

> 勾配降下法とは?わかりやすく整理

SGDを整理した記事です。

> 確率的勾配降下法(SGD)とは?わかりやすく整理

計算効率と安定性のバランスを取る、実務で最も使われる学習方法です。

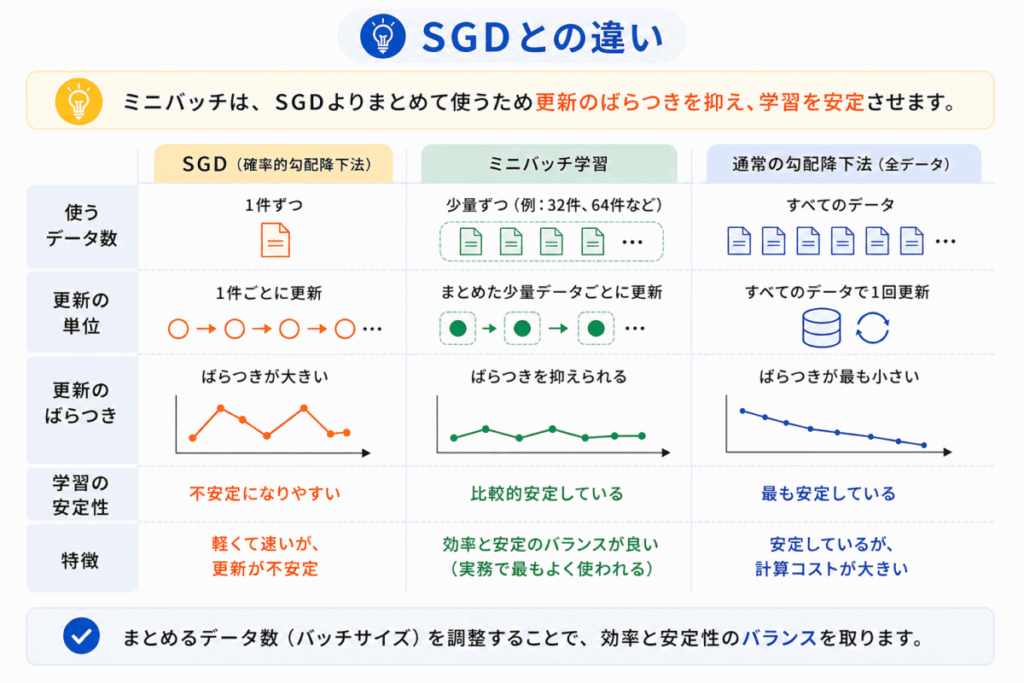

SGDとの違い

SGD(確率的勾配降下法)とミニバッチの違いは下記があげられます。

SGD:1件ずつ更新するため計算は軽い

SGD:1件ずつ更新するため計算は軽い

→ ただし更新ごとのばらつきが大きい

ミニバッチ:少量まとめて更新

ミニバッチ:少量まとめて更新

→ ばらつきを抑えつつ効率も維持できる

「軽さ優先(SGD)」か「安定性とのバランス(ミニバッチ)」かが違いです。

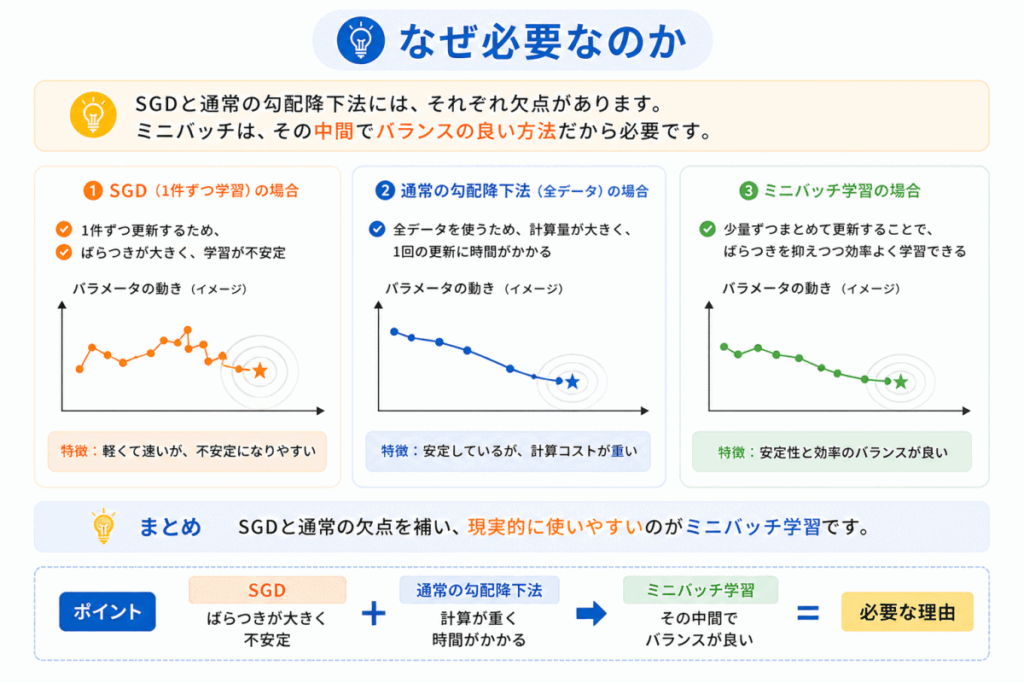

なぜ必要なのか

なぜ必要なのでしょう。

■ SGDは更新がランダムで不安定になりやすい

■ 通常の勾配降下法は計算が重く非効率

■ SGDは更新がランダムで不安定になりやすい

■ 通常の勾配降下法は計算が重く非効率

そのため…

- データが増えるほど問題が大きくなる

- 現実のAIではどちらも使いづらい場面がある

ミニバッチはその中間として、現実的に使いやすい学習方法です。

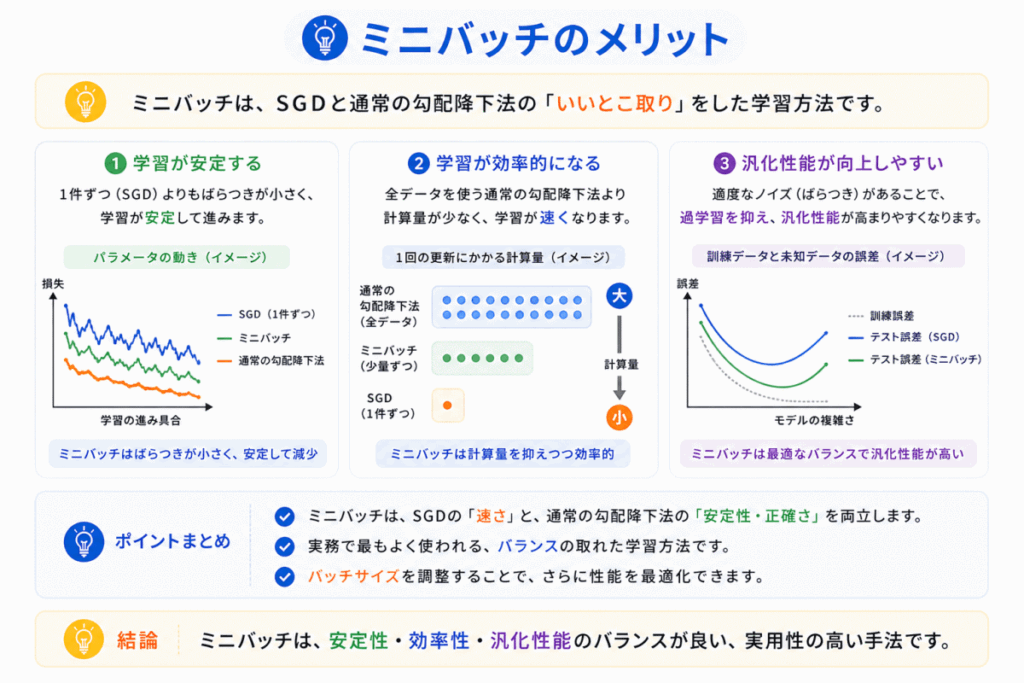

ミニバッチのメリット

ミニバッチのメリットとして下記があげられます。

- 学習が安定する

- 学習が効率的になる

- 汎化性能が向上しやすい

- 並列処理(GPU)との相性が良い

- 大規模データにも対応しやすい

「汎化性能」とは「未知のデータ」に対して正しく予測・識別できる能力を言います。

効率・安定性・実用性のバランスが取れている のが最大の強みです。

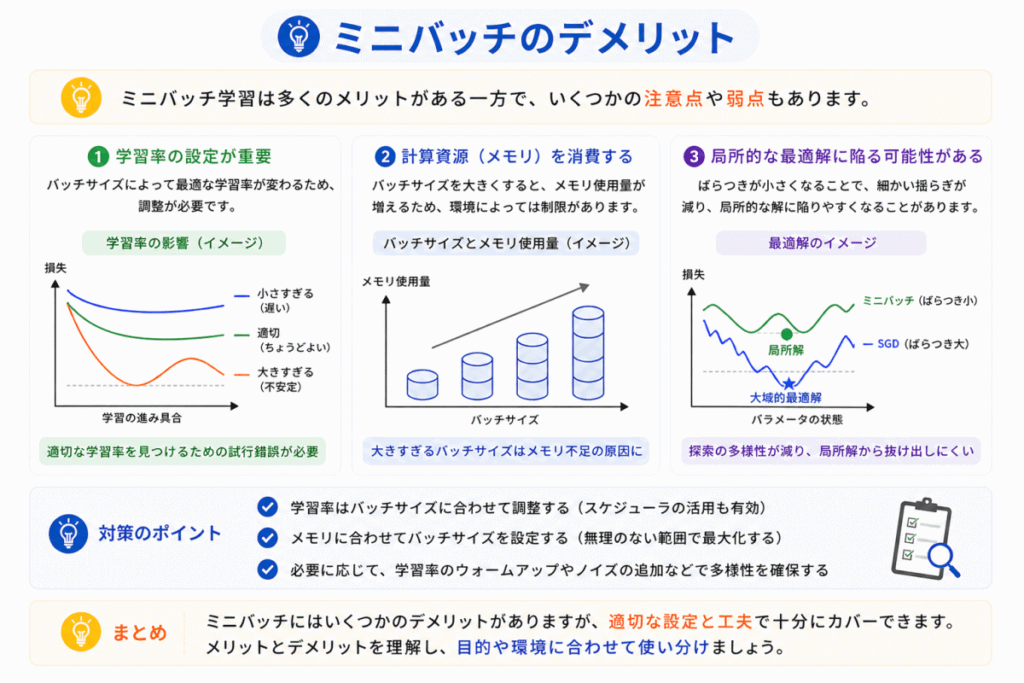

ミニバッチのデメリット

- 学習率の設定が必要

- 計算資源(メモリ)を消費する

- 局所的な最適解に陥る可能性がある

「局所的な最適解」とは、実はもっといい正解があるのに、一部分の中での正解と勘違いしてしまうことです。

「どのくらいまとめるか」で性能が変わる点に注意が必要です。

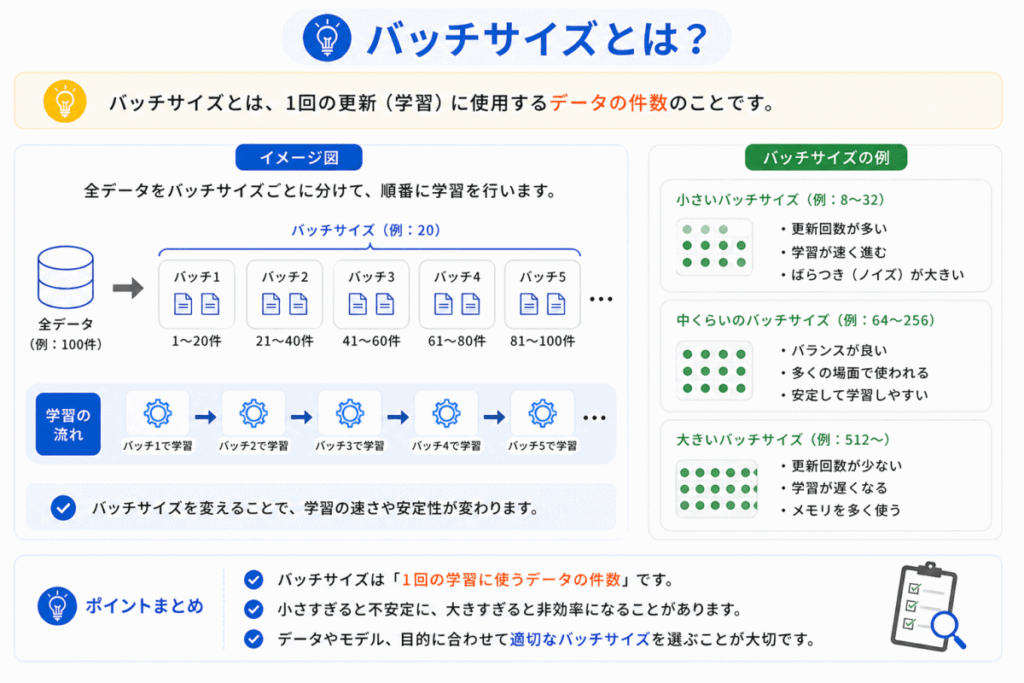

バッチサイズとは?

- 1回の更新で使うデータ数のこと

- 小さい → 更新が速いが不安定

- 大きい → 安定するが計算が重い

- 学習率と並ぶ重要なパラメータ

バッチサイズは学習効率と安定性を左右する重要な要素です。

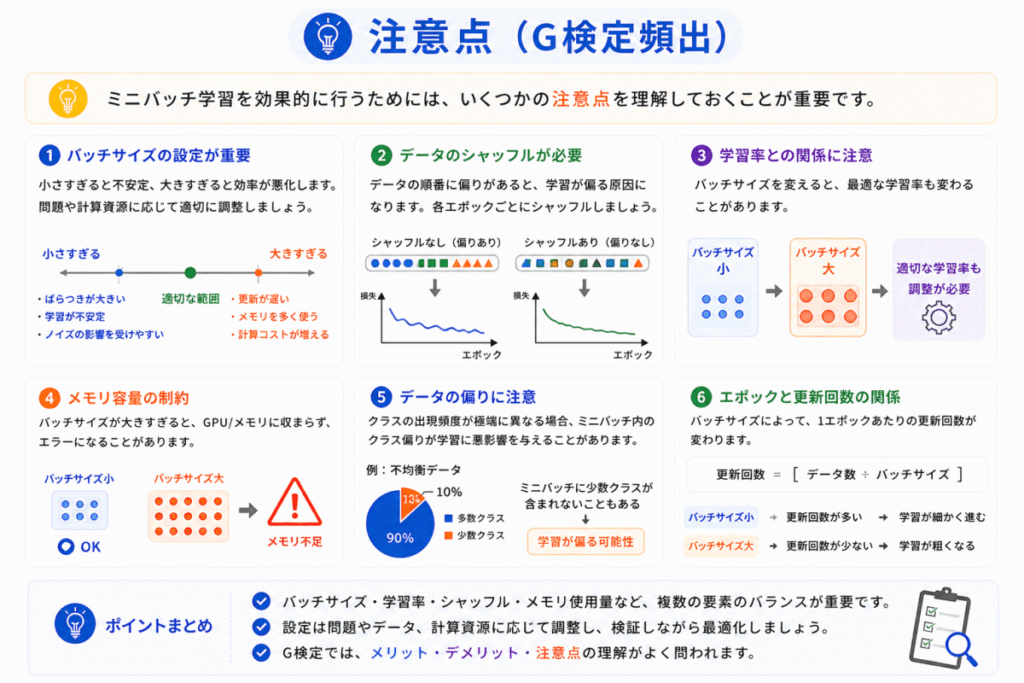

注意点(G検定頻出)

- バッチサイズの設定が重要

- データのシャッフルが必要

- 学習率との関係に注意

- メモリ容量の制約に注意

- データの偏りに注意

- エポックと更新回数の関係

「エポック」とは学習データ全体を1周することです。

「調整が前提」という点がG検定でもよく問われるポイントです。

G検定ではどう問われる?

学習方法の「使い分け」を理解しているかがポイントです

- 勾配降下法・SGD・ミニバッチの違い

- データの使い方(全体/1件/少量)

- それぞれの特徴(重い・不安定・バランス)

データ量で分類

- 全データ → 勾配降下法(安定だが重い)

- 1データ → SGD(軽いが不安定)

- 少量データ → ミニバッチ(バランス型)

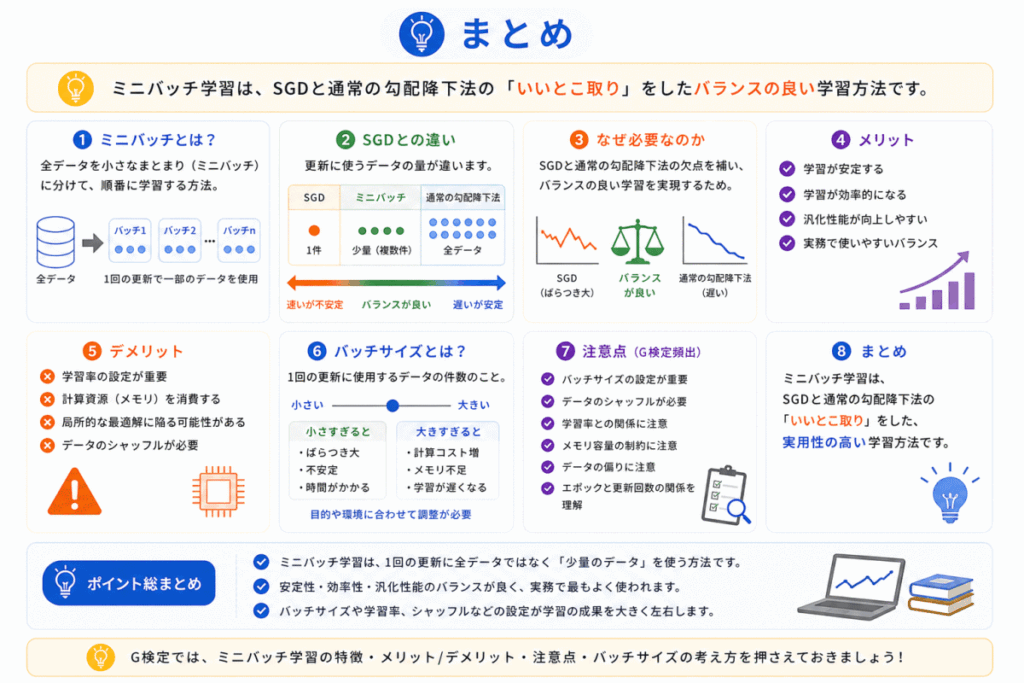

まとめ

ミニバッチ学習は、SGDと通常の勾配降下法の中間に位置する学習手法で、効率と安定性のバランスが取れている のが特徴です。

少量のデータをまとめて使うことで計算負荷を抑えつつ、学習のばらつきを軽減できます。

実務でも広く使われており、バッチサイズや学習率を適切に調整することが重要です。

- ミニバッチは中間的な学習方法

- 効率と安定性のバランスが良い

- 実務では主流の手法

「ちょうど良い学習方法」として覚えるのがポイントです。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

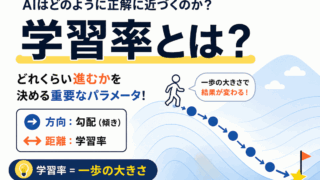

学習率について整理しました。

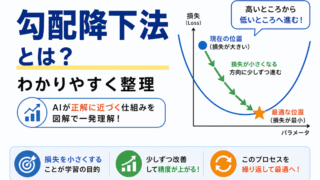

勾配降下法について整理しました。

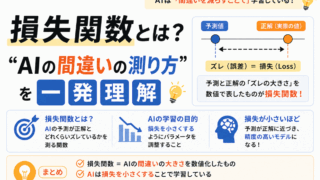

損失関数について整理しました。

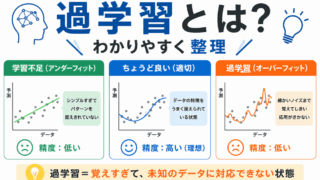

過学習について整理しました。

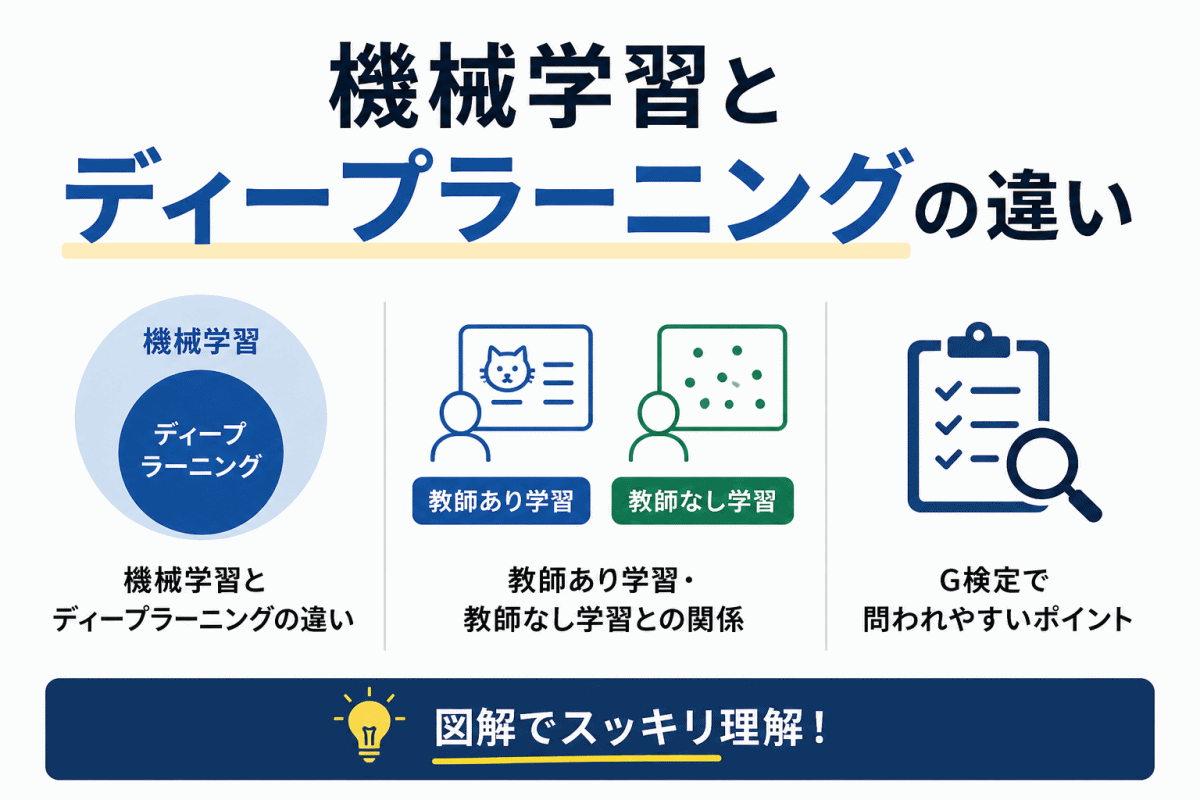

機械学習とディープラーニングの違いを整理しました。

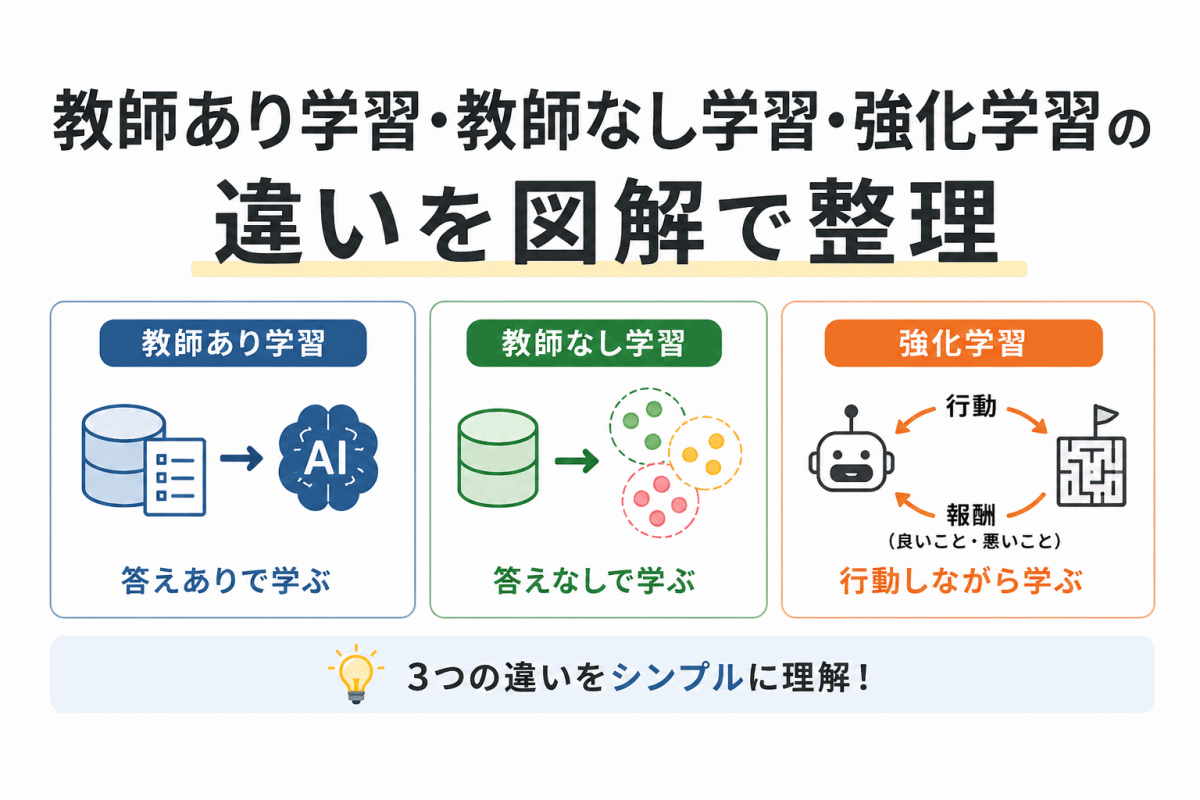

教師あり学習・教師なし学習・強化学習の違いを整理しました。

CNN・RNN・Transformerの違いを整理しました。

どの分野から出題されるか予想しました。

G検定 合格体験談です。2回目の受験で何とか合格できました。