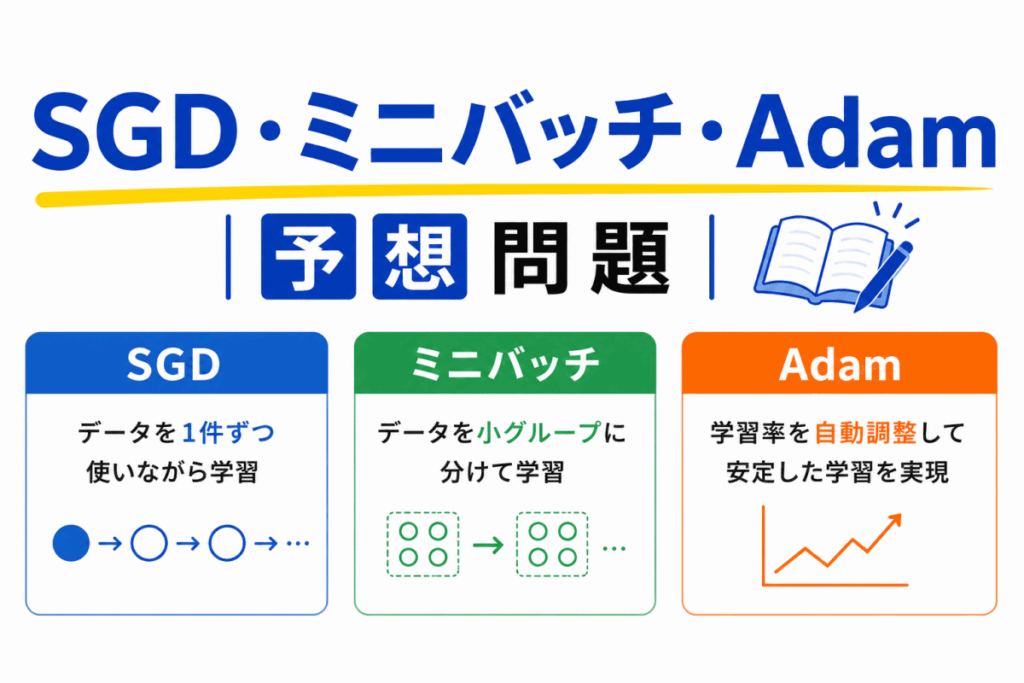

【G検定予想問題】SGD・ミニバッチ・Adam

SGD・ミニバッチ・Adam は、G検定でも頻出の重要テーマです。

ただし、「1件ずつ学習」「小グループ学習」「高性能な最適化手法」と丸暗記しているだけでは、少し聞き方が変わると混乱しやすくなります。

この記事では、単なる暗記ではなく

- なぜSGDは更新がばらつくのか

- なぜミニバッチ学習が主流なのか

- Adamは何を改善したのか

- どう整理すると違いを理解しやすいのか

まで含めて整理していきます。

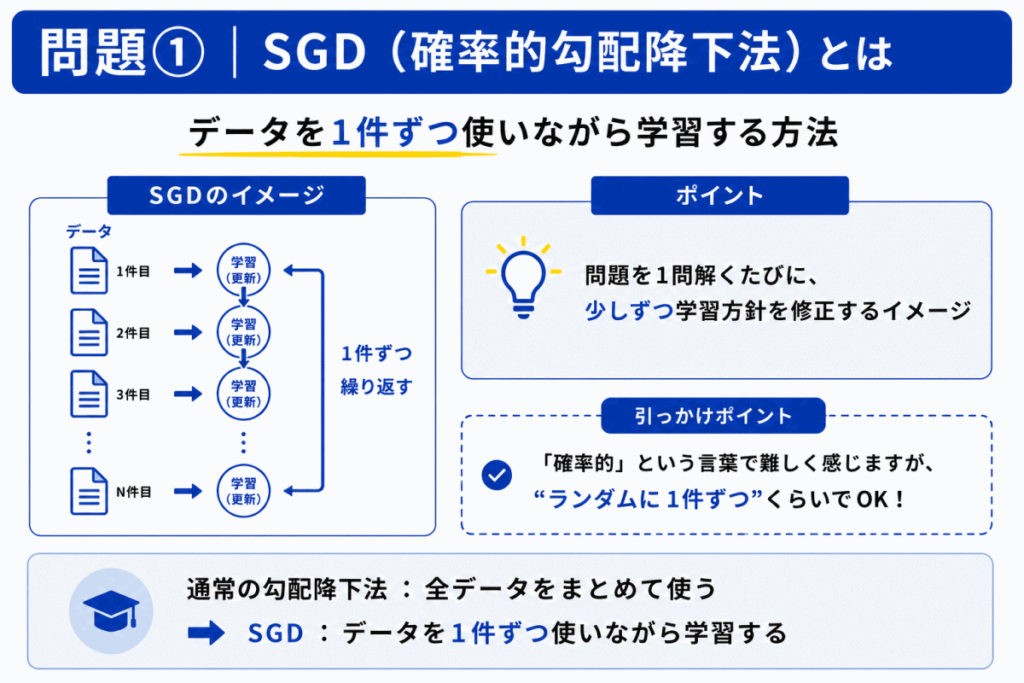

問題①

SGD(確率的勾配降下法)の説明として最も適切なものはどれか?

A. 全データを毎回まとめて学習する

B. データを1件ずつ使いながら学習する

C. 学習を停止する手法

D. 過学習を防ぐ手法

- 正解・解説(クリックすると開きます)

-

正解

B

解説

SGD(Stochastic Gradient Descent)は「データを1件ずつ使いながら学習する方法」です。

通常の勾配降下法では

- 全データ

- 全体平均

を使って更新します。

しかし、SGDでは「1件ごとに更新」します。

問題を1問解くたびに、少しずつ学習方針を修正するイメージです。

引っかけポイント

「確率的」という言葉で難しく感じますが「ランダムに1件ずつ」くらいでまずOKです。

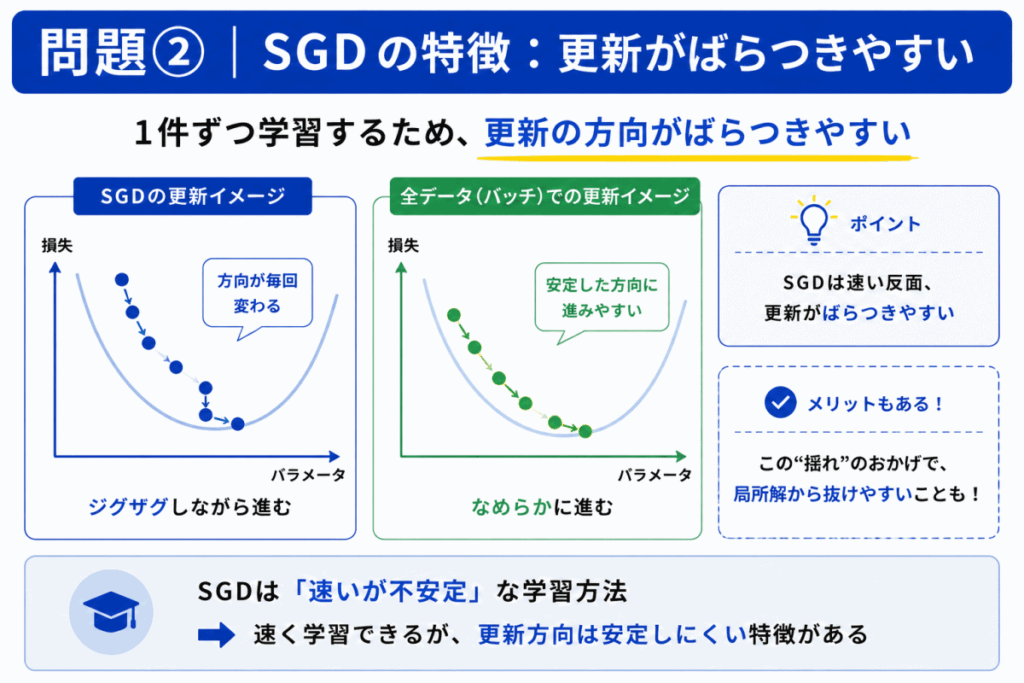

問題②

SGDの特徴として最も適切なものはどれか?

A. 更新が安定しやすい

B. 計算量が大きい

C. 更新がばらつきやすい

D. 必ず最適解に到達する

- 正解・解説(クリックすると開きます)

-

正解

C

解説

SGDは1件ずつ学習するため「更新方向がばらつきやすい」です。

つまり

- 良い方向へ進んだり

- 少しズレたり

を繰り返します。

ただしメリットもある

この「揺れ」のおかげで「局所解から抜けやすい」ことがあります。

SGD「速いが不安定」です。

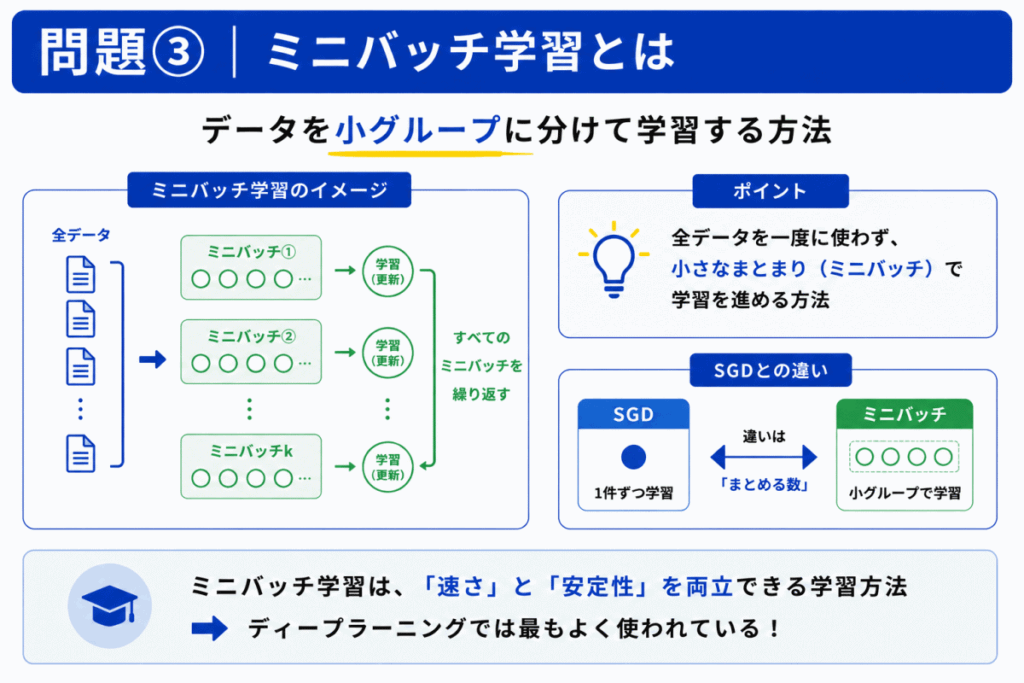

問題③

ミニバッチ学習の説明として最も適切なものはどれか?

A. 全データを1回で使う

B. データを小分けして学習する

C. 学習を止める

D. ニューロンを削除する

- 正解・解説(クリックすると開きます)

-

正解

B

解説

ミニバッチ学習は「データを小グループに分けて学習する方法」です。

例えば

- 32件

- 64件

- 128件

などの単位で学習します。

SGDとの違い

SGD → 1件ずつ

ミニバッチ → 小グループずつ

超重要

現在のディープラーニングでは「ミニバッチ学習が主流」です。

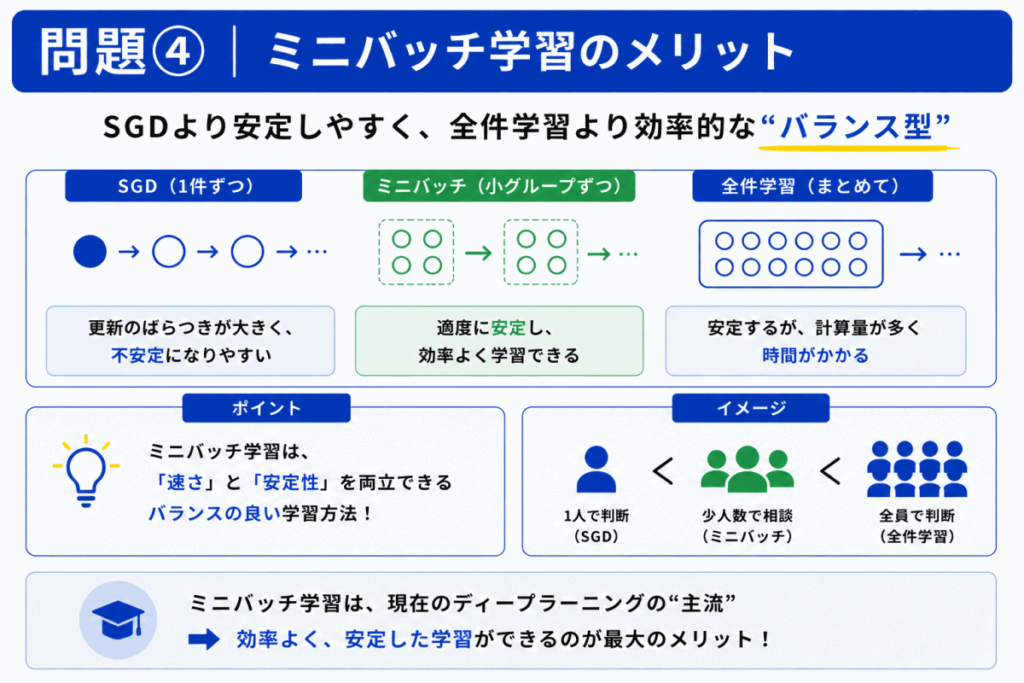

問題④

ミニバッチ学習のメリットとして最も適切なものはどれか?

A. 更新が極端に不安定になる

B. SGDより安定しやすい

C. データが不要になる

D. 過学習を完全に防げる

- 正解・解説(クリックすると開きます)

-

正解

B

解説

ミニバッチ学習は

- SGDほど不安定ではない

- 全件学習ほど重くない

という「バランス型」です。

イメージ

SGD → 1人の意見だけで判断

ミニバッチ → 少人数で相談して判断

理解ポイント

現在は「速さ と 安定性 の両立」が重要です。

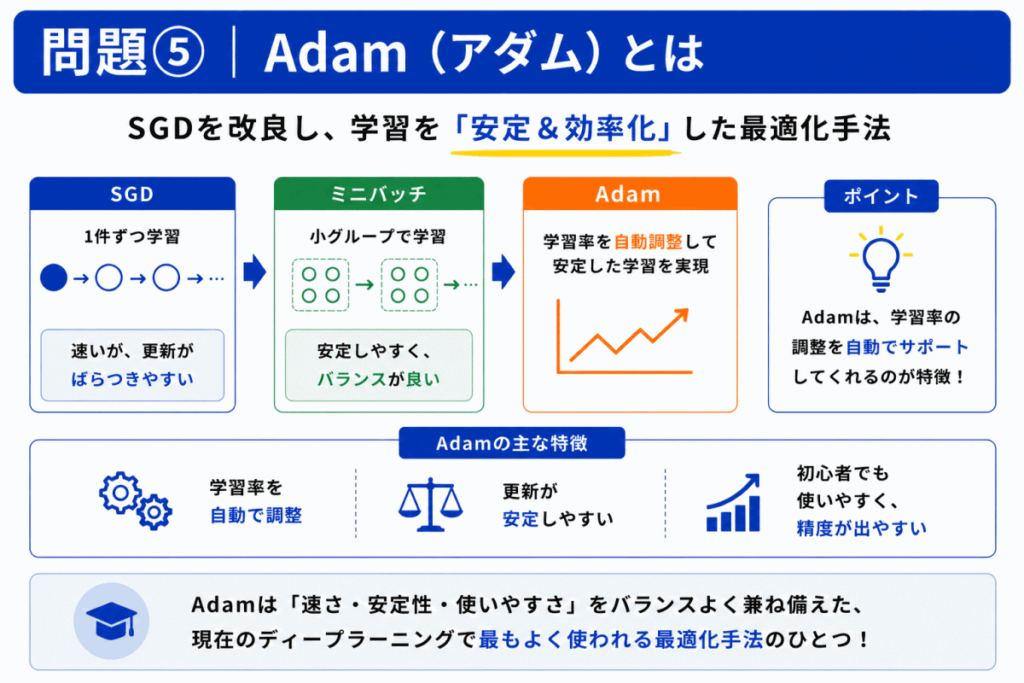

問題⑤

Adamの説明として最も適切なものはどれか?

A. SGDを改良した最適化手法

B. データを削除する手法

C. 画像処理専用モデル

D. 活性化関数の一種

- 正解・解説(クリックすると開きます)

-

正解

A

解説

Adamは「SGDをさらに改良した手法」です。

特徴は

- 学習率を自動調整

- 更新方向を安定化

できることです。

なぜ人気?

初心者でも

- 学習しやすい

- 安定しやすい

- 精度が出やすい

ため 実務でも非常によく使われます。

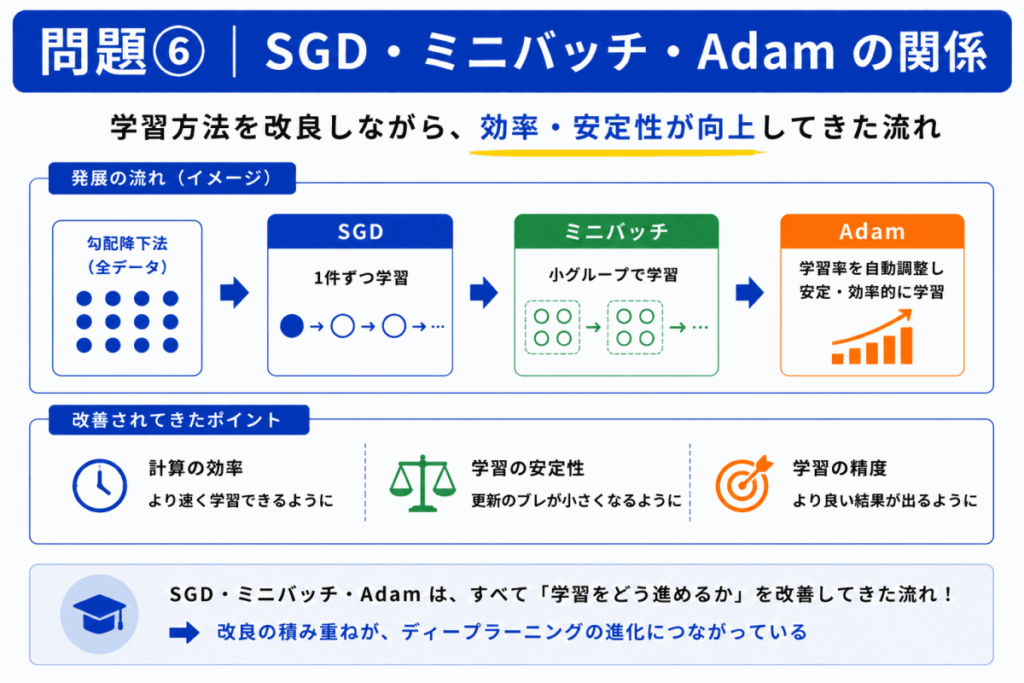

問題⑥

SGD・ミニバッチ・Adam の関係として最も適切なものはどれか?

A. 全く別ジャンルの技術

B. すべて過学習対策

C. 学習方法を改善した流れ

D. すべて画像処理専用

- 正解・解説(クリックすると開きます)

-

正解

C

解説

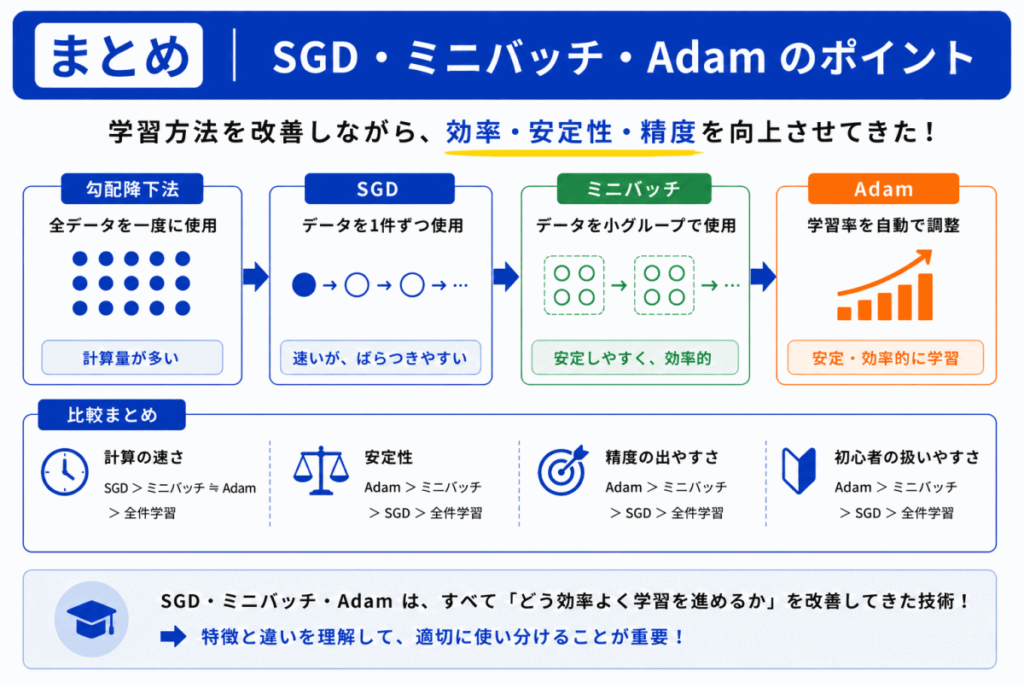

流れとしては 勾配降下法 → SGD → ミニバッチ → Adam という「改善の歴史」があります。

改善ポイント

- 計算速度

- 安定性

- 学習効率

を改善してきました。

G検定で重要

単独暗記ではなく「何を改善したのか」を理解することが重要です。

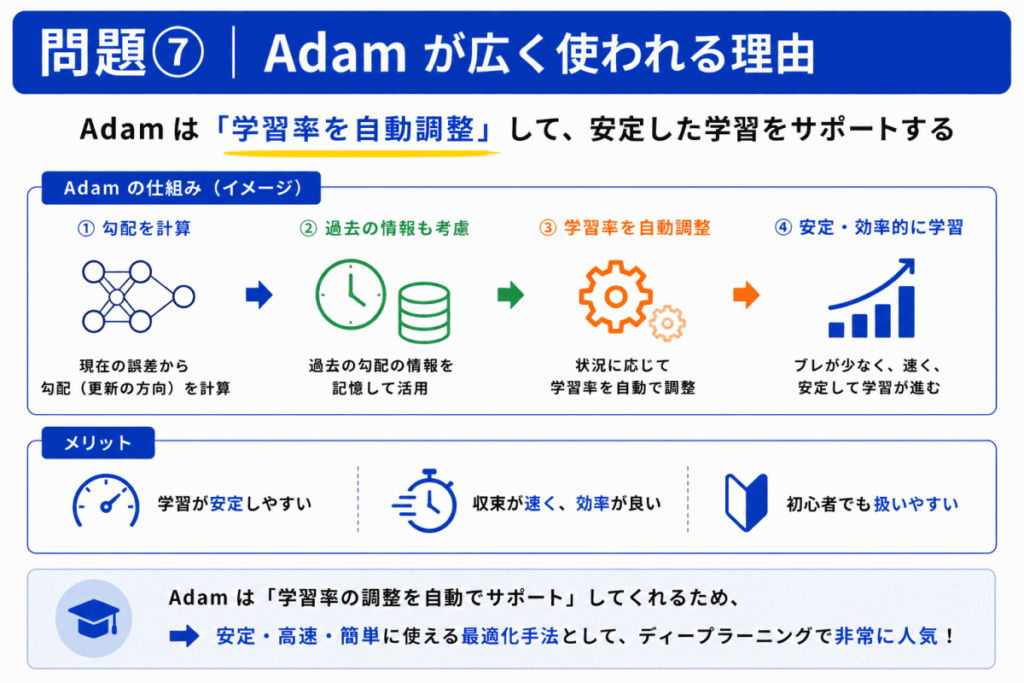

問題⑦

次のうち、Adamが広く使われる理由として最も適切なものはどれか?

A. 計算が非常に単純だから

B. 学習率調整を補助し、安定しやすいから

C. データが不要だから

D. 過学習を完全に防げるから

- 正解・解説(クリックすると開きます)

-

正解

B

解説

Adamは「学習率調整」をうまく補助 してくれるため

- 学習が安定しやすい

- 初心者でも扱いやすい

特徴があります。

理解ポイント

ディープラーニングでは「どう学習を進めるか」が非常に重要です。

Adamは、その「学習の進め方」を改善した技術 です。

まとめ

SGD・ミニバッチ・Adamは、すべて「どう効率良く学習するか」を改善してきた技術です。

特にG検定では

- SGDとの違い

- ミニバッチとの関係

- Adamの役割

を比較形式で問われやすくなります。

単なる用語暗記ではなく

- なぜ改良されたのか

- 何を解決したのか

- どう違うのか

まで整理して理解することが重要です。

関連記事・おすすめ記事

この予想問題よりもSGD・ミニバッチ・Adamを詳しく整理しています。

もっと詳しく学習した方はご覧ください。

不合格体験記です。私のような失敗をしないように確認しましょう。