【G検定|理解型予想問題】活性化関数

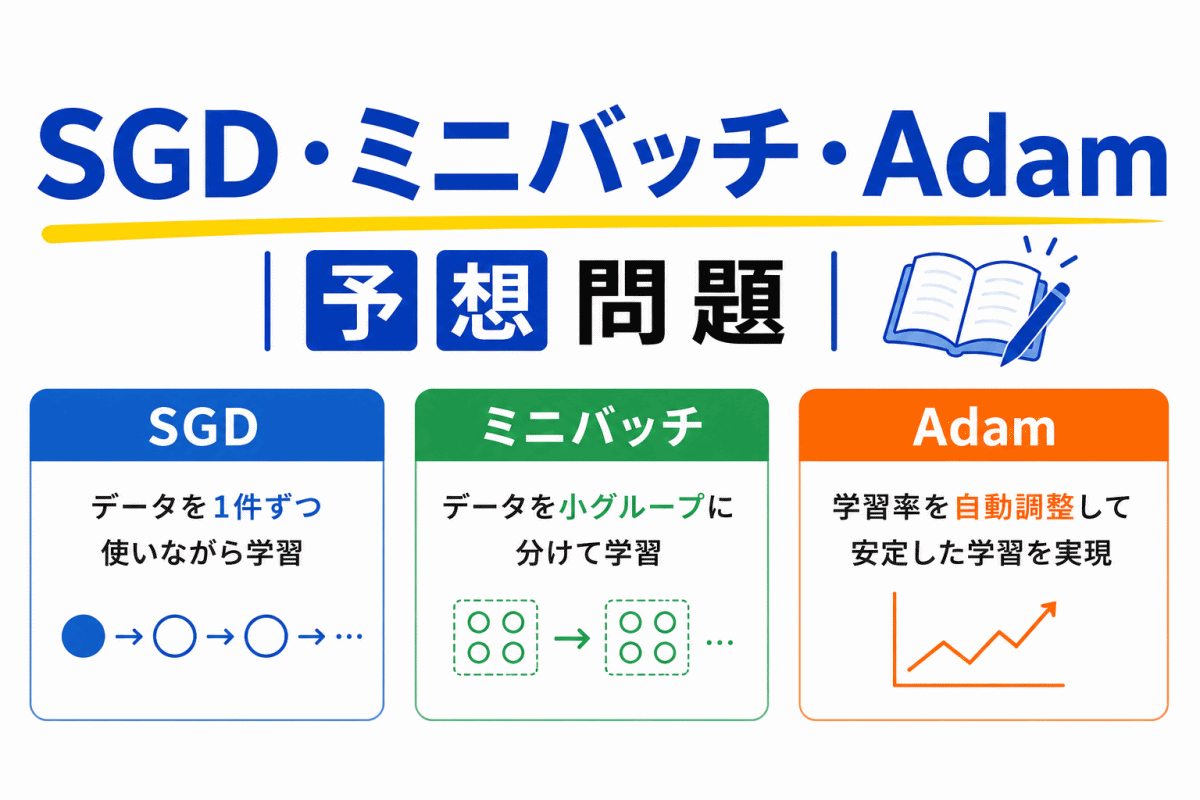

活性化関数は、G検定でも重要テーマです。

ただし

- シグモイド

- ReLU

- tanh

を丸暗記しているだけでは、少し聞き方が変わると混乱しやすくなります。

この記事では、単なる暗記ではなく

- なぜ活性化関数が必要なのか

- なぜReLUがよく使われるのか

- どこが混同ポイントなのか

まで含めて、理解型で整理していきます。

問題①

活性化関数の役割として最も適切なものはどれか?

- A. 学習データを増やす

- B. モデルに非線形性を与える

- C. 誤差を小さくする

- D. 学習率を調整する

- 正解・解答(クリックで開きます)

-

正解

B

解説

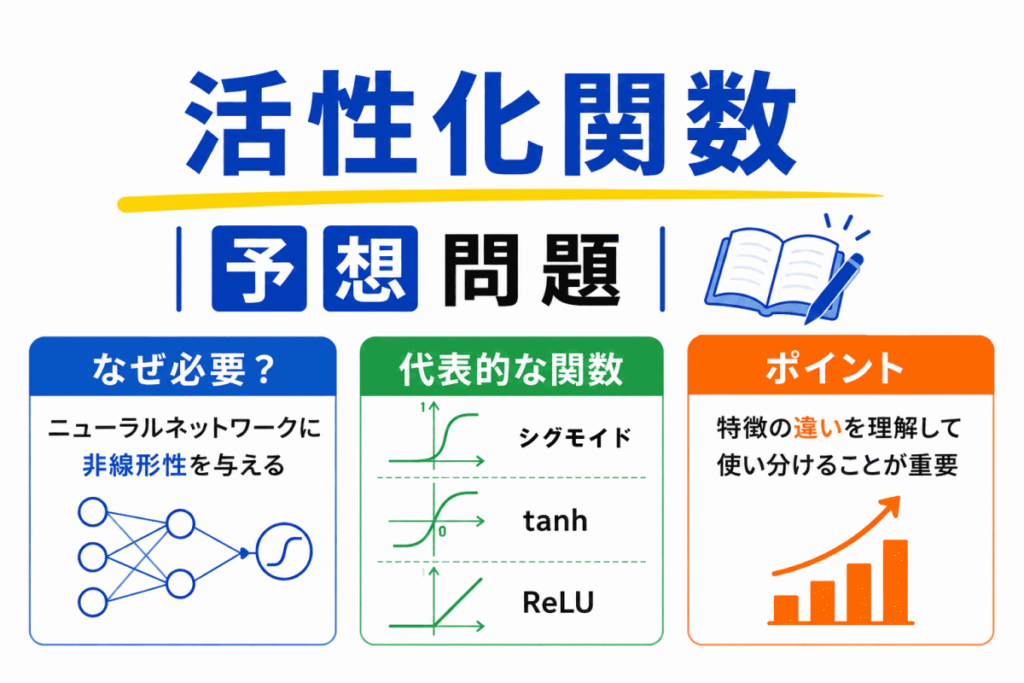

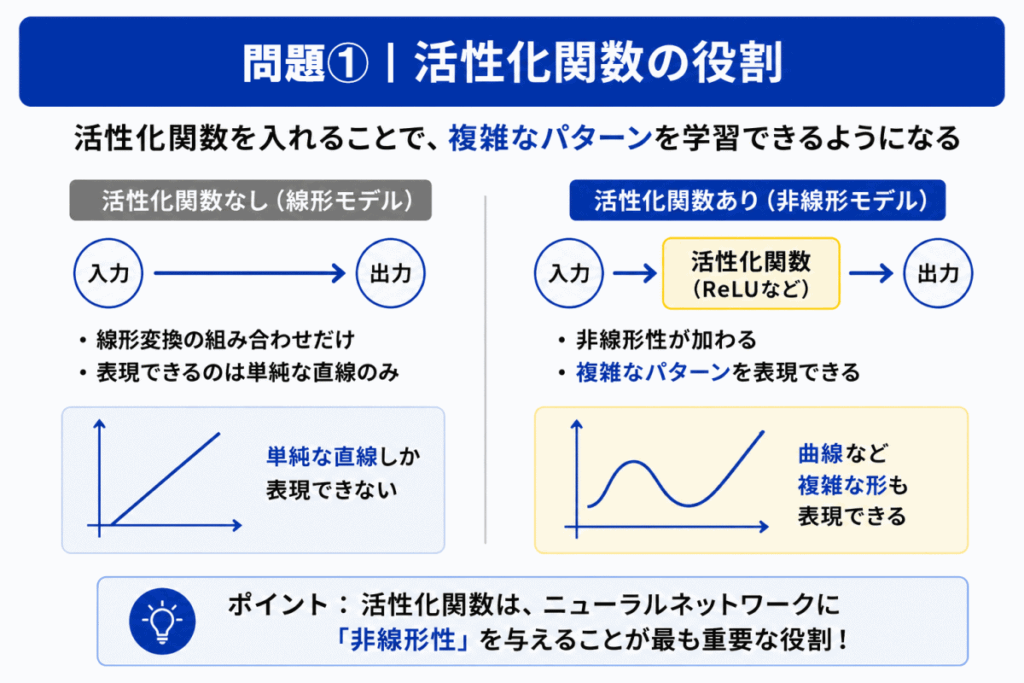

活性化関数の最も重要な役割は「非線形性」を与えること です。

ニューラルネットワークは、活性化関数を入れないと「ただの線形変換」の組み合わせになってしまいます。

すると複雑なパターンを学習できません。

そのため

- ReLU

- シグモイド

- tanh

などを使い、複雑な表現を可能にしています。

補足(理解ポイント)

ここはG検定でかなり重要です。

初心者は「活性化関数 = 出力を変えるもの」とだけ覚えがちです。

しかし本質は「線形だけでは複雑な問題を解けない」にあります。

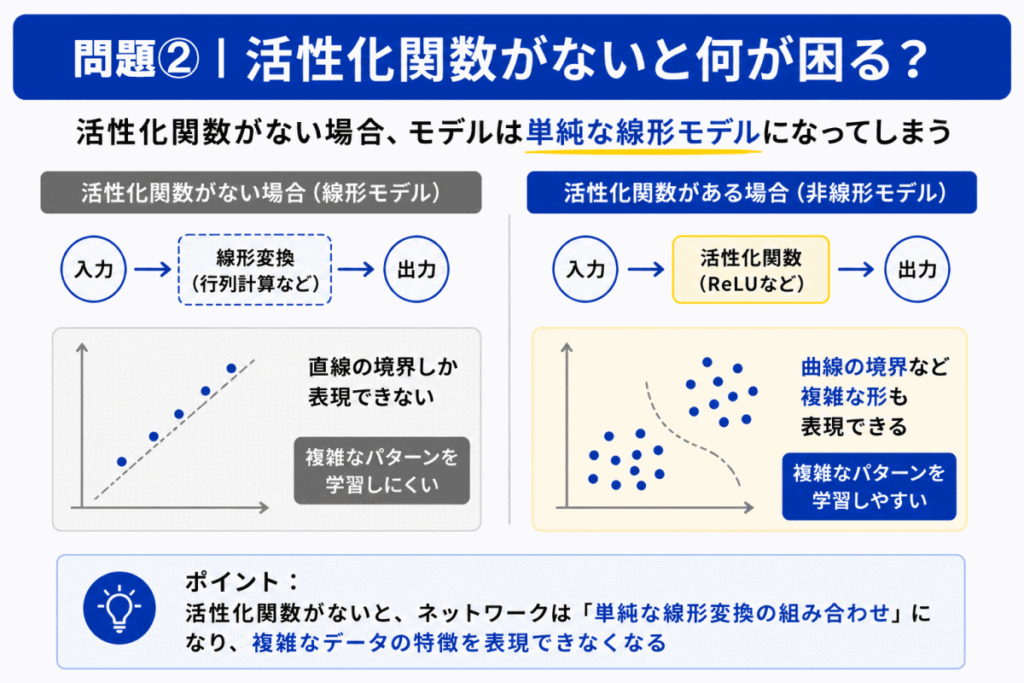

問題②

活性化関数を使わなかった場合に起きやすいこととして最も適切なものはどれか?

- A. 学習データが不足する

- B. モデルが複雑なパターンを学習しにくくなる

- C. GPUが使えなくなる

- D. 学習率が自動調整される

- 正解・解説(クリックで開きます)

-

正解

B

解説

活性化関数を使わない場合、ニューラルネットワークは実質的に「単純な線形モデル」に近くなります。

すると

- 画像認識

- 自然言語処理

- 複雑な分類

などへの対応が難しくなります。

つまり「複雑な特徴を学習できなくなる」ことが大きな問題です。

補足(引っかけポイント)

G検定では「活性化関数がないと何が困るのか」を問われることがあります。

単なる用語暗記ではなく「非線形性が失われる」まで理解しておくことが重要です。

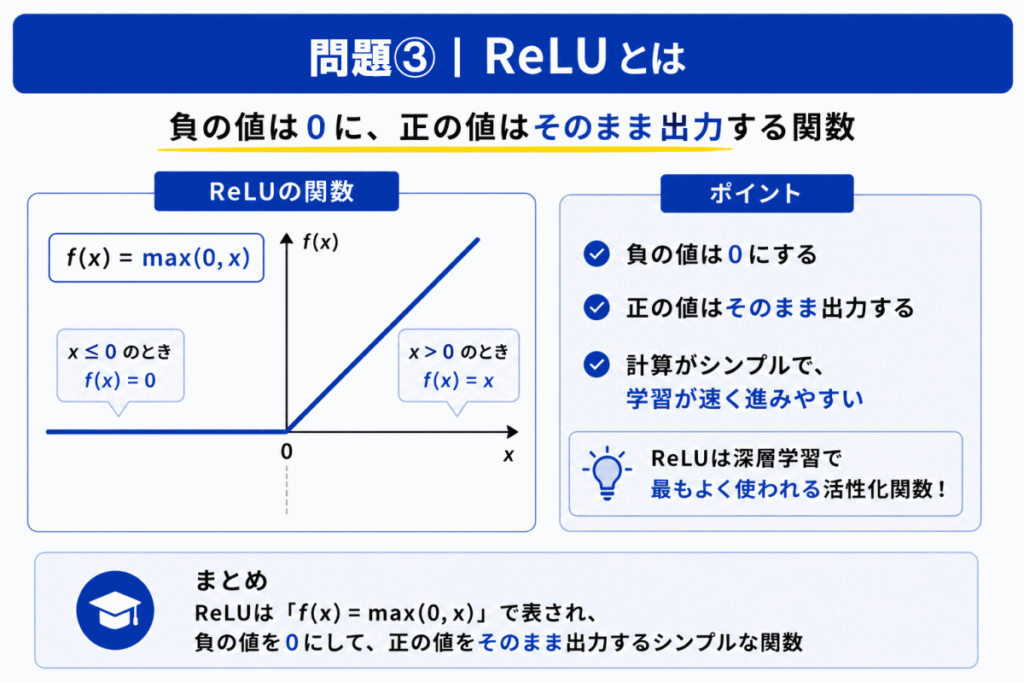

問題③

ReLUの特徴として最も適切なものはどれか?

- A. 常に0〜1の値を出力する

- B. 負の値をそのまま出力する

- C. 正の値をそのまま出力する

- D. 出力が必ず-1〜1になる

- 正解・解答(クリックで開きます)

-

正解

C

解説

ReLU(Rectified Linear Unit)は

- 負の値 → 0

- 正の値 → そのまま出力

というシンプルな構造を持っています。

このシンプルさにより

- 計算が軽い

- 学習しやすい

- 勾配消失が起きにくい

というメリットがあります。

補足(混同ポイント)

ここは

- シグモイド

- tanh

- ReLU

の違いを比較されやすいポイントです。

特に「0〜1に収まる」のはシグモイド。ReLUではありません。

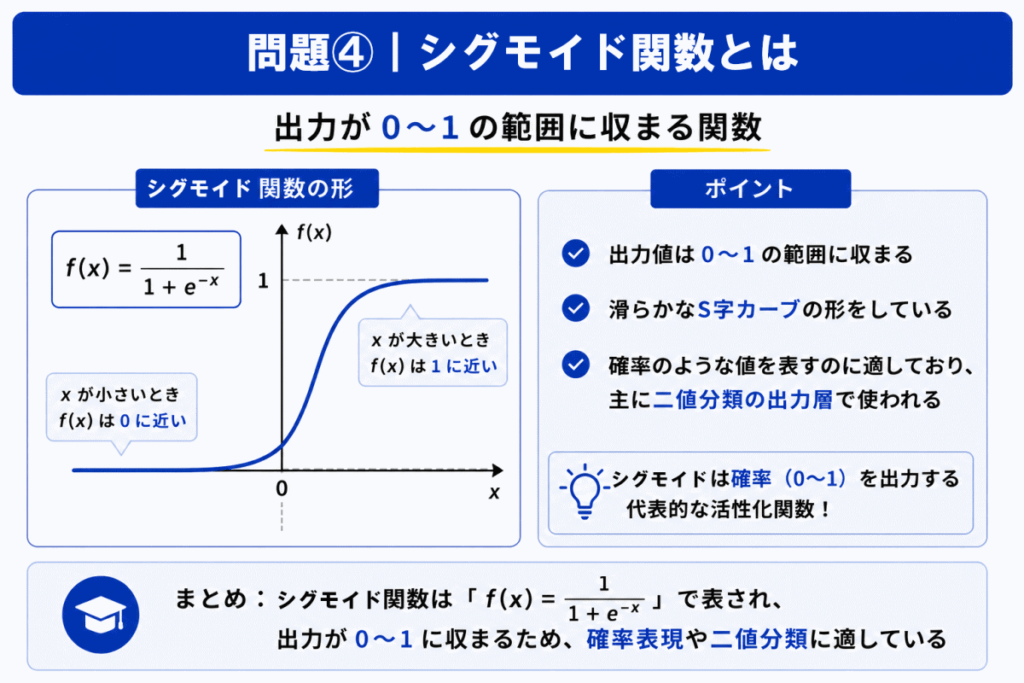

問題④

シグモイド関数の特徴として最も適切なものはどれか?

- A. 出力値は0〜1の範囲に収まる

- B. 正の値をそのまま出力する

- C. 負の値のみ出力する

- D. 出力値に上限がない

- 正解・解答(クリックで開きます)

-

正解

A

解説

シグモイド関数は 出力が0〜1に収まる 特徴があります。

そのため

- 確率表現

- 二値分類

などで利用されます。

補足(重要)

昔はシグモイドがよく使われていました。

しかし、現在は ReLUの方が主流 です。

理由は「勾配消失問題」が起きやすいためです。

勾配消失問題とは、AIが学習を重ねる途中で「どこを直せばいいか」の情報が弱くなり、学習が進みにくくなる問題です。

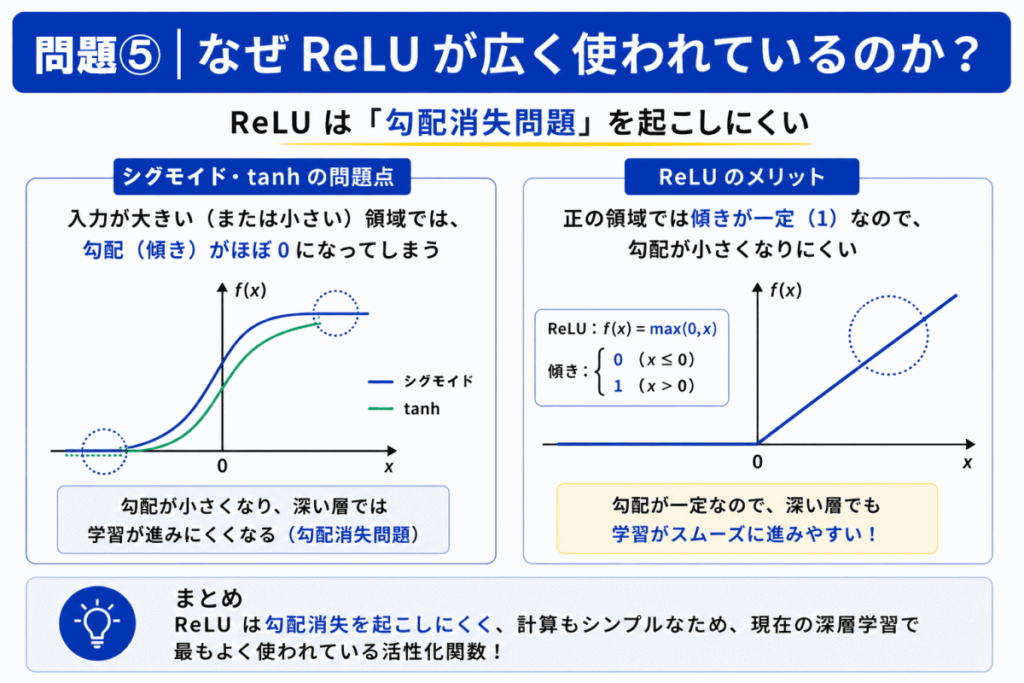

問題⑤

ReLUが現在広く使われている理由として最も適切なものはどれか?

- A. 出力が必ず0〜1になるため

- B. 学習率を自動調整できるため

- C. 勾配消失問題を起こしにくいため

- D. 過学習を完全に防げるため

- 正解・解答(クリックで開きます)

-

正解

C

解説

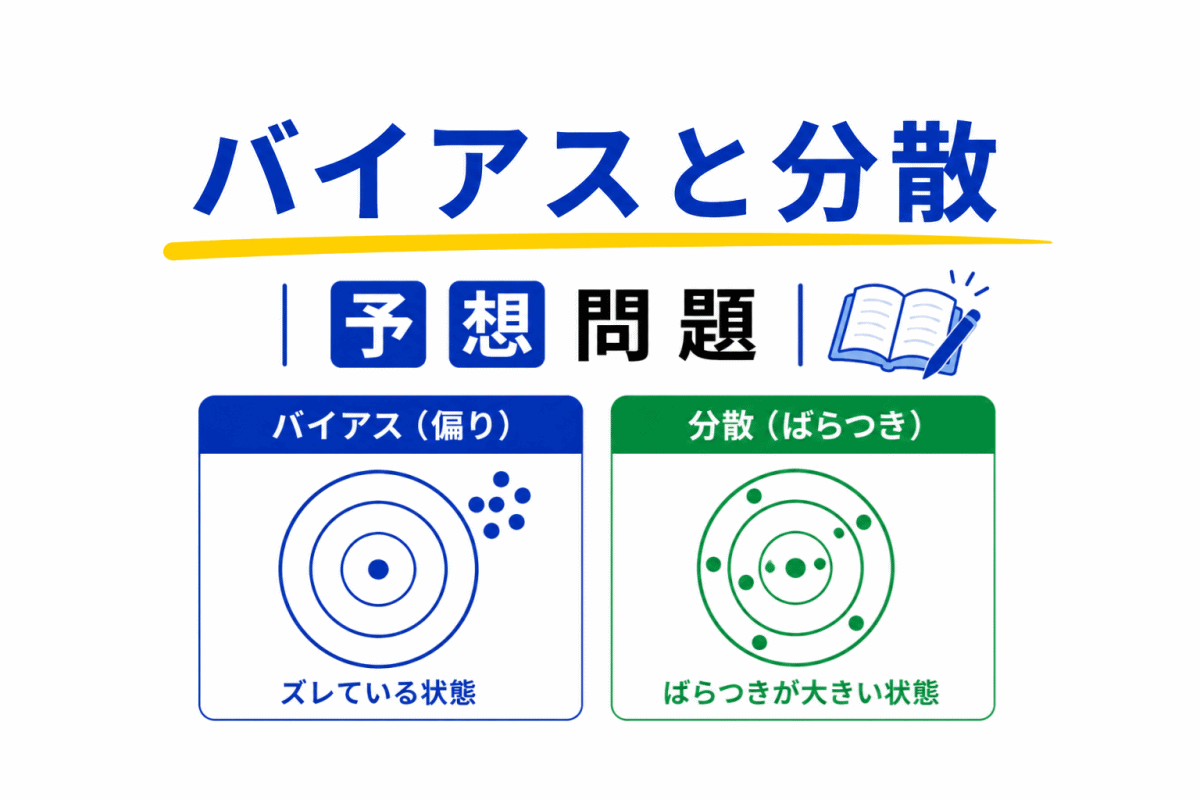

シグモイドやtanhでは

- 層が深くなる

- 勾配が小さくなる

ことで「勾配消失問題」が発生しやすくなります。

勾配消失問題とは、AIが学習を重ねる途中で「どこを直せばいいか」の情報が弱くなり、学習が進みにくくなる問題です。

一方ReLUは 正の領域で勾配が一定 のため、勾配消失が起きにくい特徴があります。

その結果 深層学習で広く利用 されるようになりました。

補足(超重要)

G検定では「なぜReLUが普及したのか」はかなり重要です。

単なる「ReLUがよく使われる」ではなく「勾配消失を起こしにくい」までセットで理解しましょう。

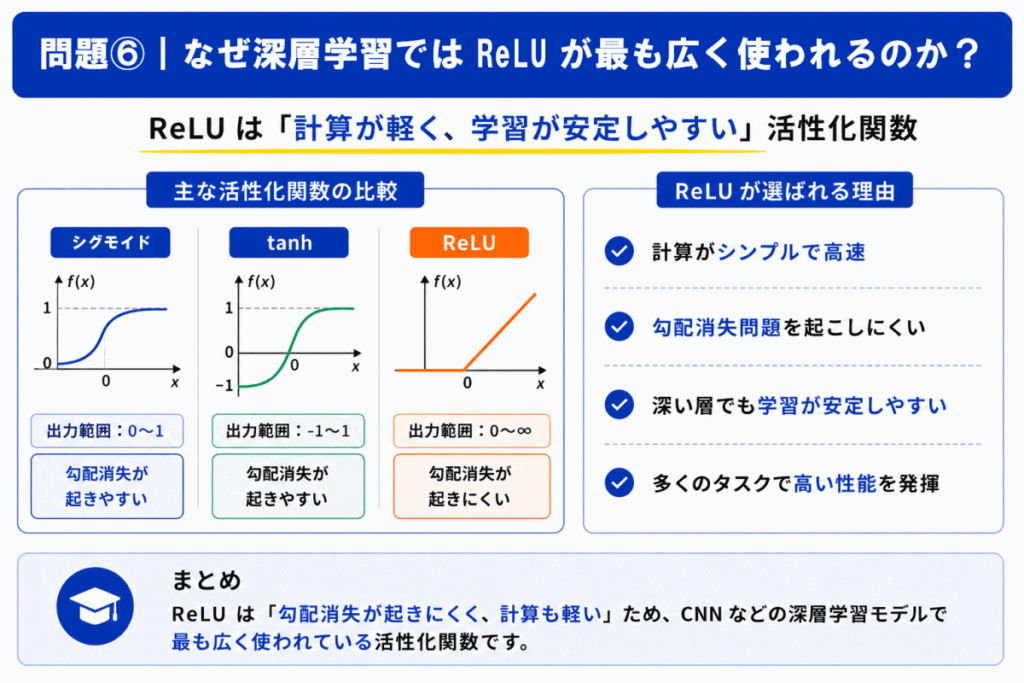

問題⑥

画像認識などの深層学習で、現在最も広く使われている活性化関数として適切なものはどれか?

- A. ReLU

- B. シグモイド

- C. tanh

- D. ソフトマックス

- 正解・解答(クリックで開きます)

-

正解

A

解説

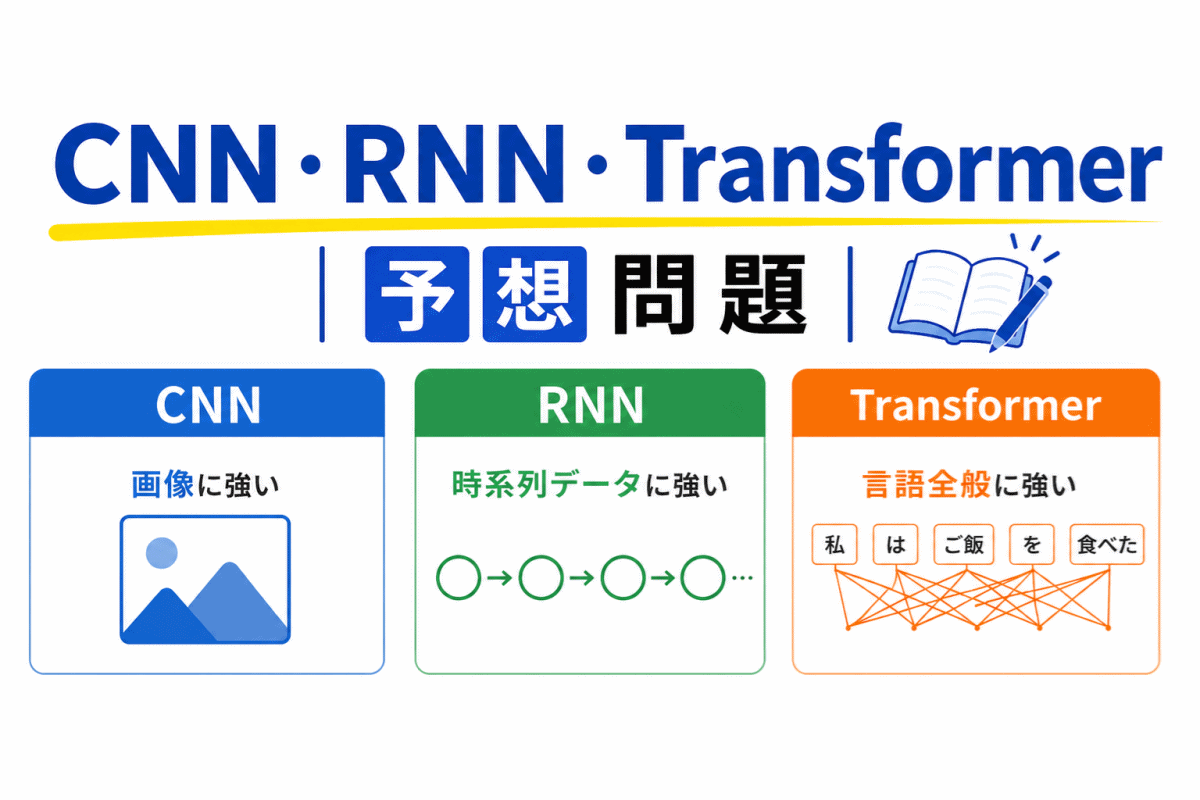

現在の深層学習(ディープラーニング)では ReLU系 の活性化関数が広く利用されています。

理由は

- 計算が軽い

- 学習しやすい

- 勾配消失を起こしにくい

ためです。

特にCNNなどでは頻繁に利用されます。

補足(引っかけ)

ソフトマックスは活性化関数として扱われることもありますが、主に出力層 で使われます。

一方ReLUは、中間層で広く利用 されるのが特徴です。

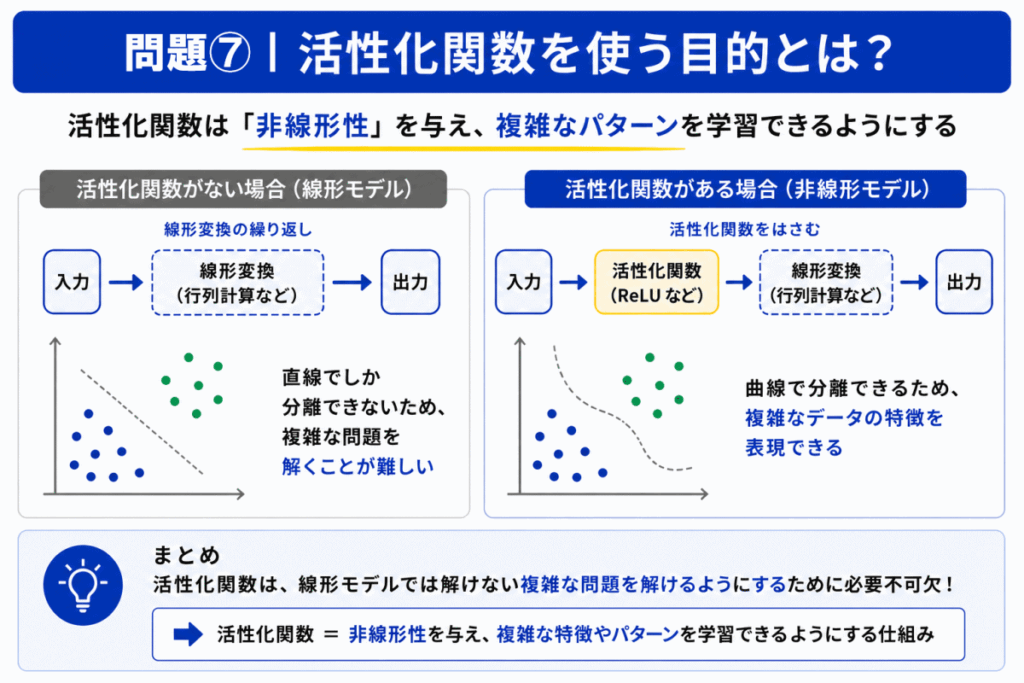

問題⑦

次のうち、「活性化関数を利用する目的」として最も適切なものはどれか?

- A. モデルを単純な線形計算だけにするため

- B. 複雑な特徴やパターンを学習できるようにするため

- C. 学習データ数を増やすため

- D. 過学習を完全に防ぐため

- 正解・解答(クリックで開きます)

-

正解

B

解説

活性化関数の本質は「非線形な表現を可能にすること」です。

これによりニューラルネットワークは

- 画像

- 音声

- 言語

などの複雑な特徴を学習できるようになります。

もし活性化関数がなければ「深いネットワークでも単純な線形変換」に近くなってしまいます。

補足(サイト思想)

ここは「なぜ必要なのか」を理解しているかが重要です。

G検定では

- 用語暗記

- 関数名暗記

だけでは対応しにくい問題も出ます。

そのため「活性化関数がないと何が困るのか」まで整理して理解することが問い方変更への対応力につながります。

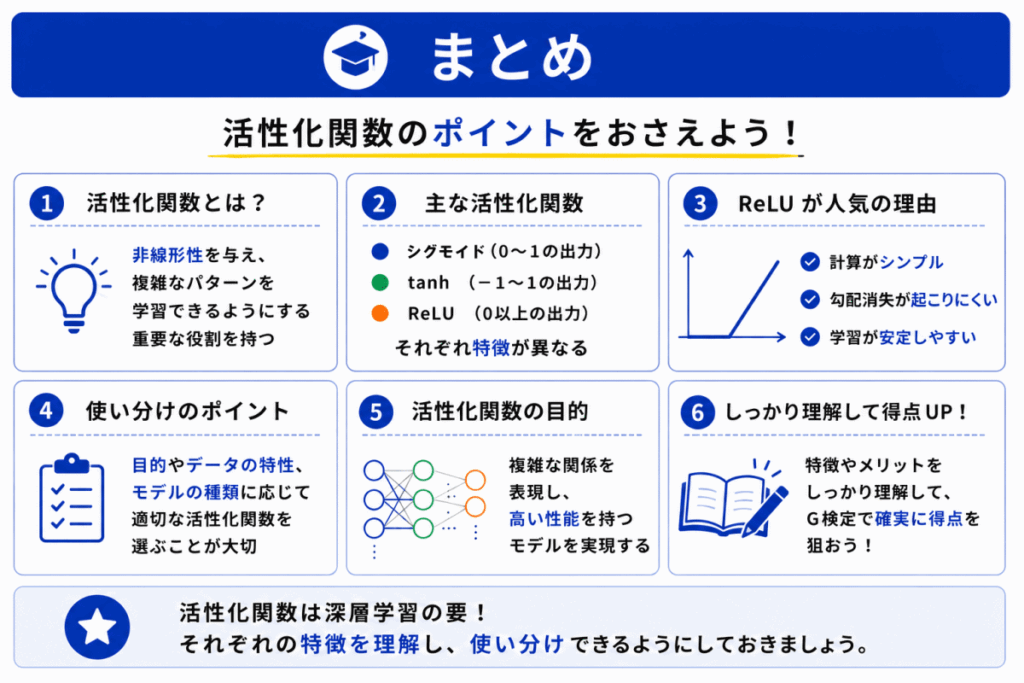

まとめ

活性化関数は「非線形性を与える」ための重要な仕組みです。

特に

- シグモイド

- tanh

- ReLU

の違いはG検定重要ポイントです。

ただし「ReLUが主流」だけを暗記していると

- なぜ使われるのか

- 何を改善したのか

- シグモイドとの違い

で混乱しやすくなります。

重要なのは「なぜその関数が必要なのか」を理解することです。

理解ベースで整理すると、問い方が変わっても対応しやすくなります。

関連記事・おすすめ記事

この予想問題よりも活性化関数を詳しく整理しています。

もっと詳しく学習したい方はご覧ください。

不合格体験記です。私のような失敗をしないように確認しましょう。