【G検定対策】活性化関数とは?わかりやすく整理

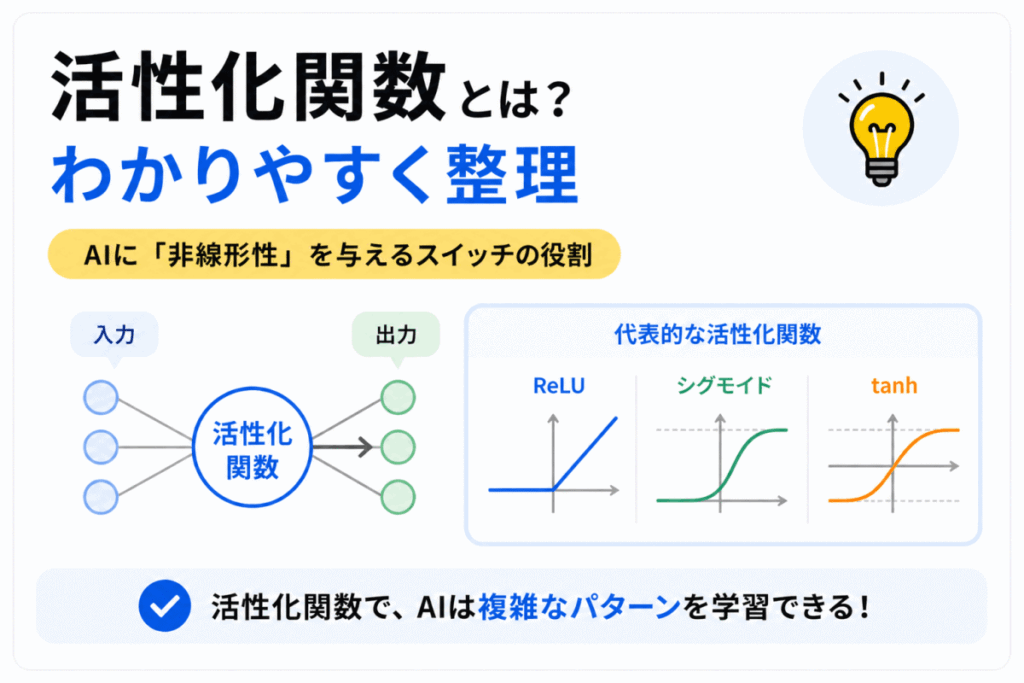

ニューラルネットワークが「ただの計算機」で終わるか「賢いAI」になるか、その分かれ道が 活性化関数 です。

もし、この仕組みがなければ、AIは単純な直線しか表現できず、画像認識や翻訳のような複雑な処理はできません。

つまり、活性化関数はAIの「表現力」を決める超重要パーツです。

この記事では、初心者でも一発で理解できるように、仕組み・役割・代表的な種類を図解ベースで整理します。

活性化関数とは?

活性化関数とは…

活性化関数=出力に「変化(クセ)」をつける関数

活性化関数=出力に「変化(クセ)」をつける関数

です。

- そのまま出力するとただの足し算になる

- 変化をつけることで「非線形」になる

非線形とは「まっすぐなルールだけでは説明できない複雑な関係」のことです。

活性化関数は、AIにその複雑さを表現する力を与えます。

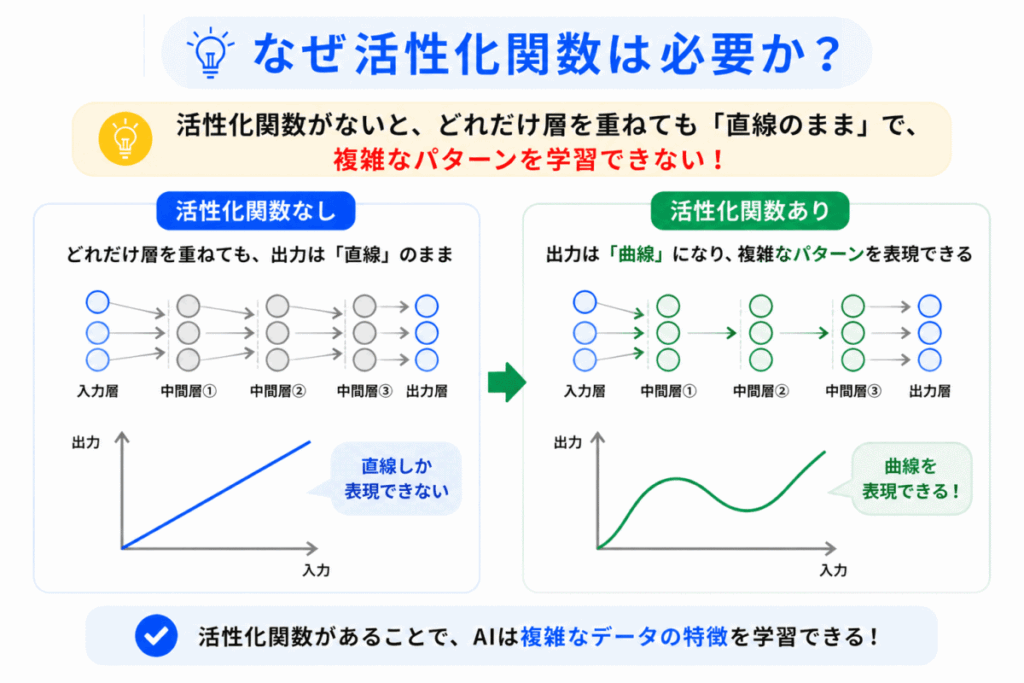

なぜ活性化関数は必要か?

活性化関数がないと…

- 線形計算だけだと「単純な足し算」しかできない

- 複雑なパターン(画像・言語)が表現できない

活性化関数がないと、どれだけ層を増やしても「結局1回の計算」と同じになる。

つまり、AIが賢くなりません。

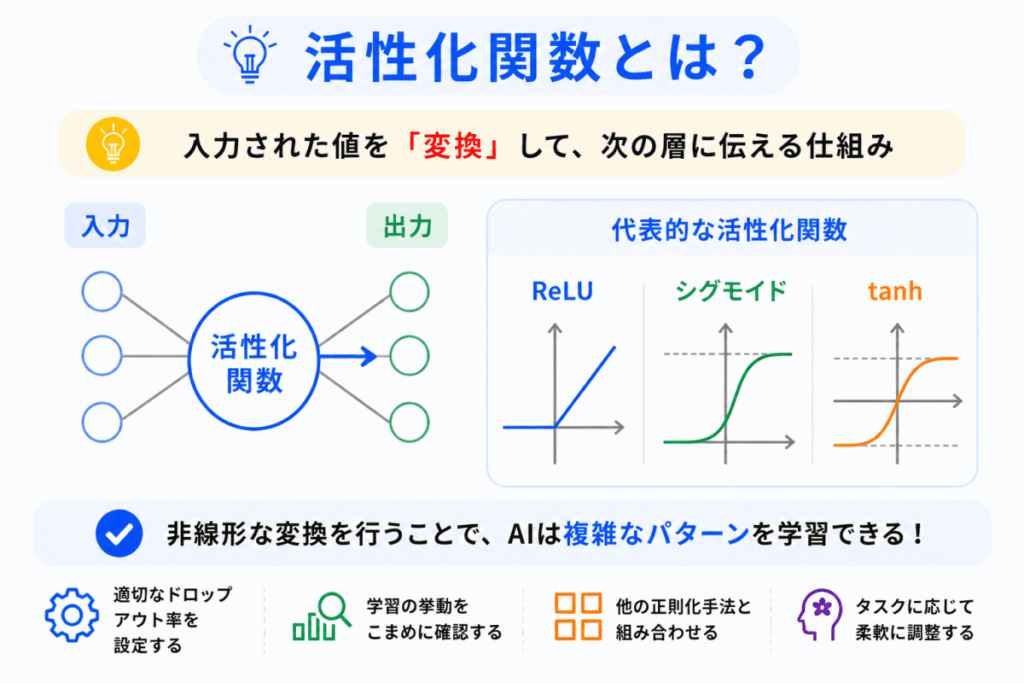

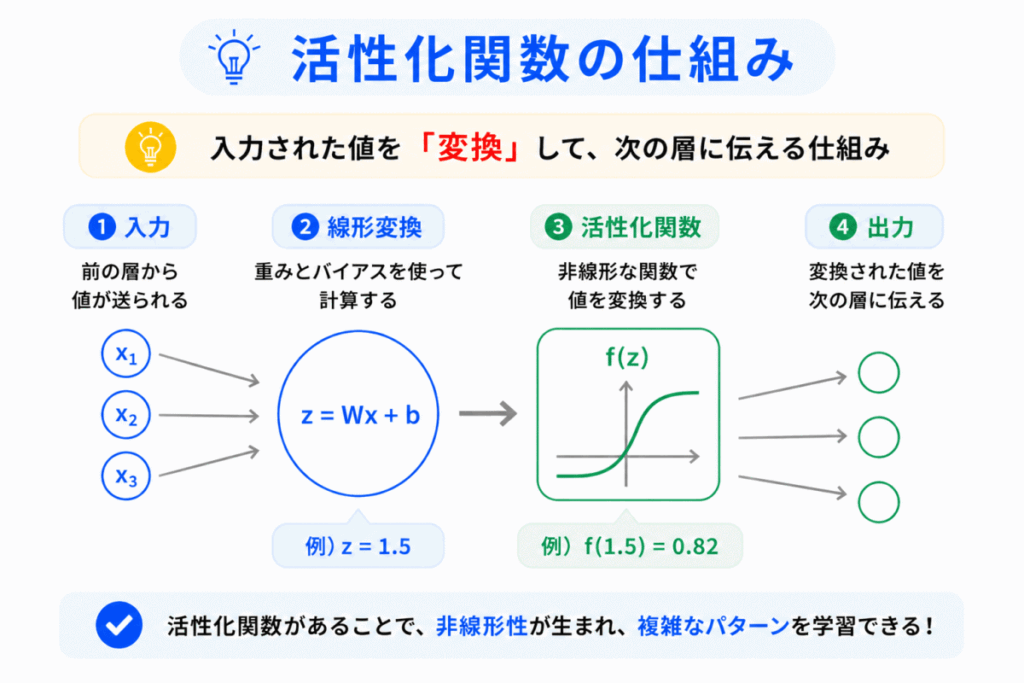

活性化関数の仕組み

活性化関数の仕組みをまとめると下記の特徴があげられます。

- 入力値を受け取る

- 一定のルールで変換する

- 出力を次の層へ渡す

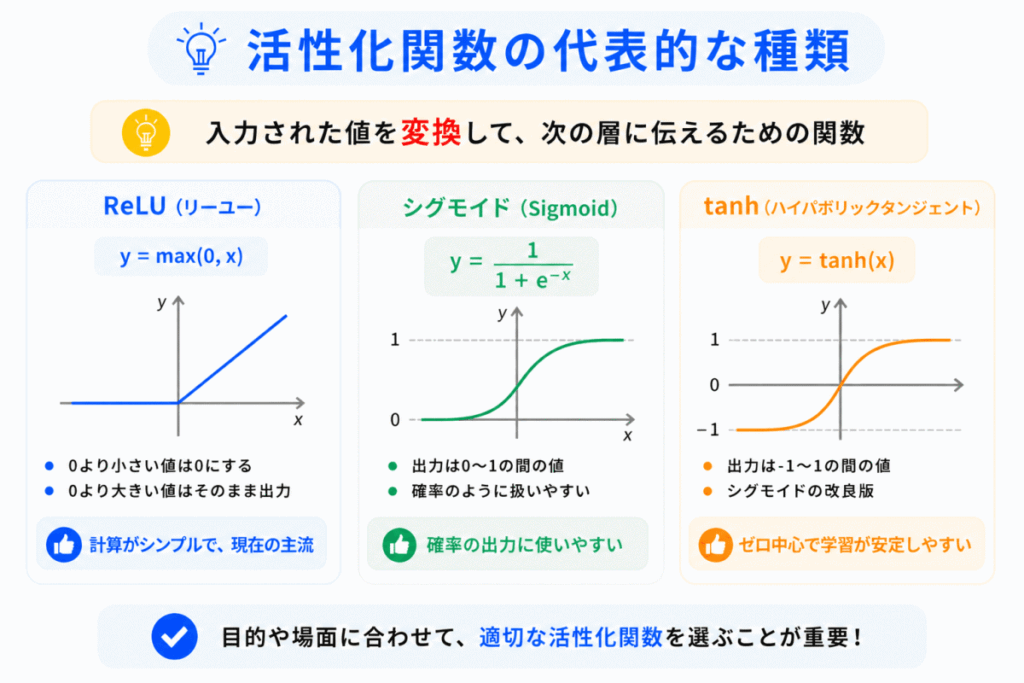

活性化関数の代表的な種類

ReLU(最重要)

0未満は0、0以上はそのまま(現在の主流)

0未満は0、0以上はそのまま(現在の主流)

■ 特徴

- 計算が速い

- 勾配消失しにくい

- ディープラーニングの標準

シグモイド

0〜1に圧縮する(確率っぽい出力)

0〜1に圧縮する(確率っぽい出力)

■ 補足

- 昔は主流

- 勾配消失が起きる

- 現在は出力層で使われることが多い

tanh

-1〜1に圧縮(シグモイドの強化版)

-1〜1に圧縮(シグモイドの強化版)

■ 補足

- 0中心で扱いやすい

- それでも勾配消失は起きる

- RNNで使われることがある

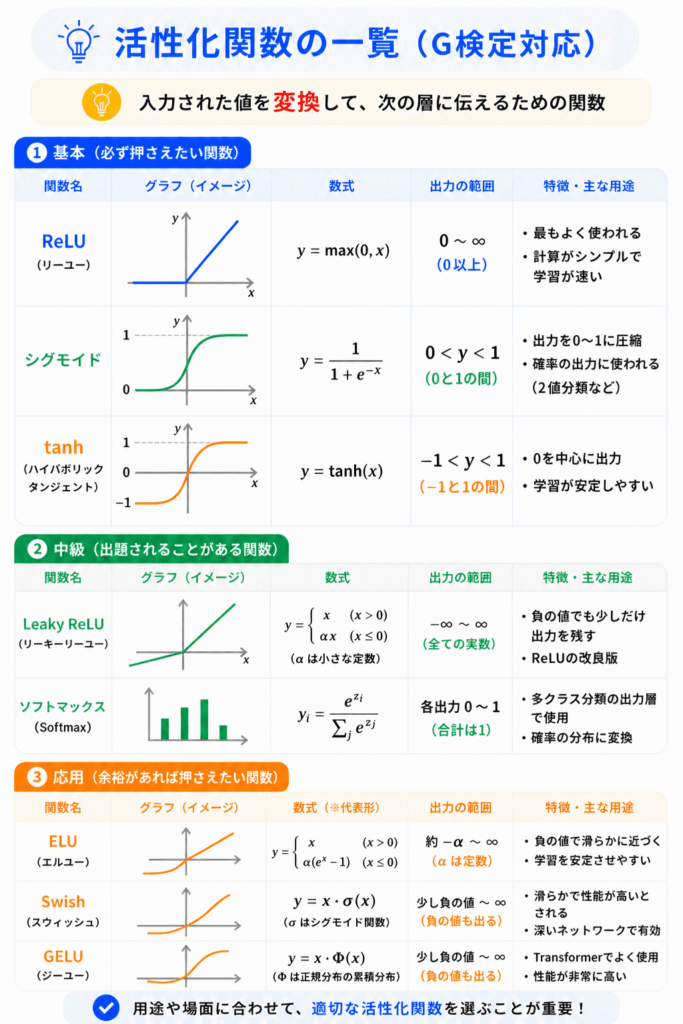

Leaky ReLU

マイナスも少しだけ通すReLU

マイナスも少しだけ通すReLU

■ 補足

- ReLUの欠点(死んだニューロン)対策

- 負の値もわずかに出力

ソフトマックス(Softmax)

合計1になる確率分布に変換

合計1になる確率分布に変換

■ 補足

- 分類問題で使用

- 「どれが一番か」を出す

- G検定頻出

活性化関数一覧表

G検定で頻出の活性化関数はこれまで記載しましたが、シラバスに掲載されているものをまとめました。

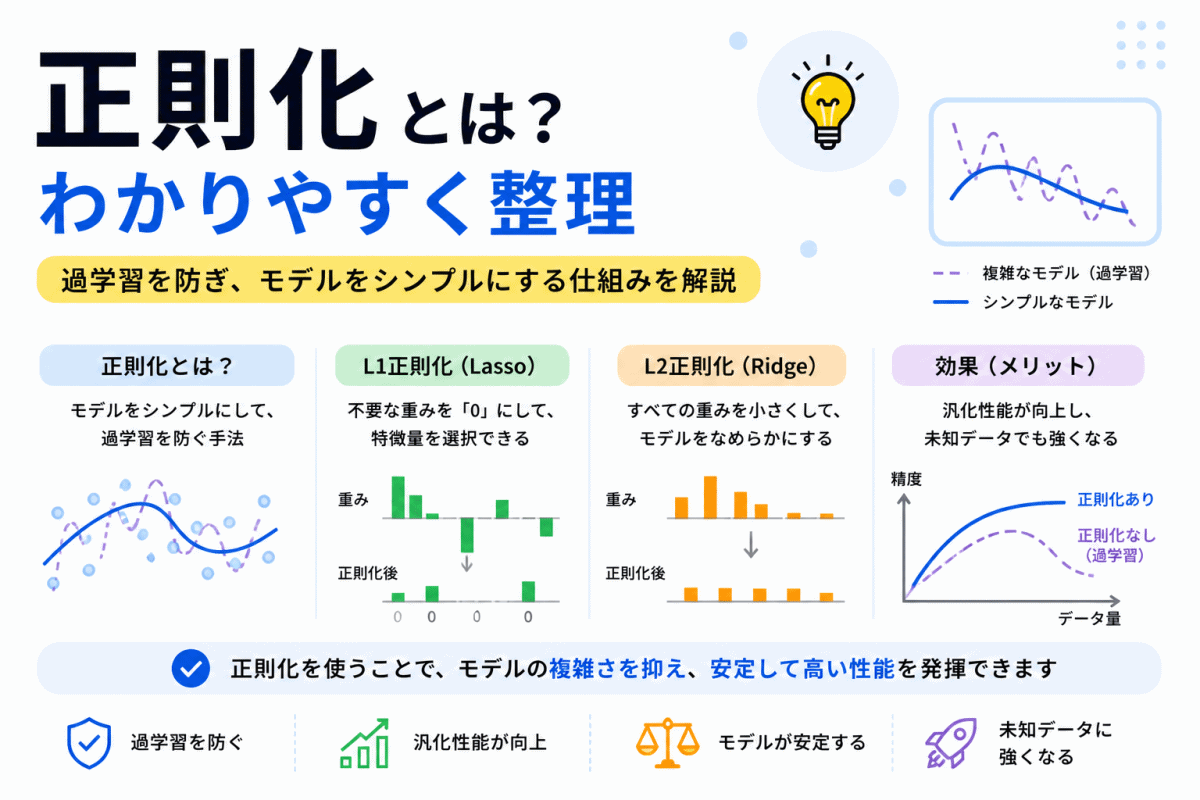

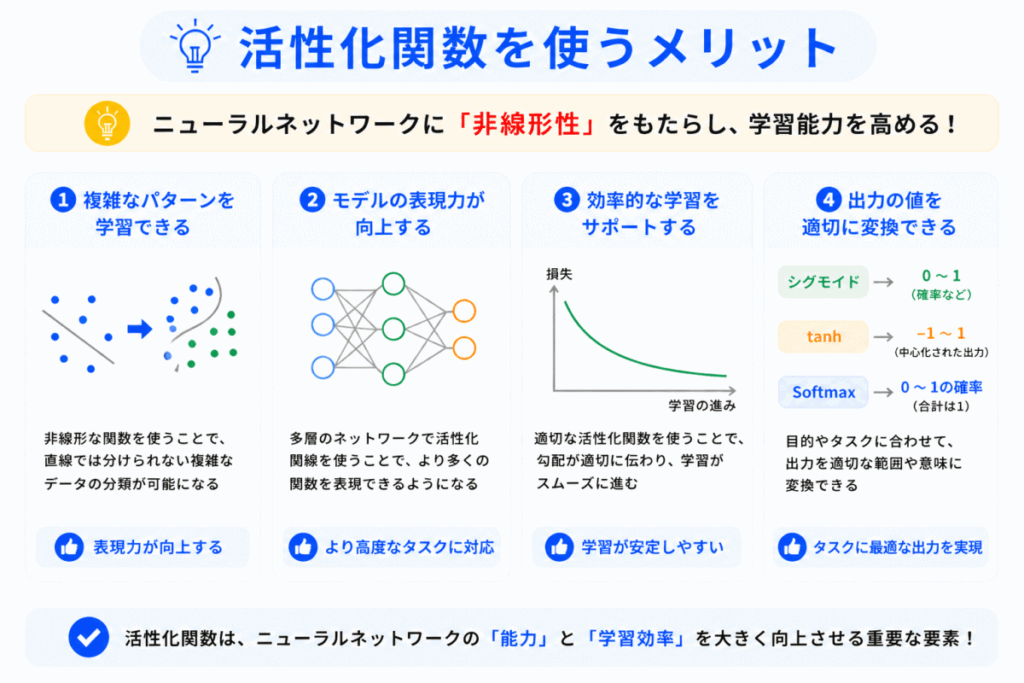

活性化関数を使用するメリット

活性化関数を使用するメリットとして下記があげられます。

- 複雑なパターンを学習できる

- モデルの表現力が向上する

- 出力の値を適切に変換できる

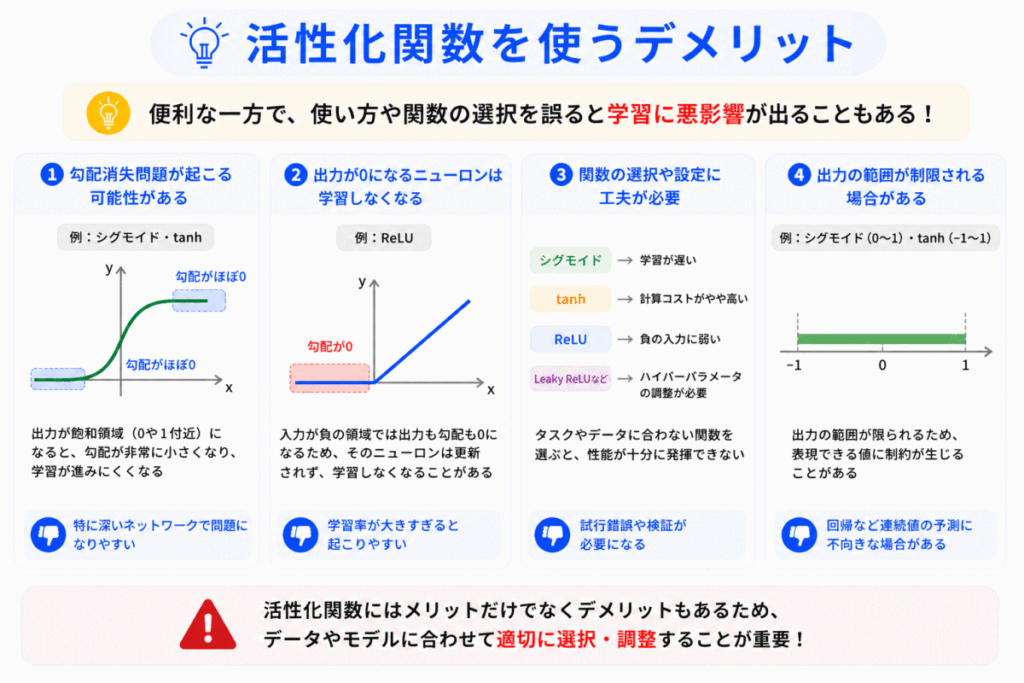

活性化関数を使用するデメリット

活性化関数を使用するデメリットとして下記があげられます。

- 勾配消失問題が発生することがある

(シグモイドで発生) - 学習が遅くなる

勾配消失問題とはAIが学習するときに使う「修正のヒント」が小さくなりすぎて、うまく学習できなくなる問題です。

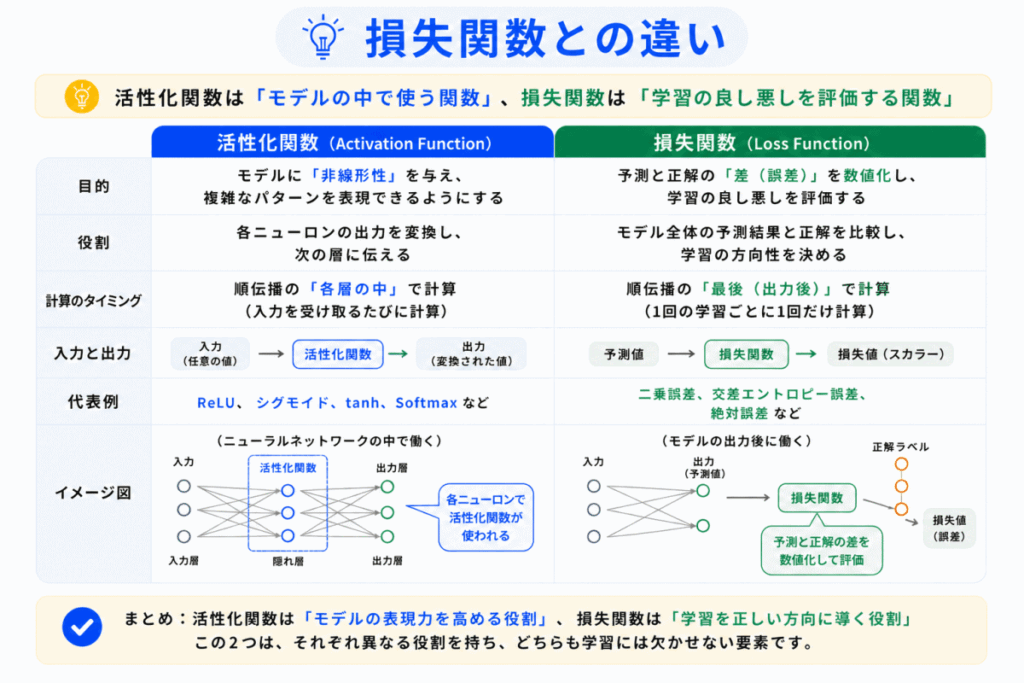

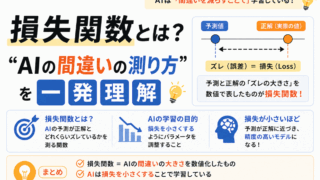

損失関数との違い

役割がまったく違います。

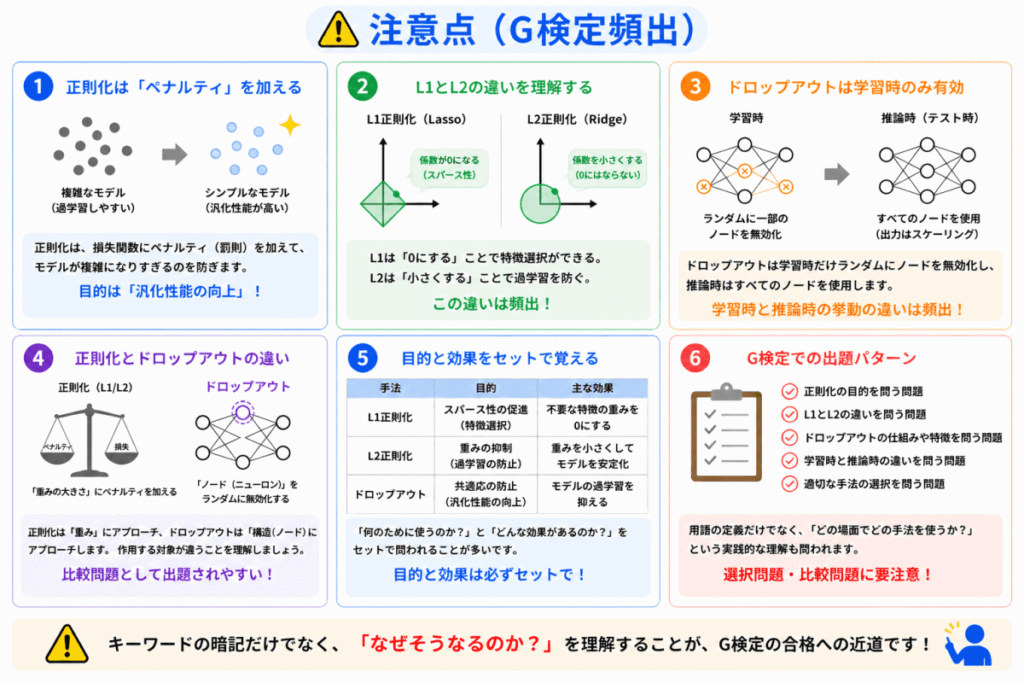

注意点

G検定で頻出される活性化関数の特徴に下記があげられます。

- ReLUが現在の主流

- シグモイド → 勾配消失

- tanh → 改良版

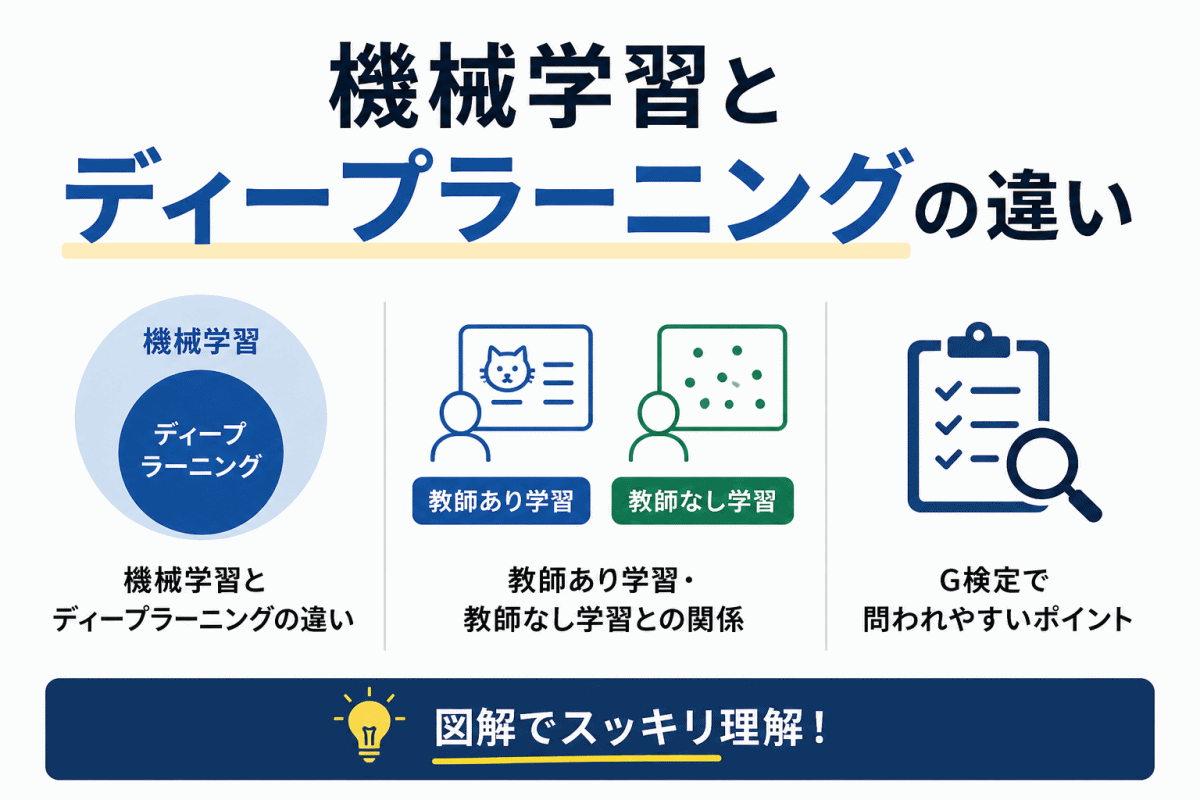

G検定ではどう問われる?

下記の点が頻出です。

- 活性化関数はなぜ使われるのか

- ReLUの特徴

- シグモイドの問題点

- 非線形性を導入するものは?

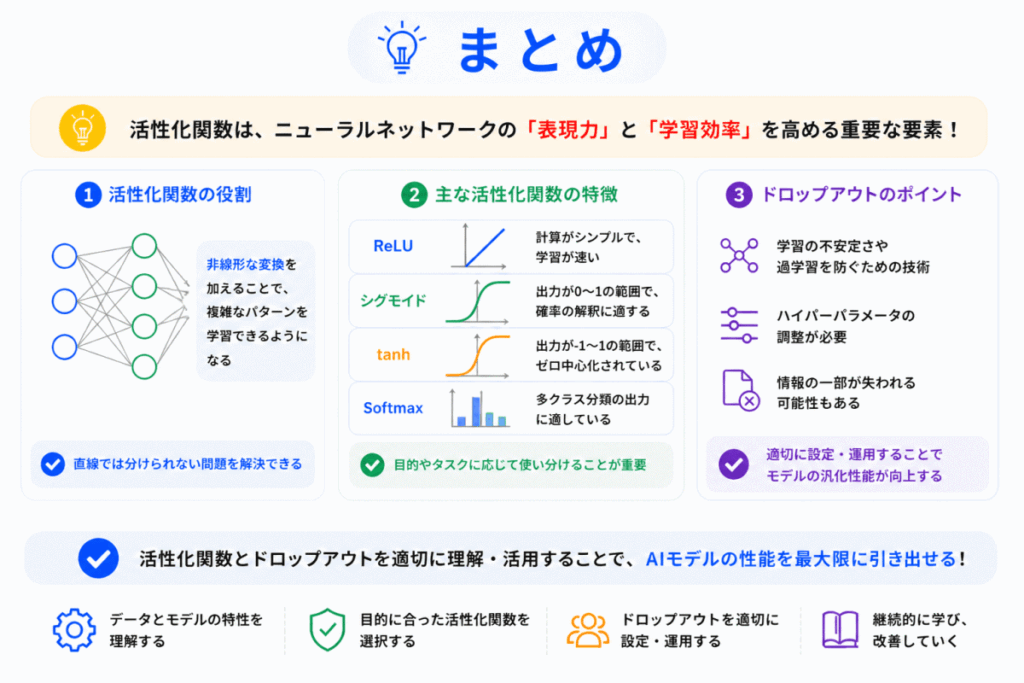

まとめ

- 活性化関数=出力を変換する仕組み

- これがないとAIは賢くならない

- ポイントは「非線形」

活性化関数は「出力するかを決めるスイッチ」であり、ディープラーニングに不可欠な要素です。

これにより単純な計算だけでは表現できない複雑なパターンを学習できるようになります。現在はReLUが主流ですが、シグモイドやtanhとの違いも重要なポイントです。

特にG検定では「ReLUの特徴」、「シグモイドの欠点(勾配消失)」が頻出なので確実に押さえておきましょう。

関連記事・おすすめ記事

活性化関数は、AIに「単純な計算以上の表現力(非線形)」を持たせるための仕組みです。

これがないと、どれだけ層を重ねても複雑な問題は解けません。

では、AIはどのように学習していくのでしょうか?

また、AIの間違いをどのように判断するのかはこちら。

実際に活性化関数が使われているモデルはこちら。

どの分野から出題されるか予想しました。

G検定 合格体験談です。2回目の受験で何とか合格できました。