【G検定対策】正則化とは?わかりやすく整理

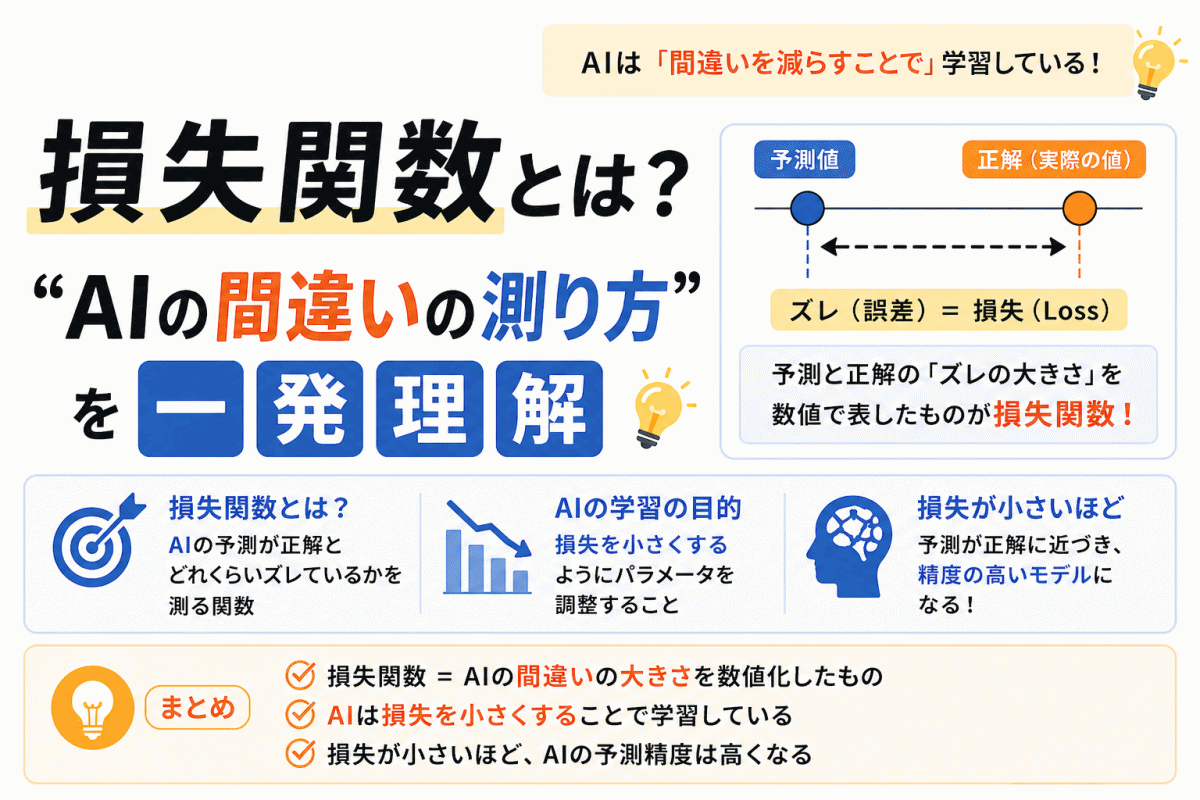

機械学習でよく出てくる「正則化(regularization)」ですが「結局、何をしているの?」と感じていませんか?

正則化はモデルがデータを覚えすぎてしまう「過学習を防ぐための重要な仕組み」です。

この記事ではL1・L2正則化の違いや役割を図解でわかりやすく整理します。

モデルとは『AIがデータをもとに判断するための「仕組み」や「計算のルール」のこと』です。

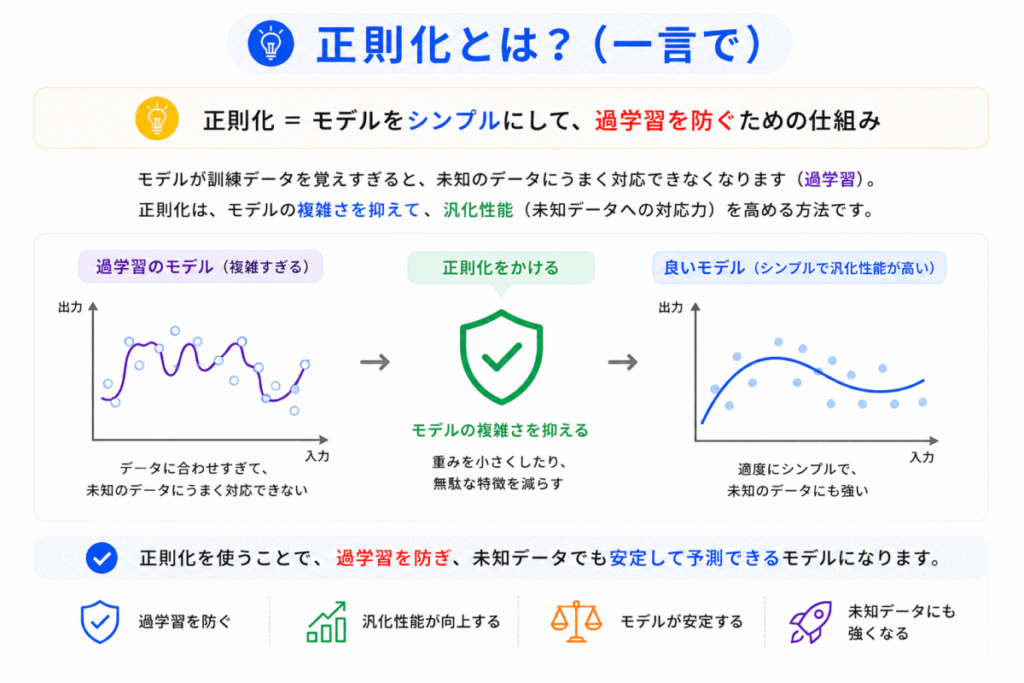

正則化とは?

正則化とは…

モデルを「シンプルにすることで過学習を防ぐ方法」

モデルを「シンプルにすることで過学習を防ぐ方法」

です。

モデルとは『AIがデータをもとに判断するための「仕組み」や「計算のルール」のこと』です。

モデルが複雑すぎると訓練データを覚えすぎてしまいます。

その結果

未知のデータで精度が落ちる(過学習)

未知のデータで精度が落ちる(過学習)

事象が発生します。

正則化は

「無駄に複雑なモデル」を抑える仕組み

「無駄に複雑なモデル」を抑える仕組み

で、過学習を防ぐ効果があります。

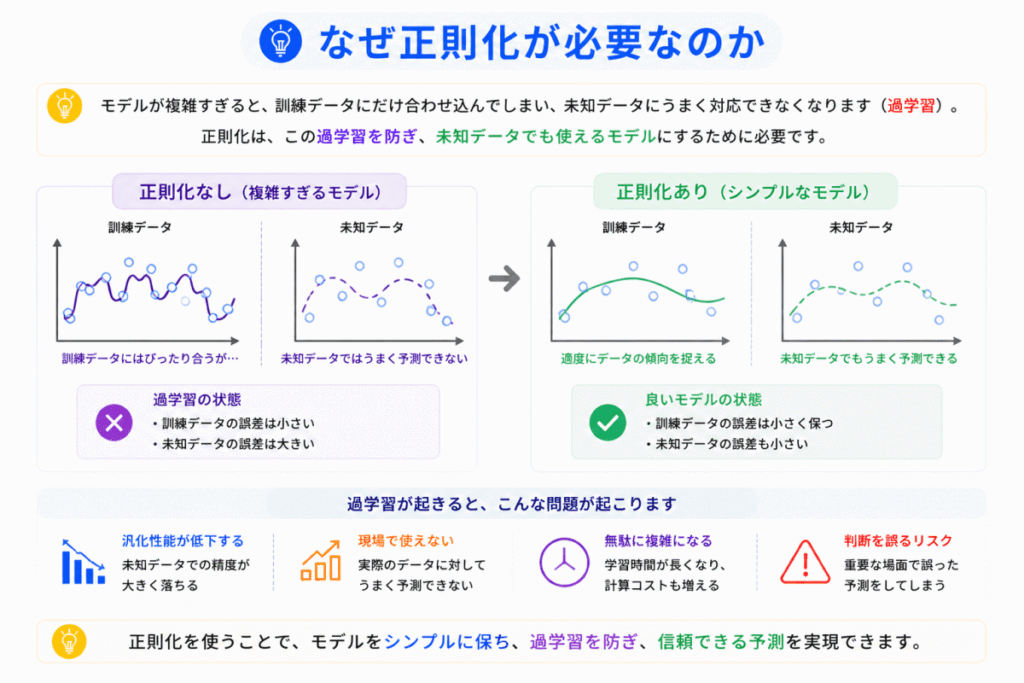

なぜ正則化が必要なのか

AIが学習をしていると下記の問題が起こることがあります。

- モデルが複雑すぎると過学習する

- 訓練データにだけ強くなる

- 未知データで使えない

過学習の状態は

訓練データ → 正解率が高い

テストデータ → 正解率が低い

訓練データ → 正解率が高い

テストデータ → 正解率が低い

過去問をひたすら覚えた → 新しい問題だと解けない… という状態です。

つまり

覚えすぎて応用できない状態

覚えすぎて応用できない状態

正則化はこれを防ぐために使います。

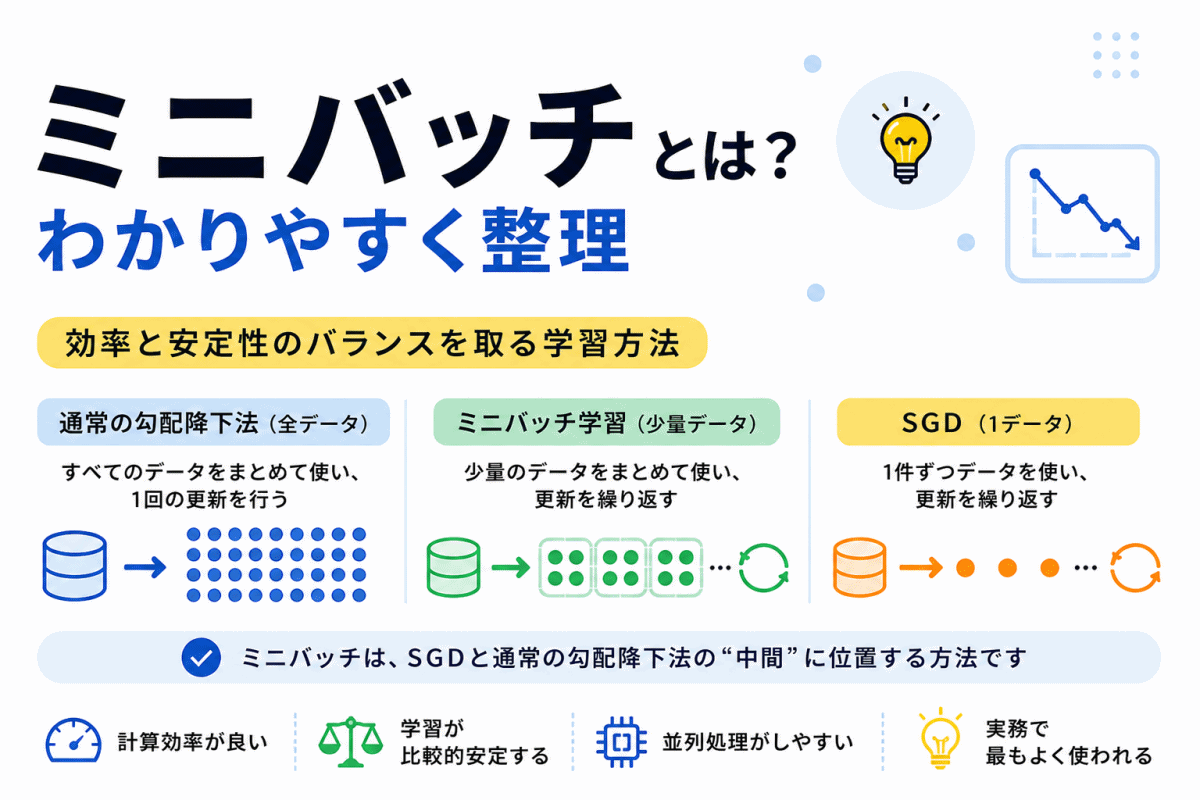

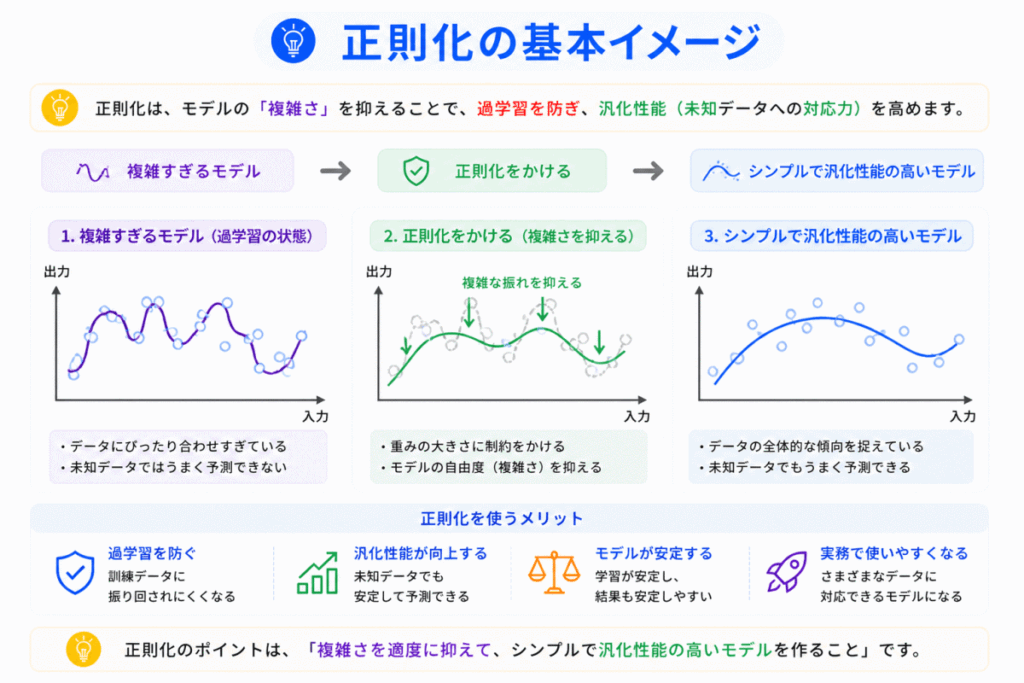

正則化の基本イメージ

「汎化性能」とは、学習に使っていない未知のデータに対して、どれだけ正確に予測・分類できるかを示す能力のことです。

正則化は下記の効果があります。

大きすぎる重みを抑える

モデルをシンプルにする

大きすぎる重みを抑える

モデルをシンプルにする

つまり、過剰な学習を防ぐことができます。

イメージとして下記です。

複雑なモデル → 曲がりくねった線

シンプルなモデル → なめらかな線

複雑なモデル → 曲がりくねった線

シンプルなモデル → なめらかな線

正則化すると

なめらかで汎用性能の高いモデルになる

なめらかで汎用性能の高いモデルになる

ということです。

正則化の種類と比較

G検定で出題される正則化をいくつか記載します。

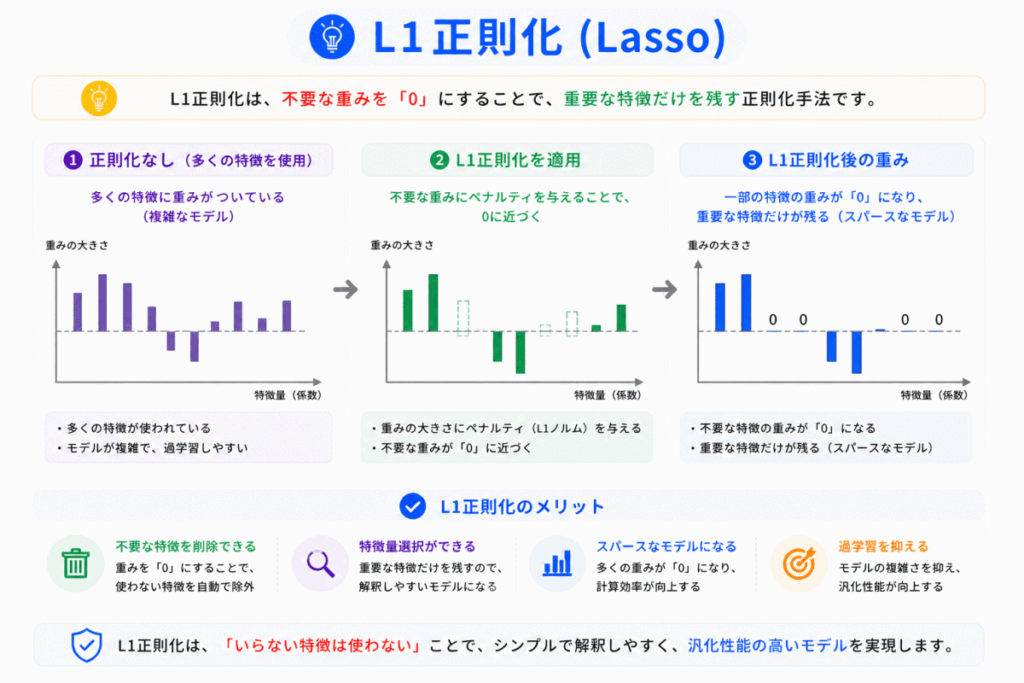

L1正則化(ラッソ回帰)

L1正則化とは

不要な重みを「0」にする正則化

不要な重みを「0」にする正則化

です。

特徴として

不要な特徴量を削除

不要な特徴量を削除

することができます。

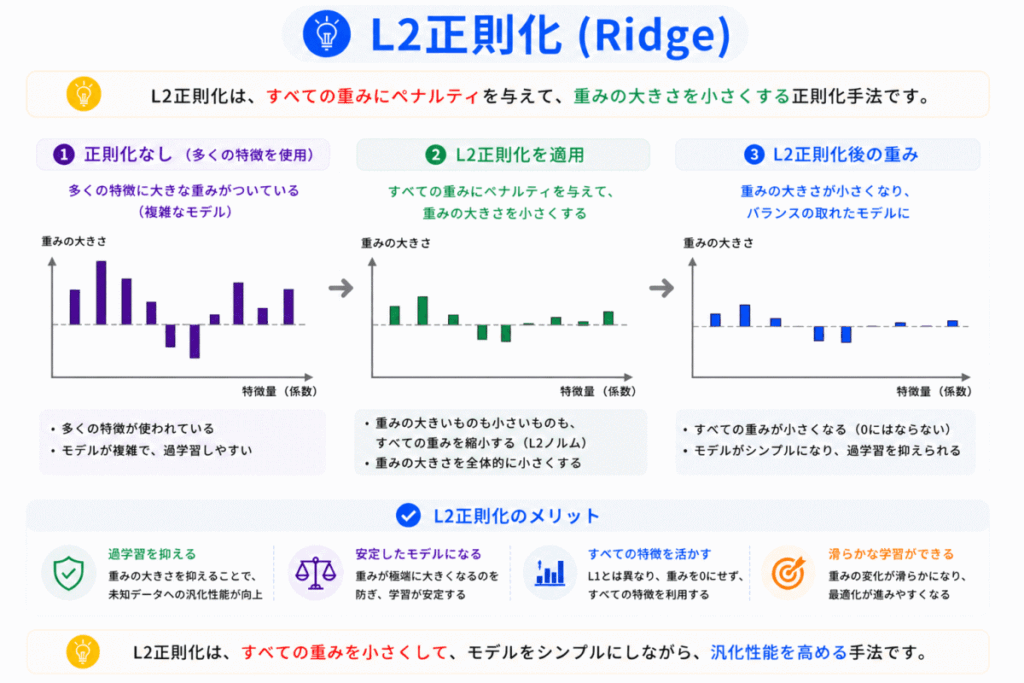

L2正則化(リッジ回帰)

L2正則化とは

重みを「小さく」する正則化

重みを「小さく」する正則化

です。

特徴として

すべての重みを均等に抑える

安定したモデルになる

すべての重みを均等に抑える

安定したモデルになる

をあげることができます。

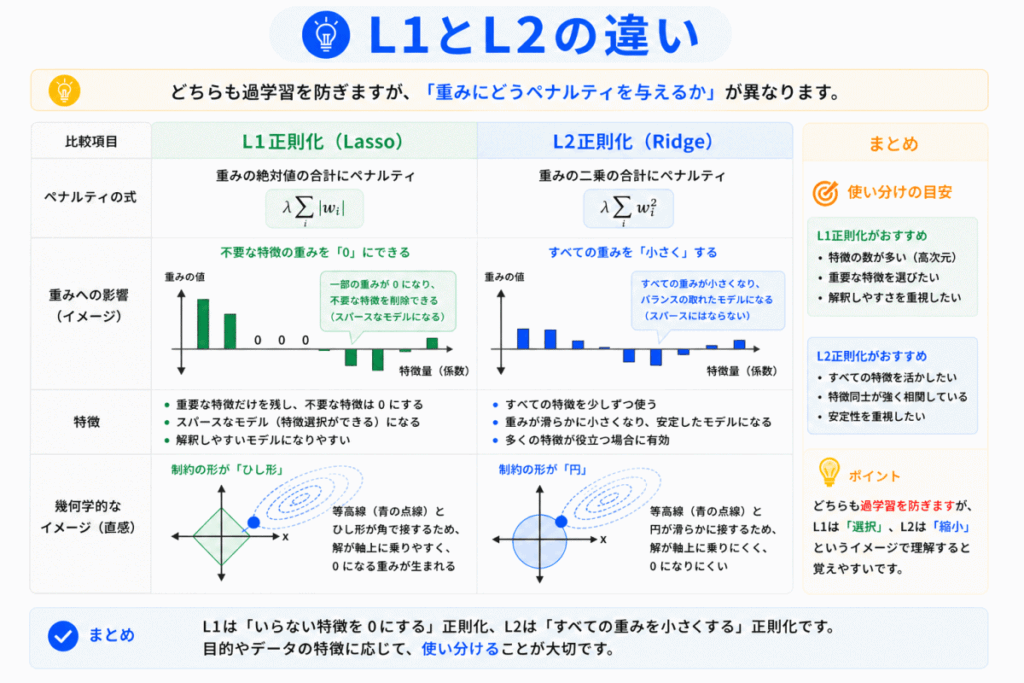

L1とL2の違い

L1とL2の違いとして下記のものがあげられます。

L1 → 不要なものを消す

L2 → 全体を抑える

L1 → 不要なものを消す

L2 → 全体を抑える

使い分け方として下記を覚えておくといいです。

特徴量を減らしたい → L1

安定した学習をしたい → L2

特徴量を減らしたい → L1

安定した学習をしたい → L2

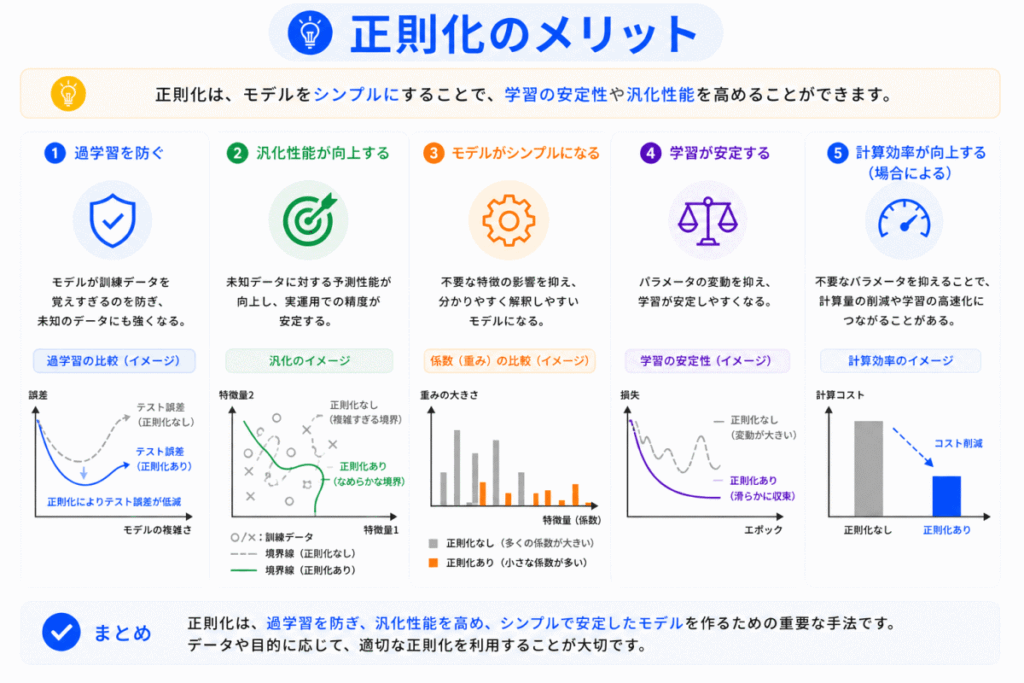

正則化のメリット

正則化のメリットとして下記があげられます。

○ 過学習を防げる

○ 汎化性能が向上する

○ モデルがシンプルになる

○ 過学習を防げる

○ 汎化性能が向上する

○ モデルがシンプルになる

「汎化性能」とは、学習に使っていない未知のデータに対して、どれだけ正確に予測・分類できるかを示す能力のことです。

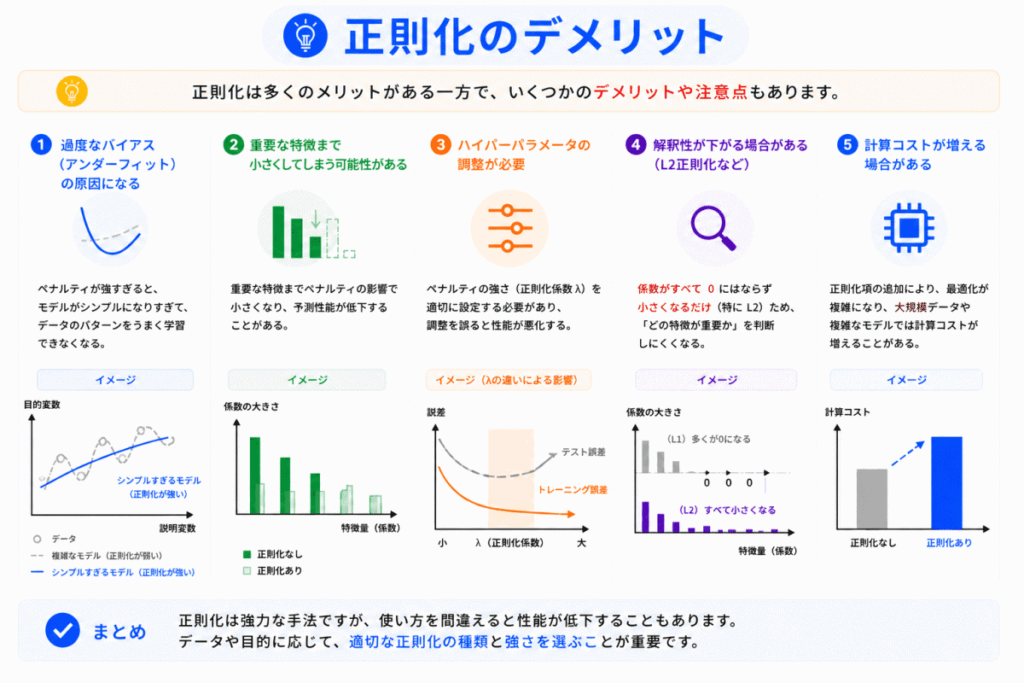

正則化のデメリット

正則化のデメリットとして下記のものがあげられます。

やりすぎると精度が落ちる

ハイパーパラメータの調整が必要

やりすぎると精度が落ちる

ハイパーパラメータの調整が必要

強すぎる正則化だと…

学習不足(アンダーフィッティング)になる

→ 学習が足りていない状況

学習不足(アンダーフィッティング)になる

→ 学習が足りていない状況

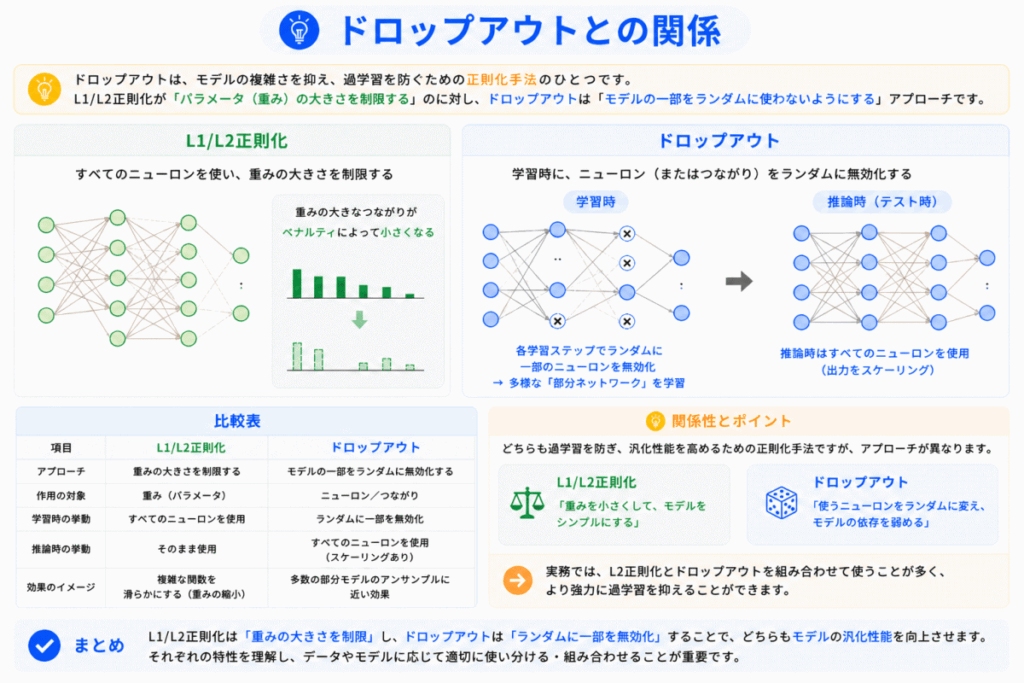

ドロップアウト(Dropout)との関係

ドロップアウト も 正則化の一種 です。

違いとしては下記があげられます。

L1正則化・ L2正則化 → 制限を掛ける

ドロップアウト → 制限を掛ける前に無効化

L1正則化・ L2正則化 → 制限を掛ける

ドロップアウト → 制限を掛ける前に無効化

どちらも過学習対策です。詳細は別の記事で記載します。

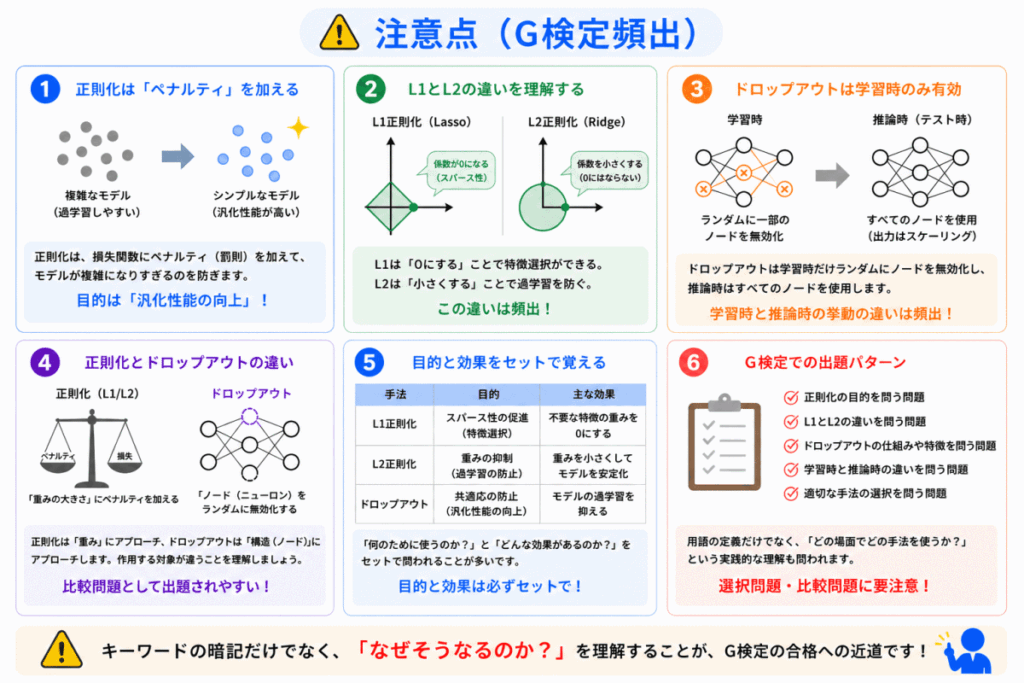

注意点(G検定頻出)

注意点(ポイント)として下記があります。

- 正則化はペナルティを与える

- L1とL2の違いを理解する

- ドロップアウトは学習時のみ有効

- 正則化とドロップアウトの違い

- 目的と効果をセットで覚える

G検定ではどう問われる?

「なぜ必要か」と「違い」をセットで覚えることが重要です。

- 正則化の目的

- 過学習との関係

- ドロップアウトと関係

- L1正則化の特徴

- L2正則化の特徴

- L1正則化とL2正則化の違い

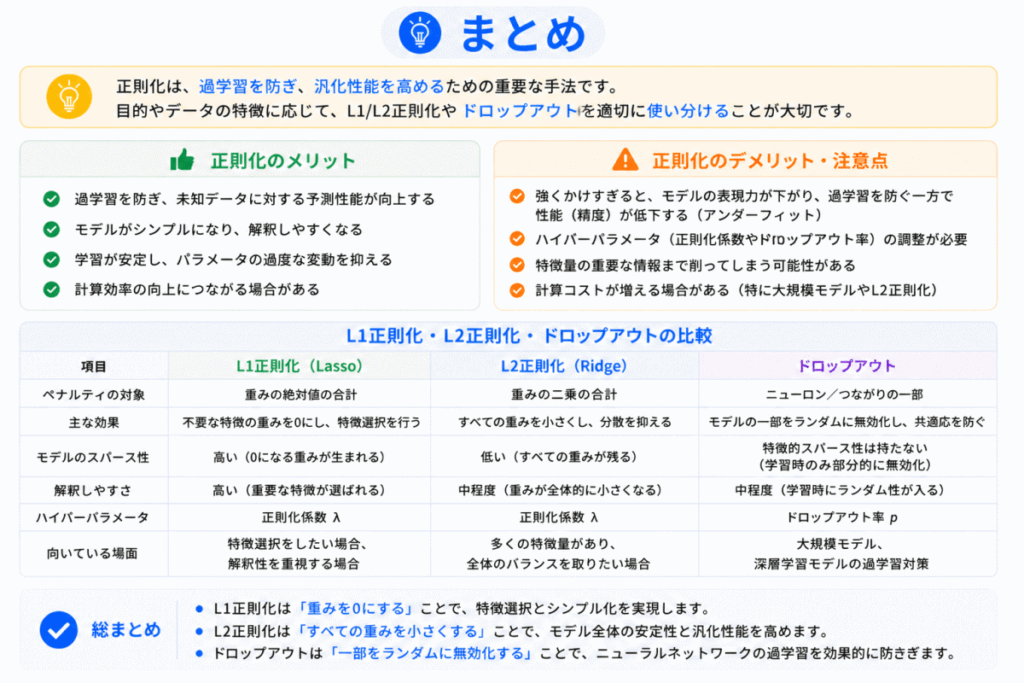

まとめ

正則化とは…

- 正則化は過学習を防ぐための手法

- モデルをシンプルにする

- L1とL2が基本

正則化とは、「学習しすぎ」を防ぐための仕組みです。

モデルをシンプルに保ち、特定の特徴や構造への過度な依存を抑えることで、未知データにも強いモデルを作ります。

L1・L2やドロップアウトを適切に使い分けることで、精度と汎化性能のバランスを取ることが重要です。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

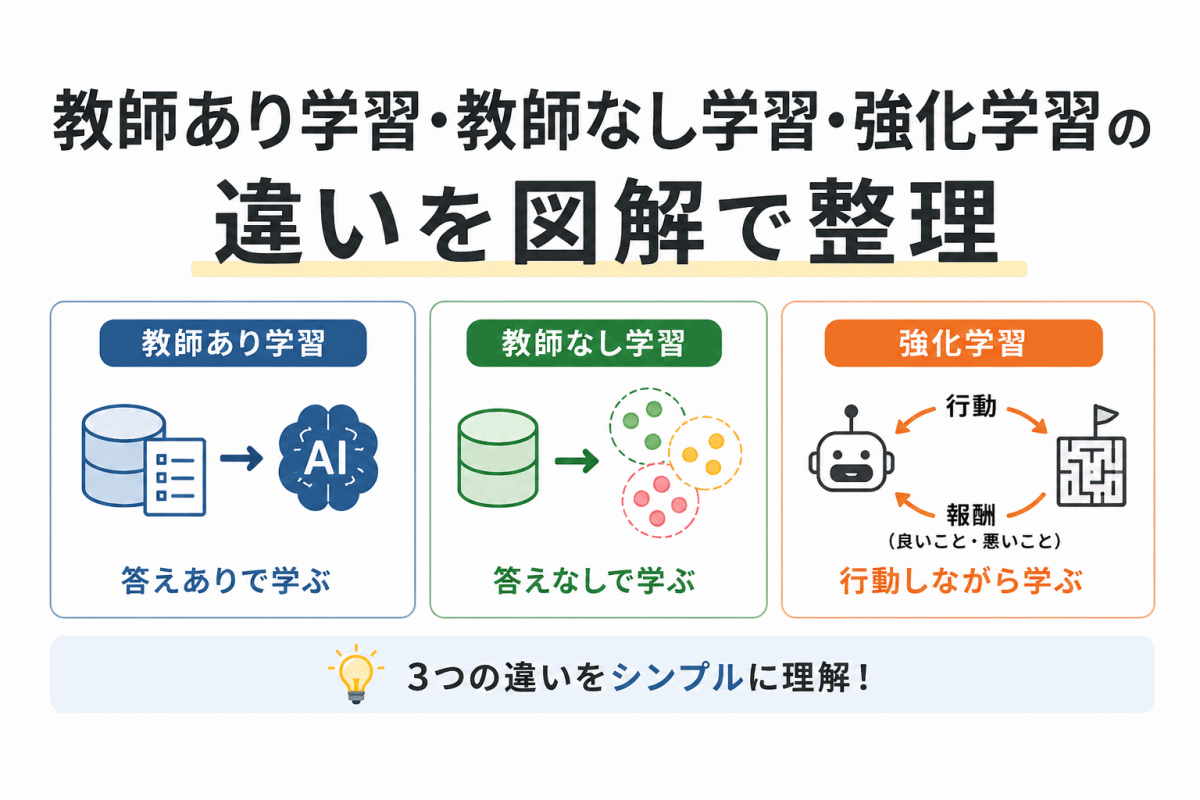

関連記事・おすすめ記事

正則化はモデルをシンプルにして過学習を防ぐ方法です。

そもそも過学習とは何か?という方はこちらも確認しておきましょう。

では、実際にどのように過学習を防ぐのか?代表的な手法はこちら。

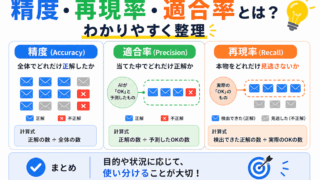

モデルの良し悪しは「評価指標」で判断します。

試験でも頻出なのでこちらも押さえておきましょう。

どの分野から出題されるか予想しました。

G検定 合格体験談です。2回目の受験で何とか合格できました。