【G検定対策】AIはどうやって賢くなるのか?

AIは最初から賢いわけではありません。

最初は

- 間違える

- 予測を外す

- 精度が低い

状態から始まります。

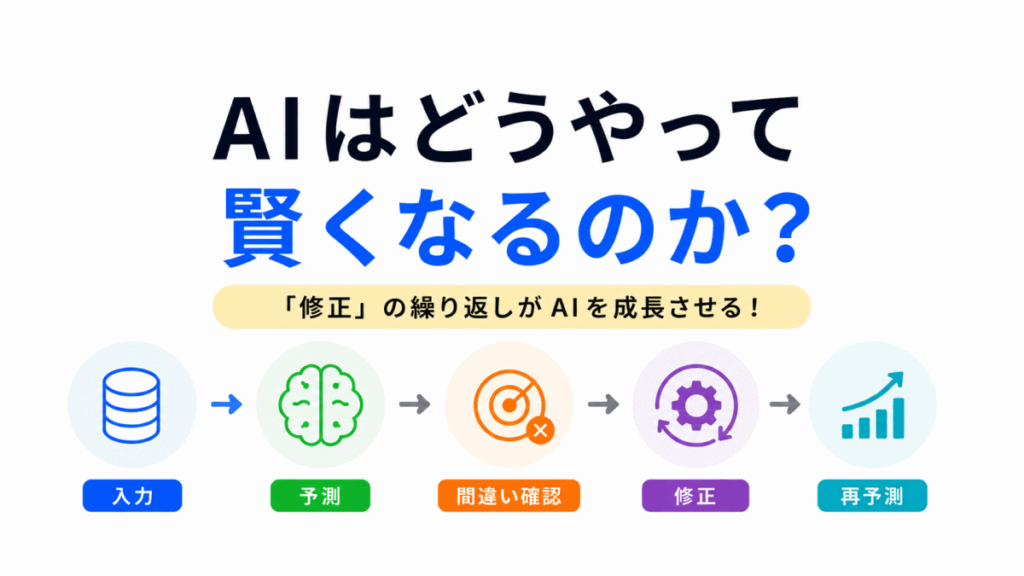

では なぜAIは少しずつ賢くなれるのでしょうか。

その理由が「修正」です。

AI内部では

を何度も繰り返しています。

つまり、AIは「修正」を繰り返して賢くなっているのです。

この記事では

- AIはなぜ賢くなるのか?

- AI内部で何を修正しているのか?

- なぜ損失関数や勾配降下法が必要なのか?

- なぜ学習率が重要なのか?

- SGD・ミニバッチ・Adamは何をしているのか?

を「AI内部の流れ」として整理し、試験に備えましょう。

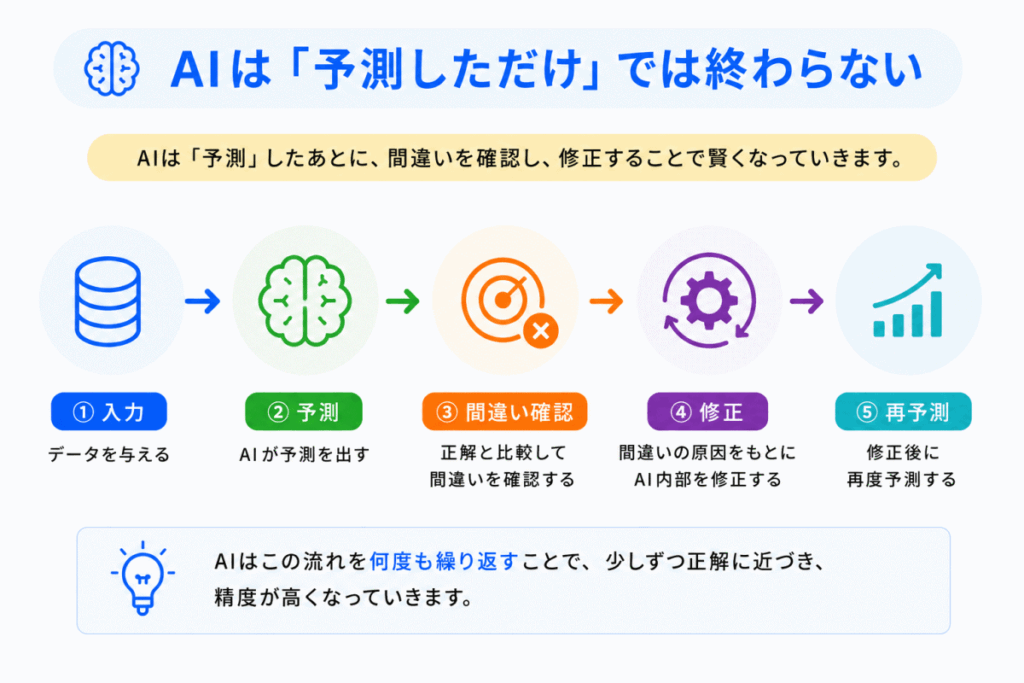

AIは「予測しただけ」では終わらない

AIは入力されたデータから「予測」を行います。

例えば:

- 猫画像 → 猫

- メール → スパム

- 売上データ → 来月予測

などです。

しかし、ここで重要なのは「予測したあと」です。

AIは「どれだけ間違えたか?」を確認します。

つまり、AIは

ことで少しずつ賢くなっています。

ここで重要なのが「AIは何を基準に修正しているのか?」です。

ここからは「AI内部で起きている修正の流れ」を見ていきましょう。

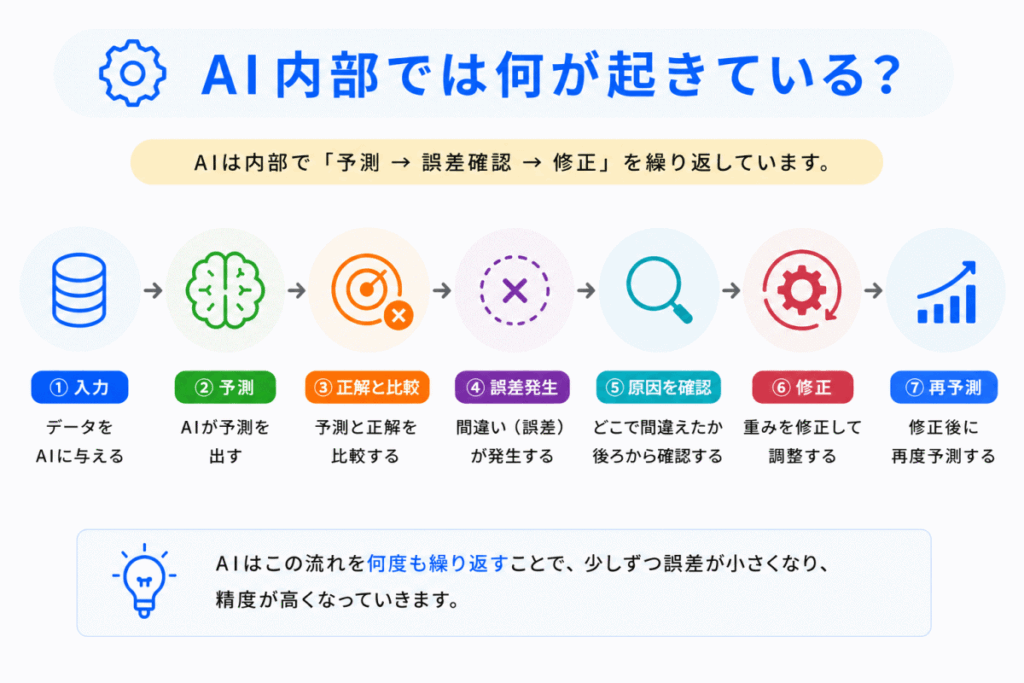

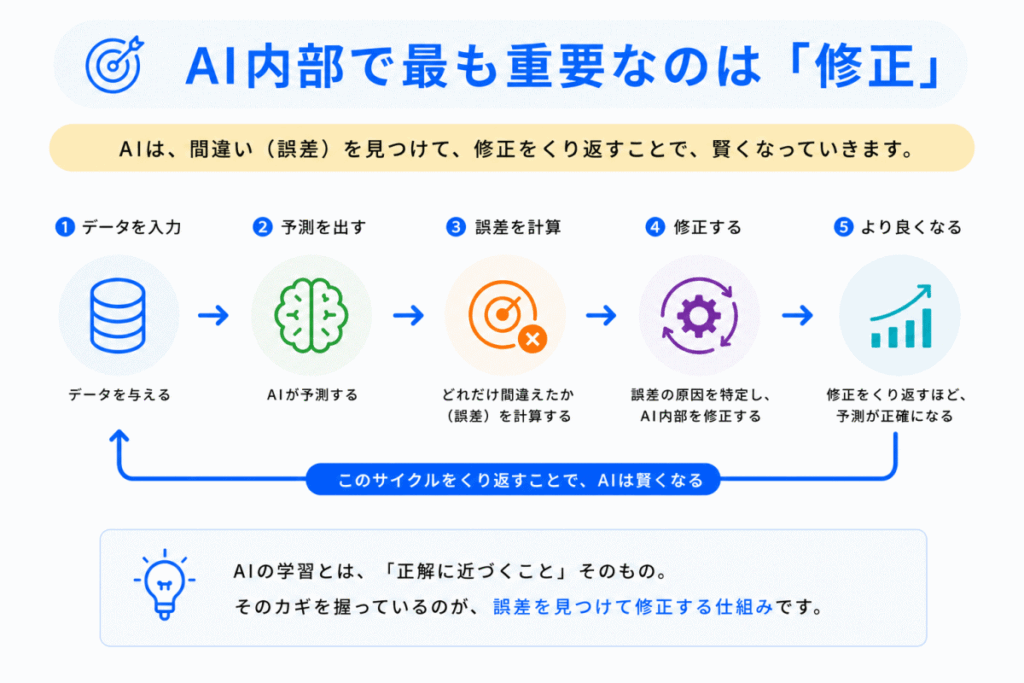

AI内部では何が起きている?

AI内部では次の流れが起きています。

ここで重要なのが「間違えたから修正する」という流れです。

AIは、最初から正解しているわけではありません。

「失敗 → 修正」を大量に繰り返しています。

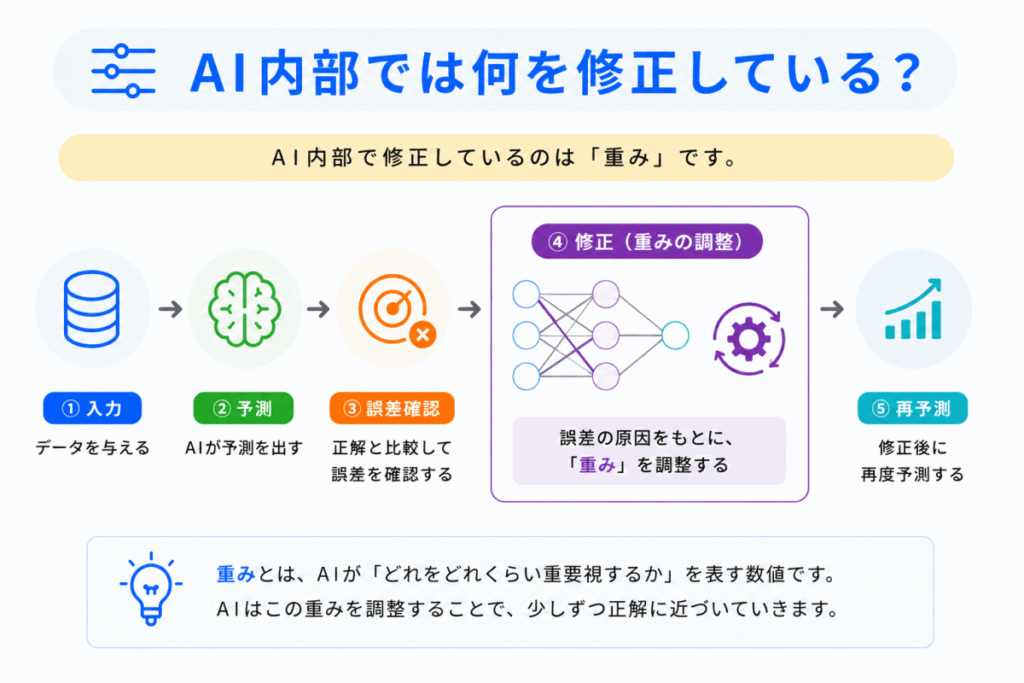

AI内部では何を修正している?

では、AIは内部で何を修正しているのでしょうか?

修正しているのは「重み」です。

重みとは「どれをどれくらい重要視するか?」を表す数値です。

例えば画像認識なら

- 耳

- 目

- ヒゲ

- 輪郭

などの特徴を どれくらい重視するか を調整しています。

つまり、AIは「重要度の調整」を繰り返しているのです。

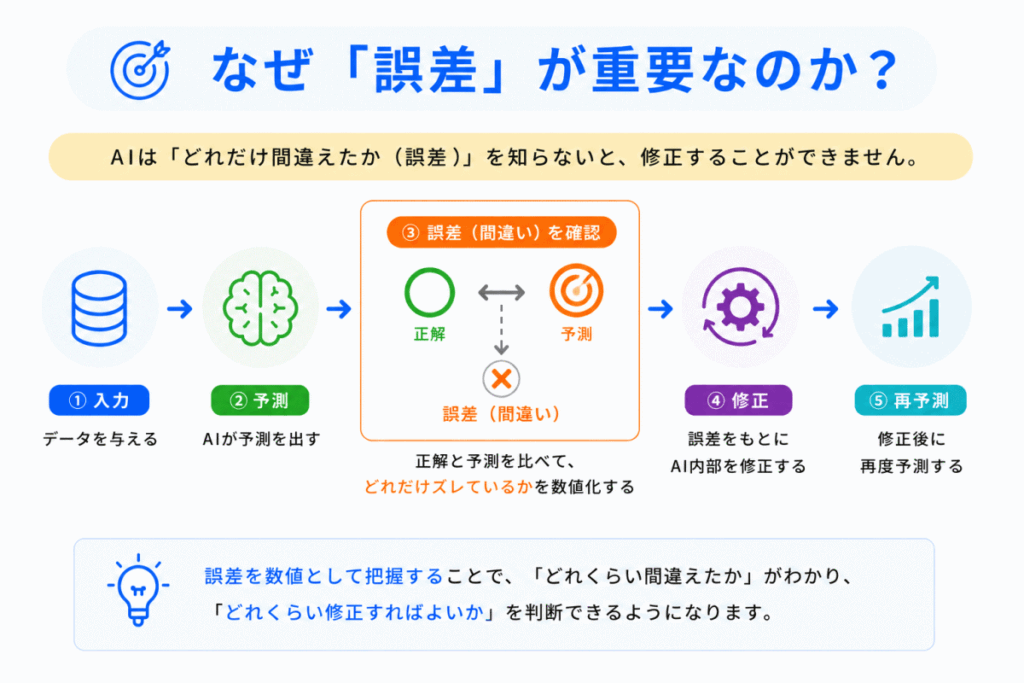

なぜ「誤差」が重要なのか?

AIは「どれだけ間違えたか?」を確認しないと修正できません。

そこで使われるのが 損失関数 です。

損失関数は「間違いの大きさ」を数値化します。

つまり、AIは

「どれくらいズレた?」→ 「どれくらい修正する?」

を判断しているのです。

ここで「誤差」が非常に重要になります。

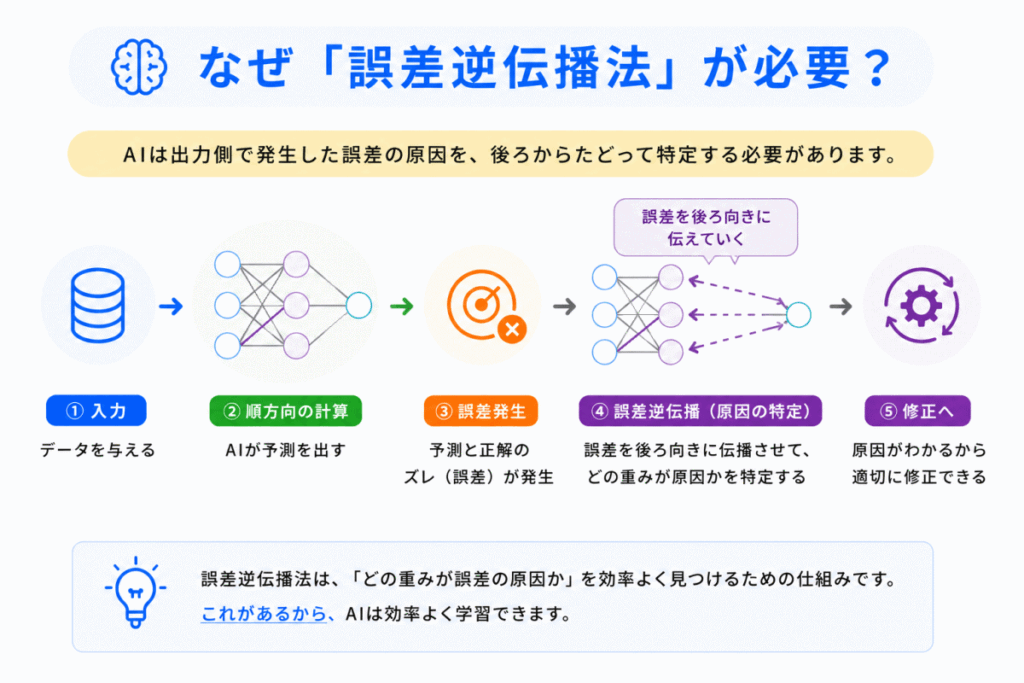

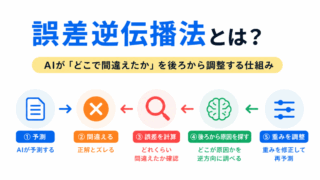

なぜ「誤差逆伝播法」が必要?

では「どこを修正すれば良いのか?」はどう判断しているのでしょうか?

ここで登場するのが 誤差逆伝播法(バックプロパゲーション)です。

AIは出力側で発生した誤差を 後ろから逆向きに確認 していきます。

つまり

を後ろから調べています。

ここが「AI内部理解」で非常に重要です。

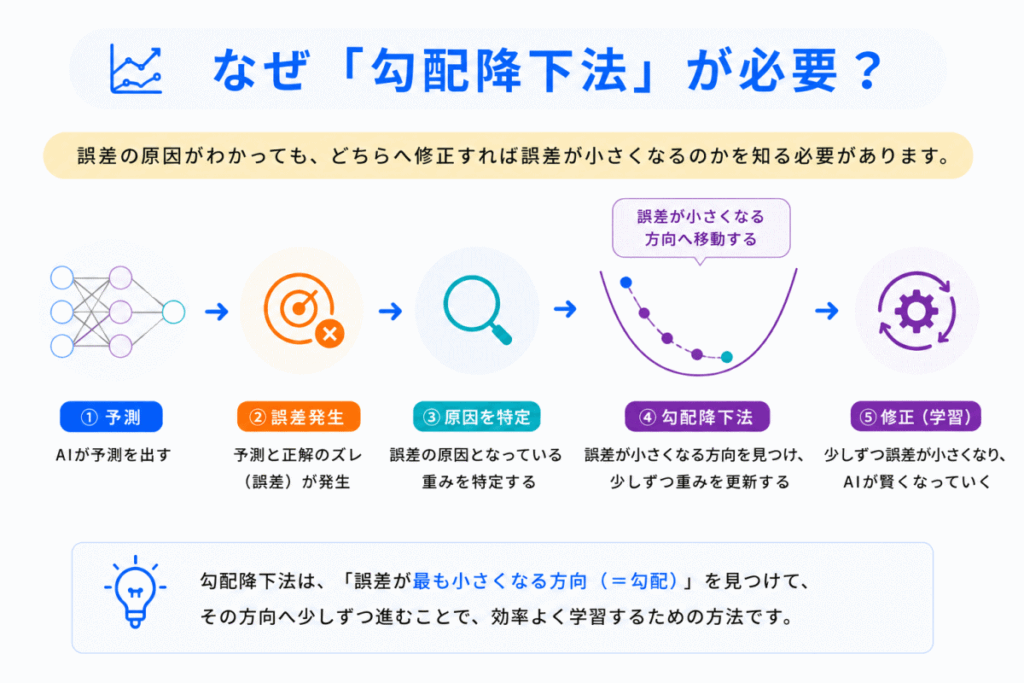

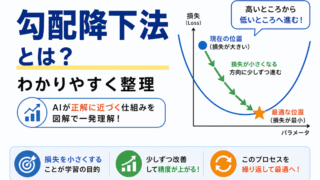

なぜ「勾配降下法」が必要?

誤差の原因がわかっただけでは、まだ修正できません。

次に必要なのが「どちらへ修正するか?」です。

ここで使われるのが 勾配降下法 です。

勾配降下法は「誤差が小さくなる方向」を探します。

つまり、AIは

を繰り返しています。

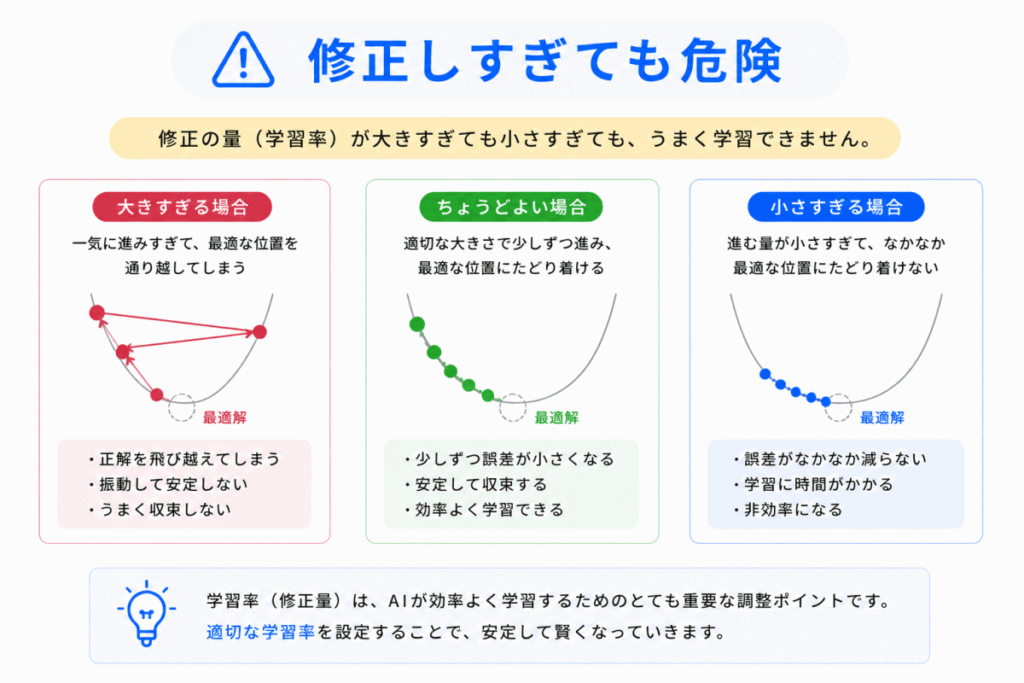

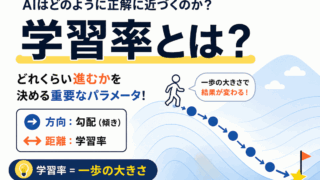

修正しすぎても危険

ここで重要なのが「修正量」です。

修正が大きすぎると

- 学習が不安定

- 正解を飛び越える

- 振動する

などが起きます。

逆に小さすぎると

- 学習が遅い

- なかなか改善しない

となります。

ここで重要になるのが 学習率 です。

つまり、AIは「どれくらい修正するか?」も調整しています。

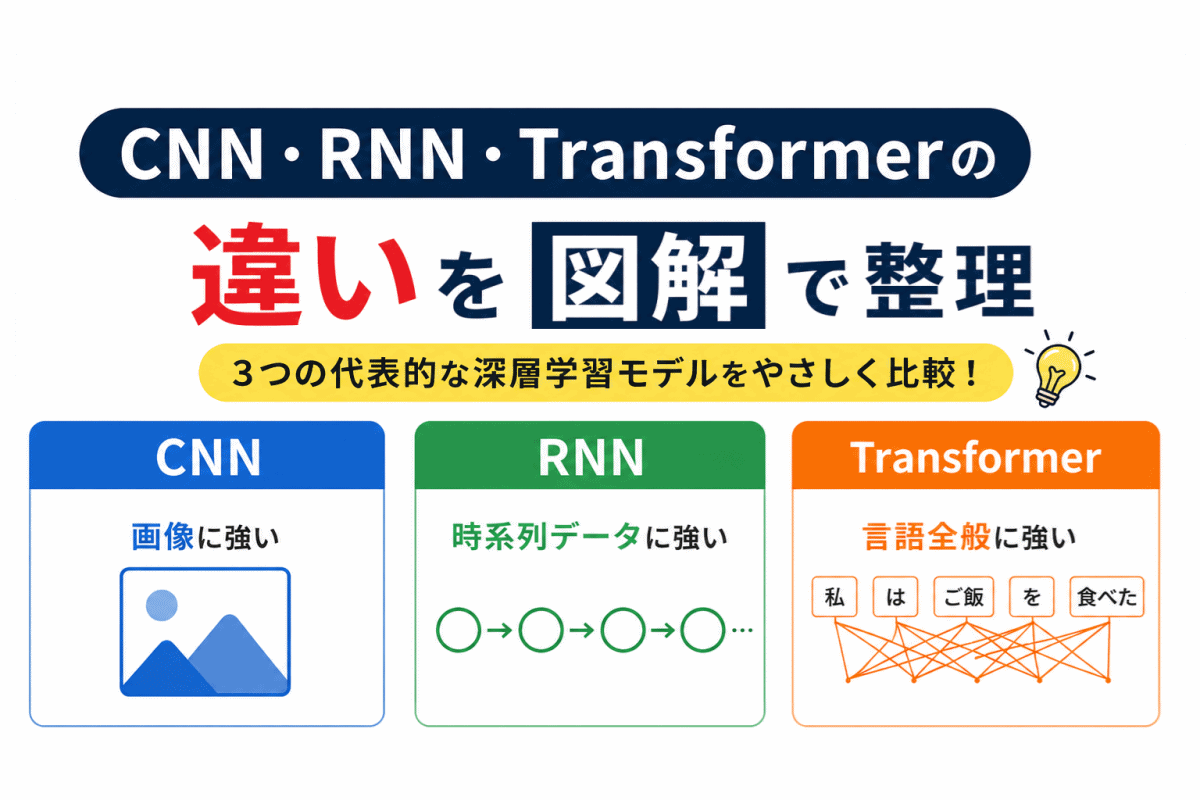

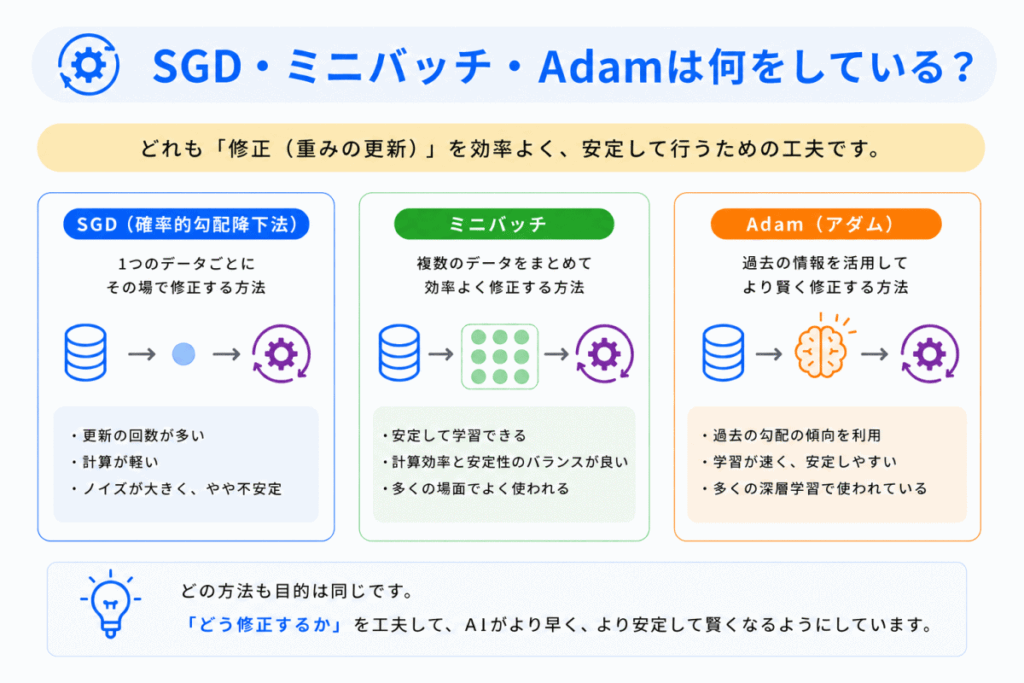

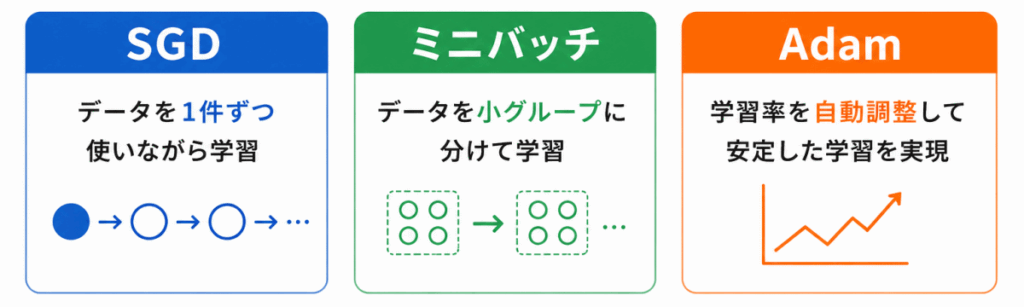

SGD・ミニバッチ・Adamは何をしている?

これらも本質は同じです。

全部「修正を効率化する仕組み」です。

SGD

少しずつ修正する

ミニバッチ

一部データごとに修正する

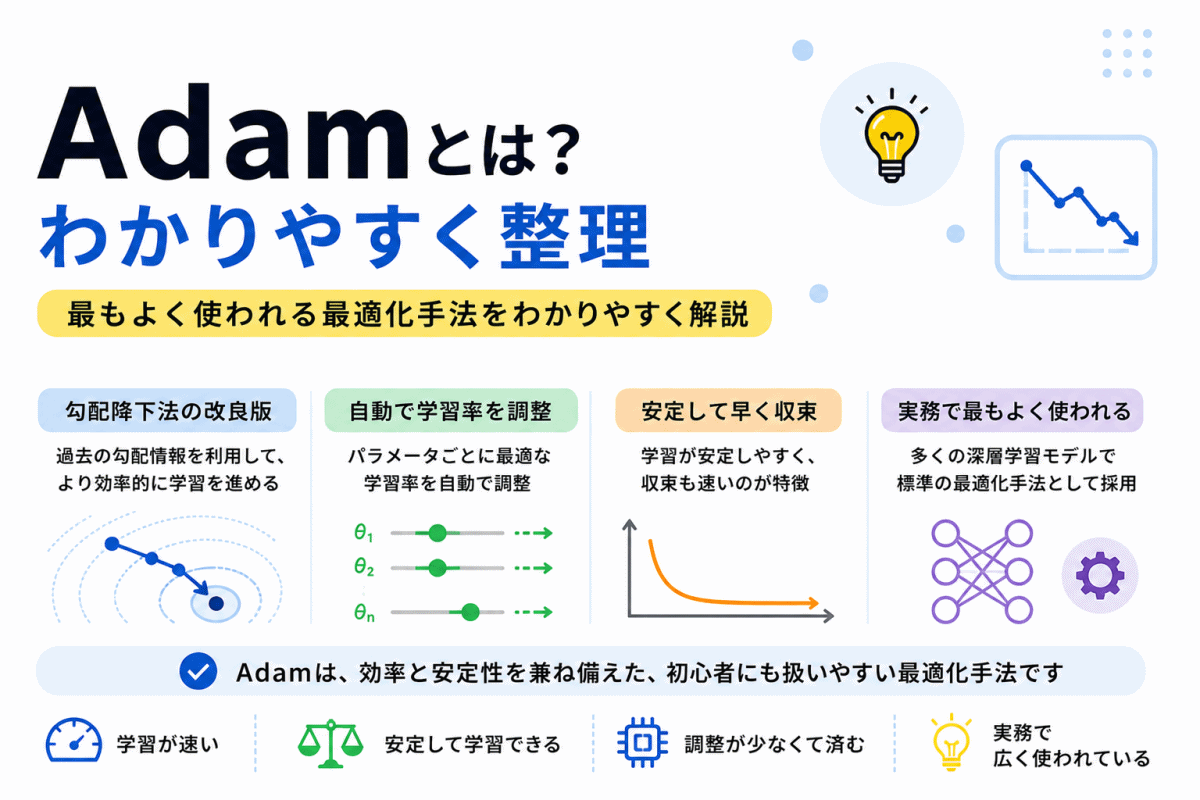

Adam

修正を賢く安定化する

SGD・ミニバッチ・Adam

つまり

AI内部では「どう修正すると効率が良いか?」を工夫しているのです。

AI内部で最も重要なのは「修正」

ここまでの流れを見ると、AI関連用語は全部バラバラではないことが見えてきます。

例えば

- 損失関数 → 間違い確認

- 誤差逆伝播法 → 原因調査

- 勾配降下法 → 修正方向

- 学習率 → 修正量

- Adam → 修正効率化

つまり『全部「修正」のために存在している』のです。

これが理解できると、AI内部の流れがかなりつながります。

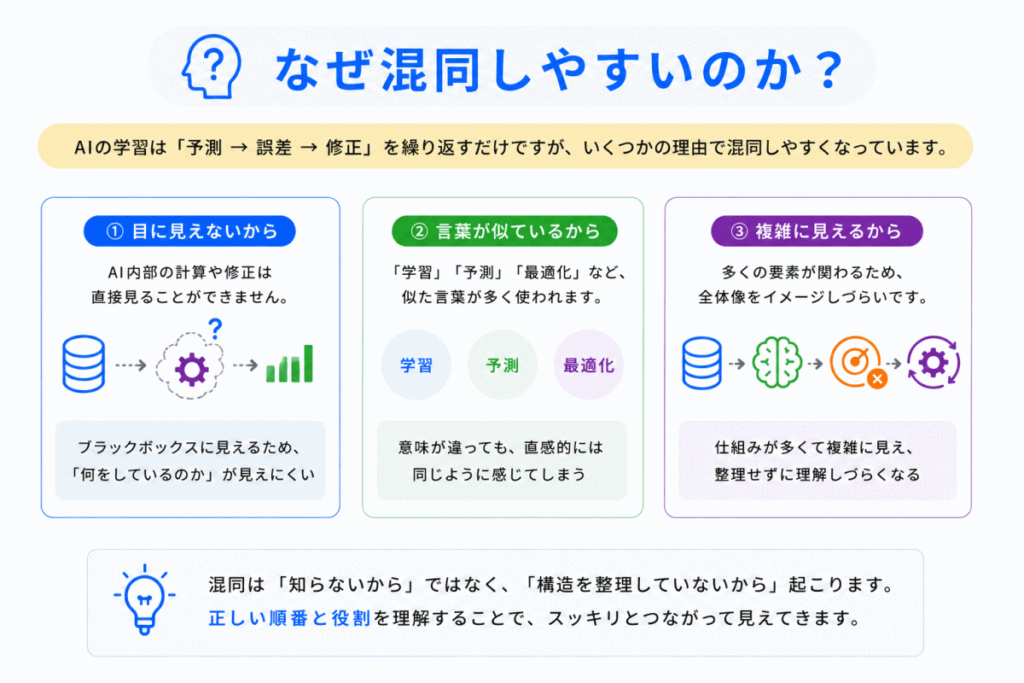

なぜ混同しやすいのか?

AIの学習をはじめたばかりの人が混乱しやすい理由は『全部「学習」に見える』からです。

しかし、実際は役割が違います。

例えば

- 損失関数 → 間違い測定

- 勾配降下法 → 修正方向

- 学習率 → 修正量

です。

つまり「何を担当しているのか?」を整理することが重要です。

G検定ではどう問われる?

G検定では

- 損失関数

- 誤差逆伝播法

- 勾配降下法

- 学習率

- SGD

- Adam

などが「関係性」で問われることがあります。

そのため、単語暗記だけでは「見たことあるのに解けない」が発生しやすいです。

重要なのは「AI内部で何が起きているのか?」を流れで理解することです。

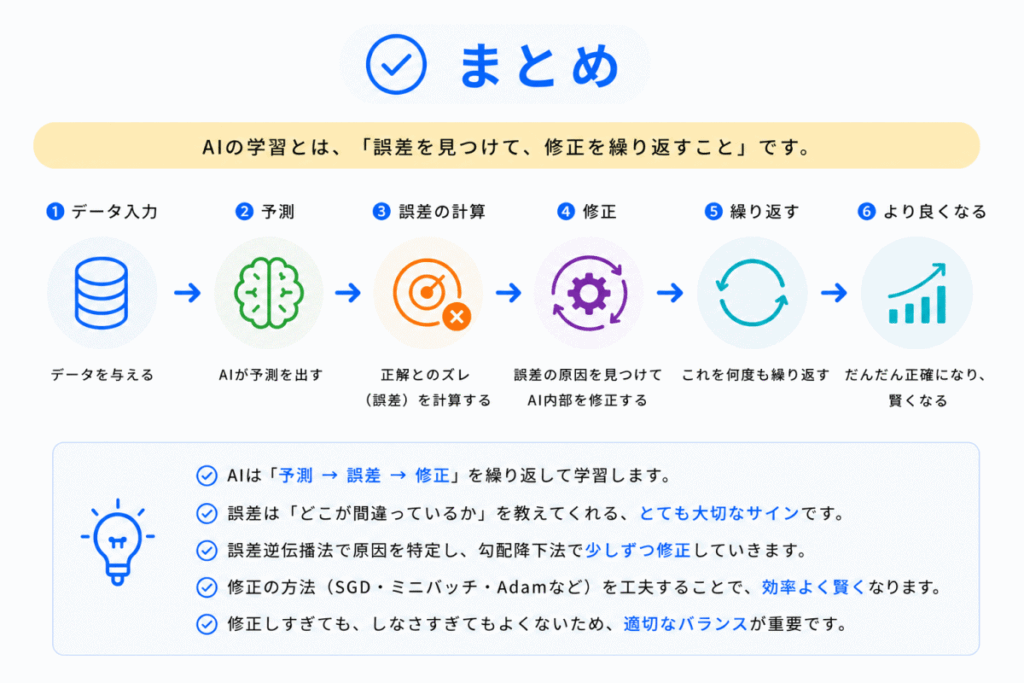

まとめ

AIは最初から賢いわけではありません。

AI内部では

を大量に繰り返しています。

そして

- 損失関数

- 誤差逆伝播法

- 勾配降下法

- 学習率

- SGD

- ミニバッチ

- Adam

はすべて「修正」のために存在しています。

つまり AIは「修正」を繰り返して賢くなっている のです。

ここを理解すると、AI内部の流れが一気につながり「なぜそうなるのか?」がかなり見えやすくなります。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

「誤差逆伝藩法」を整理しました。

「勾配降下法」を整理しました。

「学習率」を整理しました。

不合格体験記です。私のような失敗をしないように確認しましょう。