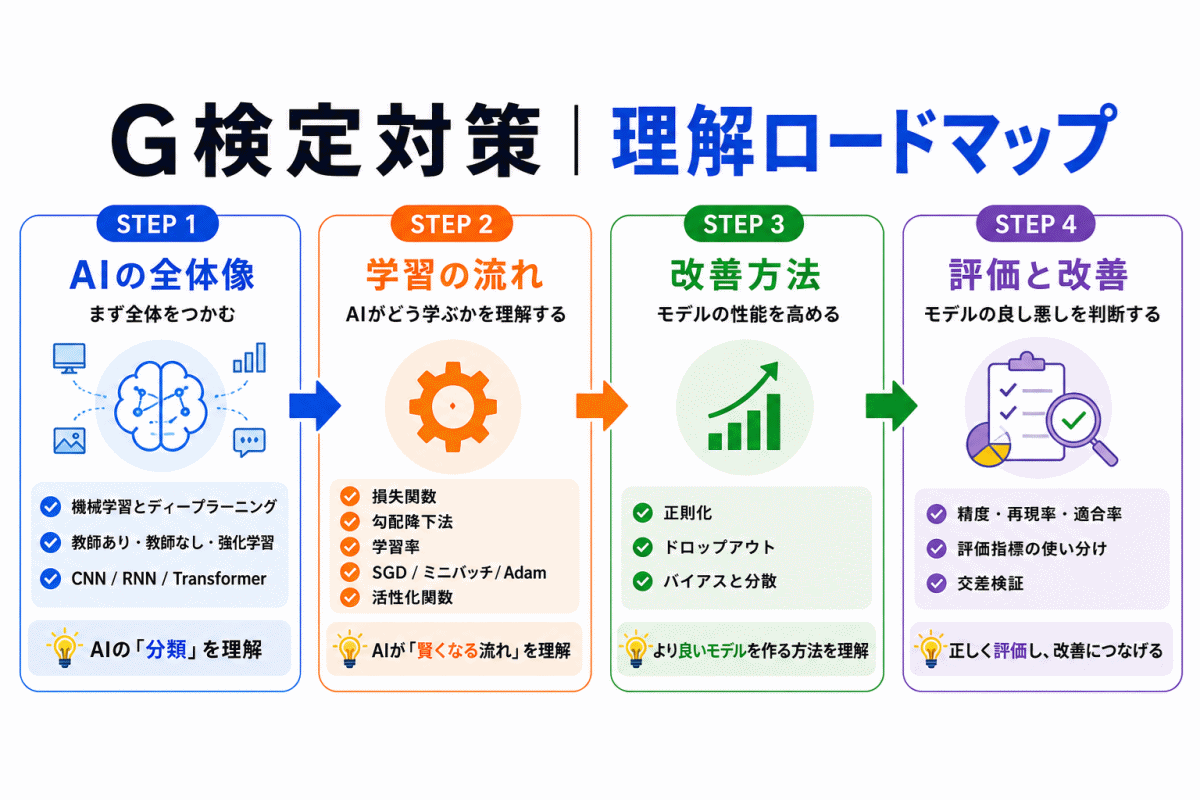

【G検定対策】AIはどうやって学習する?全体の流れをわかりやすく整理

AIやディープラーニングを学び始めると

- 損失関数

- 勾配降下法

- 学習率

- SGD

- Adam

- 過学習

など、専門用語が大量に出てきます。

しかし、AIの学習をはじめたばかりの人が混乱しやすい最大の理由は「全部バラバラに見える」ことです。

本当はこれらは別々の話ではありません。

すべて「AIがどうやって学習しているのか」という1つの流れの中に存在しています。

この記事では「AI学習の全体像」を図解イメージで整理しながら

- AIは何をしているのか

- なぜ損失関数が必要なのか

- なぜ勾配降下法が必要なのか

- Adamは何を改善したのか

を「線」で理解できるように整理していきます。

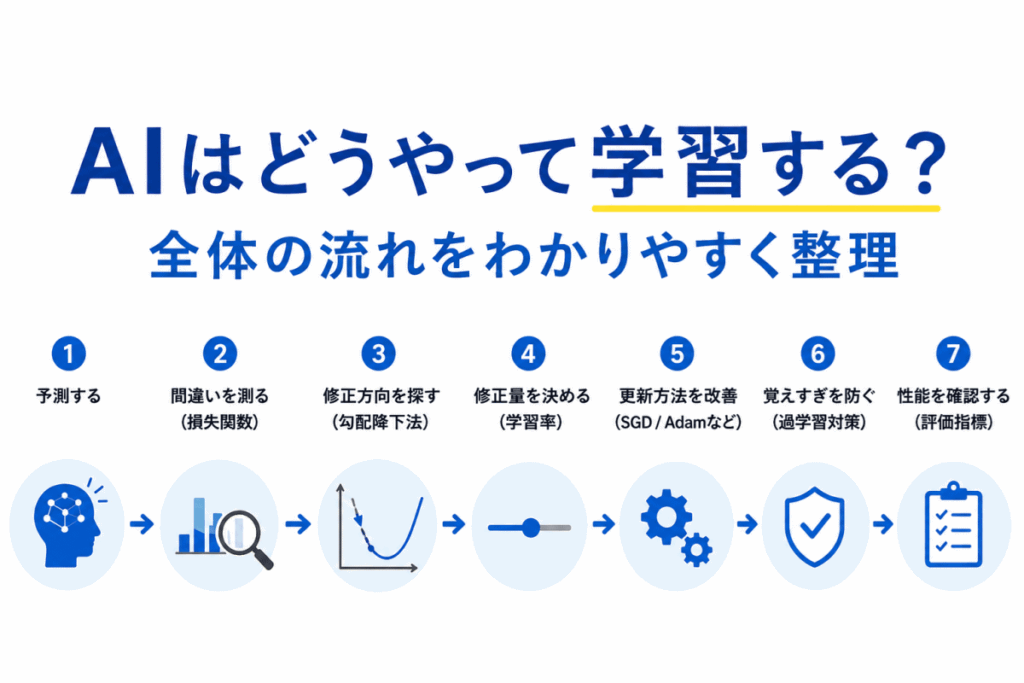

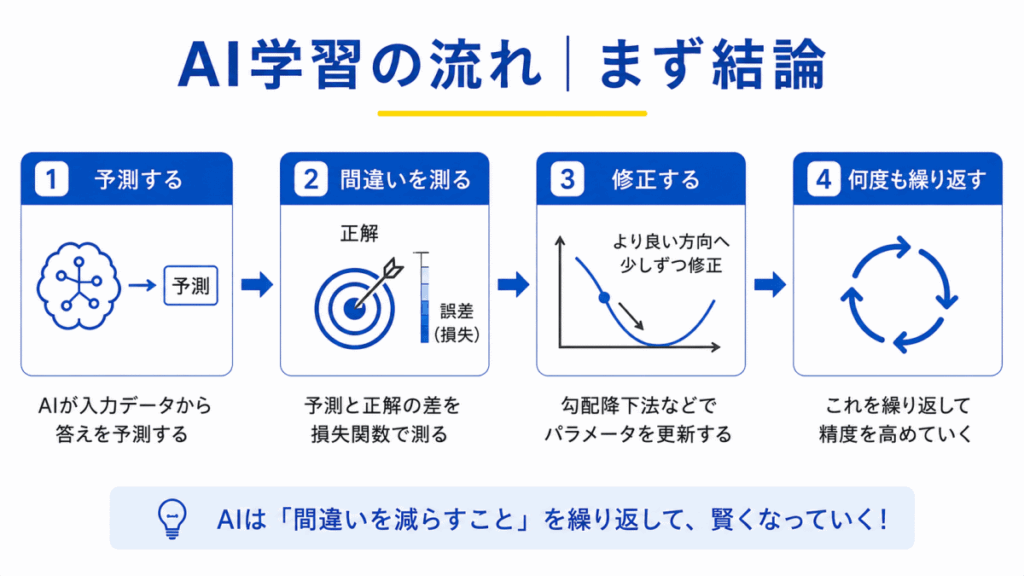

まず結論|AI学習の流れはこれ

AI学習の全体像は、非常にシンプルに表すと下記の順で行われます。

① 予測する

② 間違いを測る

③ 修正する

④ 何度も繰り返す

もう少し詳しくすると、AI学習で行われる(使われる)ものには下記表のものがあります。

つまり「AIは間違いを修正し続けて学ぶ」のです。

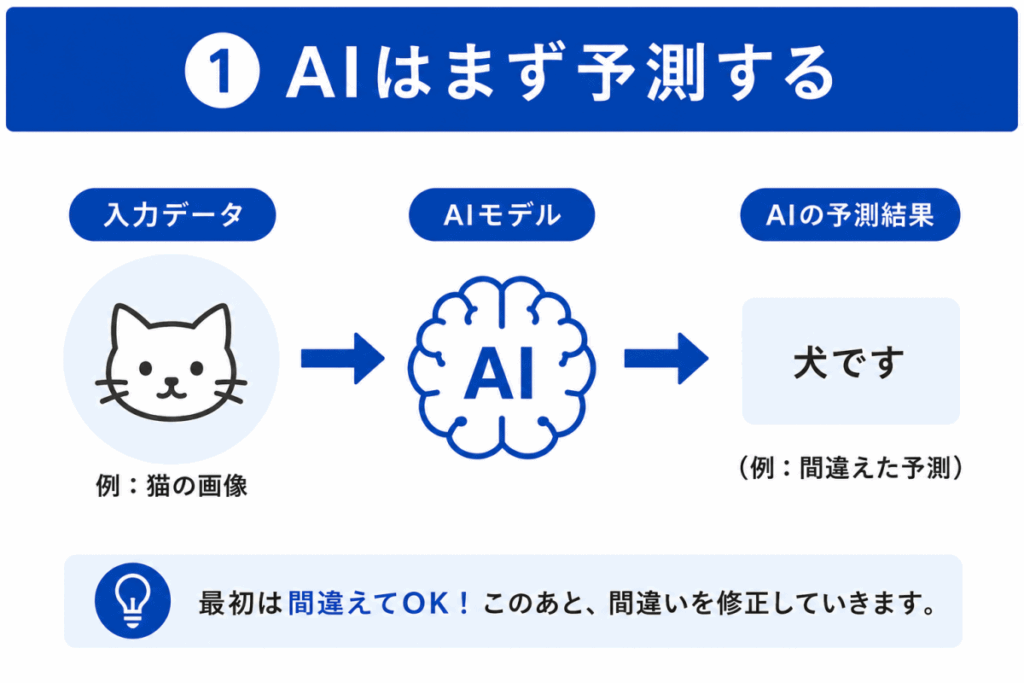

① AIはまず予測する

最初にAIは

- 画像

- 文章

- 数値データ

などを入力として受け取り「とりあえず予測」します。

例えば猫画像分類なら

- 入力 → 猫画像

- AI予測 → 「犬です」

のように、最初は普通に間違えます。

しかし、問題ありません。

AI学習では「最初は間違える前提」だからです。

重要なのは「どれだけ間違えたか」を次に測ることです。

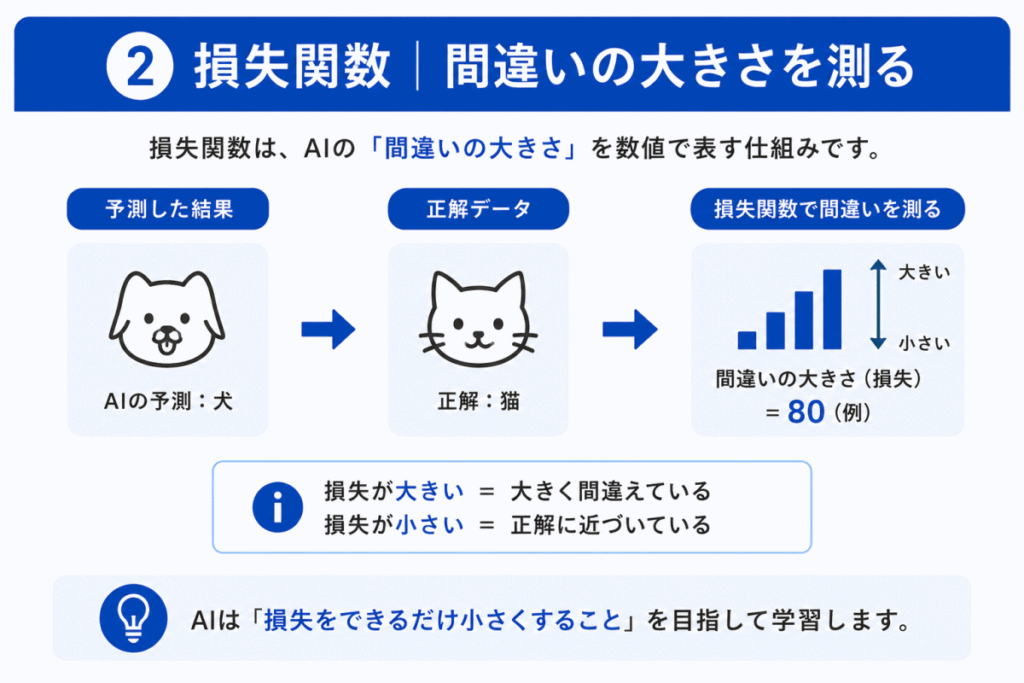

② 損失関数|間違いの大きさを測る

AIが予測した後は「どのくらい間違えたか」を測ります。

ここで登場するのが 損失関数 です。

損失関数は「AIの間違い点数」のようなものです。

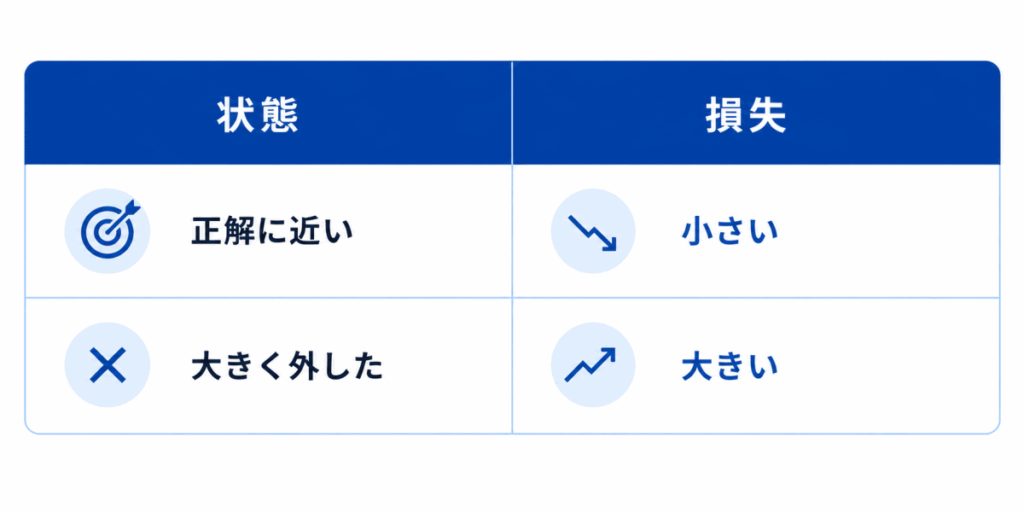

状態と損失の関係を表したものが下の表です。

一般的に 損失が小さいほど良いAI です。AI学習の目的は「損失をできるだけ小さくする」ことです。

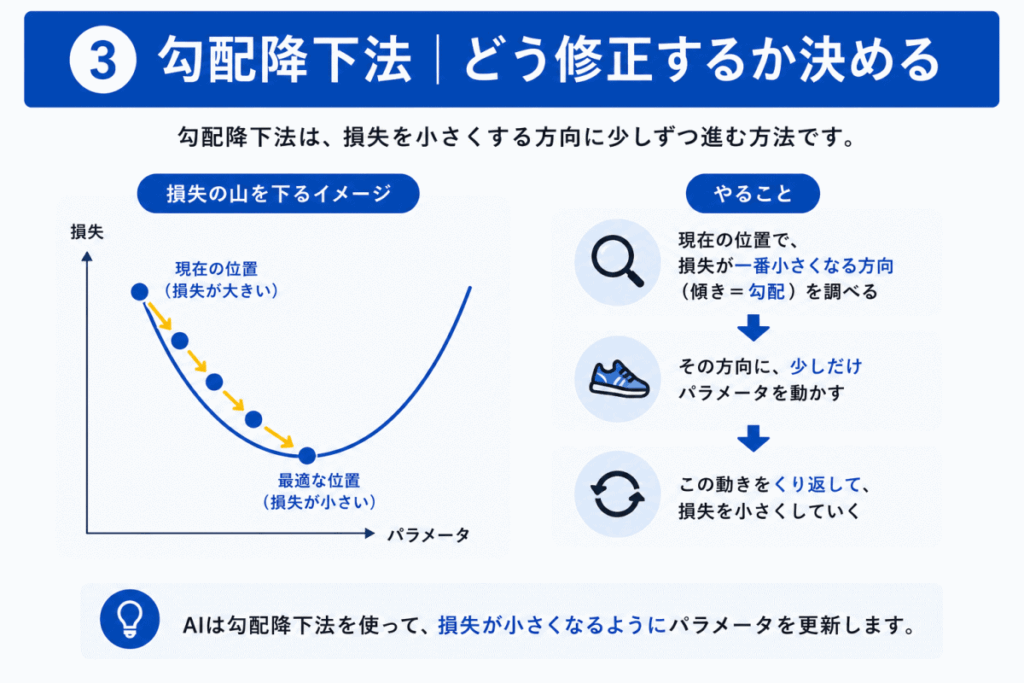

③ 勾配降下法|どう修正するか決める

次にAIは「どう修正すれば損失が減るか」を考えます。

ここで使われるのが 勾配降下法 です。

勾配降下法は簡単に言うと「損失が減る方向を探す仕組み」です。

山登りの逆をイメージするとわかりやすいです。

AIは「より低い場所」を探し続けます。

つまり「もっと間違いが少なくなる方向」へ少しずつ進むのです。

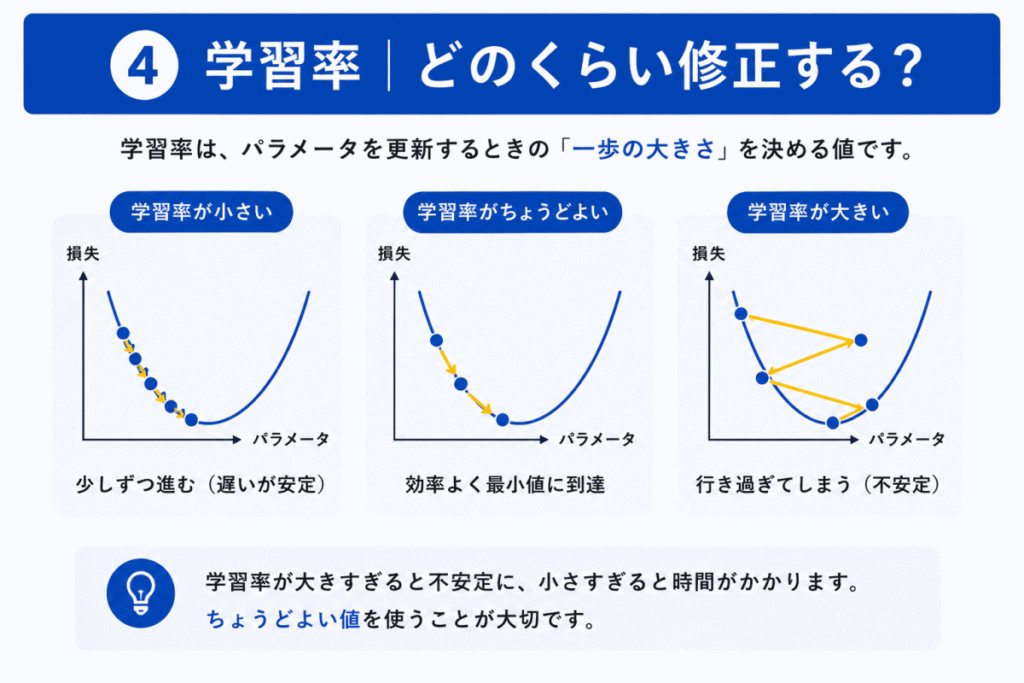

④ 学習率|どのくらい修正する?

方向が決まっても「どのくらい動くか」は別問題です。

ここで登場するのが 学習率 です。

学習率は「修正の大きさ」を決めます。

学習率が大きすぎる場合

- 行き過ぎる

- 最適解を飛び越える

- 学習が不安定

学習率が小さすぎる場合

- 学習が遅い

- なかなか改善しない

つまり「ちょうどよい修正量」が重要なのです。

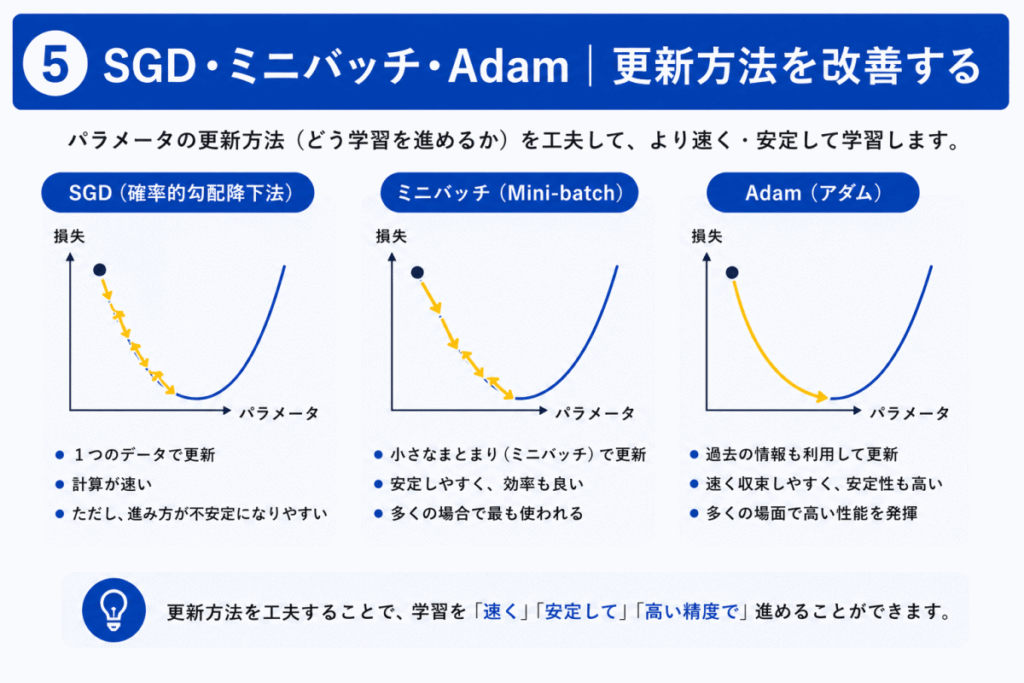

⑤ SGD・ミニバッチ・Adam|更新方法を改善する

ここで初学者が非常に混乱します。

なぜなら

- SGD

- ミニバッチ

- Adam

が全部「似たもの」に見えるからです。

しかし、実際には下の表の違いがあります。

つまり「どう更新するか」を改善している技術です。

特にAdamは

- 学習率調整

- 更新効率改善

などを組み合わせた、非常に強力な最適化アルゴリズムです。

現在のディープラーニングでは重要項目です。

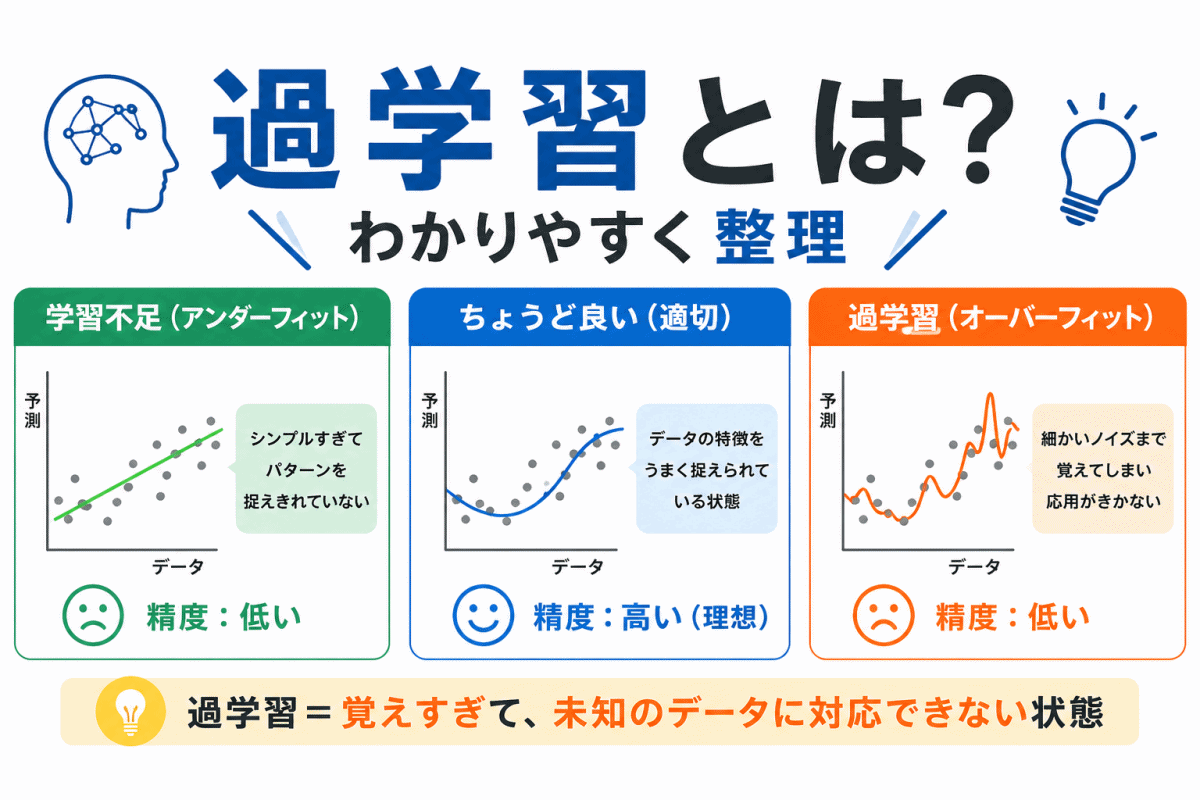

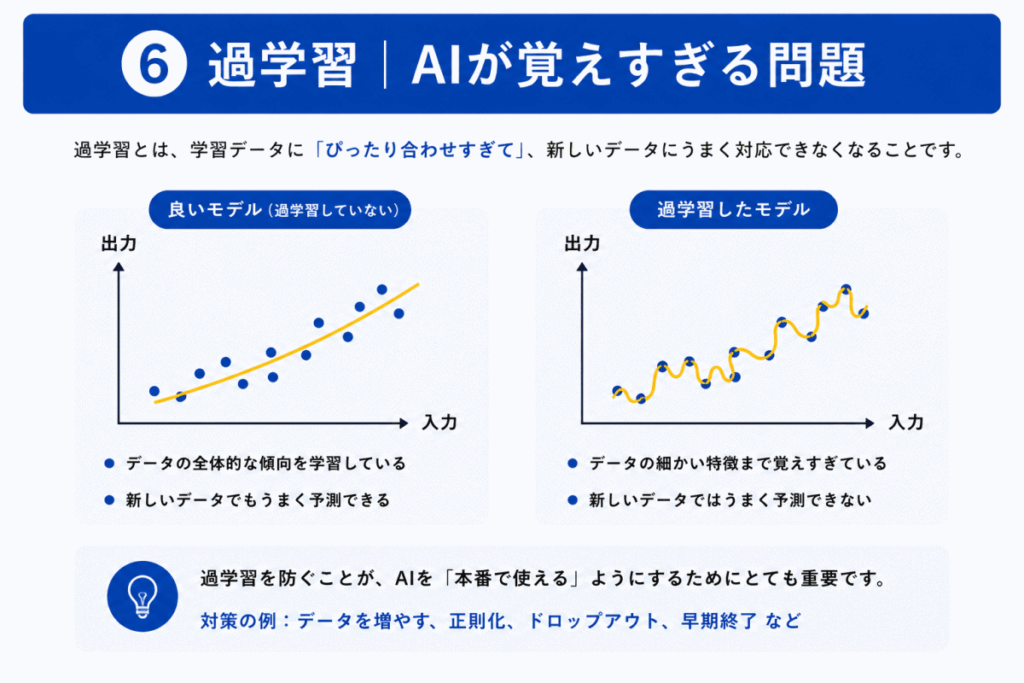

⑥ 過学習|AIが覚えすぎる問題

AI学習では「学習すればするほど良い」わけではありません。

ここで登場するのが 過学習 です。

過学習とは「訓練データを覚えすぎた状態」です。

この状態になると

- 訓練データ → 高精度

- 初見データ → 弱い

になります。

つまり「応用力がなくなる」のです。

これは人間の試験勉強にもかなり近いです。

- 問題だけ暗記

- 解き方だけ記憶

- 問い方変更で崩れる

という状態です。

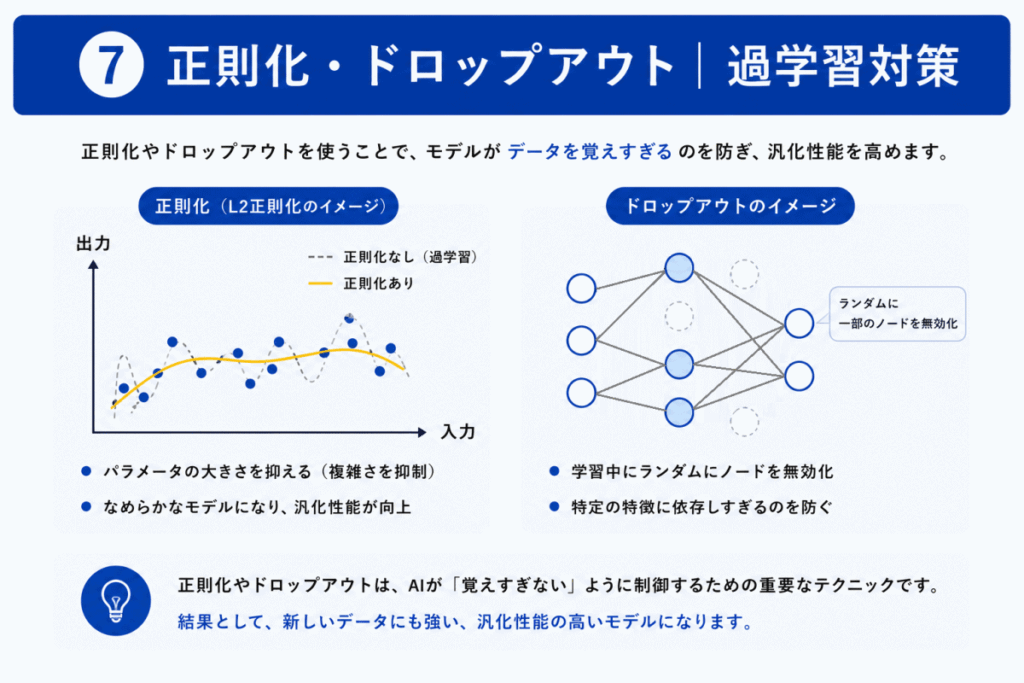

⑦ 正則化・ドロップアウト|過学習対策

過学習を防ぐために

- 正則化

- ドロップアウト

などを使います。

正則化

→ 学習しすぎを抑える

ドロップアウト

→ 一部ニューロンをランダム停止

です。

目的は共通しています。「覚え込みすぎ防止」です。

つまり「汎化性能を上げる」ための技術です。

「汎化性能」とは「未知のデータ」に対して正しく予測・識別できる能力を言います。

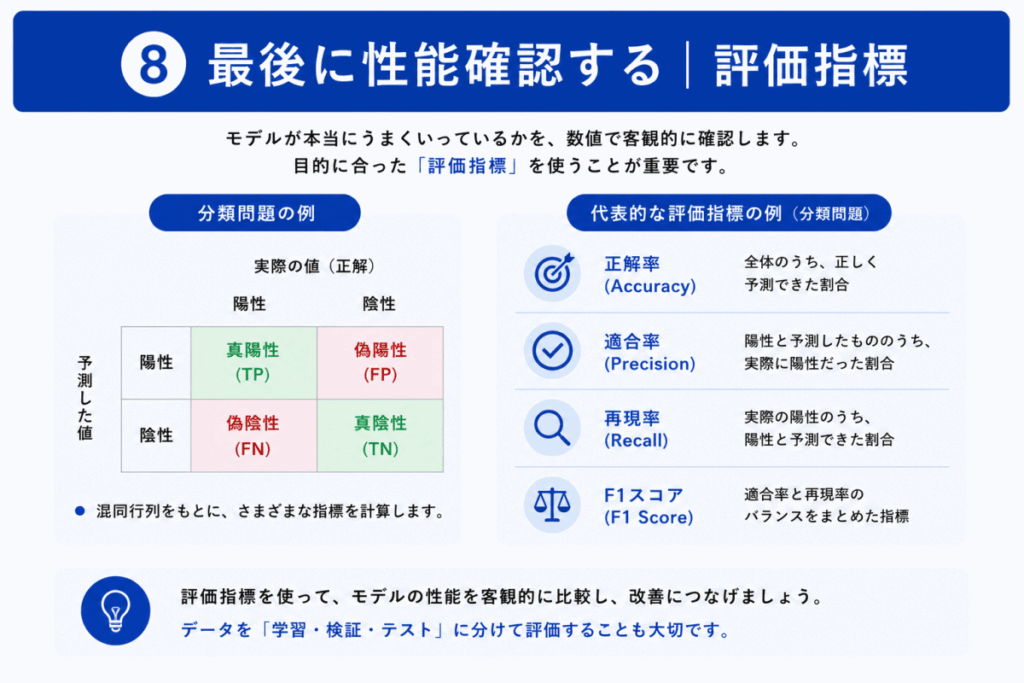

⑧ 最後に性能確認する|評価指標

最後に「結局どれくらい性能が良いのか」を確認します。

ここで使うのが

- 正解率

- 適合率

- 再現率

- F1値

などの 評価指標 です。

重要なのは 損失関数と評価指標は別物 ということです。関係性をまとめたものが下の表になります。

ここはG検定でも非常に混同しやすいポイントです。

G検定ではどう問われる?

G検定では「AI学習の流れ」を理解しているかが非常に重要です。

例えば

- 損失関数の役割

- 勾配降下法との関係

- 学習率の意味

- Adamの特徴

- 過学習対策

などは単独ではなく「つながった状態」で問われることがあります。

そのため「単語暗記」だけでは崩れやすいです。

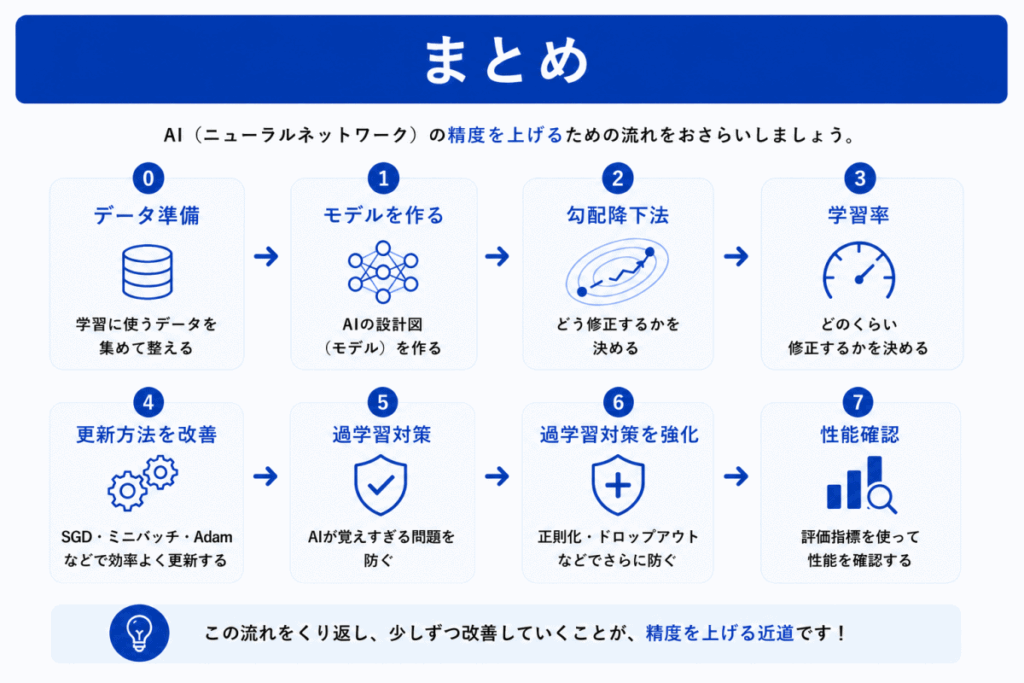

まとめ

AI学習は「間違いを修正し続ける仕組み」です。

流れを整理すると下記の通りです。

① 予測する

② 間違いを測る(損失関数)

③ 修正方向を探す(勾配降下法)

④ 修正量を決める(学習率)

⑤ 更新方法を改善する(SGD / Adam)

⑥ 覚えすぎを防ぐ(過学習対策)

⑦ 最後に性能確認する(評価指標)

重要なのは「全部別々の用語ではない」ことです。

本当は「AIがどう学習するか」という1本の流れの中に存在しています。

この「線」理解できるようになると、G検定の問題でも

- 問い方変更

- 選択肢変更

- 引っかけ問題

に強くなっていきます。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

G検定の概要を理解しやすい流れで確認できるように整理しました。

不合格体験記です。私のような失敗をしないように確認しましょう。