【G検定予想問題】CNN・RNN・Transformer

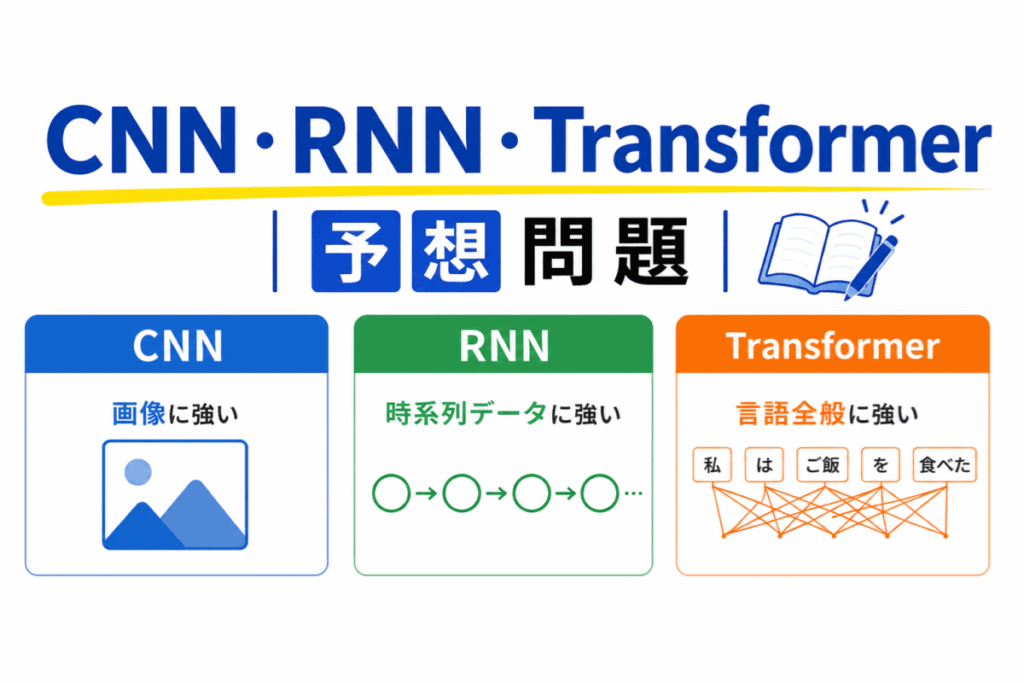

CNN・RNN・Transformer は、G検定でも頻出の重要テーマです。

ただし、「画像」「時系列」「自然言語」と丸暗記しているだけでは、少し聞き方が変わると迷いやすくなります。

この記事では、単なる暗記ではなく

- なぜその答えになるのか

- どこが引っかけなのか

- どう整理すると理解しやすいのか

まで含めて整理していきます。

問題①

画像認識で特に強みを持つモデルとして最も適切なものはどれか?

- A. RNN

- B. CNN

- C. Transformer

- D. 強化学習

- 解答・解説(クリックで開きます)

-

正解

B

解説

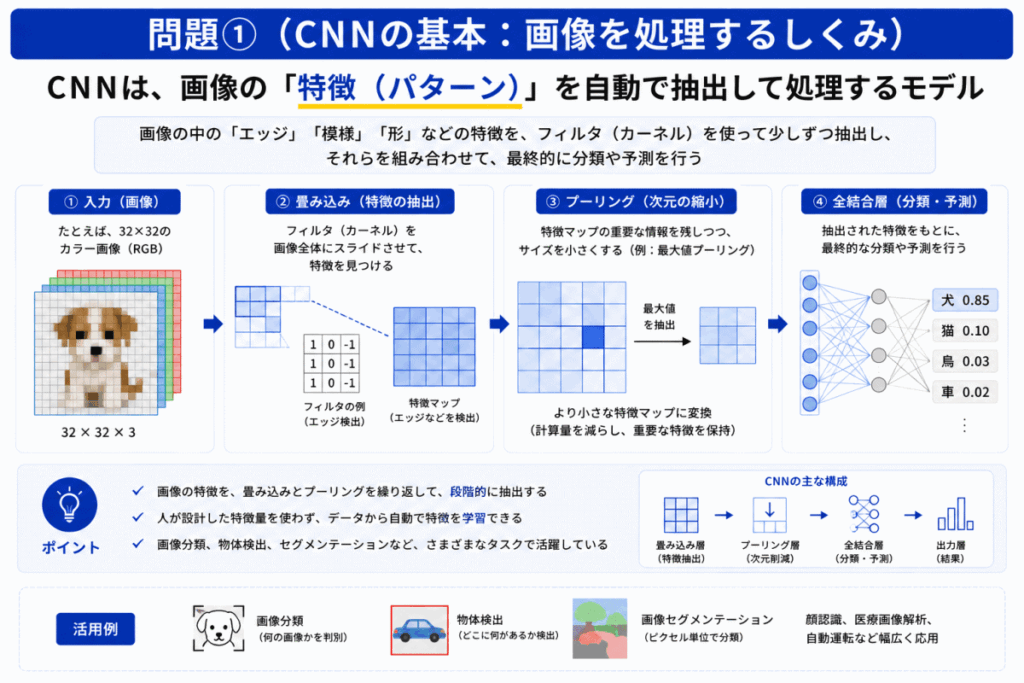

CNN(Convolutional Neural Network)は、画像の特徴を抽出することが得意なモデルです。

特に

- エッジ

- 模様

- 形

- 位置関係

などを学習できます。

そのため

- 画像分類

- 顔認識

- 物体検出

などで広く利用されています。

引っかけポイント

最近はTransformerも画像分野で利用されます。

しかし、G検定の基本整理としては- CNN → 画像

- RNN → 時系列

- Transformer → 自然言語

をまず押さえることが重要です

問題②

文章や音声のように「順番」が重要なデータ処理で活躍したモデルとして最も適切なのはどれか?

- A. CNN

- B. RNN

- C. 決定木

- D. クラスタリング

- 解答・解説(クリックで開きます)

-

正解

B

解説

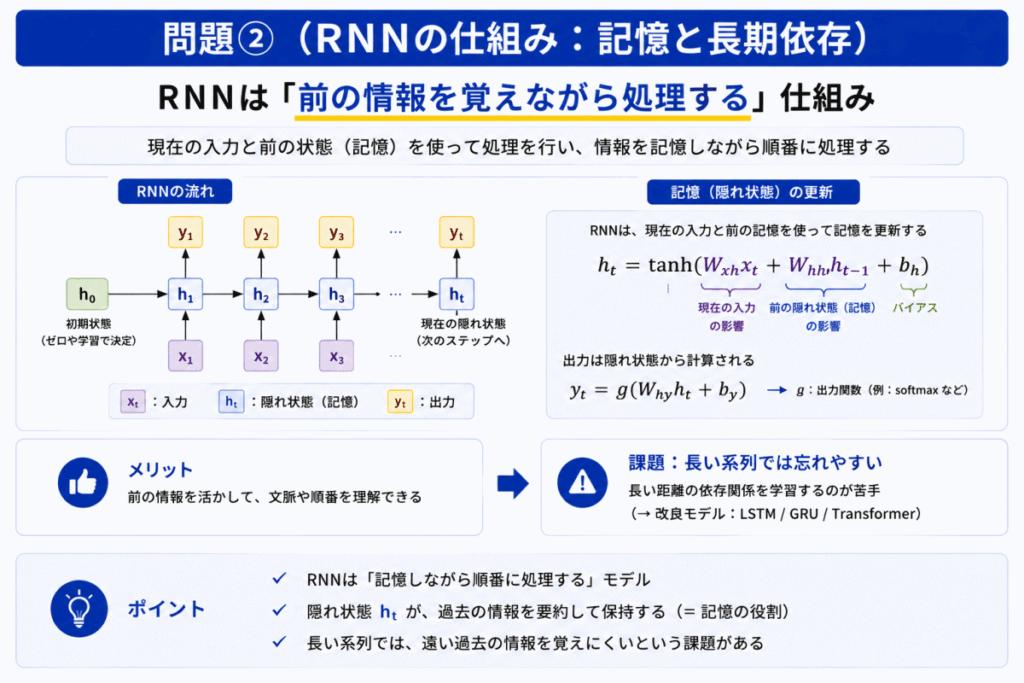

RNN(Recurrent Neural Network)は時系列データを扱うために作られたモデルです。

特徴は前の情報を保持しながら次を処理できることです。例えば

- 翻訳

- 音声認識

- 文章生成

- 株価予測

などで利用されていました。

引っかけポイント

現在の生成AIはTransformerが主流です。

しかし、「時系列処理で有名なモデル」としてRNNはG検定頻出です。

問題③

現在のChatGPTなどの大規模言語モデル(LLM)の中心技術として最も適切なのはどれか?

- A. CNN

- B. RNN

- C. Transformer

- D. 線形回帰

- 解答・解説(クリックで開きます)

-

正解

C

解説

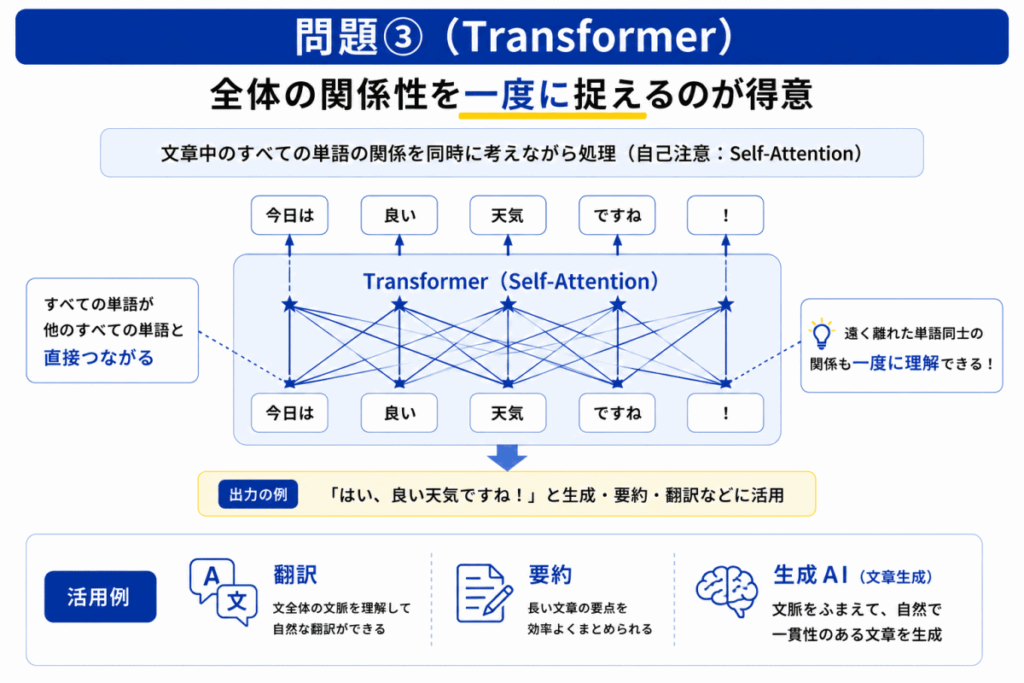

Transformerは、現在の生成AIの中心となっている技術です。

特に、Attention機構によって、文章全体の関係性を効率良く学習できます。

ChatGPTもTransformerベースで作られています。引っかけポイント

「文章 = RNN」とだけ覚えていると迷いやすい問題です。

現在は、RNNよりTransformerが主流になっています。

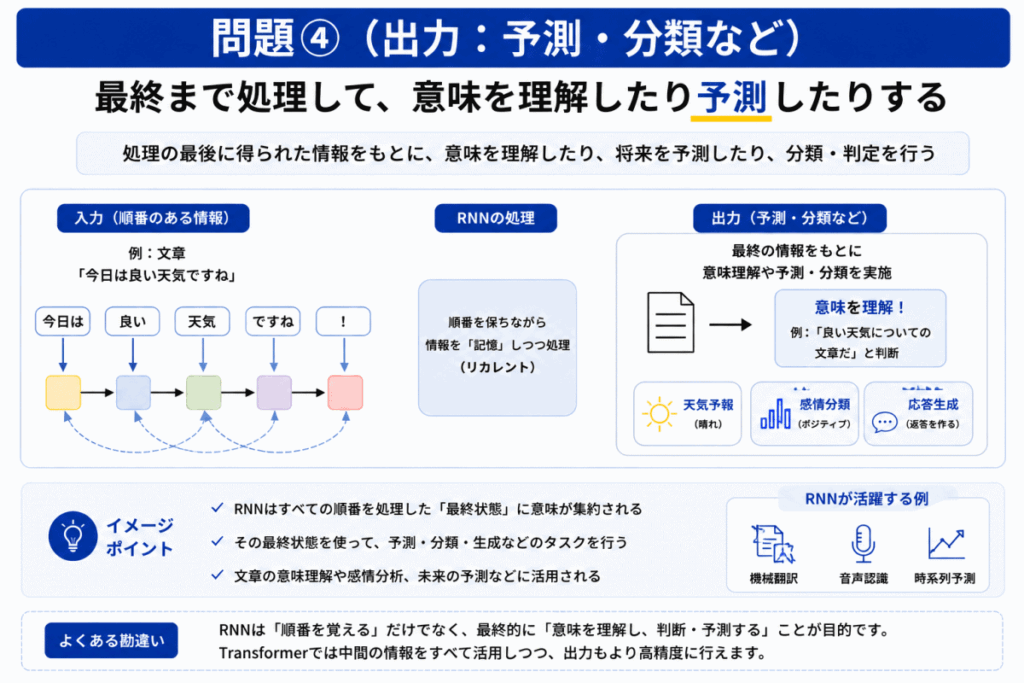

問題④

次の組み合わせとして正しいものはどれか?

- A. CNN:時系列 / RNN:画像 / Transformer:強化学習

- B. CNN:画像 / RNN:時系列 / Transformer:自然言語

- C. CNN:自然言語 / RNN:画像 / Transformer:回帰分析

- D. CNN:教師なし学習 / RNN:教師あり学習 / Transformer:クラスタリング

- 解答・解説(クリックで開きます)

-

正解

C

解説

Transformerは、現在の生成AIの中心となっている技術です。

特に、Attention機構によって、文章全体の関係性を効率良く学習できます。

ChatGPTもTransformerベースで作られています。引っかけポイント

「文章 = RNN」とだけ覚えていると迷いやすい問題です。

現在は、RNNよりTransformerが主流になっています。

問題⑤

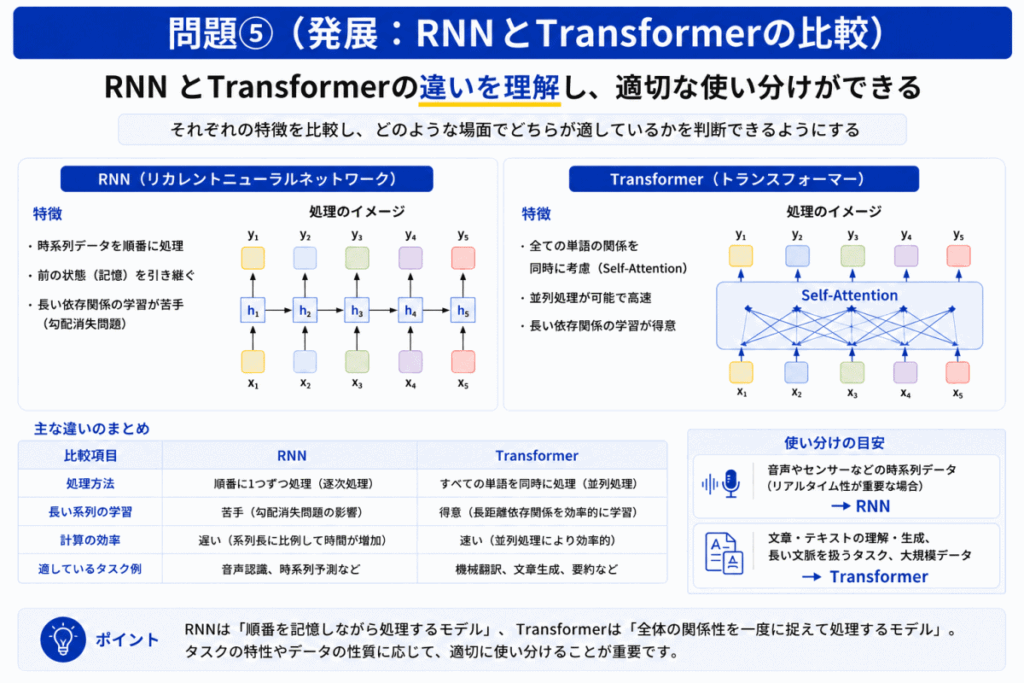

RNNが苦手としていた問題として最も適切なものはどれか?

- A. 画像認識

- B. 長期依存問題

- C. 教師なし学習

- D. 正則化

- 解答・解説(クリックで開きます)

-

正解

B

解説

RNNは、文章が長くなると、前半の情報を保持しづらくなる問題がありました。

これを「長期依存問題」と呼びます。

Transformerは、Attention機構によって、文章全体を参照しやすくなっています。引っかけポイント

「文章処理 = RNN」だけで覚えていると、Transformerが広まった理由を説明できません。

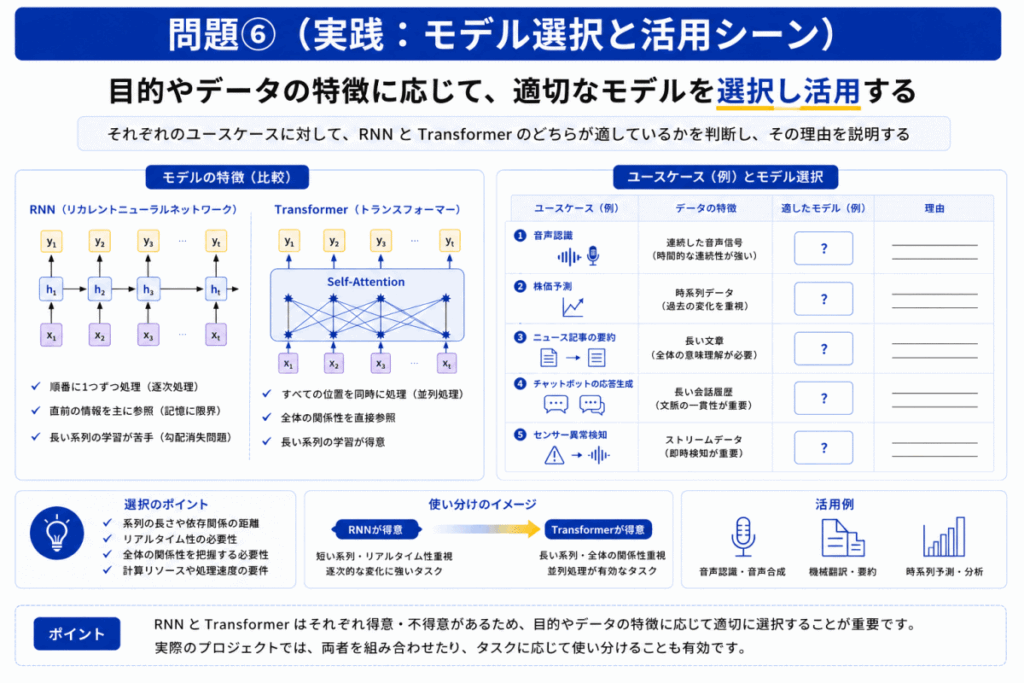

問題⑥

Transformerで重要な役割を持つ機構として最も適切なのはどれか?

- A. 正則化

- B. Attention機構

- C. 活性化関数

- D. クラスタリング

- 解答・解説(クリックで開きます)

-

正解

B

解説

Attention機構は文章中の「どこに注目すべきか」を判断する仕組みです。

例えば

「私は昨日、映画を見た。それは面白かった。」

の「それ」が何を指しているかなど、文章全体の関係性を理解しやすくなります。

引っかけポイント

「Transformer = 難しい」で終わるのではなく「文章全体を見やすくした仕組み」と理解すると整理しやすくなります。

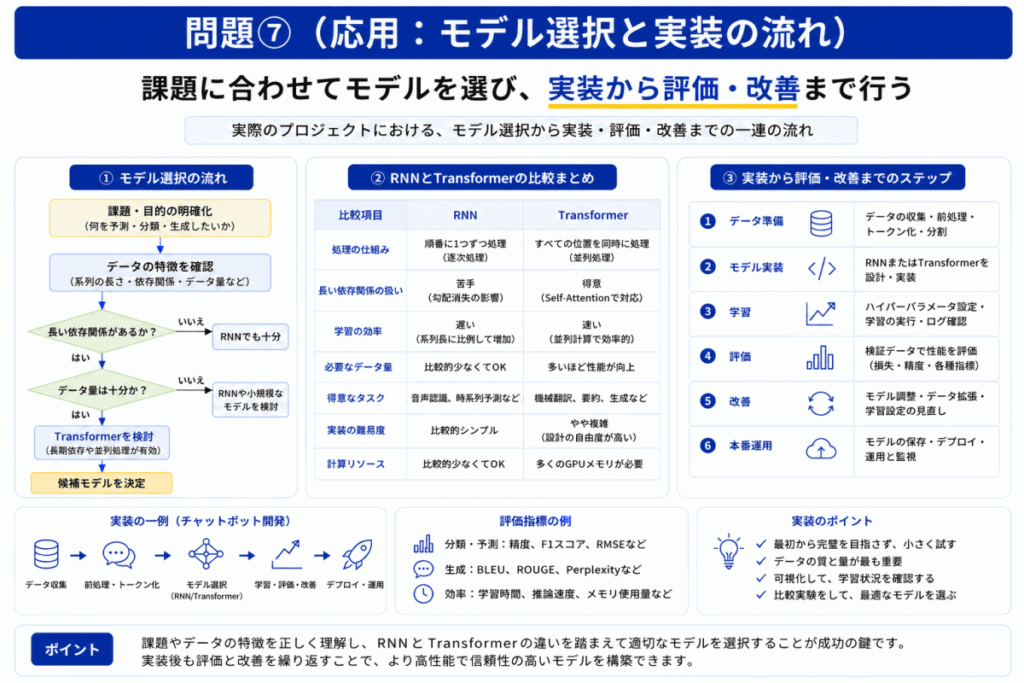

問題⑦

次の説明として最も適切なものはどれか?

- A. CNNは文章処理専用モデルである

- B. RNNは画像認識専用モデルである

- C. Transformerは長文処理に強みを持つ

- D. Transformerは時系列データを扱えない

- 解答・解説(クリックで開きます)

-

正解

C

解説

Transformerは、Attention機構によって、長文でも情報を保持しやすい特徴があります。

そのため

- ChatGPT

- Gemini

- Claude

などの生成AIでも利用されています。

引っかけポイント

「RNN = 文章」だけで止まっていると、現在の生成AIとのつながりが見えにくくなります。

G検定では- RNNの弱点

- Transformerが普及した理由

まで理解しておくことが重要です。

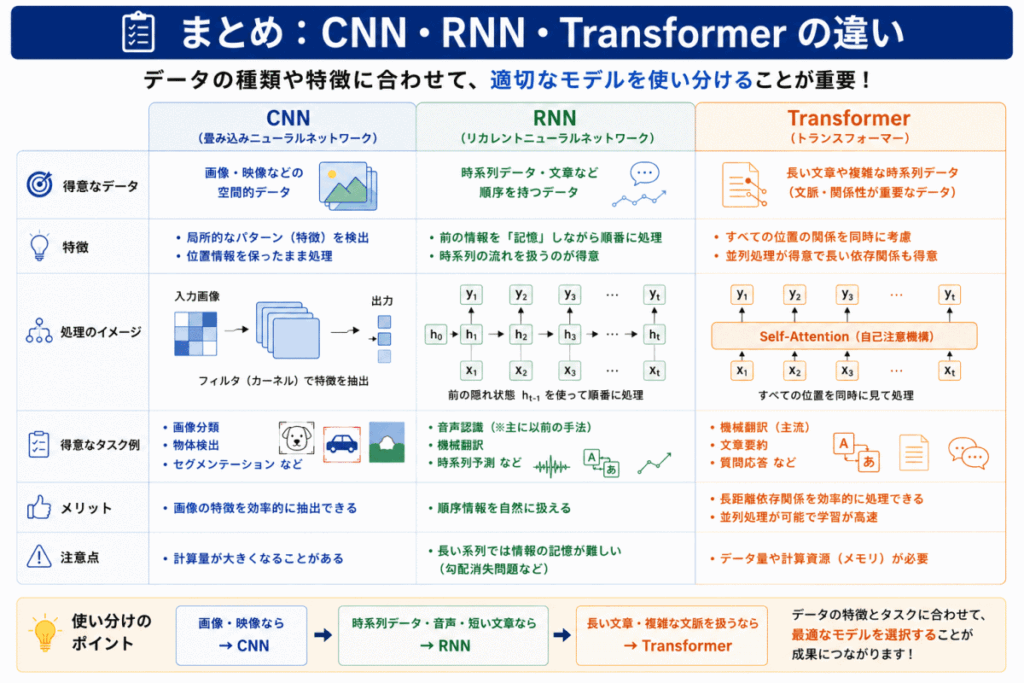

まとめ

CNN・RNN・Transformer は、G検定でも頻出の重要テーマです。

特に重要なのは、単なる暗記ではなく

- なぜCNNが画像に強いのか

- なぜRNNが時系列向きなのか

- なぜTransformerが普及したのか

まで理解することです。

まずは

- CNN → 画像

- RNN → 時系列

- Transformer → 自然言語

を整理し、その後に「なぜそうなるのか」を理解していくと、G検定でも応用が効きやすくなります。

関連記事・おすすめ記事

この予想問題よりもCNN・RNN・Transformerを詳しく整理しています。

不合格体験記です。私のような失敗をしないように確認しましょう。