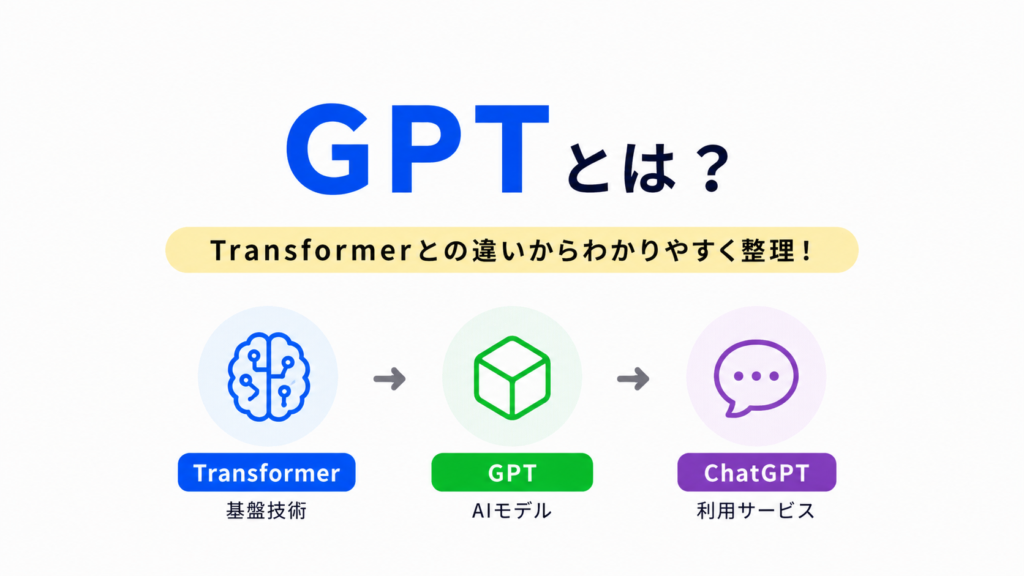

【G検定対策】GPTとは?|Transformerとの違いからわかりやすく整理

AIの学習をはじめたばかりの人にとって

- GPT

- ChatGPT

- LLM

- Transformer

は非常に混同しやすい用語です。

特に「GPT = ChatGPT?」と思ってしまう人はかなり多いです。

しかし、実際には

という「階層」があります。

この記事では

- GPTとは何か

- Transformerとの関係

- ChatGPTとの違い

- なぜ文章生成が得意なのか

- AI内部では何が起きているのか

を、流れで整理していきます。

GPTとは?

GPTとは「文章を予測しながら生成するAIモデル」です。

GPTは Generative Pre-trained Transformer の略です。

意味を分解すると

- Generative → 生成する

- Pre-trained → 事前学習済み

- Transforme → Transformer技術を使っている

という意味になります。

つまり、GPTは「Transformerを使った文章生成AI」です。

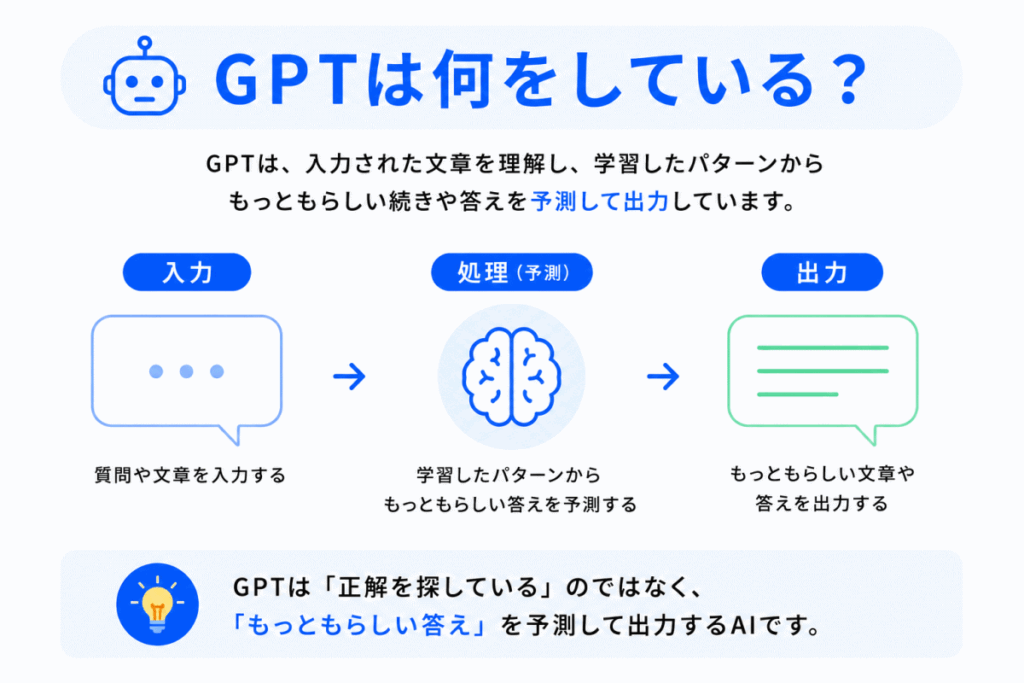

GPTは何をしている?

GPTがやっていることは非常にシンプルです。

基本は「次に来そうな単語を予測する」だけです。

例えば

「私は昨日、コンビニで…」

と来たら

- おにぎりを買った

- 飲み物を買った

- コーヒーを買った

など「次に来そうな単語」を予測しています。

重要なのは「意味理解」ではなく「予測」だという点です。

ここは今後の

- ハルシネーション

- AIの誤回答

- 自信満々に間違える理由

へつながる超重要ポイントです。

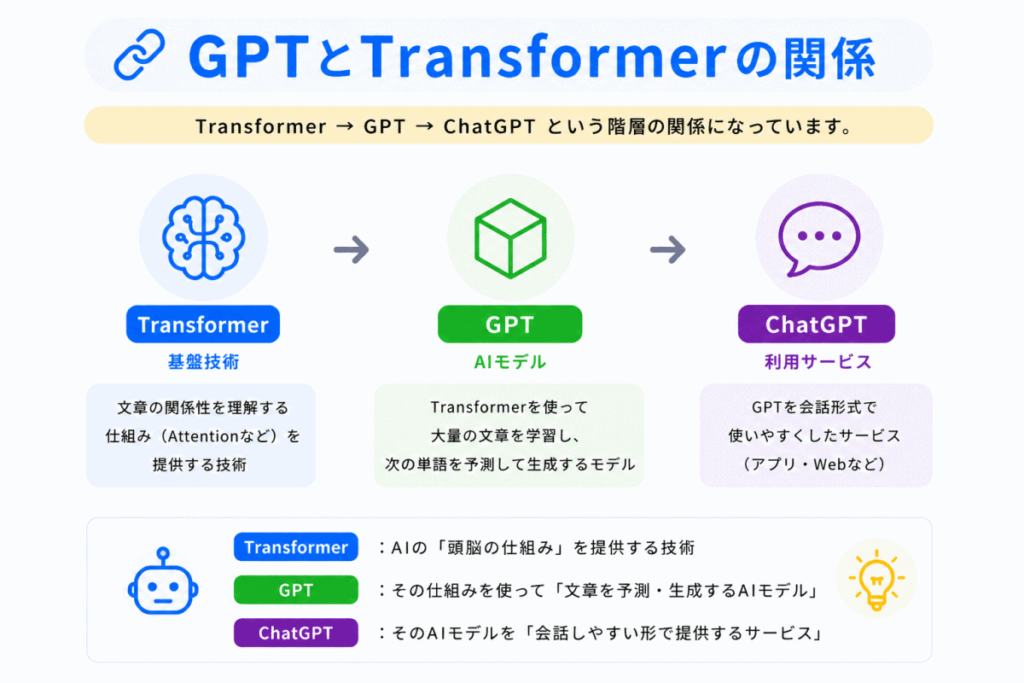

GPTとTransformerの関係

ここはかなり混同しやすい部分です。

関係性を整理すると

という関係(階層)です。

そして

使いやすくしたサービス

です。

つまり GPT = Transformerではない という点が重要です。

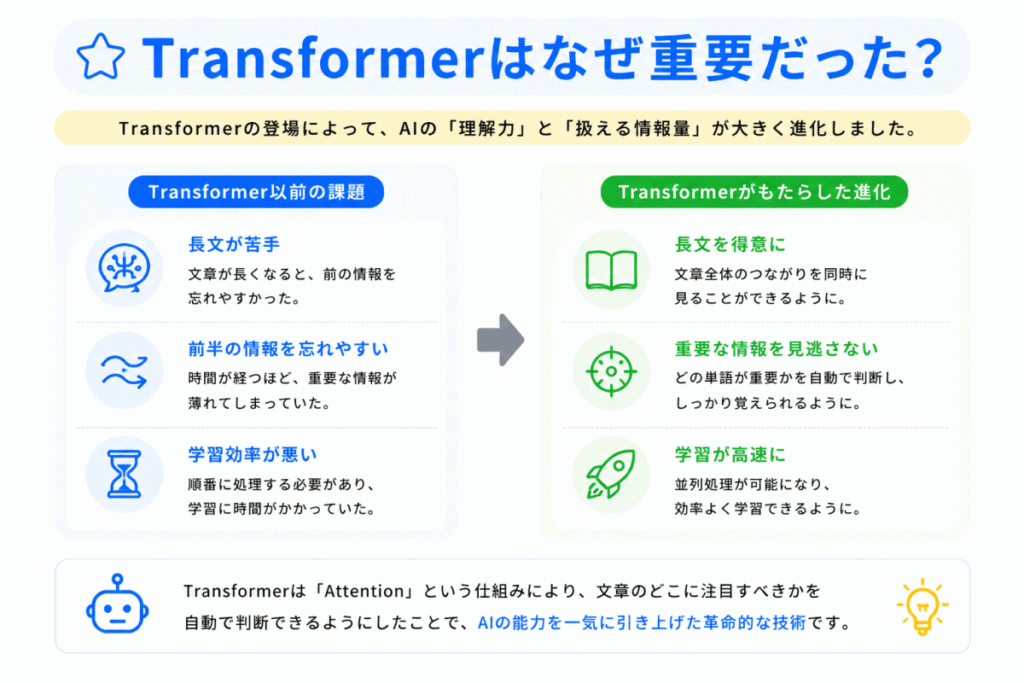

Transformerはなぜ重要だった?

GPTが強力になった最大理由は Transformer技術 にあります。

Transformer以前は

- 長文が苦手

- 前半の情報を忘れやすい

- 学習効率が悪い

という問題がありました。

しかし、Transformerでは Attention によって、「文章のどこを重要視するか」を判断できるようになりました。

その結果

- 長文理解

- 文脈整理

- 自然な文章生成

が大きく進化しました。

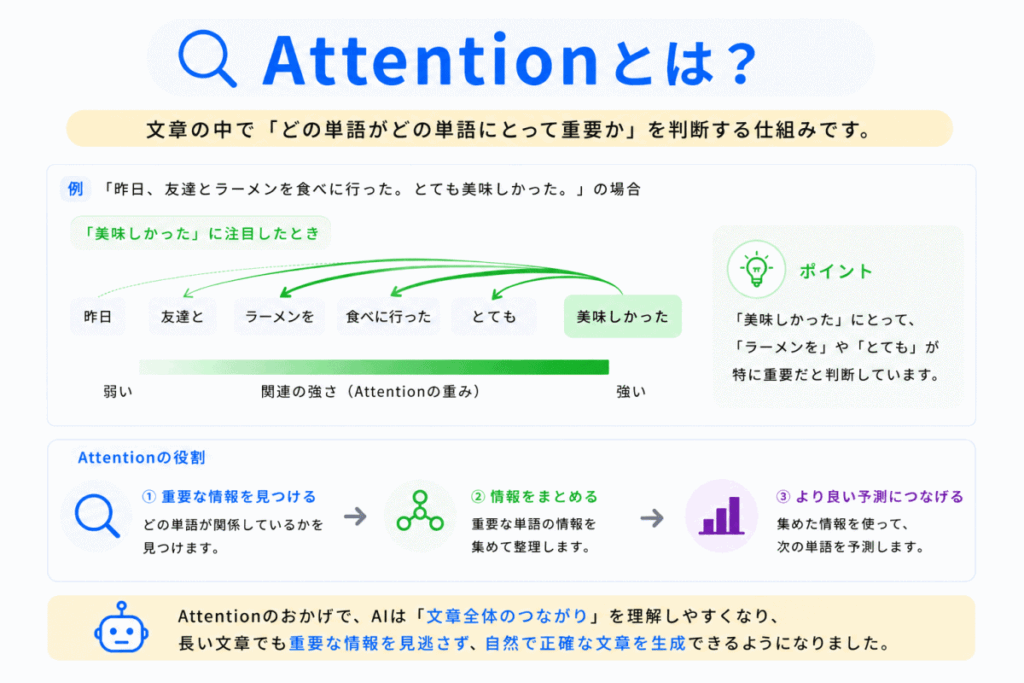

Attentionとは?

Attentionとは「重要な部分へ注目する仕組み」です。

例えば「昨日食べたラーメンは美味しかった」という文章では「美味しかった」が

- 昨日?

- 食べた?

- ラーメン?

のどれと強く関係するかを見ています。

ここで重要なのは「単語同士の関係性を見る」という点です。

これによって 文脈理解が大きく向上 しました。

なぜGPTは文章生成が得意なのか?

GPTは大量の文章を学習しています。

その結果

- 次に来やすい単語

- よくある文章パターン

- 自然な流れ

を大量に覚えています。

つまり「文章パターン予測の達人」になっている状態です。

だから

- 会話

- 要約

- 翻訳

- 文章作成

などが得意です。

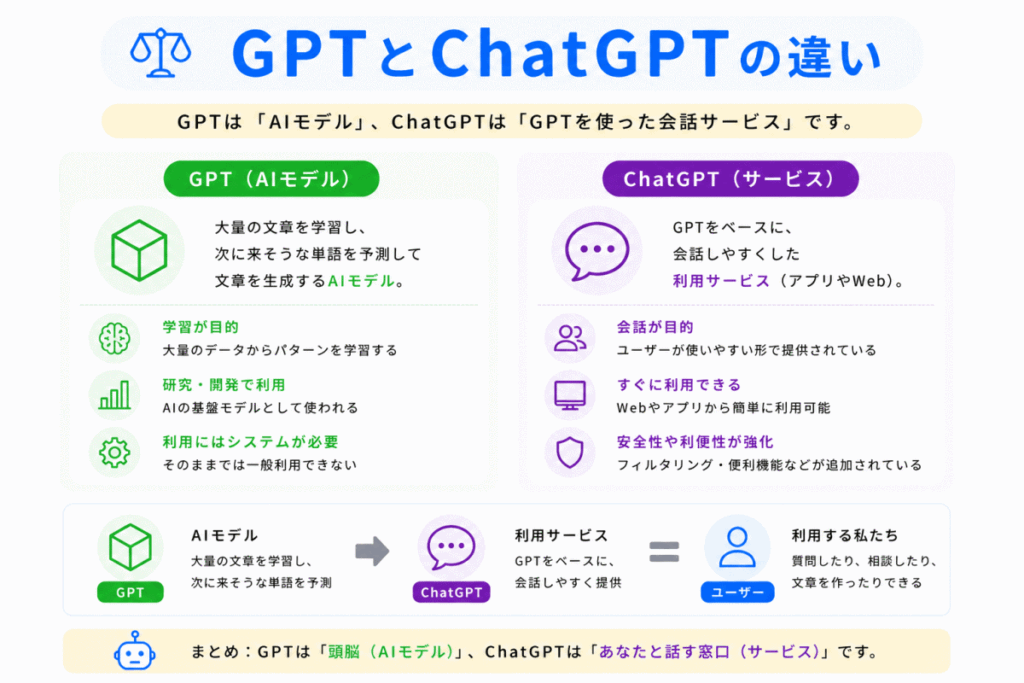

GPTとChatGPTの違い

ここも非常に混同しやすい部分です。

整理すると

利用するサービス

です。

人間の世界に例えるなら

のような関係です。

つまり、ChatGPTの中でGPTが動いている イメージです。

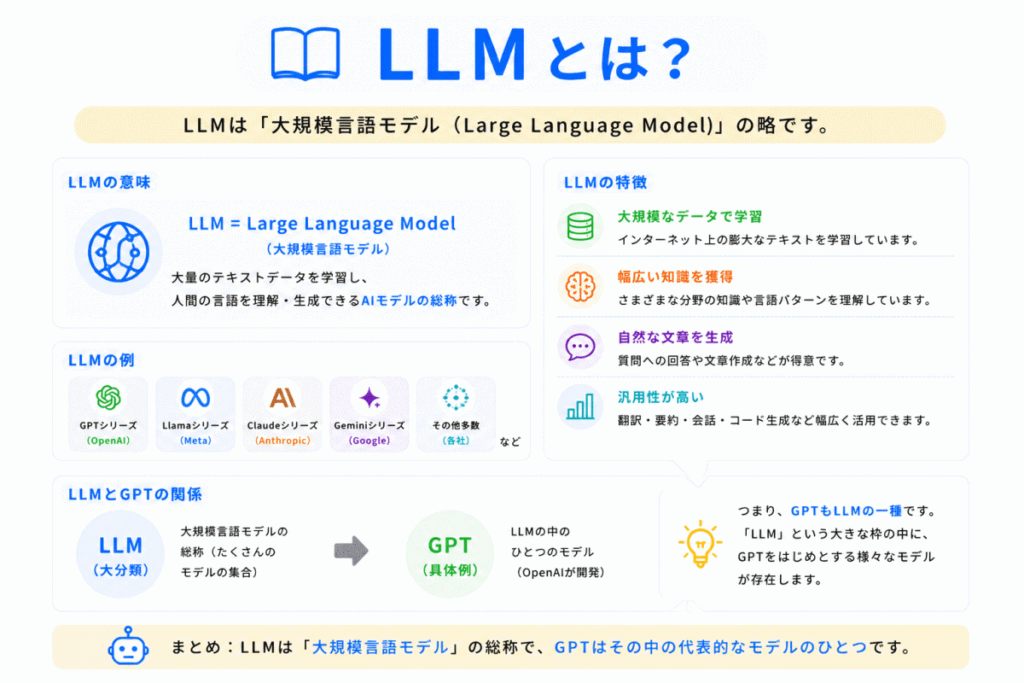

LLMとは?

LLMとは Large Language Model の略です。

意味は「大規模言語モデル」です。

GPTもLLMの一種です。

つまり

です。

ここも「LLM = GPT」ではない 点が重要です。

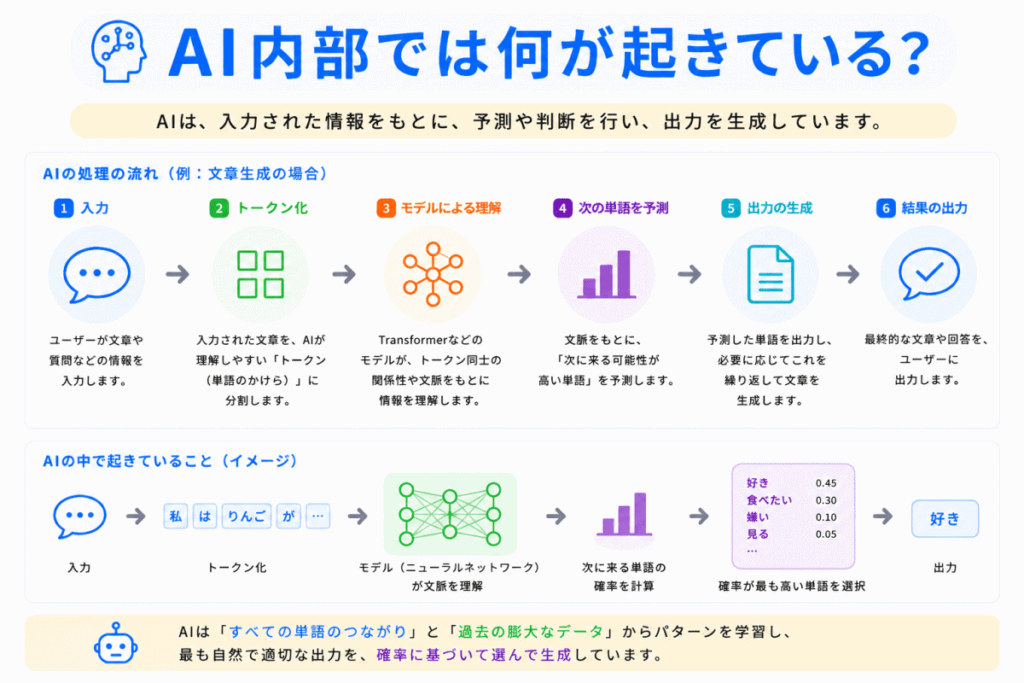

AI内部では何が起きている?

GPT内部では、次の流れが起きています。

重要なのは「理解」より「予測」です。

GPTは「意味を理解して考えている」というより「次に来そうな単語を超高精度で予測している」に近いです。

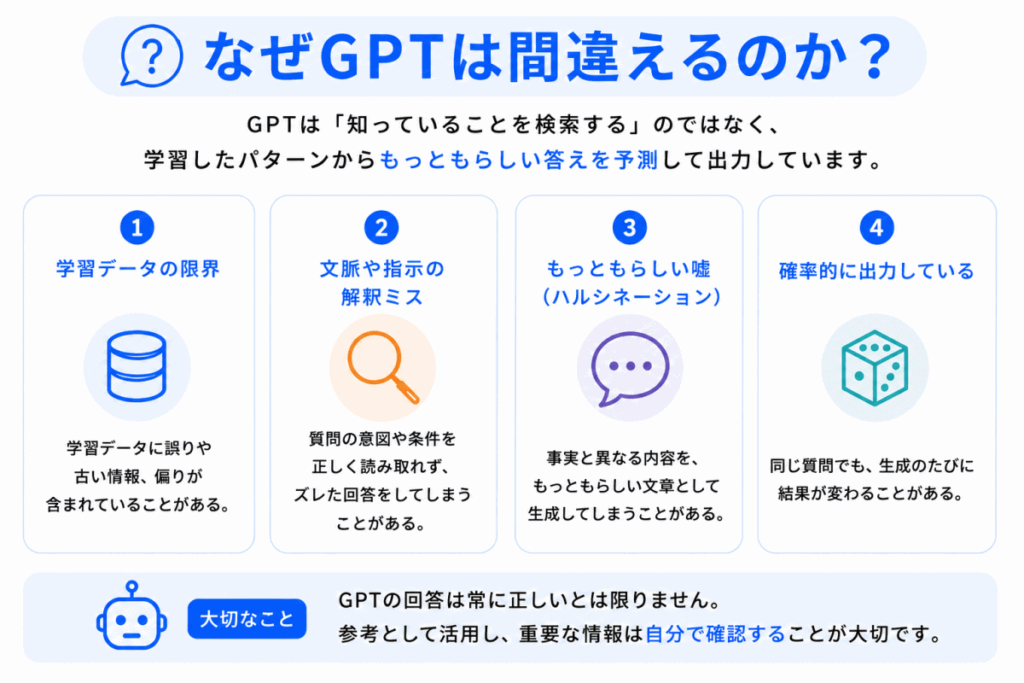

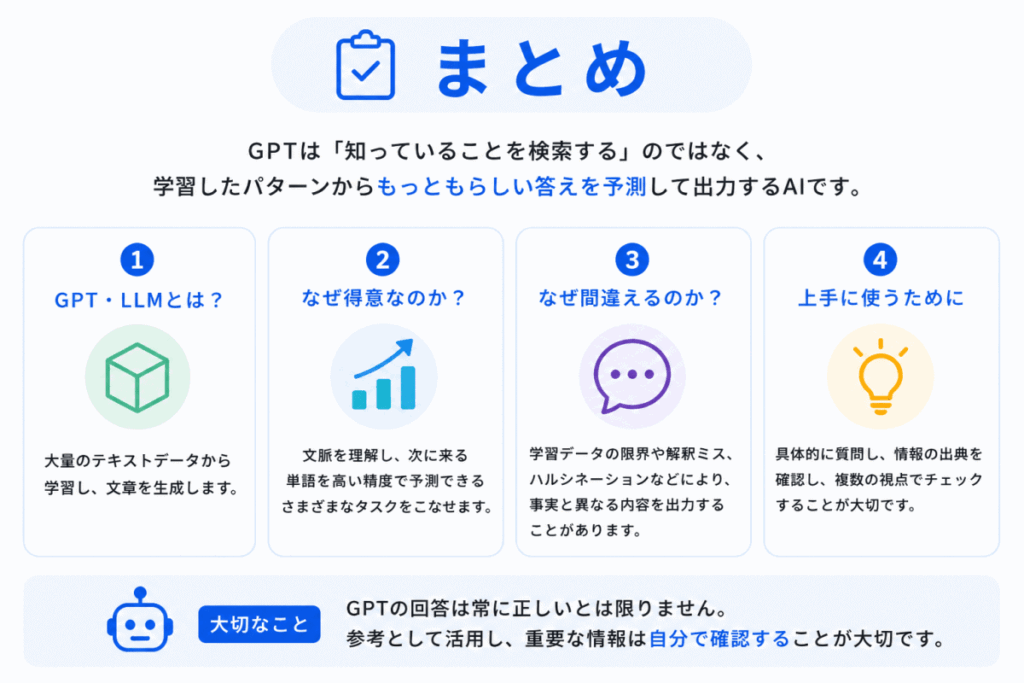

なぜGPTは間違えるのか?

GPTは「もっとも自然そうな文章」を出そうとします。

しかし「正しいかどうか」を保証しているわけではありません。

そのため

- 存在しない情報

- 間違った内容

- 嘘のような文章

を、自然な文章として出力してしまうことがあります。

(GPTに限った話ではありませんが)これが「ハルシネーション」です。

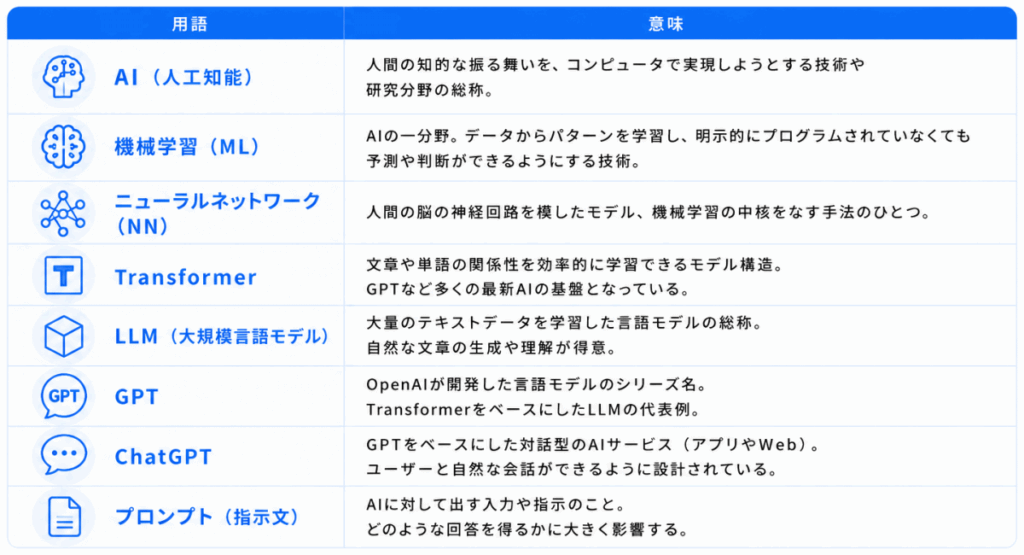

混同しやすい用語

GPT関連で混同しやすい理由は「階層が違う言葉が混ざっている」からです。

例えば

なのですが、全部まとめて「AI」として見えてしまいます。

代表的なものをまとめると下の表になります。

重要なのは「何の階層の話をしているのか?」を整理することです。

まとめ

GPTとは「Transformer技術を使った文章生成AIモデル」です。

そして重要なのは「理解」ではなく「予測」をしている点です。

GPT理解で重要なのは

- Transformerとの関係

- ChatGPTとの違い

- LLMとの位置関係

- Attentionの役割

- 次単語予測

を、「流れ」で理解すること です。

ここが整理できると

- ハルシネーション

- 生成AI

- RAG

- ファインチューニング

なども理解しやすくなります。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

Transformerの構造を理解すると、GPTがなぜ強力なのかが見えやすくなります。

「なぜAIは自信満々に間違えるのか?」、GPTの「予測型AI」という特徴は、ハルシネーション理解にも直結します。

「AIはどうやって賢くなるのか?」、予測・評価・修正というAI内部の流れを理解すると、GPTの見え方も大きく変わります。

不合格体験記です。私のような失敗をしないように確認しましょう。