【G検定対策】AI倫理・AI法律とは?AI時代に必要な考え方をわかりやすく整理

AIは便利な技術ですが、使い方を間違えると大きな問題につながることがあります。

例えば

- 誤情報

- 著作権問題

- 個人情報

- 差別・偏見

- フェイク画像

などです。

そのため、現在は「AIをどう作るか」だけでなく「AIをどう安全に使うか」も非常に重要視されています。

G検定でも法律・倫理分野は出題対象です。

ただし、単語暗記だけでは理解しづらい分野でもあります。

この記事では「なぜAI倫理やAI法律が必要なのか」を、AIの学習をはじめたばかりの人向けにわかりやすく整理します。

2026年現在、G検定では体感レベルですが、あまり問題数が多く出ているわけではありません。

しかし、海外ではAIに関する法律やルール整備が急速に進んでいます。

特にヨーロッパではAI規制が強化されており、日本でも今後さらに議論や法整備が進む可能性があります。

そのため、AI技術だけでなく「AIをどう安全に使うか」を理解する重要性も高まっています。

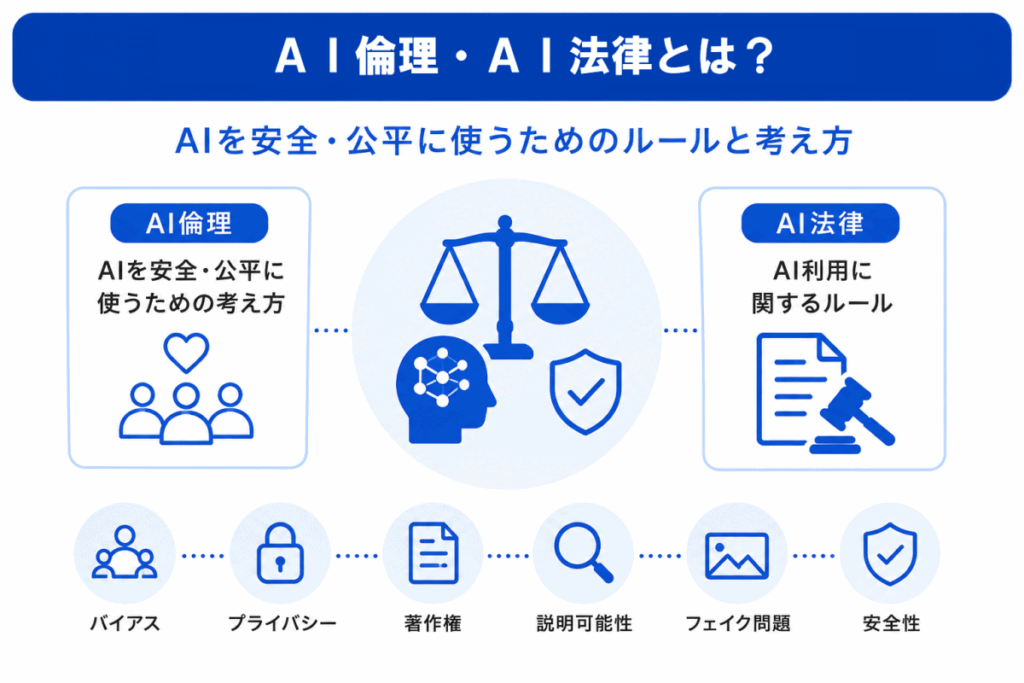

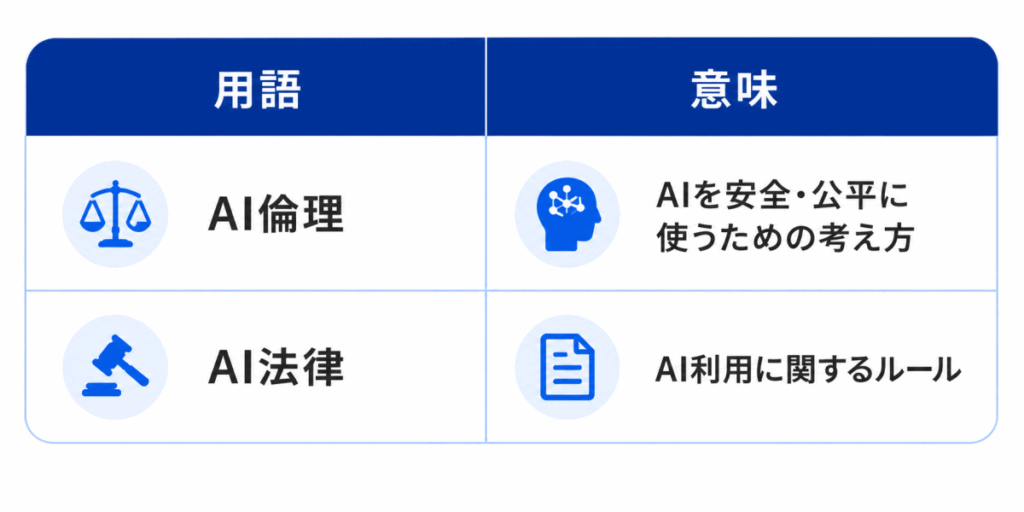

AI倫理・AI法律とは?

一言で言うと下の表にまとめられます。

- AI倫理:AIを安全・公平に使うための考え方

- AI法律:AI利用に関するルール

重要なのは「技術そのもの」ではなく「技術をどう使うか」を扱う分野だということです。

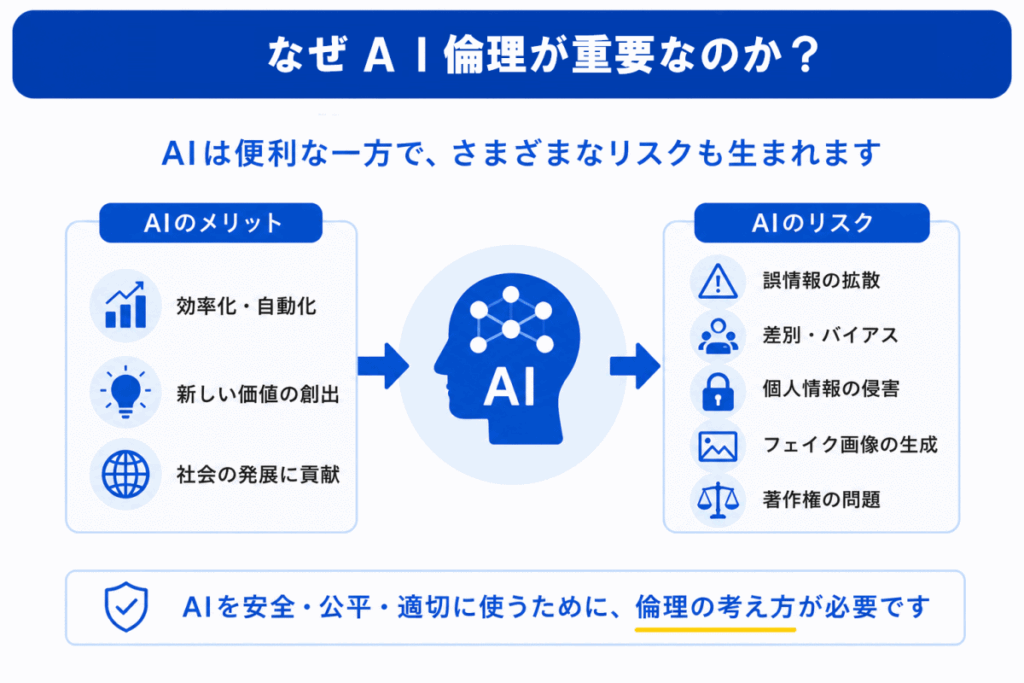

なぜAI倫理が重要なのか?

AIは非常に便利です。

しかし、便利だからこそ問題も起きます。

例えば

- 間違った情報を出力する

- 差別的な判断をする

- 個人情報を学習してしまう

- 本物そっくりの偽画像を作れる

- 著作物に似た文章を生成する

などです。

つまり「AIが高性能になるほど影響力も大きくなる」ということです。

そのため現在は「性能だけ」ではなく「安全性」も重要になっています。

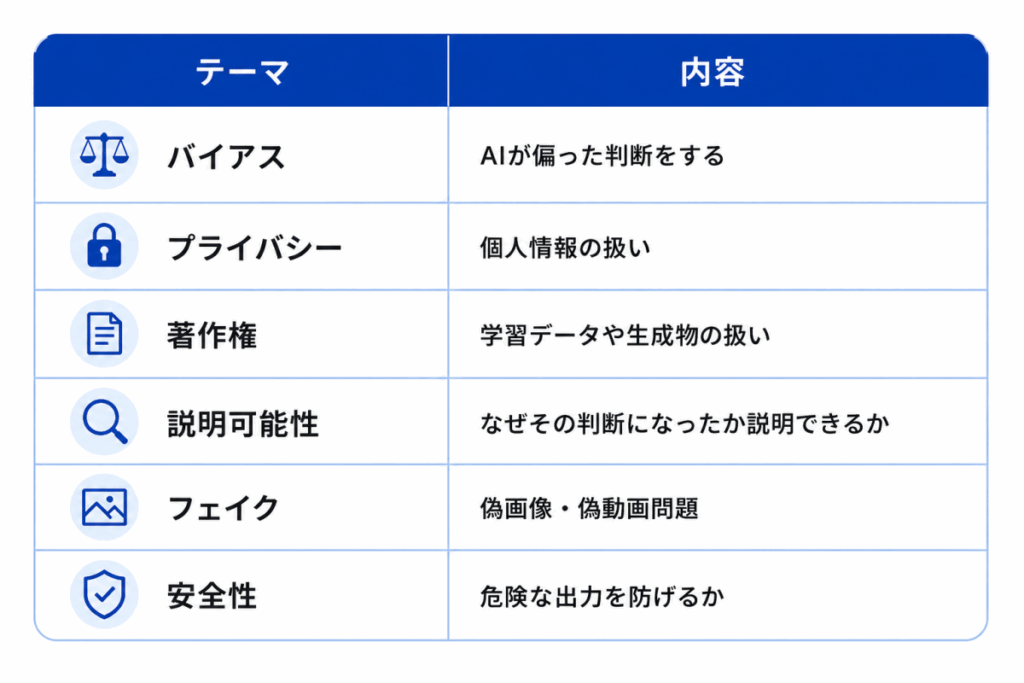

AI倫理でよく出る重要テーマ

G検定では、細かい法律条文暗記よりも「何が問題になっているか」を理解することが重要です。

代表例を整理すると下記の表になります。

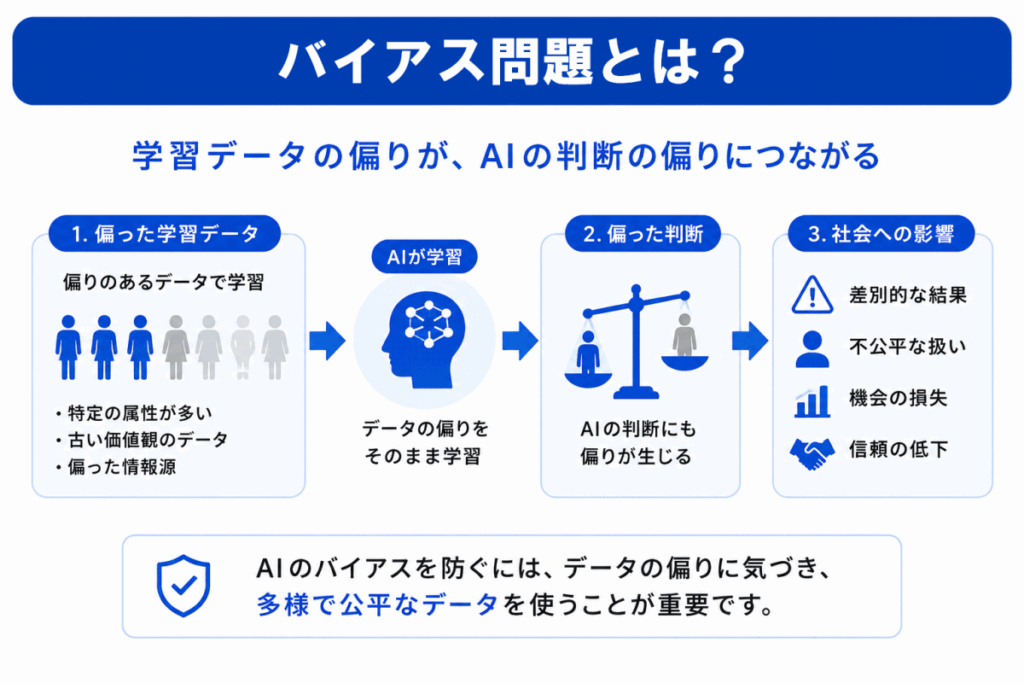

バイアス問題とは?

AIは「学習データ」から学びます。

つまり「偏ったデータで学習すると」→「AIも偏る」可能性があります。

例えば

- 特定属性だけで学習

- 古い価値観のデータ

- 偏ったニュースデータ

などです。

これは「AIが勝手に差別している」のではなく「学習データの偏り」を反映しているケースがあります。

ここはG検定でも重要です。

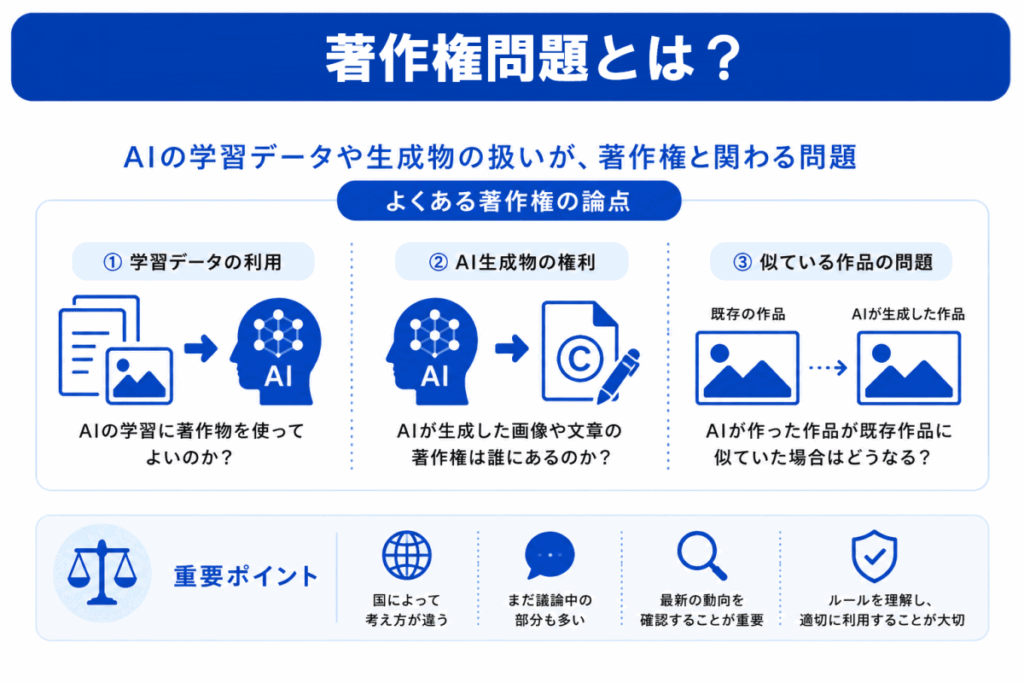

著作権問題とは?

現在、非常に議論されているテーマです。

例えば

- AI学習に著作物を使ってよいのか

- AI生成画像は誰の権利か

- AI生成文章は著作権侵害になるのか

などです。

重要なのは「国によって考え方が違う」こと。

さらに「まだ議論中の部分も多い」ことです。

つまり「絶対こう」と言い切れない分野もあります。

これは法律・AI倫理分野の特徴です。

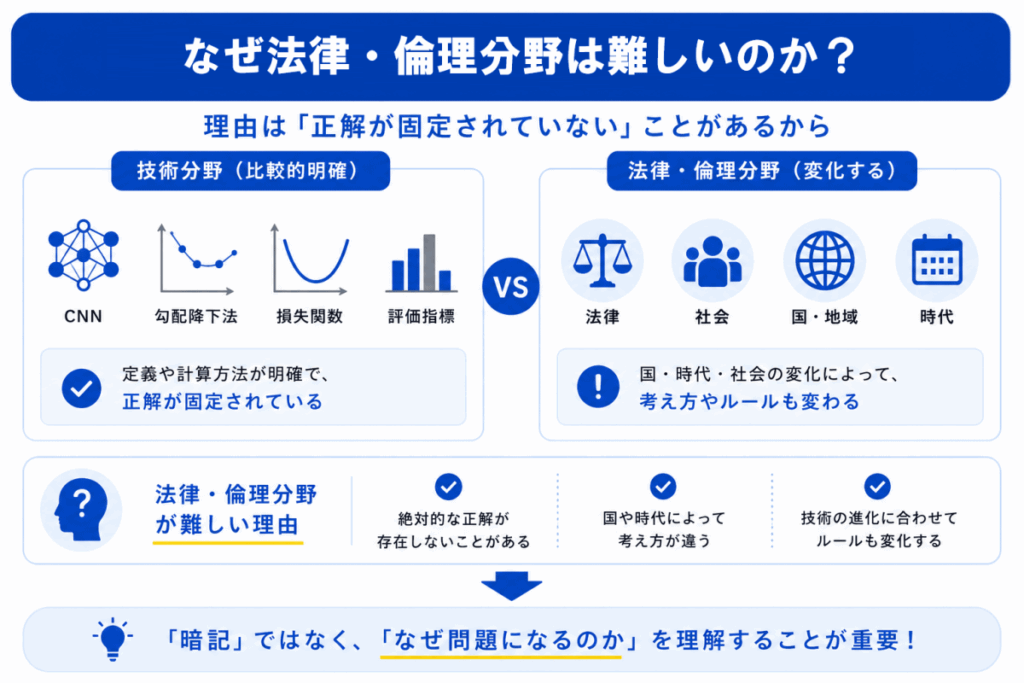

なぜ法律・倫理分野は難しいのか?

理由は「正解が固定されていない」ことがあるからです。

技術分野は

- CNN

- SGD

- 学習率

など比較的定義が明確です。

しかし、法律・倫理は

- 時代

- 国

- 社会

- 技術進化

によって変わります。

つまり「社会と一緒に変化する分野」なのです。

G検定ではどう問われる?

G検定では「法律名の丸暗記」だけでは厳しいです。

重要なのは「なぜ問題になっているか」を理解すること。

例えば

- なぜ著作権が議論になる?

- なぜ説明可能性が重要?

- なぜAIの偏りが危険?

- なぜ個人情報保護が必要?

- なぜフェイク画像が問題?

- なぜAIの誤情報が危険?

- なぜ国ごとに考え方が違う?

- なぜ「安全性」が重要視される?

などです。

つまり「AIが社会に与える影響」を理解することが重要になります。

法律・倫理分野は「AI技術そのもの」ではなく「AIを社会でどう安全に使うか」を問う分野です。

なぜ混同しやすいのか?

AIの学習をはじめたばかりの人が混同しやすい理由は「技術」と「ルール」が混ざる からです。

まとめると下記の表になります。

- 技術 : CNN・Transformer・SGD

- ルール : 著作権・個人情報・AI倫理

つまり「AIを作る話」と「AIを安全に使う話」は別カテゴリです。

ここを分けて理解すると整理しやすくなります。

どう考えればいい?

おすすめは「AIは強力だからルールが必要」と考えることです。

これは自動車に近いです。

車は便利ですが

- 交通ルール

- 免許

- 安全基準

があります。

AIも同じです。

性能が高くなるほど「安全に使うための考え方」が重要になります。

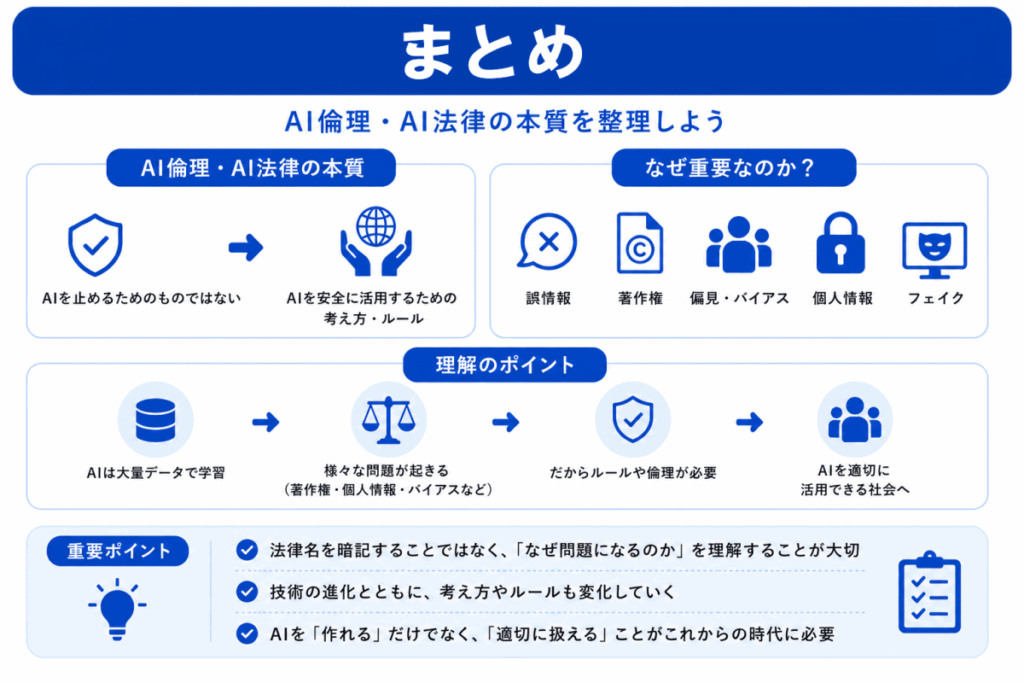

まとめ

AI倫理・AI法律は「AIを止めるためのもの」ではありません

本質は「AIを安全に活用するための考え方」です。

現在のAIは非常に高性能です。

しかし

- 誤情報

- 著作権

- 偏見

- 個人情報

- フェイク

など、社会への影響も大きくなっています。

そのため現在は「AIを作れる」だけでなく「AIを適切に扱える」ことも重要になっています。

G検定でも

- 技術

- 社会実装

- 法律

- 倫理

をまとめて理解する方向へ進んでいます。

重要なのは「法律名を暗記すること」ではなく「なぜ問題になるのか」を理解することです。

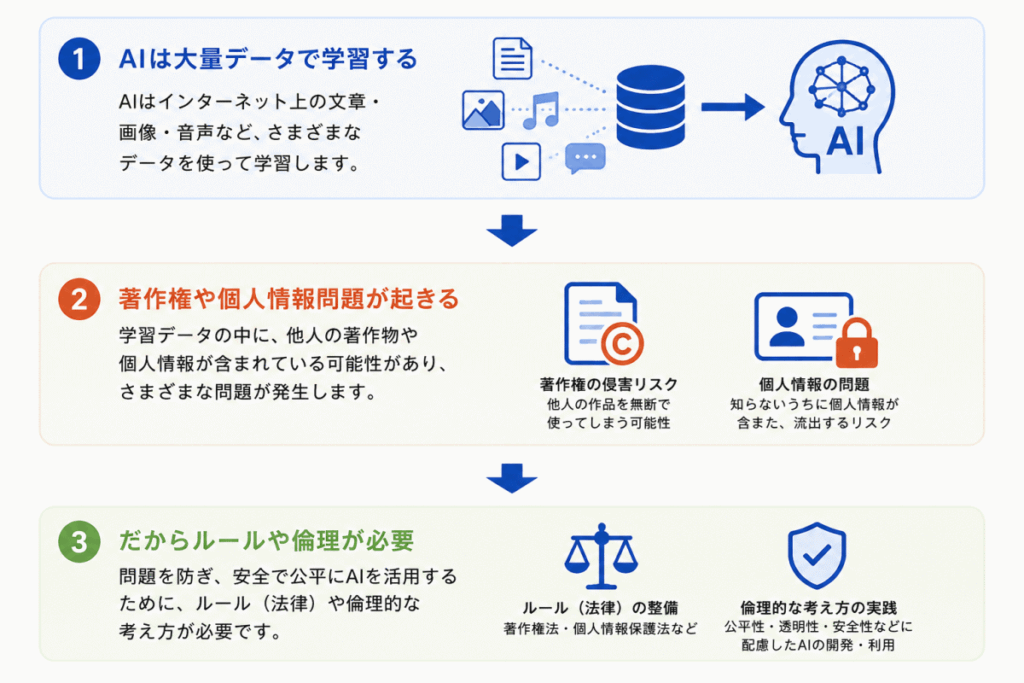

例えば

- AIは大量データで学習する

↓ - 著作権や個人情報問題が起きる

↓ - だからルールや倫理が必要

という流れです。

つまり法律・倫理分野も「単語暗記」ではなく「AIが社会に与える影響」という「構造」で理解することが重要です。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

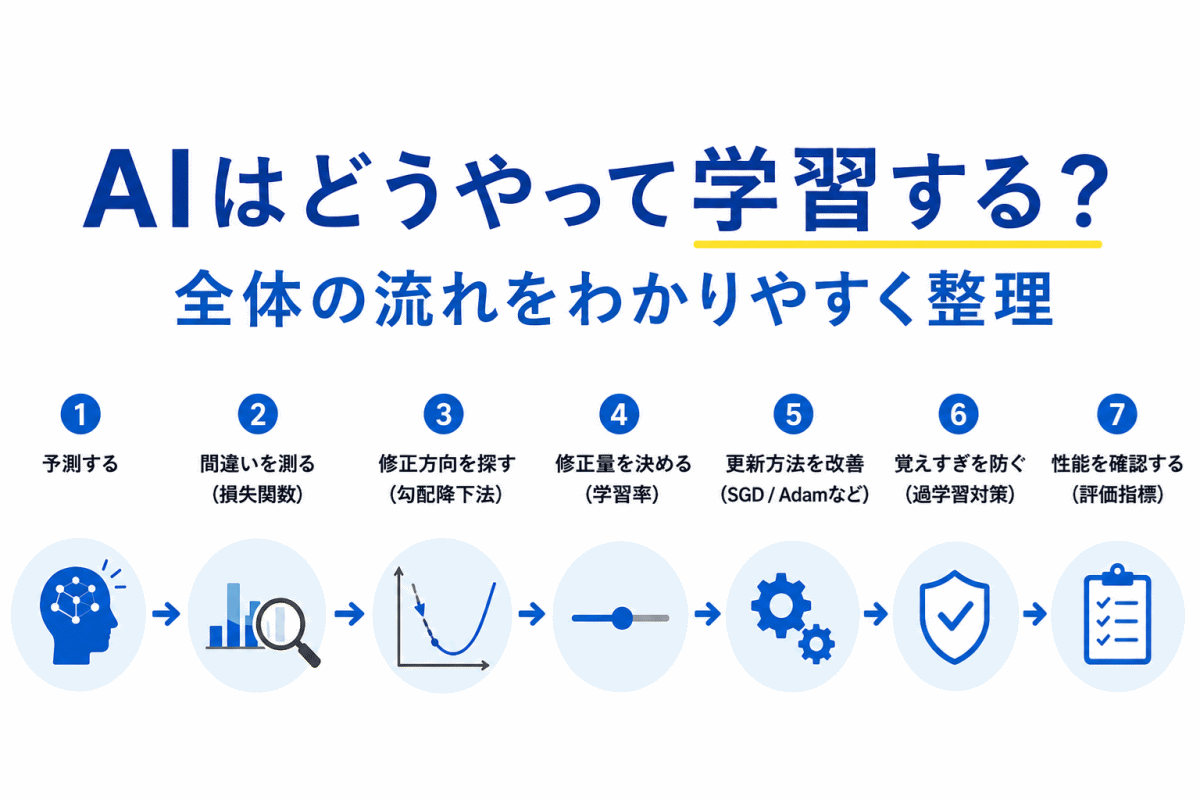

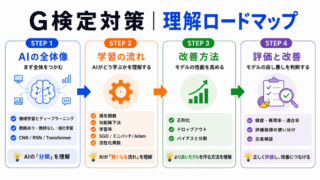

AIの学習の流れを整理しました。

G検定の概要を理解しやすい流れで確認できるように整理しました。

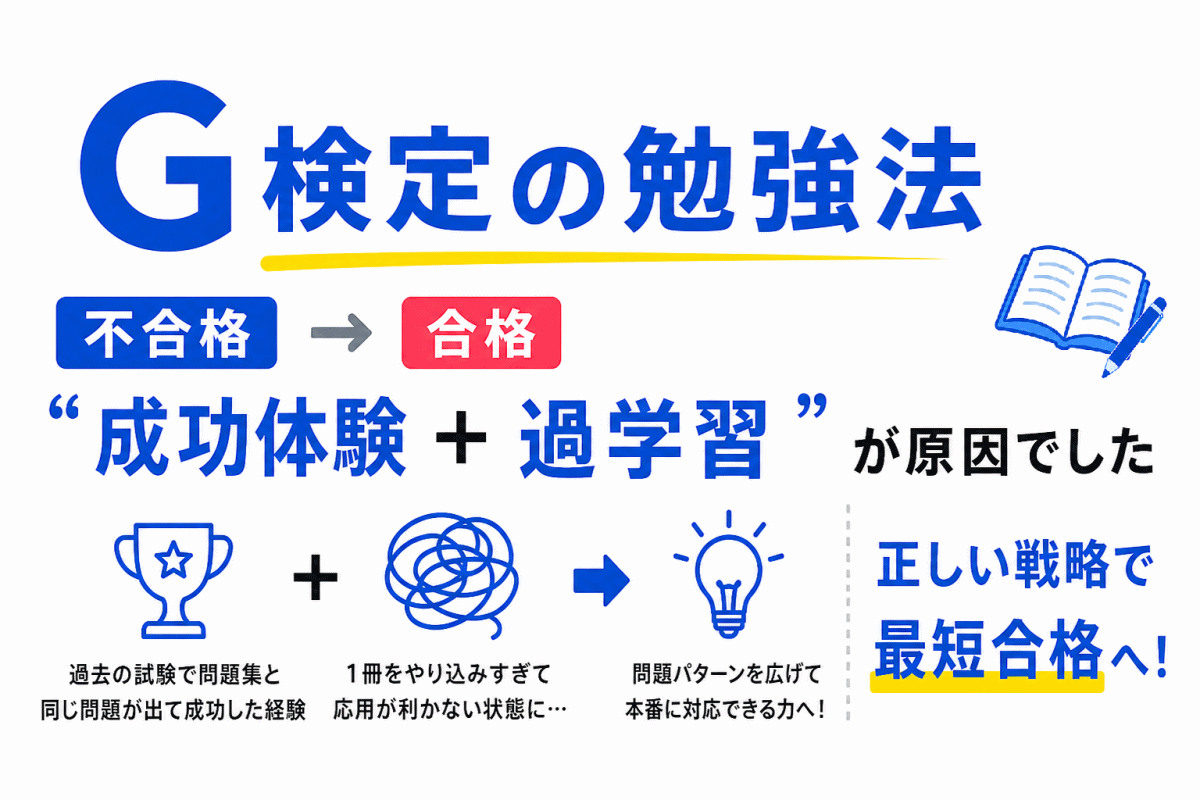

不合格体験記です。私のような失敗をしないように確認しましょう。