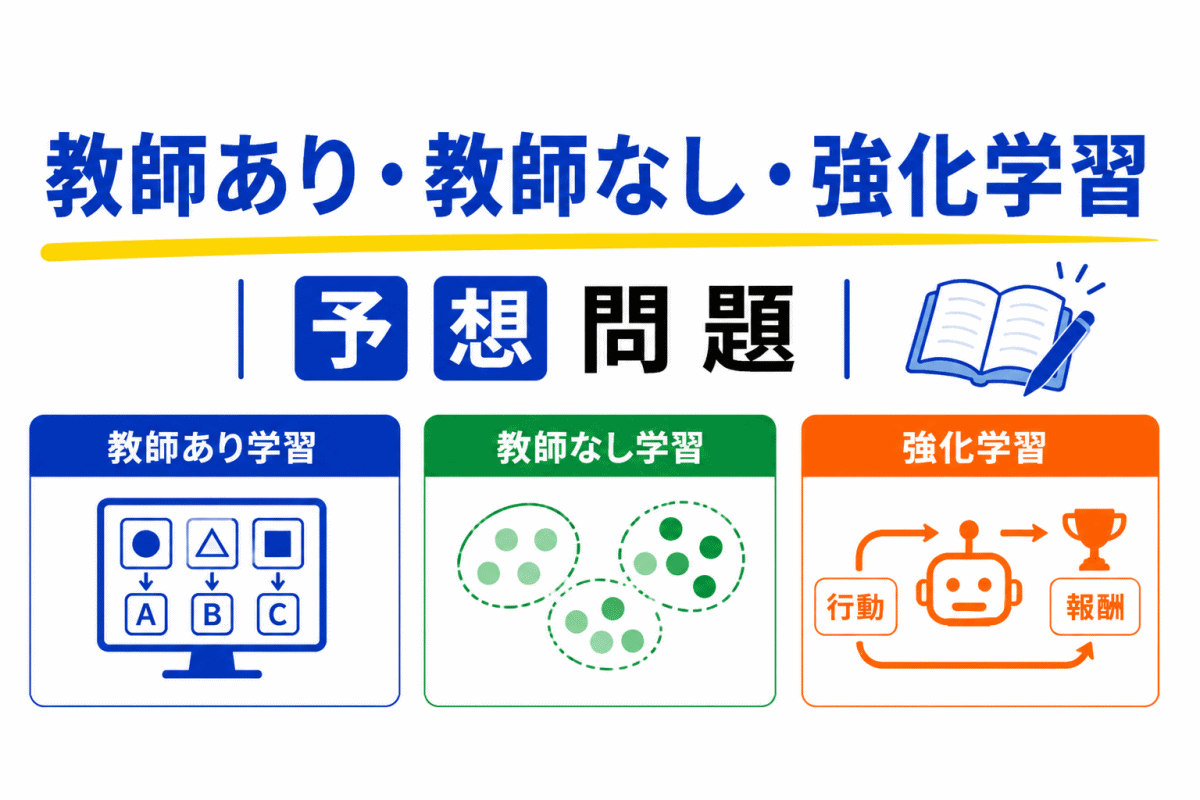

【G検定|理解型予想問題】損失関数・勾配降下法・学習率

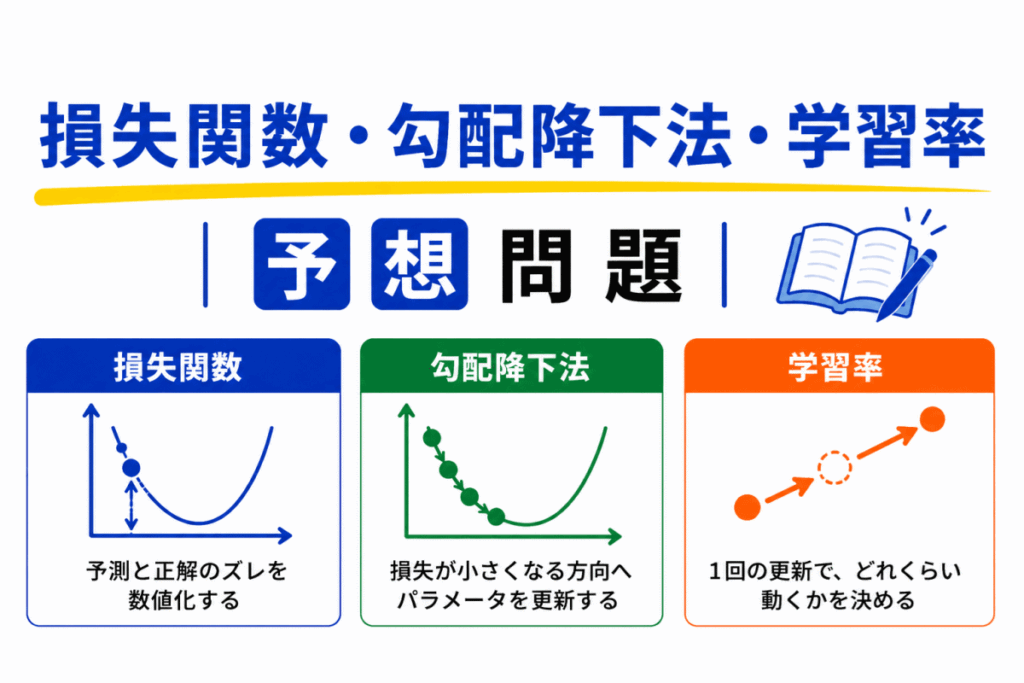

G検定では「損失関数」、「勾配降下法」、「学習率」は重要項目ですが、単語だけ覚えると混同しやすいテーマでもあります。

「損失を減らす」、「勾配で更新する」と聞いても「何をしているのか」がつながらないまま問題を解いてしまうケースも少なくありません。

この記事では、理解型予想問題を通して

- なぜ損失関数を小さくするのか?

- 勾配降下法は何をしているのか?

- なぜ学習率が必要なのか?

を「AIがどう学習するのか」という流れで整理します。

「見たことあるのに解けない」を防ぐために、単語暗記ではなく「意味理解」を重視して整理していきましょう。

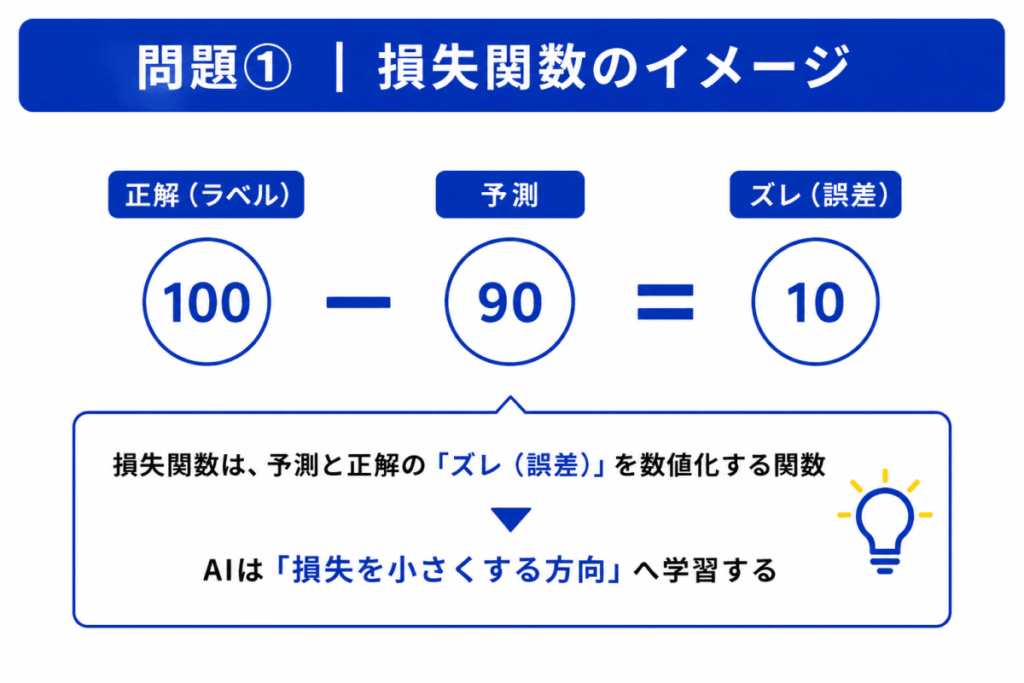

問題①

損失関数(Loss Function)の説明として最も適切なものはどれか?

- A. モデルの複雑さを増やす関数

- B. 予測と正解のズレを数値化する関数

- C. 学習データ数を増やす関数

- D. ニューラルネットワークの層数を決める関数

- 正解・解説(クリックで開きます)

-

正解

B

解説

損失関数は「予測と正解がどれくらいズレているか」を数値化するものです。

例えば

- 正解:100

- 予測:90

なら「10のズレ(誤差)」があります。

AIは「損失を小さくする方向」へ学習していきます。

つまり損失関数は AIの「間違い量」を表す重要な指標です。

補足(理解ポイント)

AIの学習を始めたばかりの人は「精度」と混同しやすいです。

違いは

- 損失関数

→ 学習中のズレを見る - 精度

→ 結果の正しさを見る

です。

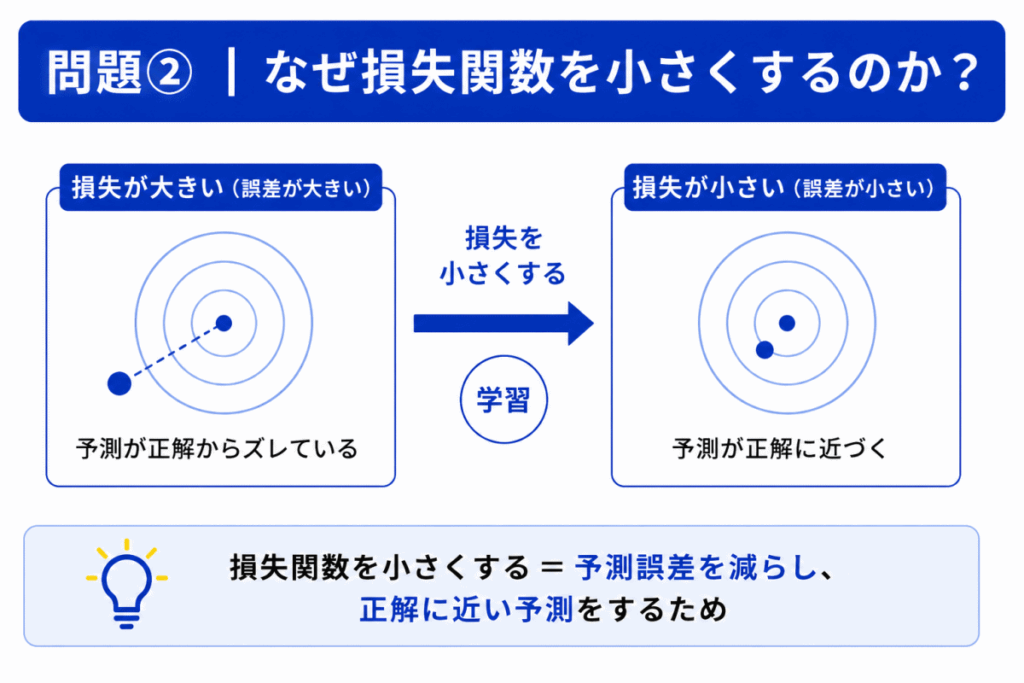

問題②

AI学習で損失関数を小さくしようとする理由として最も適切なものはどれか?

- A. モデルを軽量化するため

- B. 予測誤差を減らすため

- C. データ数を削減するため

- D. 学習時間を固定するため

- 正解・解説(クリックで開きます)

-

正解

B

解説

損失関数は「予測ミスの大きさ」を表しています。

つまり

- 損失が大きい

→ 予測がズレている - 損失が小さい

→ 正解に近い

ということです。

そのためAIは「損失を小さくする」ことで「より正解に近い予測」を目指します。

補足(超重要)

ここを理解すると

- 勾配降下法

- 学習率

- SGD

- Adam

などが「全部つながる」ようになります。

なぜなら「損失をどう減らすか?」がAI学習の核心だからです。

- 損失が大きい

問題③

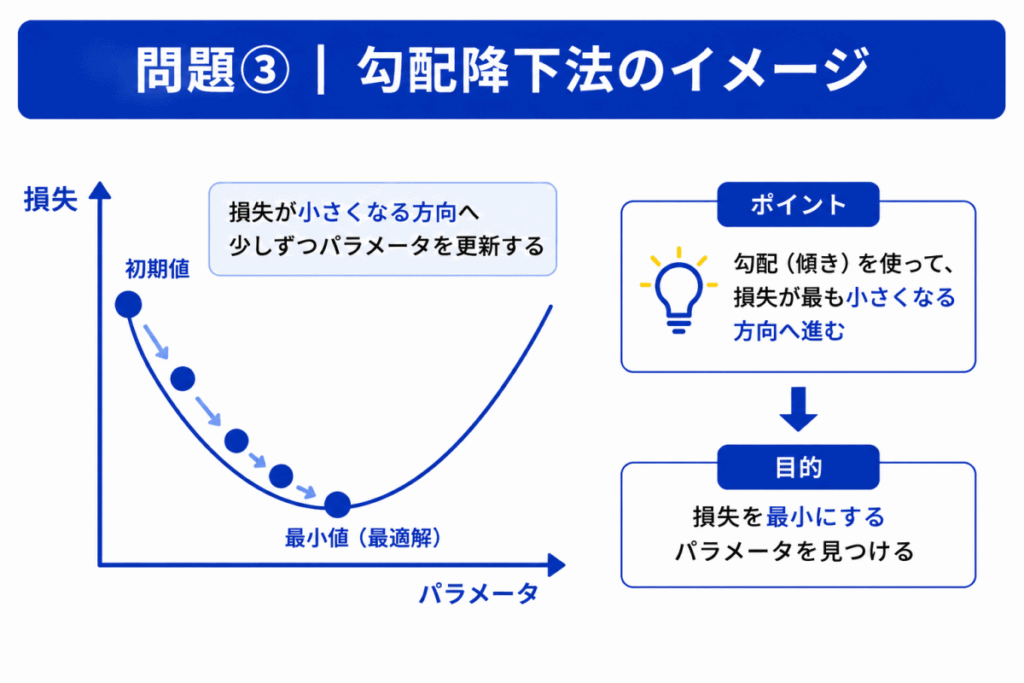

勾配降下法(Gradient Descent)の説明として最も適切なものはどれか?

- A. データを自動生成する手法

- B. 損失を小さくする方向へパラメータを更新する手法

- C. モデルをランダム化する手法

- D. ニューラルネットワークを削除する手法

- 正解・解説(クリックで開きます)

-

正解

B

解説

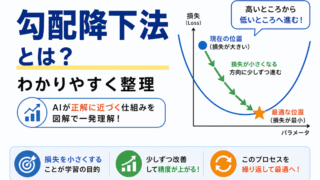

勾配降下法は「損失を小さくする方向」へ進む方法です。

AIは最初「どのパラメータが正しいか」わかっていません。

そこで少しずつ調整しながら、損失が小さくなる方向を探します。イメージ

よく「山を下るイメージ」で説明されます。

- 高い場所

→ 損失が大きい - 低い場所

→ 損失が小さい

として 一番低い場所(最小値)を目指します。

補足

ここでいう「勾配」は「どちらへ進めば損失が減るか」を示しています。

- 高い場所

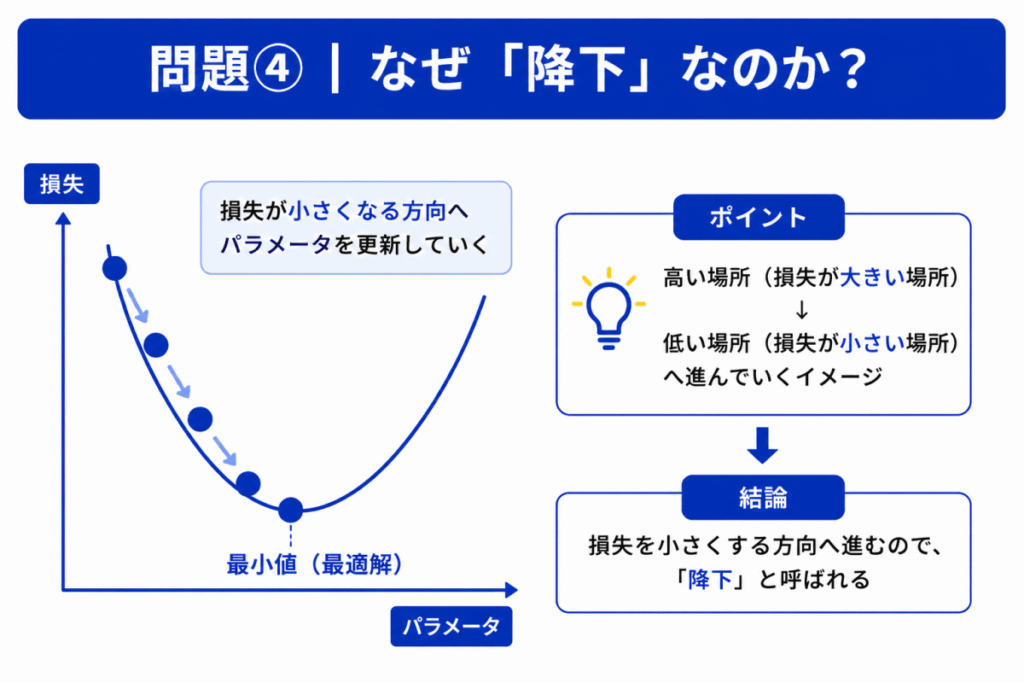

問題④

勾配降下法で「降下」という言葉が使われる理由として最も適切なものはどれか?

- A. データ量を減らすため

- B. 損失が小さい方向へ進むため

- C. 層数を減らすため

- D. 精度を固定するため

- 正解・解説(クリックで開きます)

-

正解

B

解説

勾配降下法では「損失が小さい場所」を目指します。

イメージとしては「坂を下る」感覚に近いです。

イメージ整理

- 高い場所

→ 損失が大きい - 低い場所

→ 損失が小さい

つまりAIは「より低い場所」へ進み続けます。

そのため「降下法」と呼ばれます。補足

初心者は「勾配」と「降下」を別々に覚えがちです。

しかし重要なのは「損失を減らす方向へ進む」という流れで理解することです。

- 高い場所

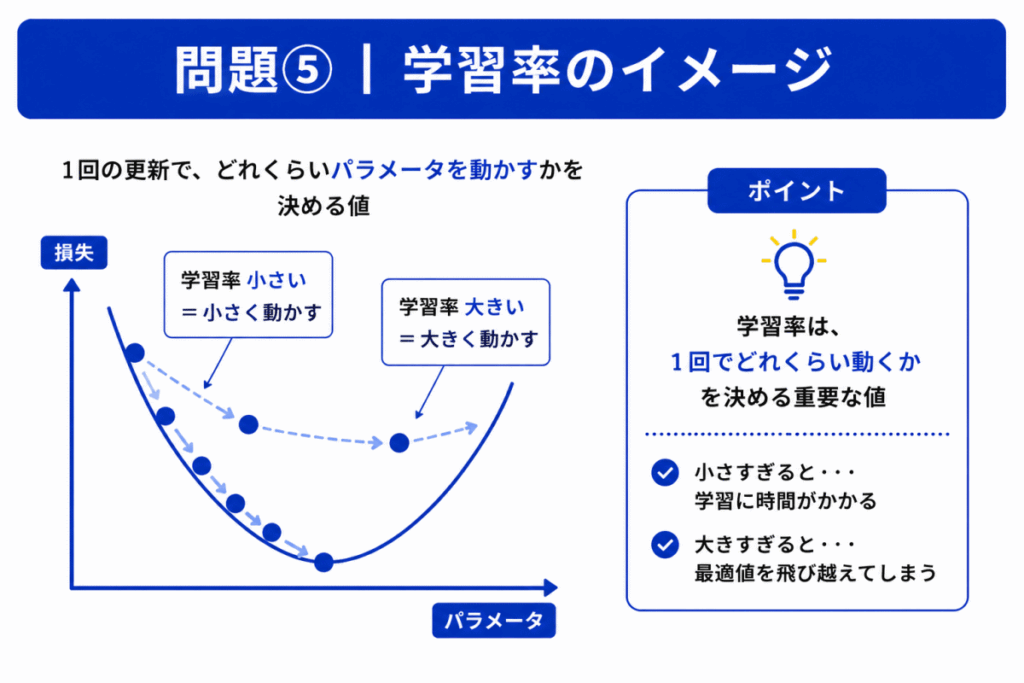

問題⑤

学習率(Learning Rate)の説明として最も適切なものはどれか?

- A. 1回でどれくらいパラメータを更新するかを決める値

- B. データ数を増やす割合

- C. ニューラルネットワークの層数

- D. 精度そのもの

- 正解・解説(クリックで開きます)

-

正解

A

解説

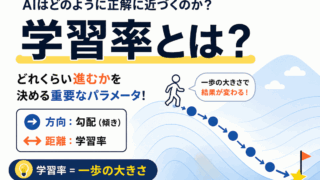

学習率は「1回でどれくらい動くか」を決める値です。

勾配降下法では 少しずつパラメータを更新 して学習します。そのとき

- 小さく動くのか

- 大きく動くのか

を決めるのが学習率です。

イメージ

- 学習率が小さい

→ 少しずつ進む - 学習率が大きい

→ 一気に進む

という違いがあります。

補足

AIの学習を始めたばかりの人は「学習率が高い=性能が高い」と思いがちですが違います。

学習率は「移動量」を決める値です。

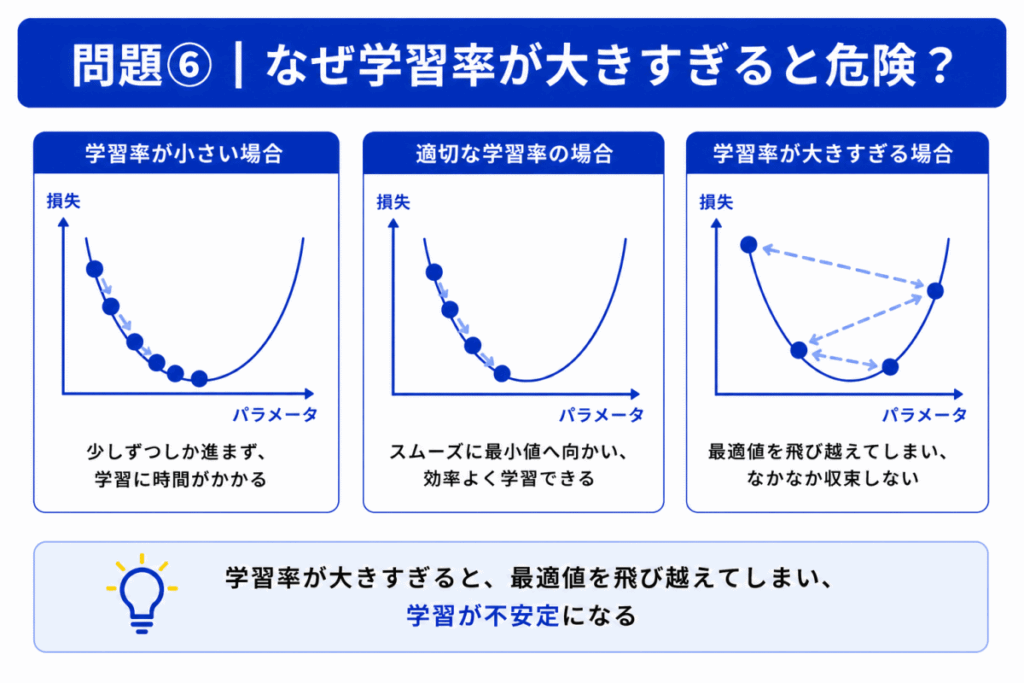

問題⑥

学習率が大きすぎる場合に起きやすいこととして最も適切なものはどれか?

- A. 損失が安定して減少する

- B. 最適値を飛び越えて学習が不安定になる

- C. データ数が自動増加する

- D. 必ず過学習が解消される

- 正解・解説(クリックで開きます)

-

正解

B

解説

学習率が大きすぎると「動きすぎる」状態になります。

すると 最適な場所を飛び越える ことがあります。

イメージ

本来は 少しずつ最小値へ近づく のが理想です。

しかし、学習率が大きすぎると

- 行き過ぎる

- 戻りすぎる

- また飛び越える

を繰り返し 学習が不安定 になります。

補足

逆に

- 小さすぎる

→ 学習が遅い

という問題もあります。

そのため「適切な学習率」が重要になります。

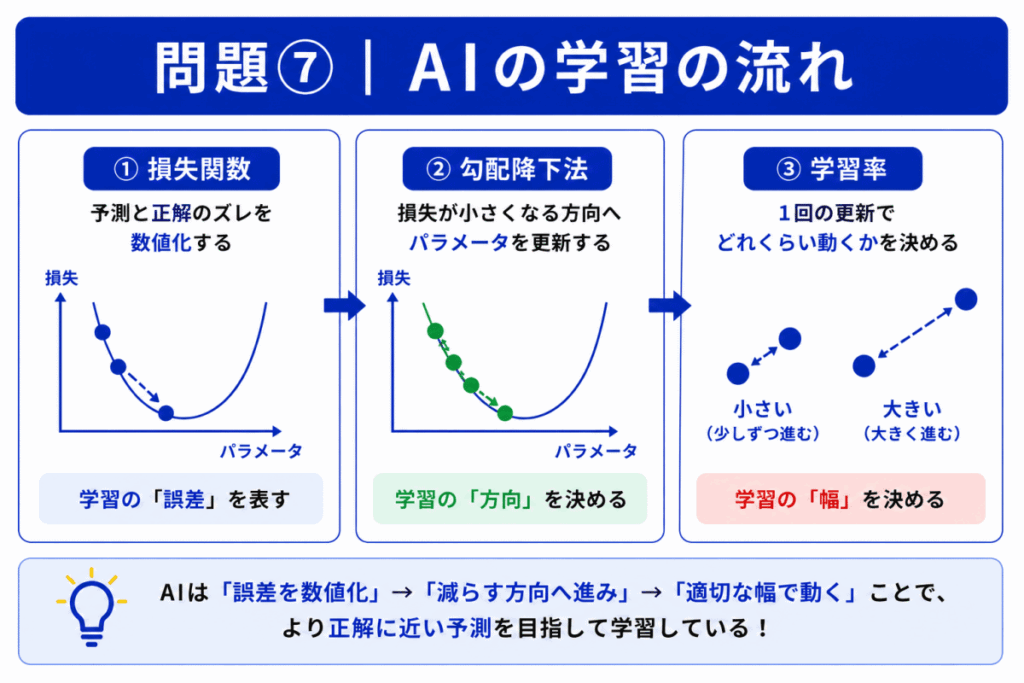

問題⑦

損失関数・勾配降下法・学習率の関係として最も適切なものはどれか?

- A. 学習率で損失を計算し、勾配降下法でデータ数を増やす

- B. 損失関数で誤差を求め、勾配降下法で損失を減らす方向へ更新し、学習率で更新量を調整する

- C. 勾配降下法でニューラルネットワークを削除し、学習率で層数を増やす

- D. 損失関数で画像生成を行い、学習率で精度を固定する

- 正解・解説(クリックで開きます)

-

正解

B

解説

AI学習では「予測と正解のズレ」を小さくすることが重要です。

そこで使われるのが- 損失関数

- 勾配降下法

- 学習率

です。

① 損失関数

損失関数は「どれくらい間違えているか」を数値化します。

つまり AIの誤差 を表しています。② 勾配降下法

勾配降下法は「損失が小さくなる方向」へパラメータを更新する方法です。

イメージとしては「坂を下る」感覚に近いです。③ 学習率

学習率は「1回でどれくらい動くか」を決める値です。

- 大きすぎる

→ 飛び越える - 小さすぎる

→ 学習が遅い

という問題があります。

重要整理

つまりAIは「損失を小さくする方向へ、適切な幅で進む」ことで学習しています。

補足

G検定では「単語単体」ではなく「それぞれが何を担当しているか」を整理すると理解しやすくなります。

今回の関係をまとめると

- 損失関数

→ 誤差を数値化 - 勾配降下法

→ 損失を減らす方向へ更新 - 学習率

→ 更新量を調整

です。

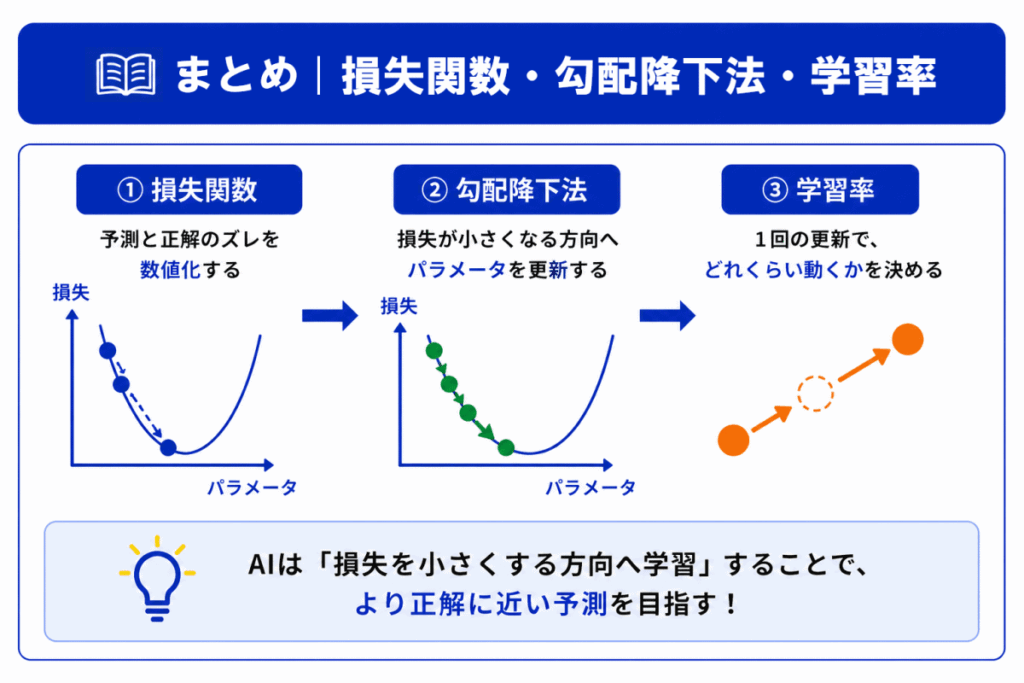

まとめ

損失関数・勾配降下法・学習率は、AIが「どうやって学習するのか」を理解する上で非常に重要なテーマです。

特にG検定では

- 損失を小さくする

- 勾配を使って更新する

- 学習率で調整する

といった言葉が頻繁に登場します。

しかし、単語だけを暗記すると「見たことあるのに解けない」状態になりやすい分野でもあります。

重要なのは「AIは予測のズレ(損失)を減らす方向へ学習する」という流れを線で理解することです。

今回の内容を整理すると

- 損失関数

→ 予測と正解のズレを数値化する - 勾配降下法

→ 損失が小さくなる方向へ進む - 学習率

→ 1回でどれくらい動くかを決める

という関係になります。

このつながりを理解できると

- SGD

- ミニバッチ

- Adam

などの最適化手法も理解しやすくなります。

G検定では「単語暗記」よりも「何を改善しようとしているのか?」を理解すると、問い方が変わっても対応しやすくなります。

関連記事・おすすめ記事

この予想問題よりも損失関数・勾配降下法・学習率を詳しく整理しています。

もっと詳しく学習したい方はご覧ください。

不合格体験記です。私のような失敗をしないように確認しましょう。