【G検定対策】Adamとは?わかりやすく整理

AdamはAIの学習を効率よく進めるために広く使われている最適化手法のひとつです。

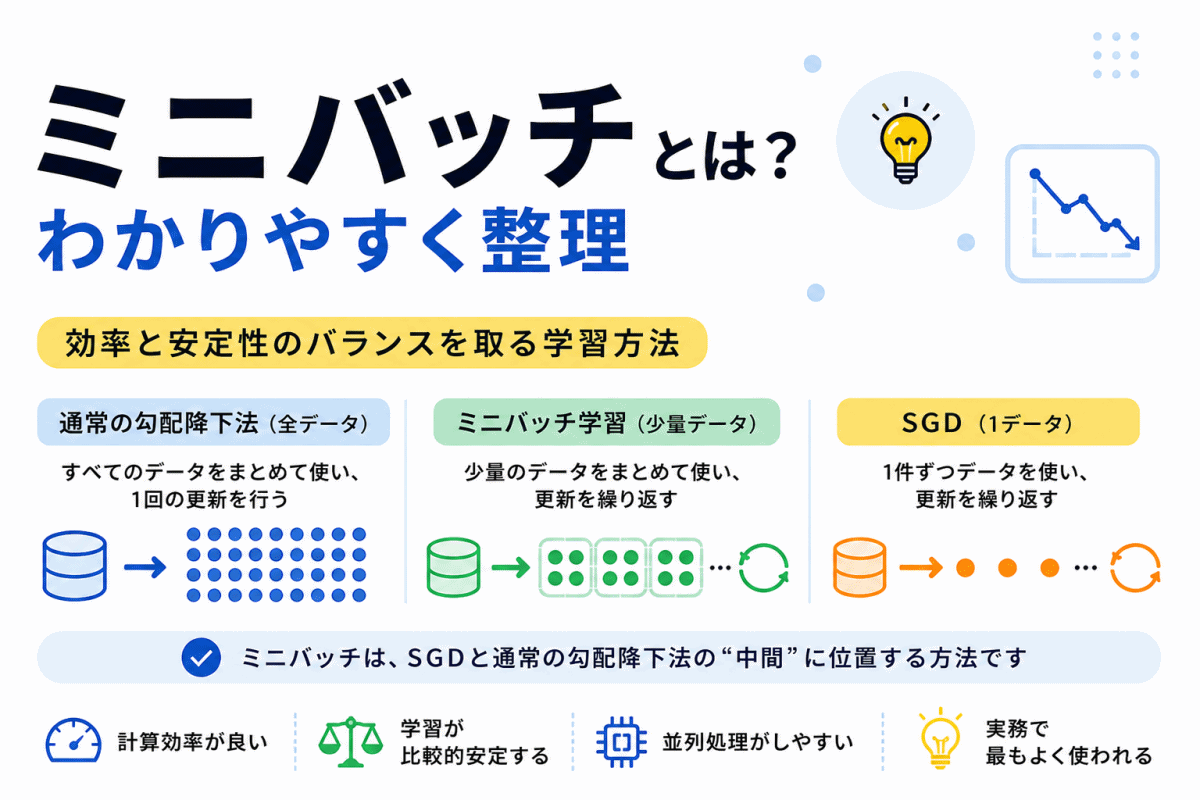

勾配降下法やSGD(確率的勾配降下法)の課題を改良し、学習率を自動で調整しながら安定かつ高速に学習を進められる のが特徴です。

この記事ではAdamの仕組みやメリット・デメリットを初心者向けにわかりやすく整理します。

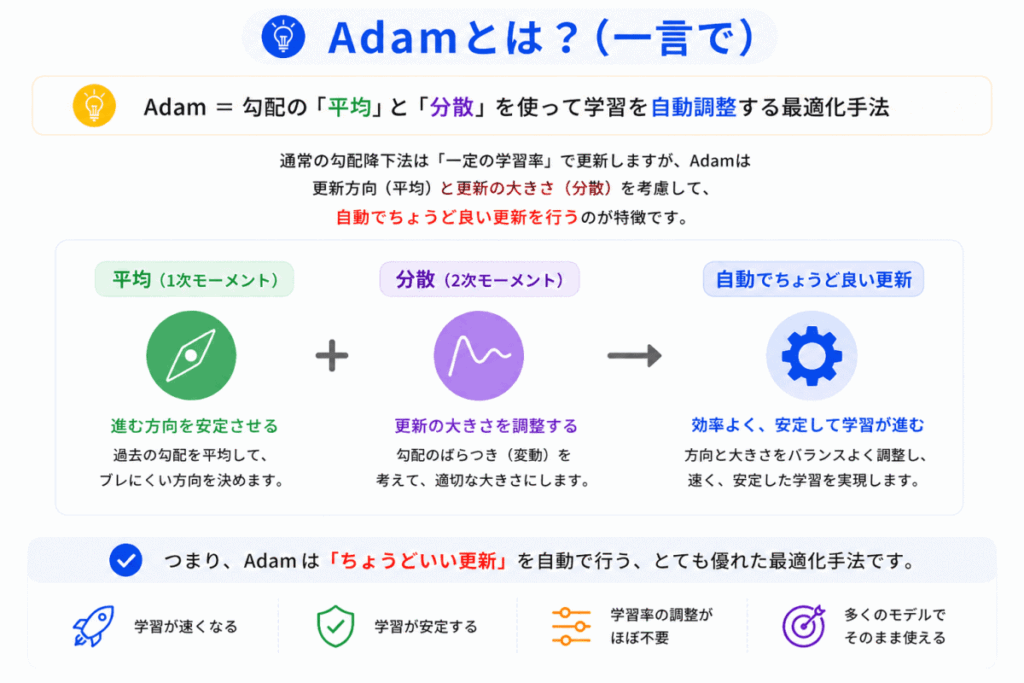

Adamとは?

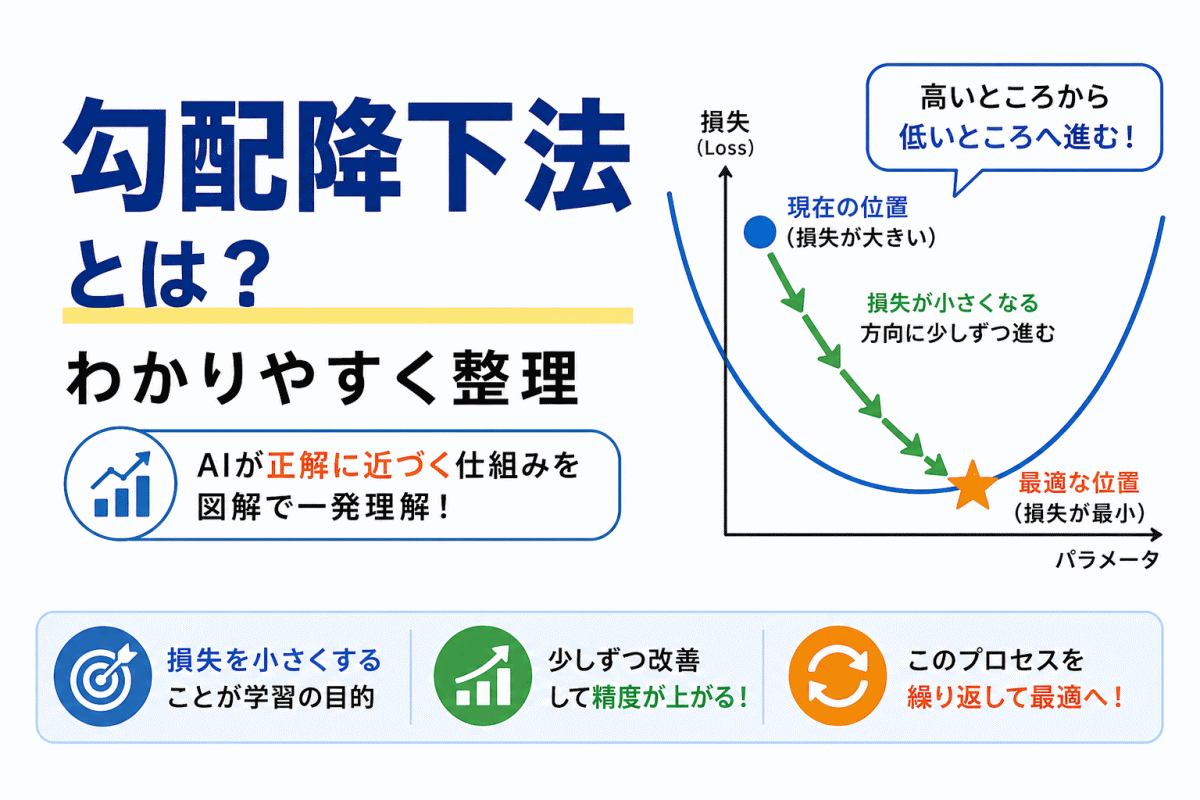

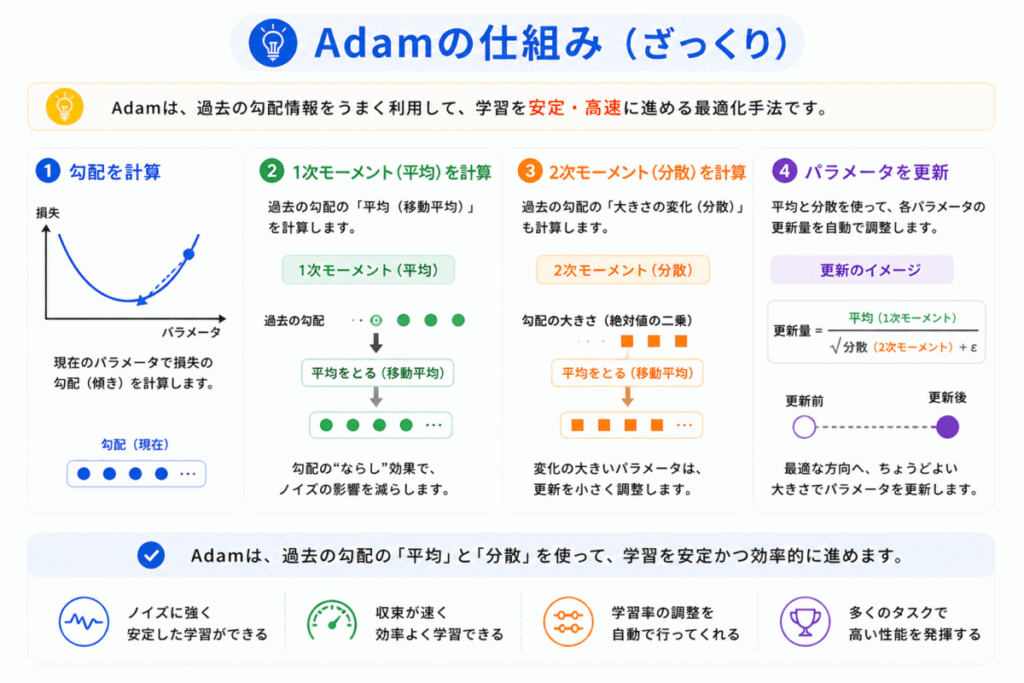

通常の勾配降下法は「一定の学習率」で更新しますが Adam は

■ 更新方向(平均)

■ 更新の大きさ(分散)

■ 更新方向(平均)

■ 更新の大きさ(分散)

を考慮して、自動でちょうど良い更新を行う のが特徴です。

「賢く調整しながら進む」学習方法です。

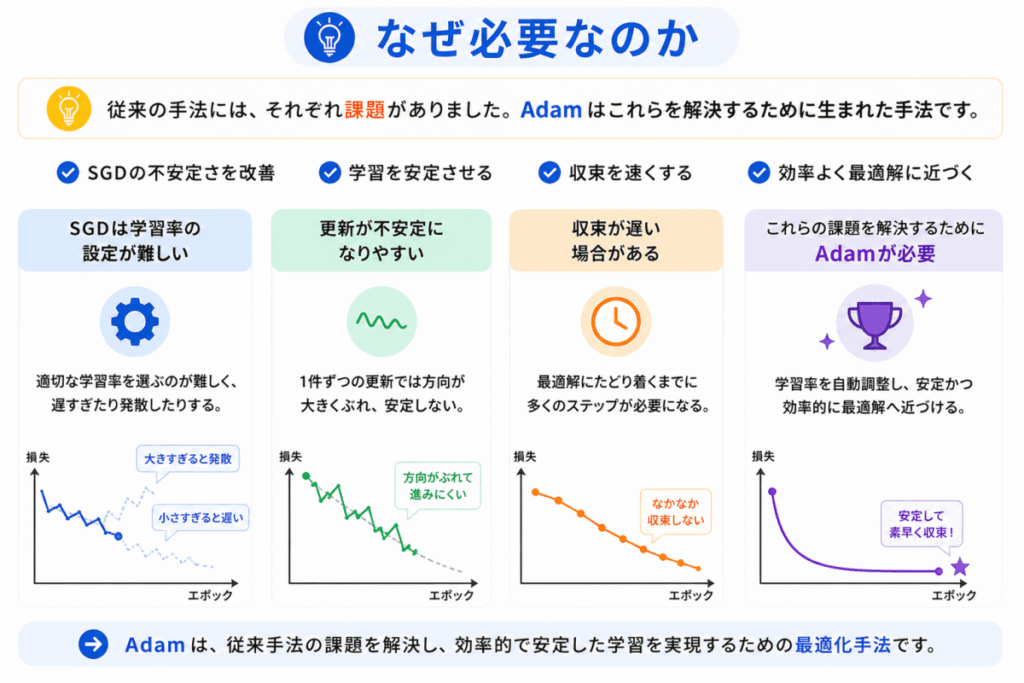

なぜ必要なのか

従来の手法(勾配降下法)では

■ 学習率が大きすぎる → 発散する

■ 学習率が小さすぎる → 学習が遅い

■ 学習率が大きすぎる → 発散する

■ 学習率が小さすぎる → 学習が遅い

という問題がありました。

つまり「学習率の調整が難しい」ということです。

最適な学習には「安定性」と「速さ」の両立が必要です。

そこで

■ 自動で調整してくれる

■ 安定して速く学習できる

■ 自動で調整してくれる

■ 安定して速く学習できる

Adam が考えられました。

Adamは 人が細かく調整しなくてもいい最適化手法 です。

Adamの仕組み

Adamは便利ですが

■ 常に最強ではない

■ 最終精度はSGDが勝つケースもある

■ 常に最強ではない

■ 最終精度はSGDが勝つケースもある

使い分け

最初 → Adam

最終調整 → SGD

最初 → Adam

最終調整 → SGD

このパターンはよく使われます。

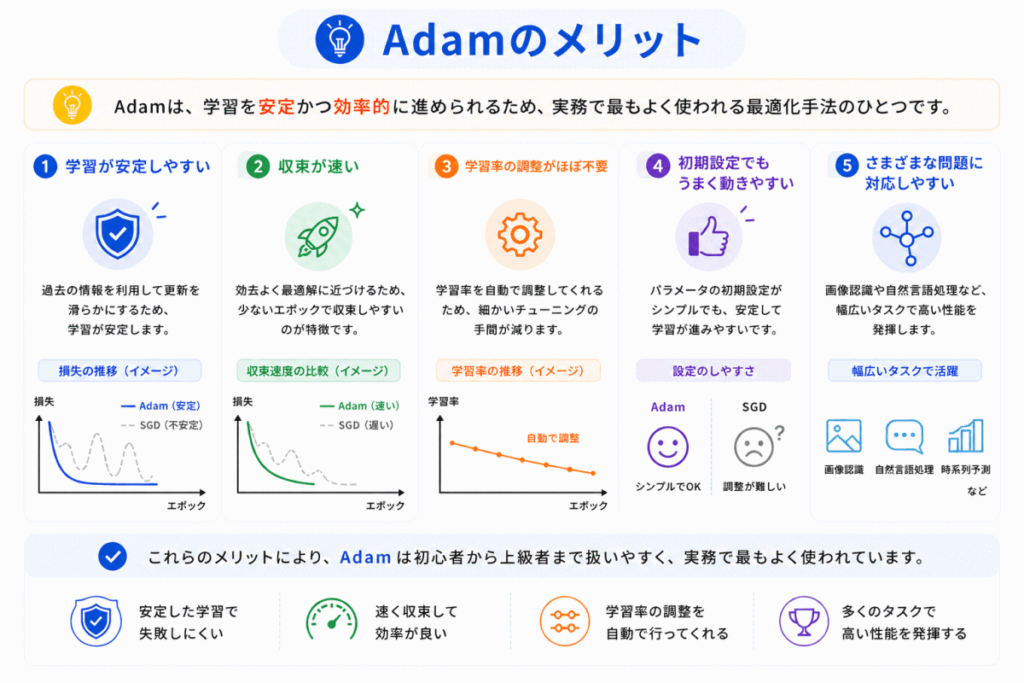

Adamのメリット

Adamのメリットとして下記があげられます。

- 学習が安定する

- 収束が速い(学習が速い)

- 学習率の調整がほぼ不要

- 初期設定でもうまく動きやすい

- 多くのモデルでそのまま使える

特に深層学習では

「とりあえずAdam」でもかなりうまくいく

「とりあえずAdam」でもかなりうまくいく

と言われるほど実用性が高いです。

これらの理由から…

- 初心者でも扱いやすい

- 実務でもよく使われる

と言われています。

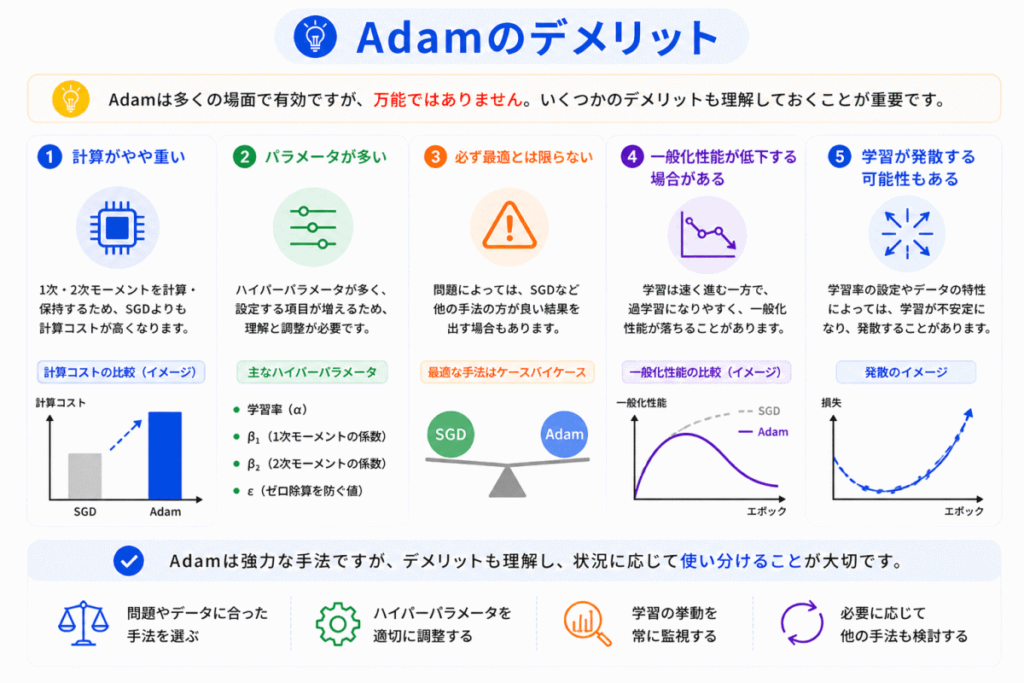

Adamのデメリット

Adamのデメリットとして下記があげられます。

- 計算がやや重い

- パラメータが多い

- 必ず最適とは限らない

- 一般化性能(汎化性能)のが低下する場合がある

- 学習が発散する可能性もある

「一般化性能(汎化性能)」とは、学習に使っていない未知のデータ(テストデータ)に対して、どれだけ正確に予測・分類できるかを示す能力のことです。

Adamは便利ですが

■ 常に最強ではない

■ 最終精度はSGDが勝つケースもある

■ 常に最強ではない

■ 最終精度はSGDが勝つケースもある

使い分け

■ 最初 → Adam

■ 最終調整 → SGD

■ 最初 → Adam

■ 最終調整 → SGD

このパターンはよく使われます。

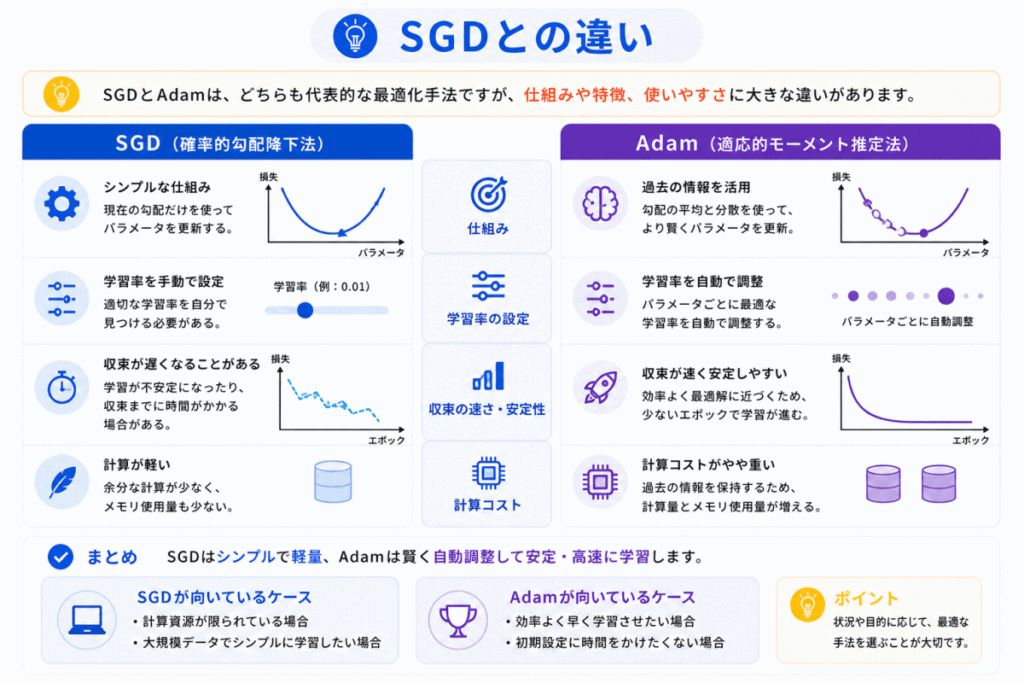

SGDとの違い

■ SGD → シンプルで軽いが不安定

■ SGD → シンプルで軽いが不安定

- 学習率は固定

- ノイズが多い

- 最終精度は高いこともある

■ Adam → 安定して速いが少し重い

■ Adam → 安定して速いが少し重い

- 学習率を自動調整

- ノイズに強い

- 収束が速い

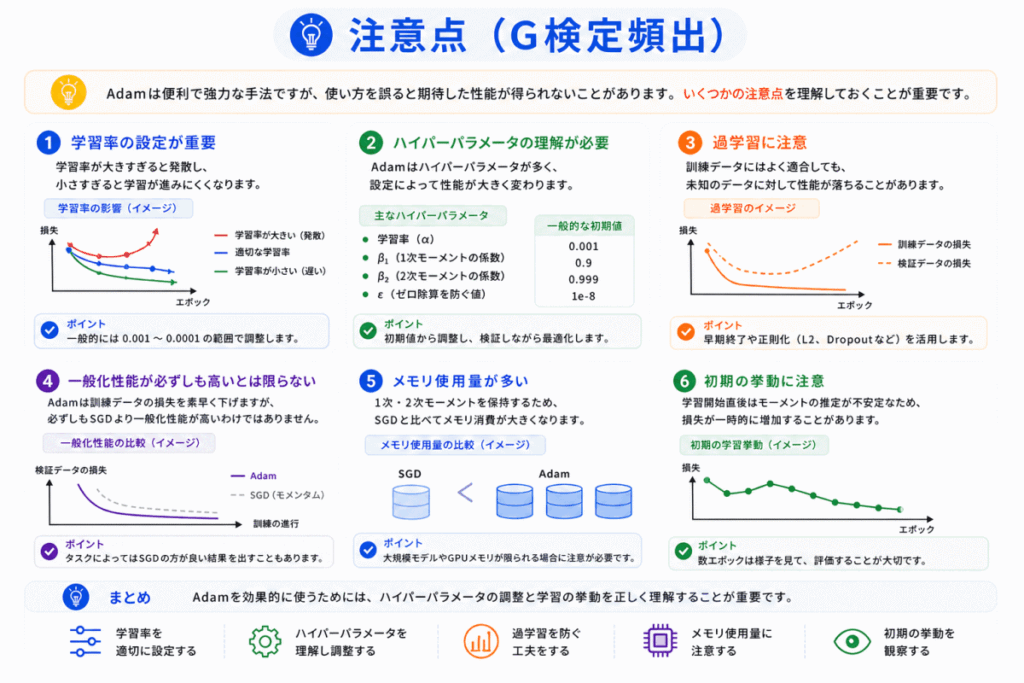

注意点(G検定頻出)

注意点(ポイント)として下記があります。

- 学習率の設定が重要

- ハイパーおあらめーたの理解が必要

- 過学習に注意

- 一般化性能が必ずしも高いとは限らない

- メモリ使用量多い

- 初期挙動に注意

特徴と違いをセットで理解する のが重要です。

G検定ではどう問われる?

「SGD(確率的勾配降下法)」との違いを理解しているかがポイントです。

- SGDとの違い

- 安定性や収束速度の比較

- どの手法が適切か

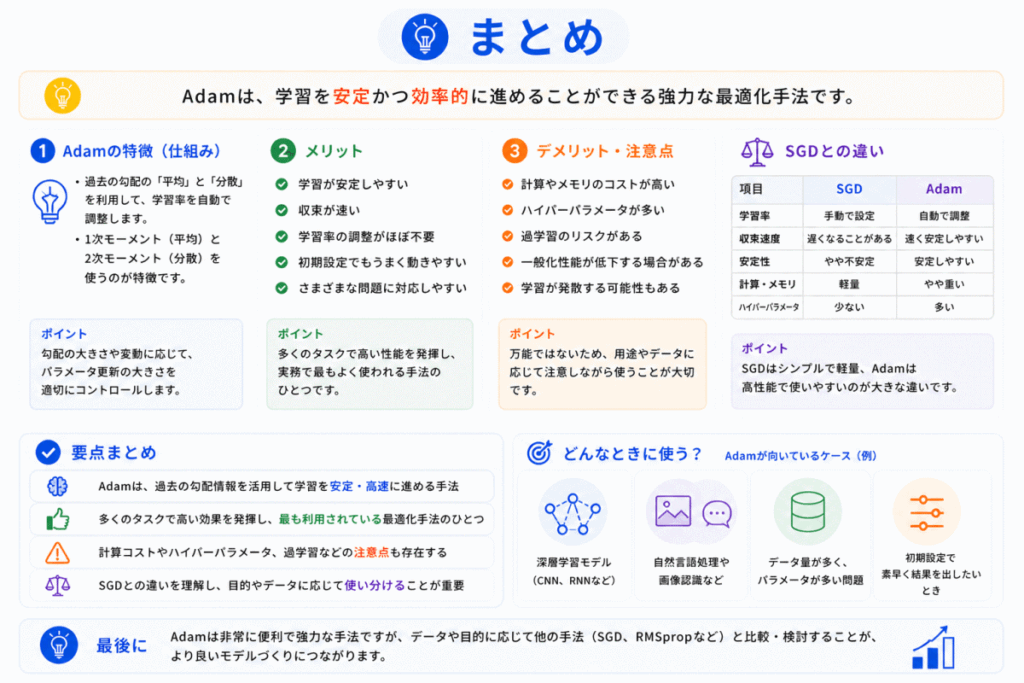

まとめ

Adamの特徴をまとめると下記になります。

- Adamは勾配降下法の改良版

- 安定性と収束速度に優れる

- 実務で最もよく使われる手法

※ ただし万能ではない

Adamは過去の勾配情報を活用して学習率を自動調整しながら、安定かつ高速に学習を進められる最適化手法です。

SGD(確率的勾配降下法)の弱点を補い、初心者でも扱いやすい点から実務でも広く使われています。

ただし計算コストや過学習のリスクもあるため、特徴を理解し状況に応じて使い分けることが重要です。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

学習率について整理しました。

勾配降下法について整理しました。

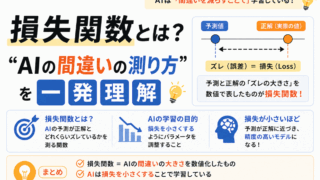

損失関数について整理しました。

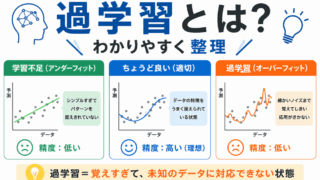

過学習について整理しました。

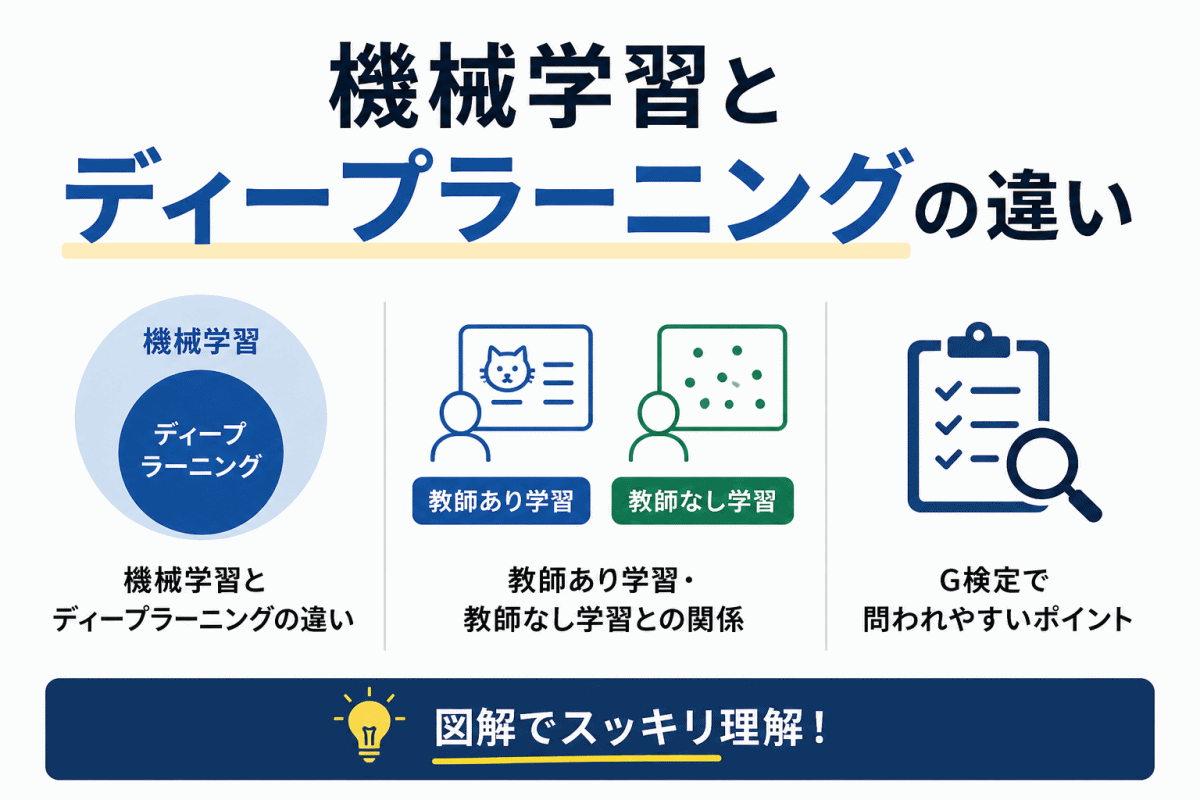

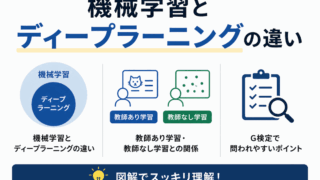

機械学習とディープラーニングの違いを整理しました。

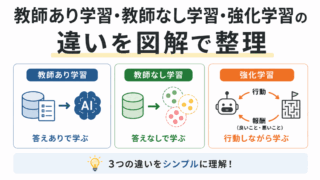

教師あり学習・教師なし学習・強化学習の違いを整理しました。

CNN・RNN・Transformerの違いを整理しました。

どの分野から出題されるか予想しました。

G検定 合格体験談です。2回目の受験で何とか合格できました。