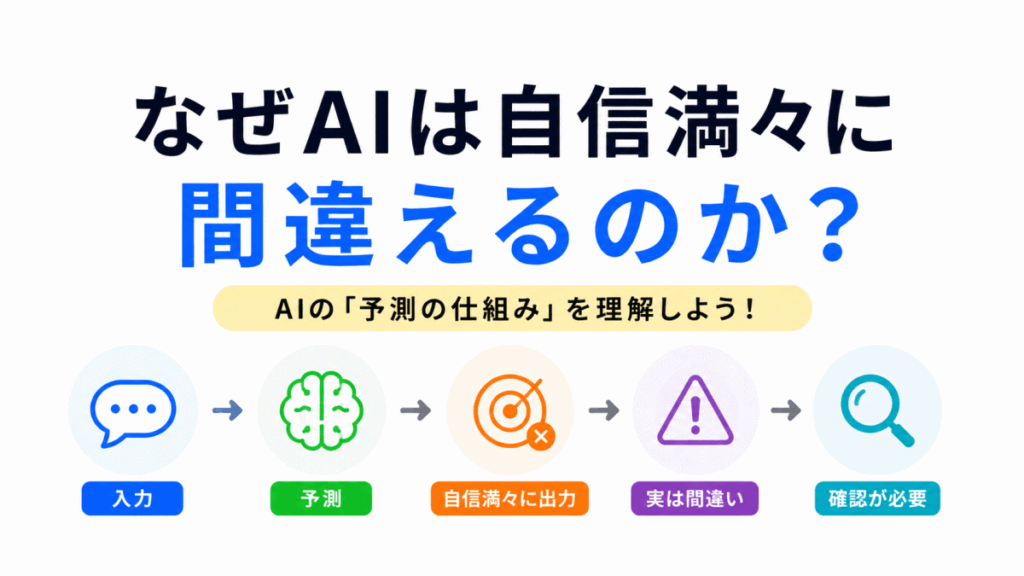

【G検定対策】なぜAIは自信満々に間違えるのか?ハルシネーションとは?

AIを使っていると

- それっぽい

- 自信ありそう

なのに、実は間違っている。

そんな経験をしたことはないでしょうか?

これは生成AI特有の重要な問題です。

しかも、厄介なのは AIは「間違っている自覚」がない という点です。

この記事では

- なぜAIは堂々と間違えるのか?

- AI内部では何が起きているのか?

- なぜ人間は騙されやすいのか?

- なぜ完全には防げないのか?

を「AI内部の流れ」から理解しておけば、試験で対応可能です。

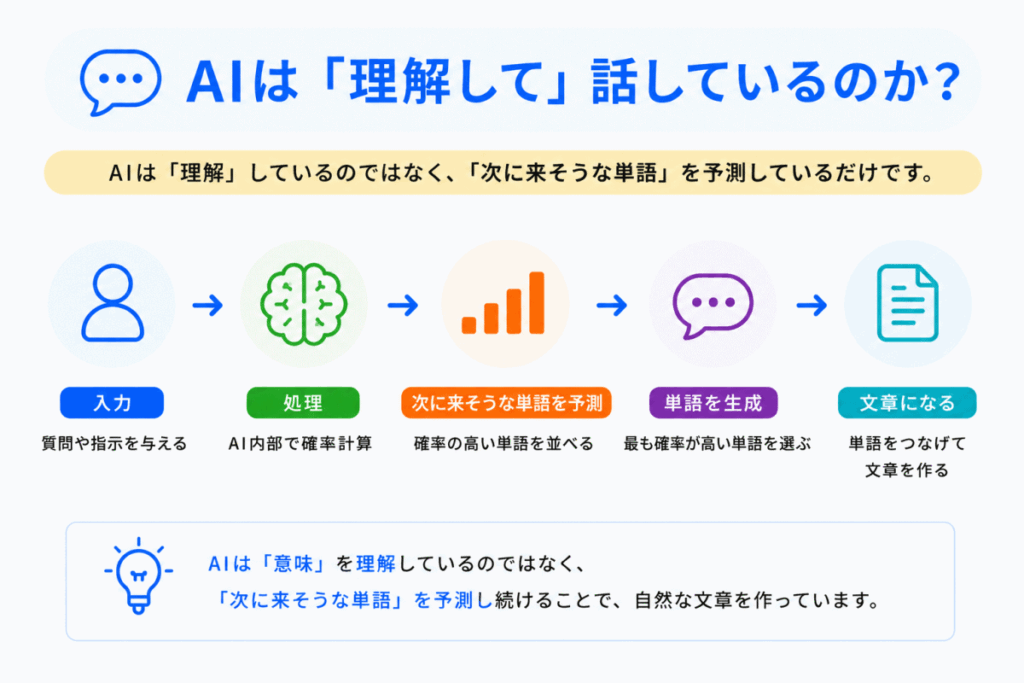

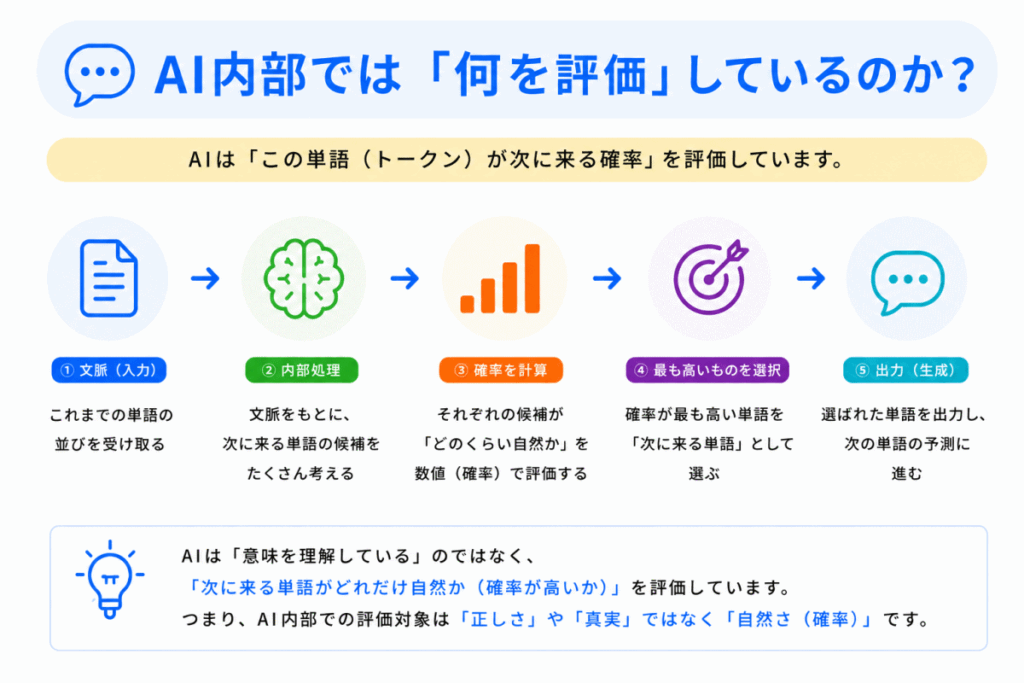

AIは「理解して」話しているのか?

まず最重要なのがここです。

多くの人は AIは意味を理解して会話している ように感じます。

しかし、実際には「次に来そうな単語」を予測しています。

つまりAI内部では

を高速で繰り返しています。

ここが 人間との大きな違い です。

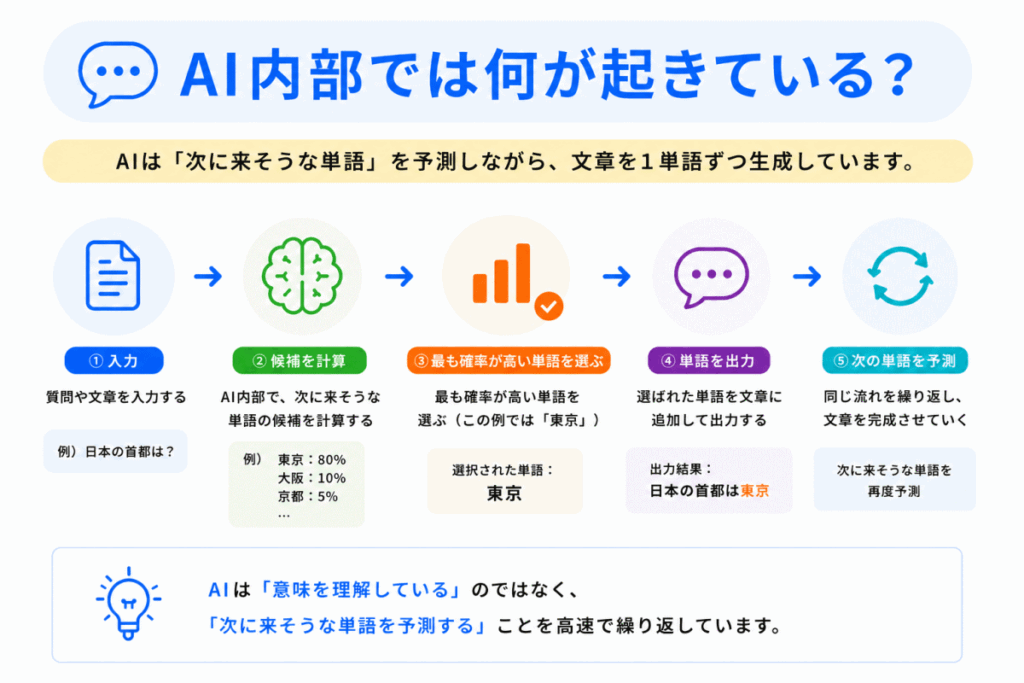

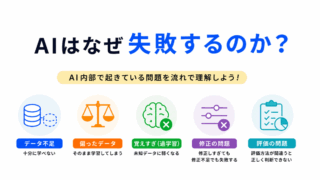

AI内部では何が起きている?

生成AI内部では「確率の高い単語」を選び続けています。

例えば

「日本の首都は?」

という入力に対して、AI内部では

- 東京

- 大阪

- 京都

などの候補が並び、最も可能性が高いものを選びます。

つまり「知っている」ではなく「予測している」のです。

ここが非常に重要です。

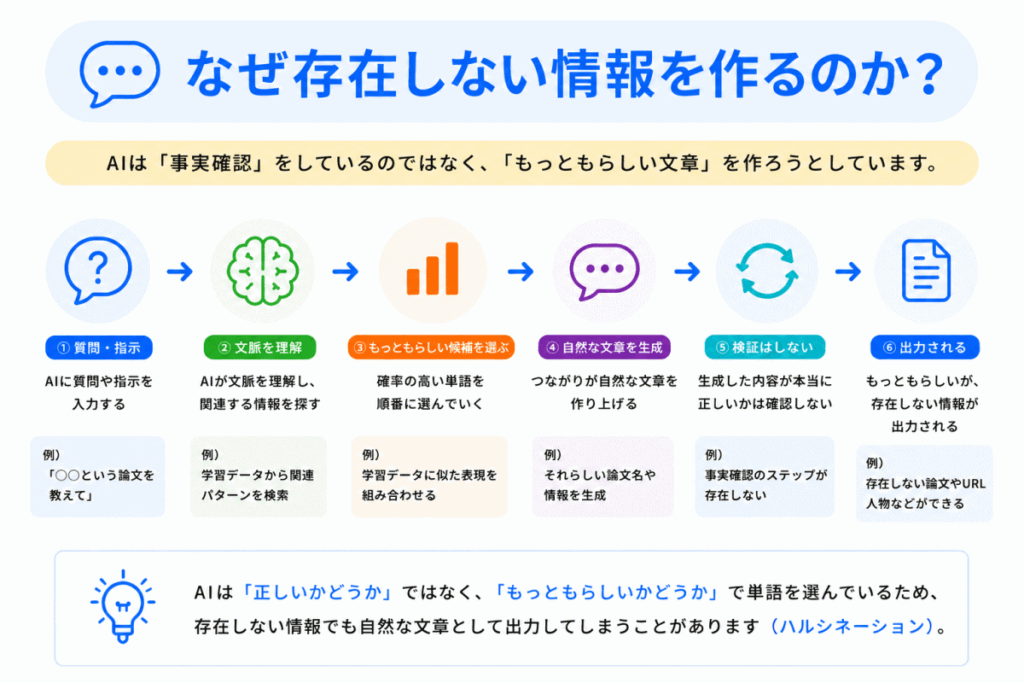

なぜ存在しない情報を作るのか?

AIは「もっともらしい文章」を作るのが得意です。

しかし「事実確認」をしているわけではありません。

そのため

- 存在しない論文

- 存在しないURL

- 存在しない人物

まで、自然に生成してしまうことがあります。

これは ハルシネーション と呼ばれます。

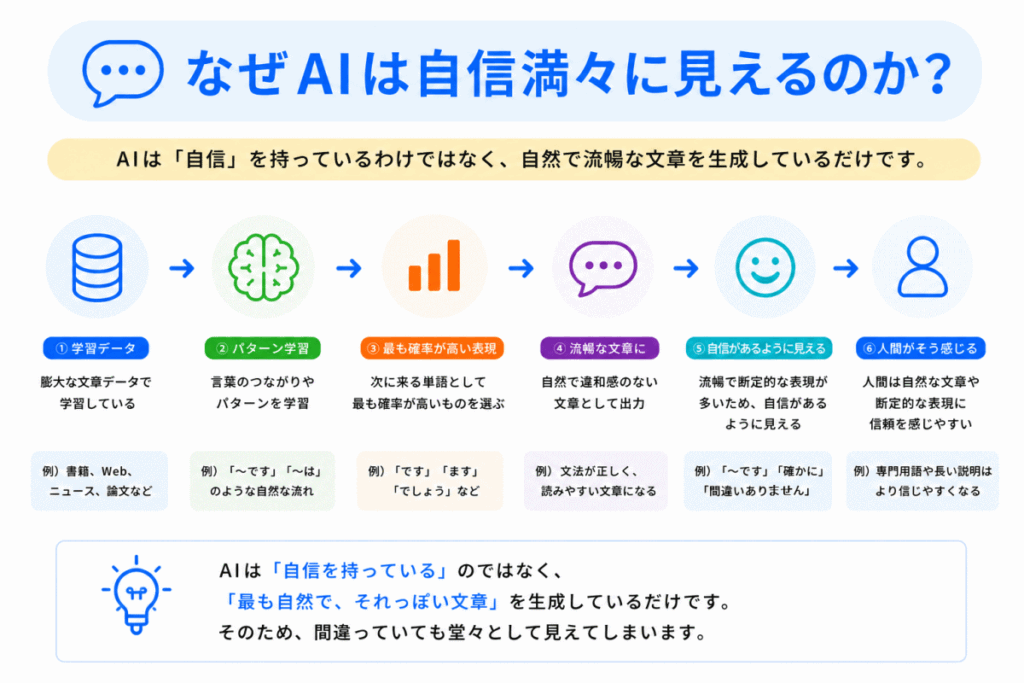

なぜAIは自信満々に見えるのか?

ここがかなり重要です。

AIは「自信」を持っているわけではありません。

しかし

- 流暢

- 断定的

- 自然な文章

を生成するため、人間側が「正しそう」と感じてしまいます。

つまり「AIが騙している」というより、「人間が自然さに騙される」側面も大きいのです。

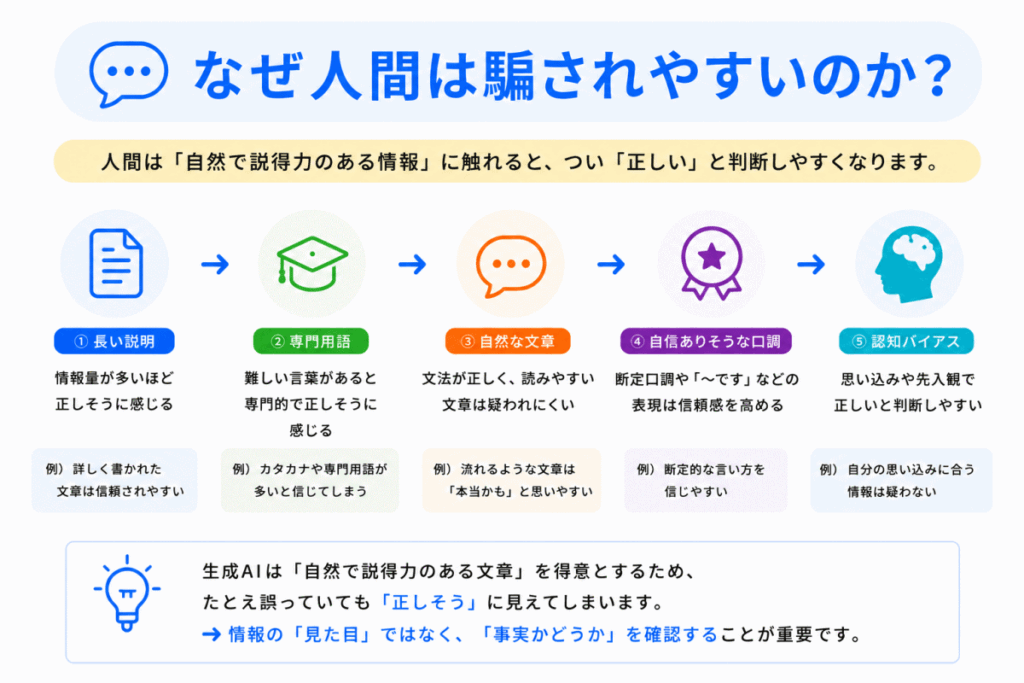

なぜ人間は騙されやすいのか?

ここは認知エラー的にも重要です。

人間は

- 長い説明

- 専門用語

- 自然な文章

- 自信ありそうな口調

を見ると、「正しいかも」と感じやすくなります。

特に生成AIは「文章を自然に見せる」能力が非常に高いため、

間違いでも自然に見えてしまいます。

AI内部では「何を評価」しているのか?

ここで重要なのが AIは「正しさ」だけを学習しているわけではない という点です。

生成AIは

- 自然な文章

- 次に来そうな単語

- 会話として成立する流れ

を重視して学習しています。

つまり「自然さ」と「事実の正確性」は別問題なのです。

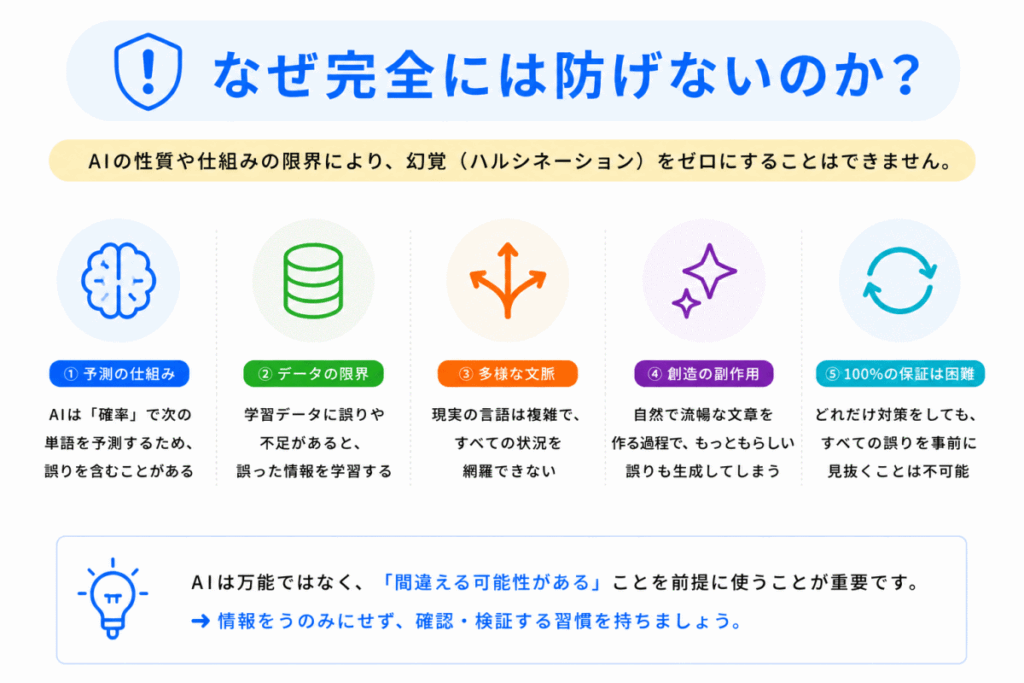

なぜ完全には防げないのか?

現在も

- RLHF

- ファインチューニング

- RAG

- 安全対策

などで改善されています。

しかし、生成AIは「予測モデル」である以上、完全にゼロにするのは難しいと言われています。

特に

- 情報不足

- 曖昧な質問

- 学習データ不足

では、AIが推測し始めるためです。

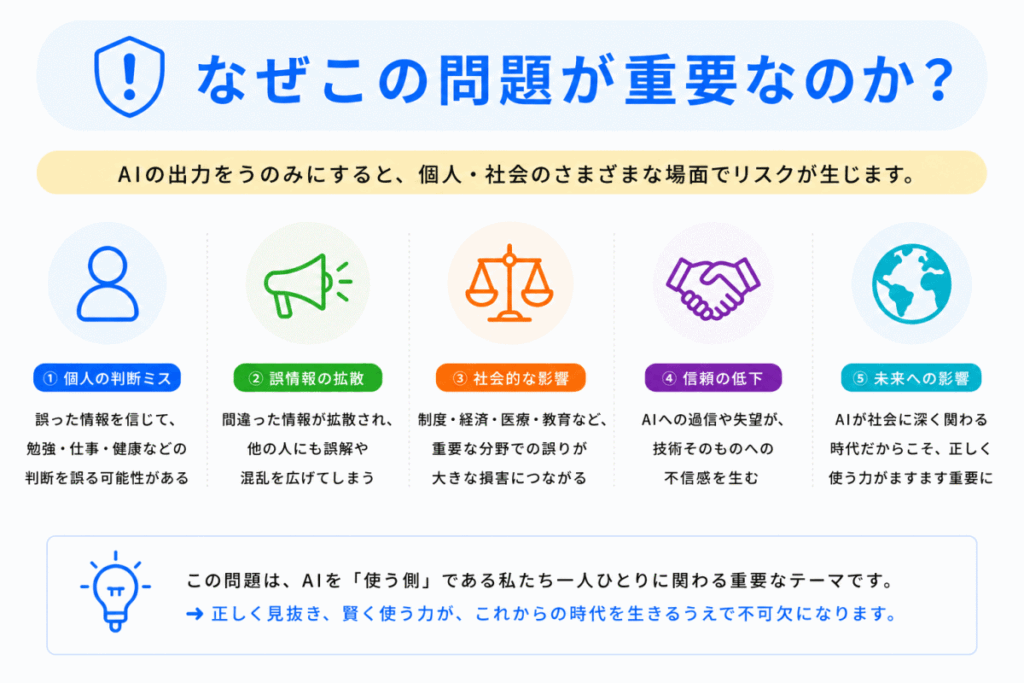

なぜこの問題が重要なのか?

生成AIは非常に便利です。

しかし「自然に話す = 正しい」ではありません。

ここを誤解すると

- 誤情報

- 著作権問題

- AI依存

- 業務ミス

につながる可能性があります。

そのため現在は AI倫理・AIガバナンス も重要視されています。

G検定ではどう問われる?

G検定では

- ハルシネーション

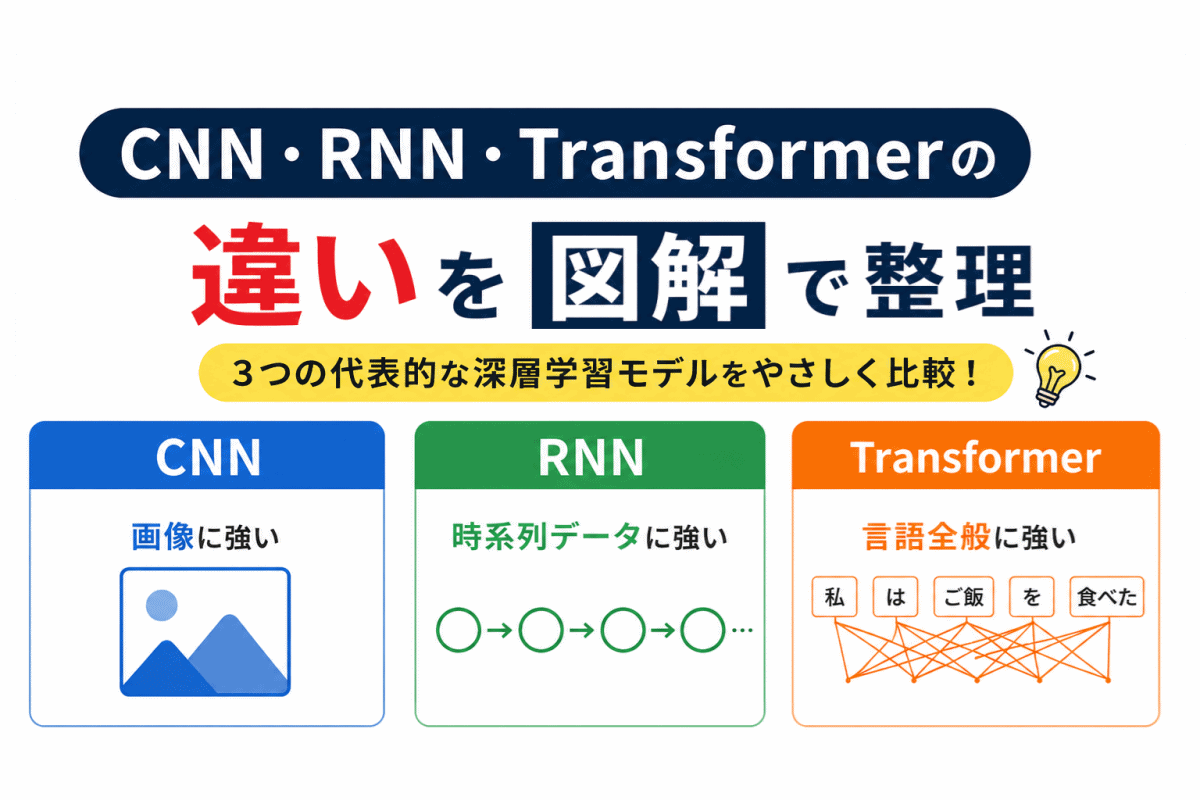

- Transformer

- LLM

- 生成AIリスク

- AI倫理

- 説明可能性

などと絡めて問われる可能性があります。

特に「生成AIはなぜ誤情報を作るのか?」は重要テーマです。

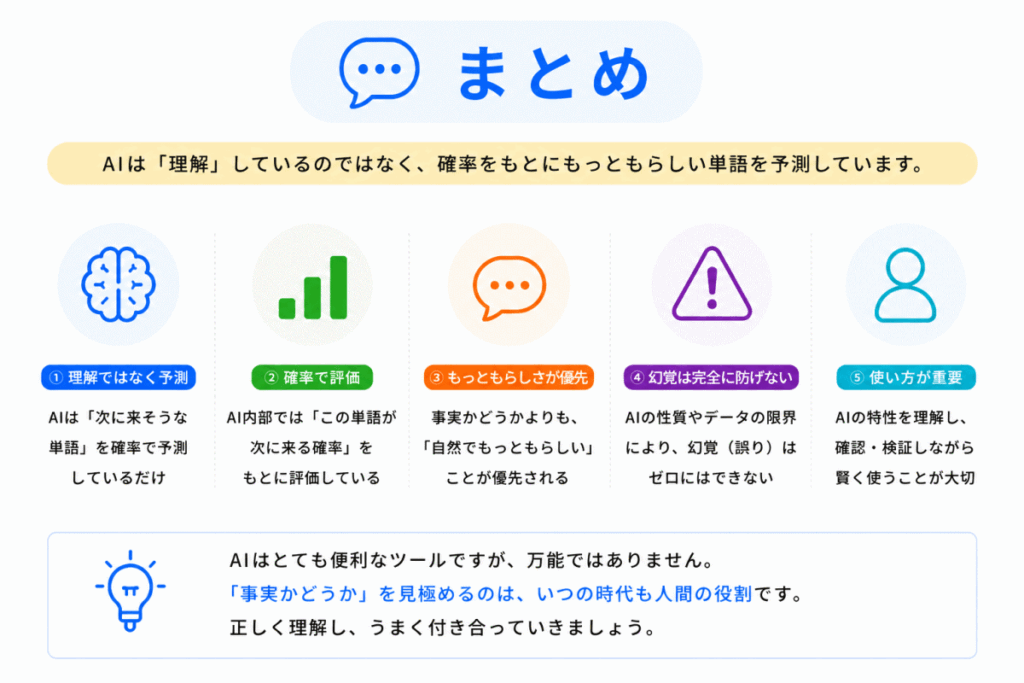

まとめ

生成AIは「理解している」のではなく「予測している」という点が最重要です。

そのため

- 自然でも間違う

- 自信ありそうでも誤る

- 存在しない情報も作る

ことがあります。

しかし、逆に言えば「AI内部で何が起きているか」を理解すると、なぜ誤るのかも見えてきます。

これは AIを正しく使うために最も重要な理解 の1つです。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

「AIはどうやって賢くなるのか?」を整理しました。

「AIはなぜ失敗するのか?」を整理しました。

「CNN・RNN・Transformer」を整理しました。

不合格体験記です。私のような失敗をしないように確認しましょう。