【G検定対策】確率的勾配降下法(SGD)とは?わかりやすく整理

確率的勾配降下法(SGD)は、AIの学習を効率よく進める ための重要な手法です。

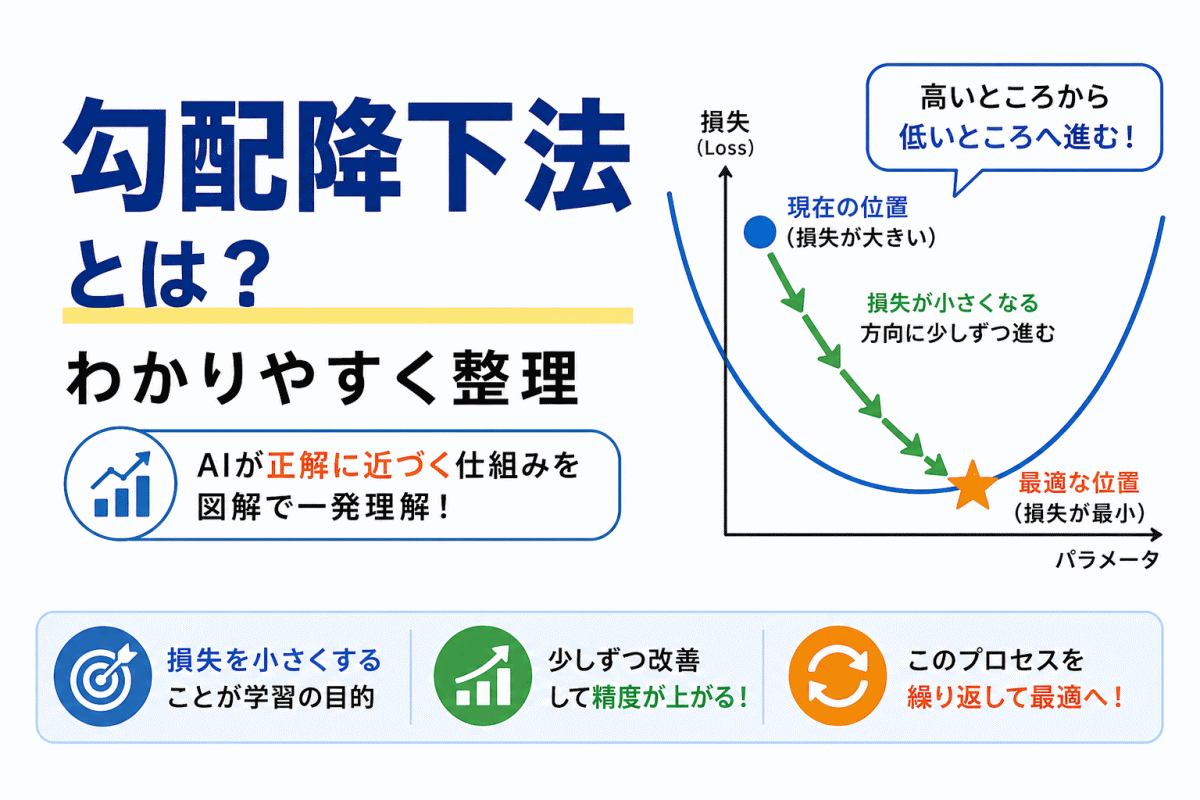

通常の勾配降下法との違いや、なぜ使われるのかを理解することで、AIの仕組みが一気にクリアになります。

本記事では、初心者向けにSGDの基本からメリット・デメリットまでを図解でわかりやすく解説します。

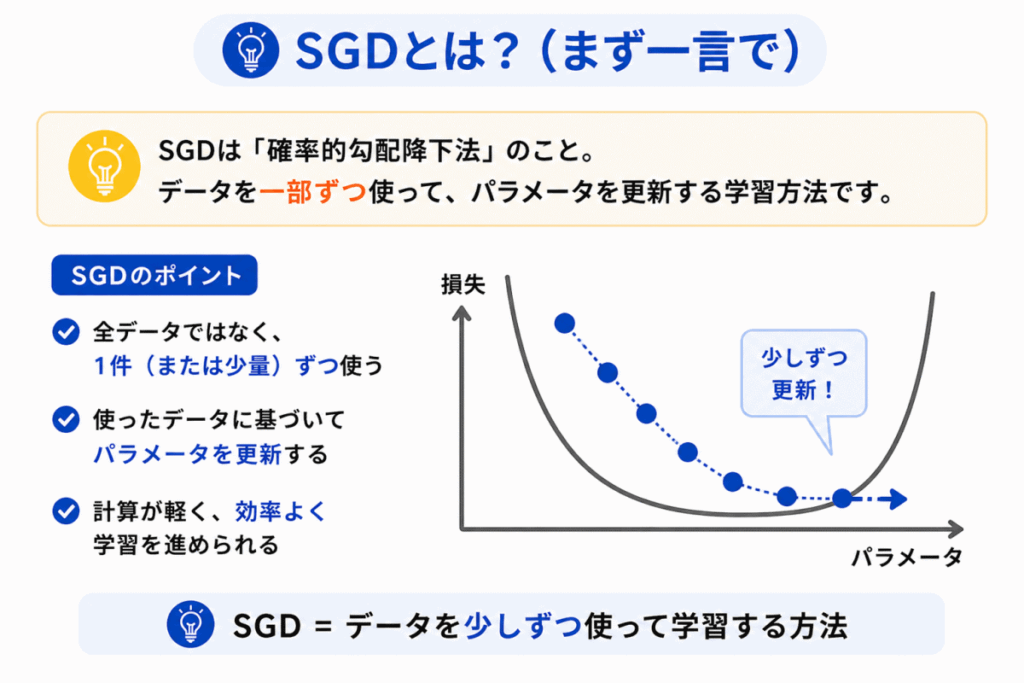

SGDとは?

SGDは日本語でいうと「確率的勾配降下法」といいます。

簡単にまとめると下記の特徴があります。

■ データを少しずつ使う学習方法

■ 1件(または少量)ごとにパラメータを更新

■ データを少しずつ使う学習方法

■ 1件(または少量)ごとにパラメータを更新

※:通常の勾配降下法は全データを使用

計算を軽くしながら、効率よく学習できる手法です

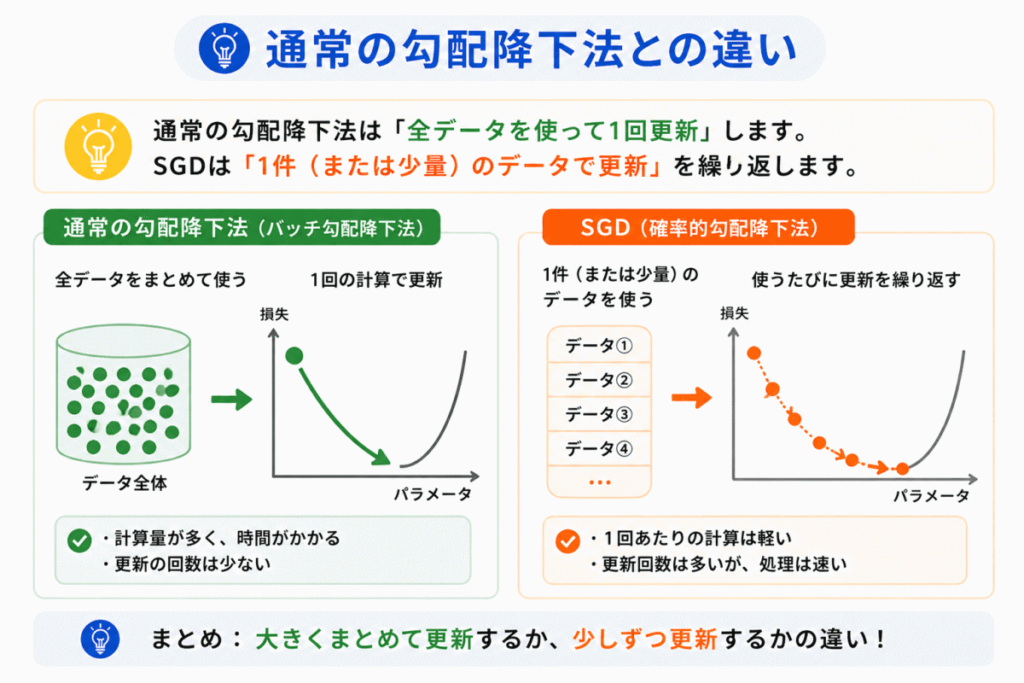

通常の勾配降下法との違い

勾配降下法を整理した記事です。

> 勾配降下法とは?わかりやすく整理

■ 通常:全データで1回更新

■ SGD:少量データで何度も更新

■ 通常:全データで1回更新

■ SGD:少量データで何度も更新

→ 1回の計算はSGDの方が軽い

「まとめて更新」か「少しずつ更新」かが大きな違いです。

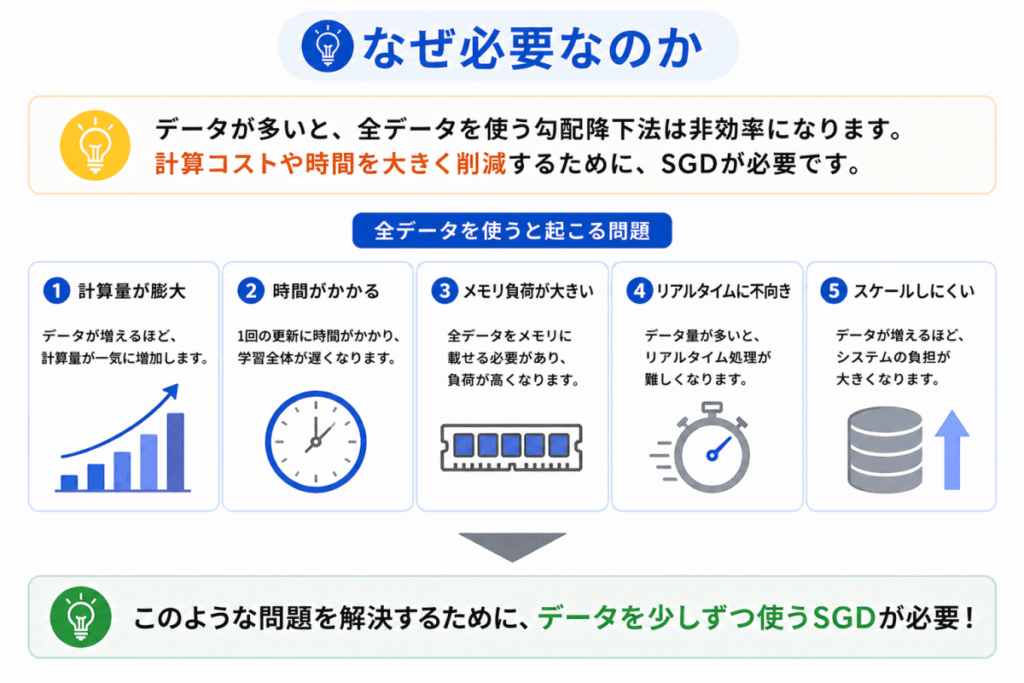

なぜ必要なのか

勾配降下法だと…

■ データが多いと計算が重くなる

■ 全データ処理は時間がかかる

■ メモリ負荷も増える

■ データが多いと計算が重くなる

■ 全データ処理は時間がかかる

■ メモリ負荷も増える

SGDは分割処理により、現実的な時間で学習を可能にします。

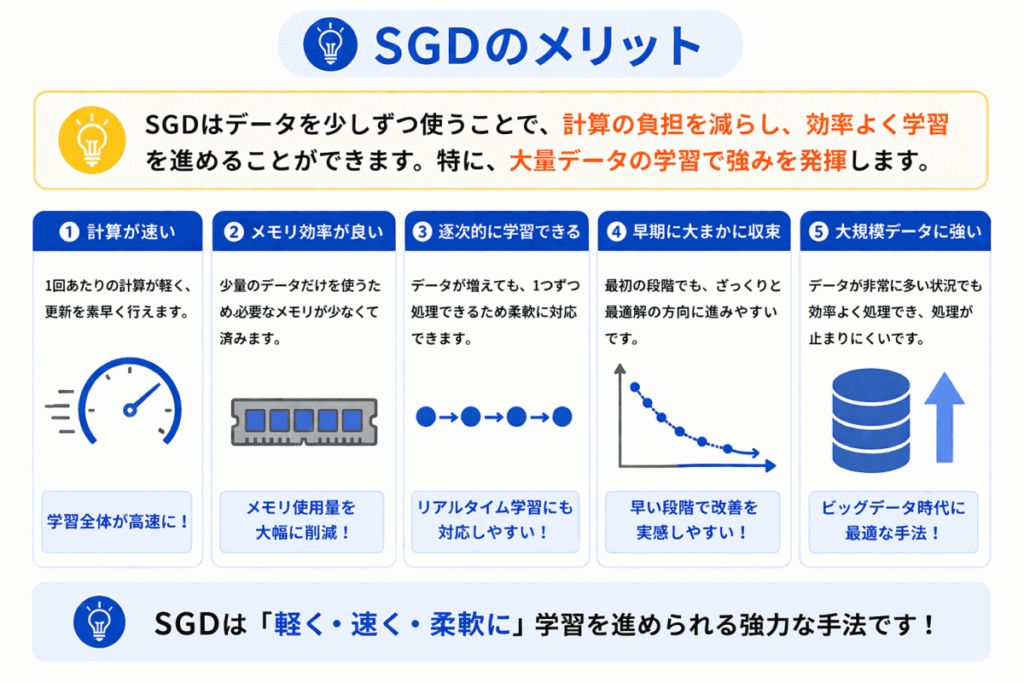

SGDのメリット

SGDのメリットとして下記があげられます。

- 計算が軽く高速に処理できる

- メモリ使用量を抑えられる

- データ追加にも柔軟に対応できる

大規模データでも効率よく学習できるのが強みです。

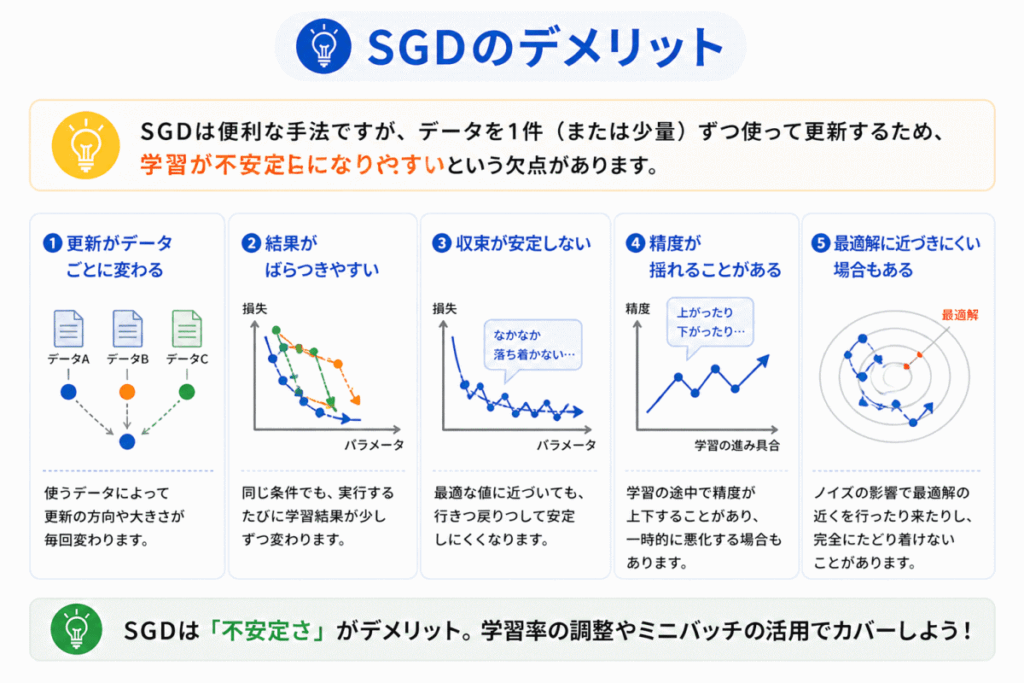

SGDのデメリット

SGDのデメリットとして下記があげられます

- 更新ごとに結果が変わりやすい

- 学習が不安定になりやすい

- 収束が滑らかでない

精度が上下しながら収束する点に注意が必要です。

→ 一部のデータを使うため偏りが発生することがある

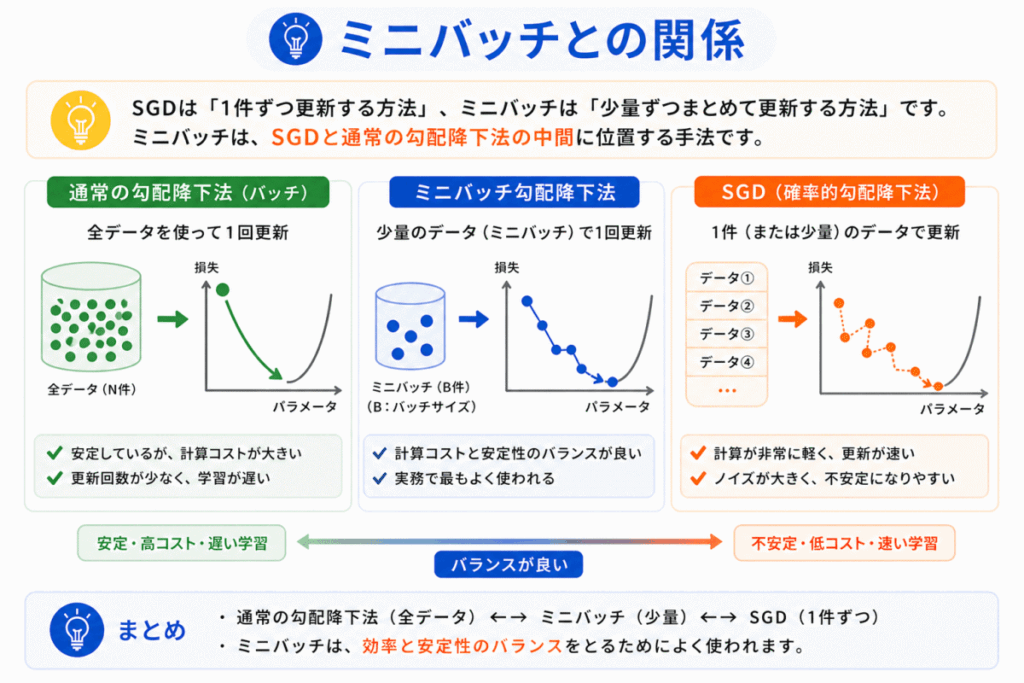

ミニバッチとの関係

- 通常法(勾配降下法):全データで更新

- ミニバッチ:少量まとめて更新

- SGD:1件ずつ更新

ミニバッチは「効率と安定性のバランス型」で、実務で主流です。

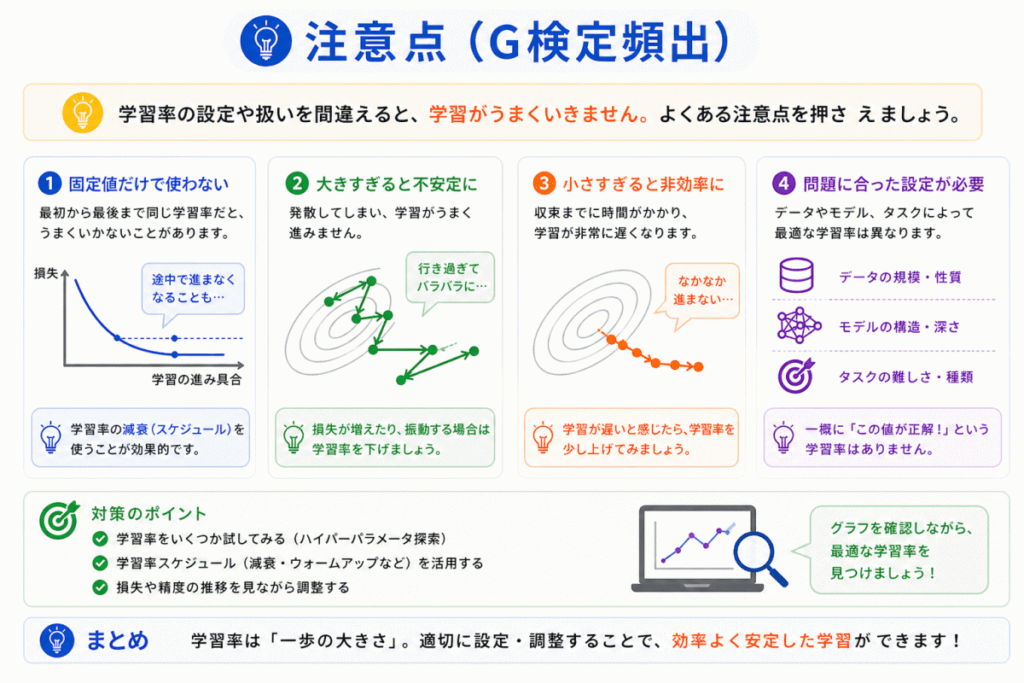

注意点(G検定頻出)

注意点(ポイント)として下記があげられます。

- 固定値で使わない

- 大きすぎると不安定に

- 小さすぎると非効率に

- 問題にあった設定が必要

「軽いが不安定」が頻出ポイント。学習率とセットで理解しましょう。

G検定ではどう問われる?

G検定では、勾配降下法との「更新方法の違い」がよく問われます。

- 全データ → 勾配降下法

- 1データ → SGD

- 少量データ → ミニバッチ

まとめ

SGDをまとめると…

■ SGDはデータを分けて学習する手法

■ 計算が軽く高速に処理できる

→ ただし、不安定さがある

■ SGDはデータを分けて学習する手法

■ 計算が軽く高速に処理できる

→ ただし、不安定さがある

確率的勾配降下法(SGD)は、データを少しずつ使って効率よく学習を進める 手法です。

計算が軽く高速に処理できる一方で、更新が不安定になりやすい という特徴もあります。

そのため、ミニバッチ学習や学習率の調整と組み合わせて使うことが重要です。

特徴を正しく理解することで、AIの学習の仕組みがより深く理解できます。

そのため 適切な学習率を設定することが、精度の高いモデルを作るうえで非常に重要です。

実際の学習では、状況に応じて学習率を調整したり、徐々に小さくしていく工夫(スケジューリング)も行われます。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

学習率について整理しました。

勾配降下法について整理しました。

損失関数について整理しました。

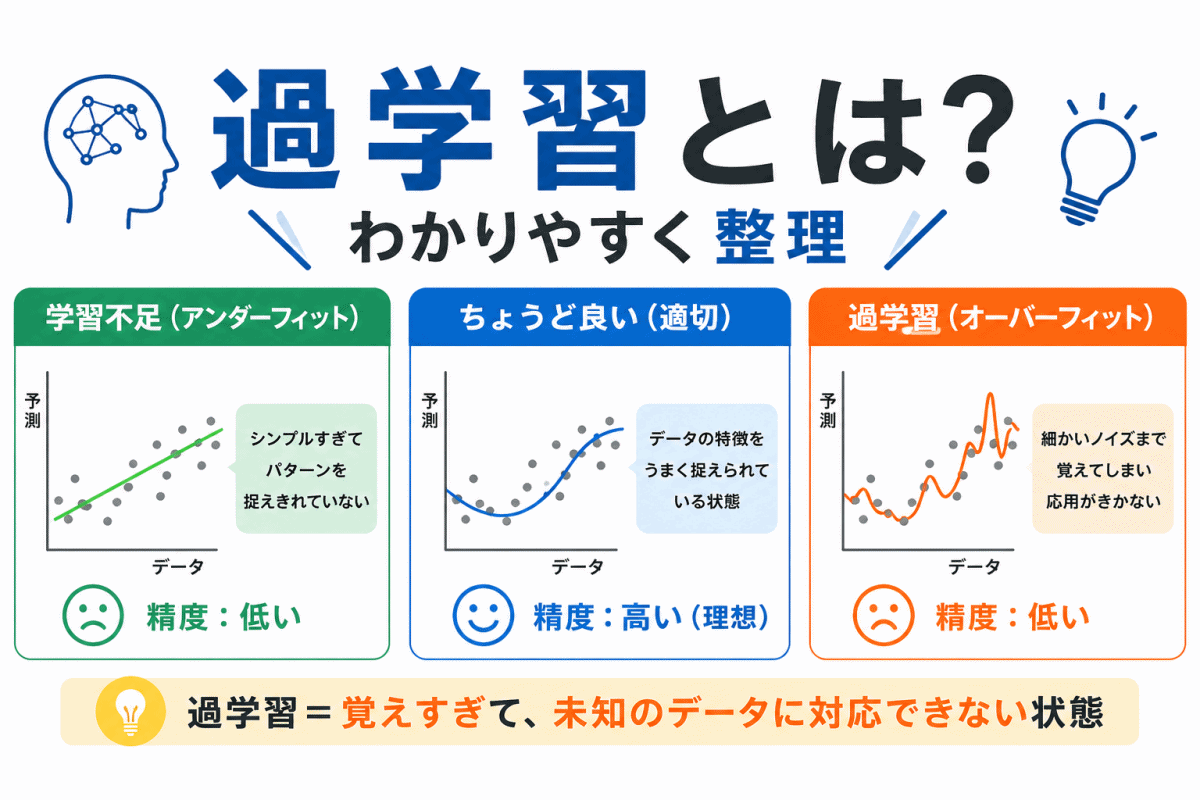

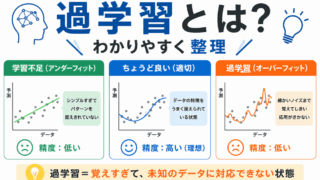

過学習について整理しました。

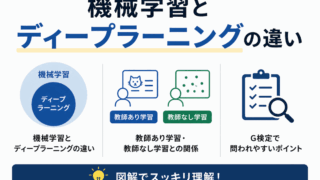

機械学習とディープラーニングの違いを整理しました。

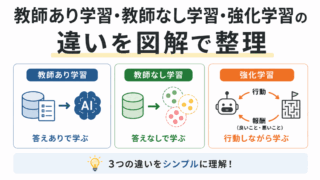

教師あり学習・教師なし学習・強化学習の違いを整理しました。

CNN・RNN・Transformerの違いを整理しました。

どの分野から出題されるか予想しました。

G検定 合格体験談です。2回目の受験で何とか合格できました。