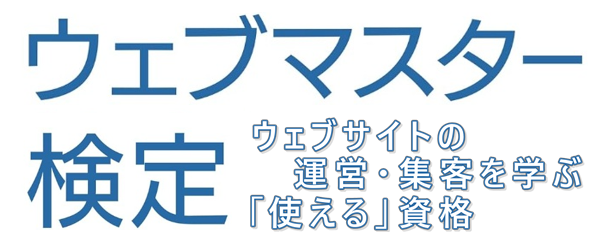

【G検定対策】勾配降下法とは?わかりやすく整理

AIはどのようにして「正解に近づいていく」のでしょうか?

そのカギとなるのが「勾配降下法(こうばいこうかほう)」です。

勾配降下法は、AIが学習するときに使う「間違いを減らすための進み方」を決める重要な仕組みです。

この記事では「勾配降下法」の概念をわかりやすく整理します。

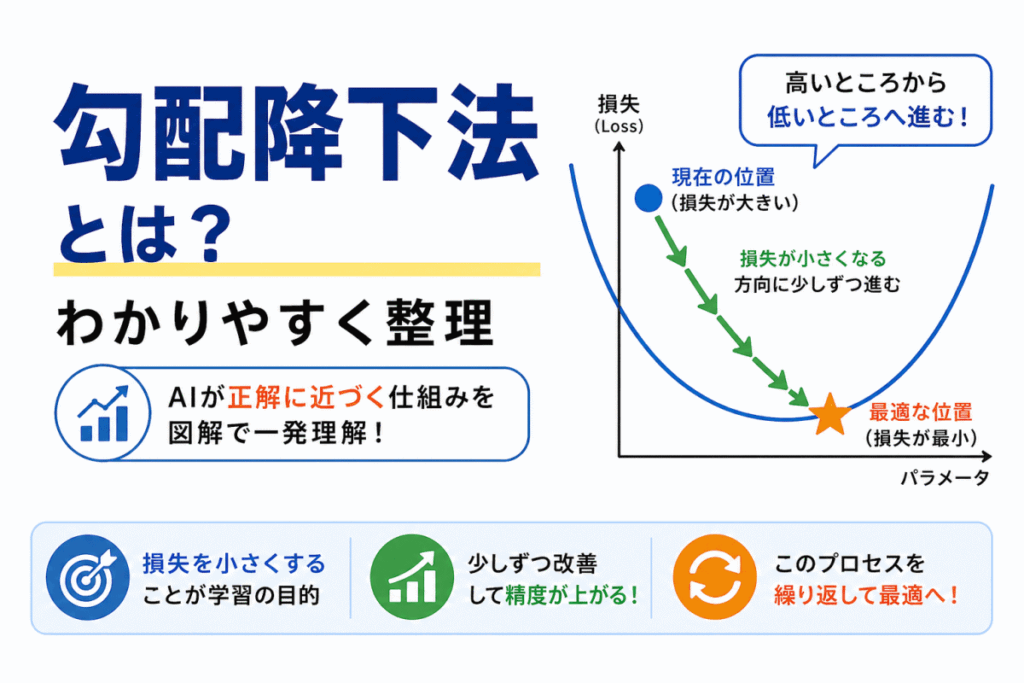

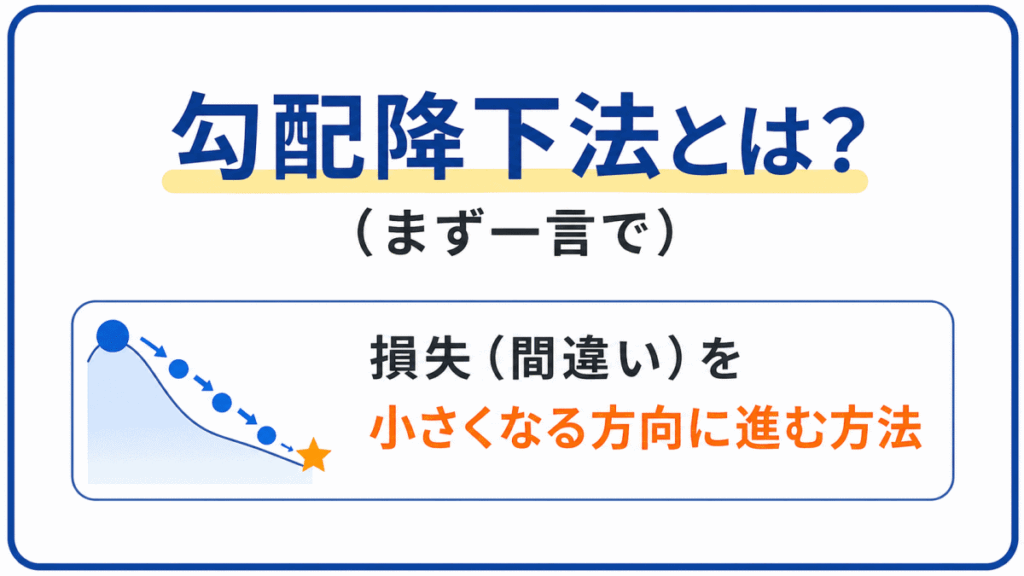

勾配降下法とは?

ひとことでいうと

勾配降下法 = 損失(※)が小さくなる方向に進む方法

勾配降下法 = 損失(※)が小さくなる方向に進む方法

です。

ここでいう「損失」とは、正解から外れたものを言います

AIは「どれだけ間違えたか(損失)」を見ながら少しずつ正解に近づくように学習していきます。

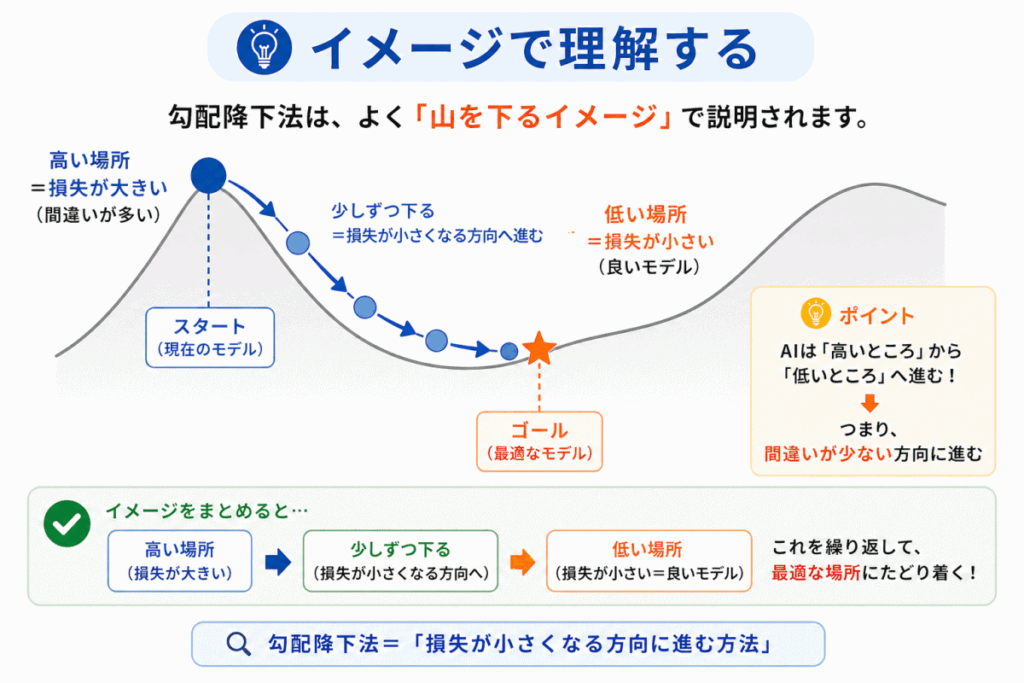

イメージで理解

勾配降下法は、よく「山を下るイメージ」で説明されます。

■ 高い場所 = 損失が大きい(間違いが多い)

■ 低い場所 = 損失が小さい(良いモデル)

■ 高い場所 = 損失が大きい(間違いが多い)

■ 低い場所 = 損失が小さい(良いモデル)

AIは「高いところ」から「低いところ」へ進みます。

つまり

間違いが少ない方向に進む

間違いが少ない方向に進む

のです。

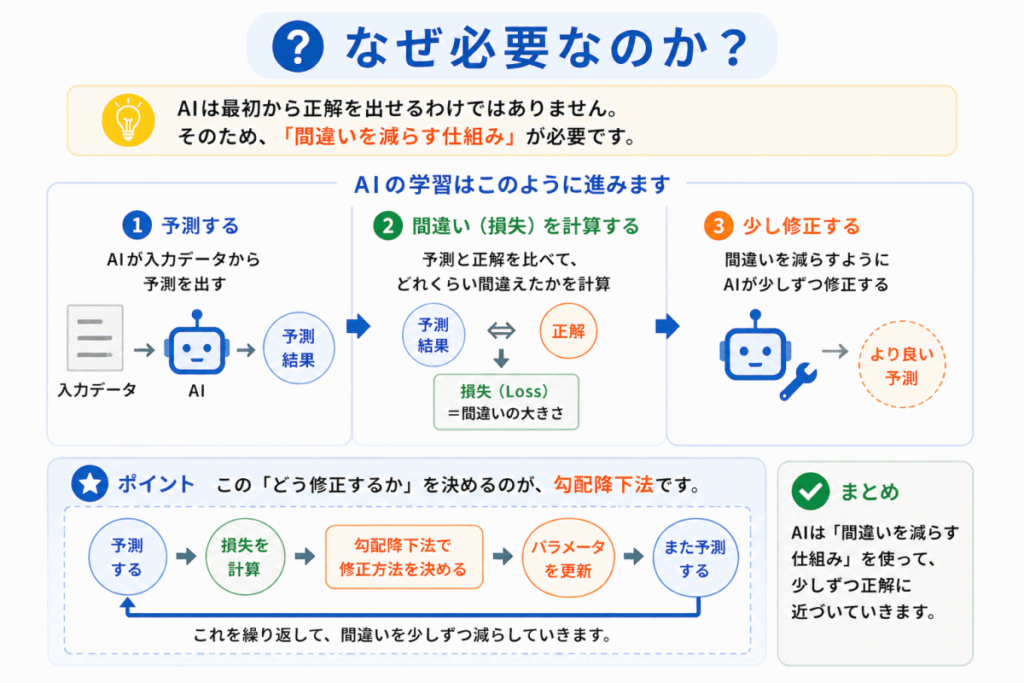

なぜ必要なのか

AIは最初から正解を出せるわけではありません。

そこで

予測する → 間違い(損失)を計算する → 少し修正する

予測する → 間違い(損失)を計算する → 少し修正する

これを繰り返します。

この「どう修正するか」を決めるのが勾配降下法です。

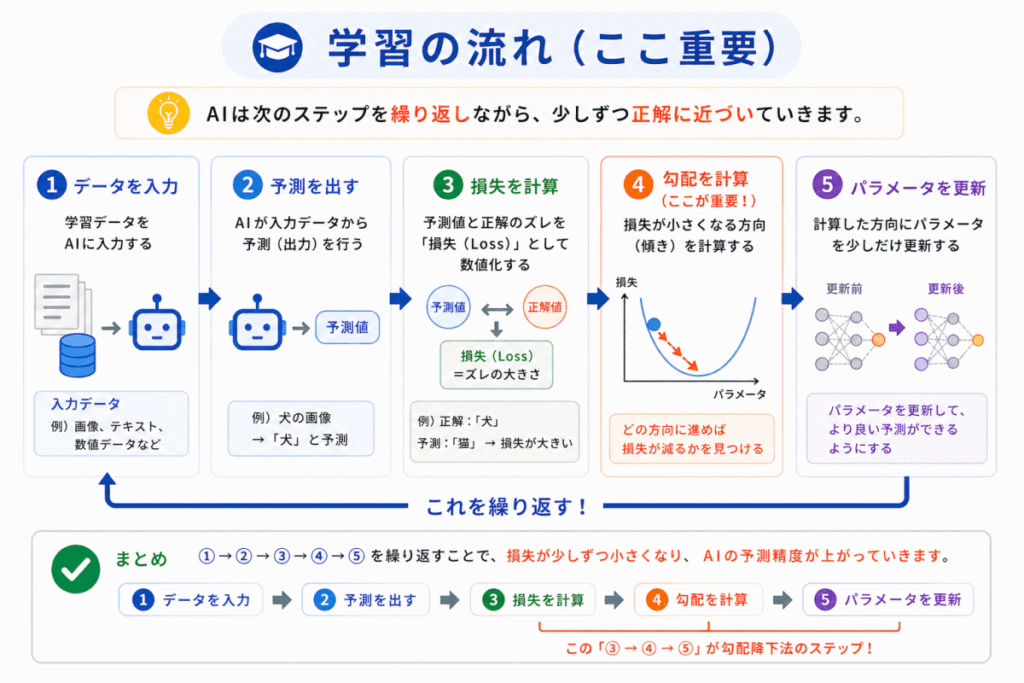

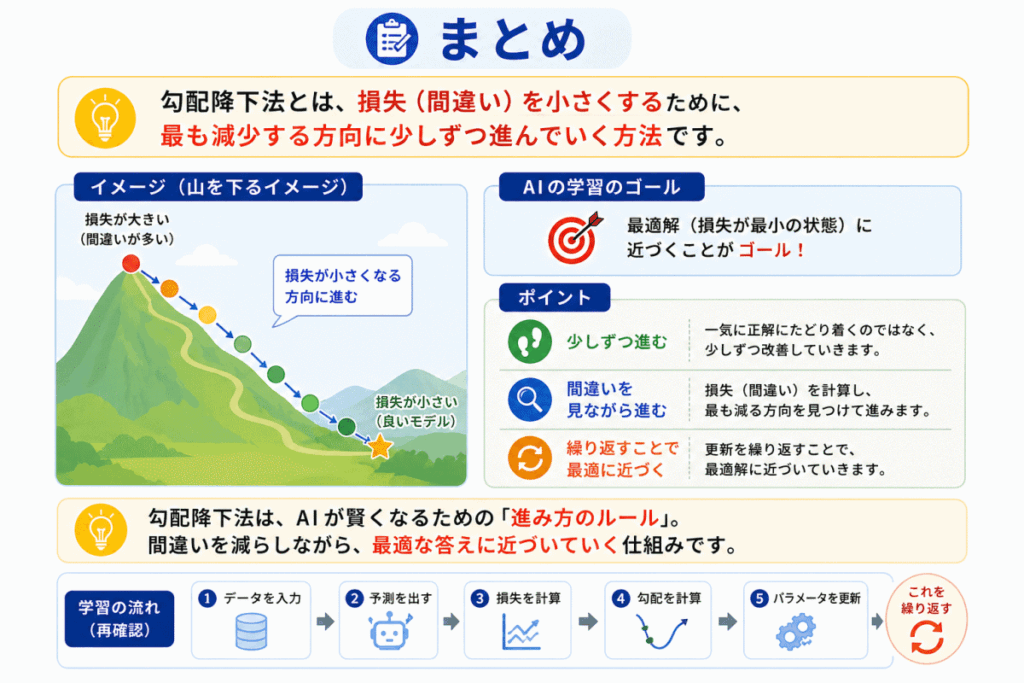

学習の流れ(ここ重要)

AIの学習は以下の流れで学習します。

① データを入力

② 予測を出す

③ 損失を計算

④ 勾配を計算

⑤ パラメータを更新

④ → ⑤ の部分が勾配降下法です。

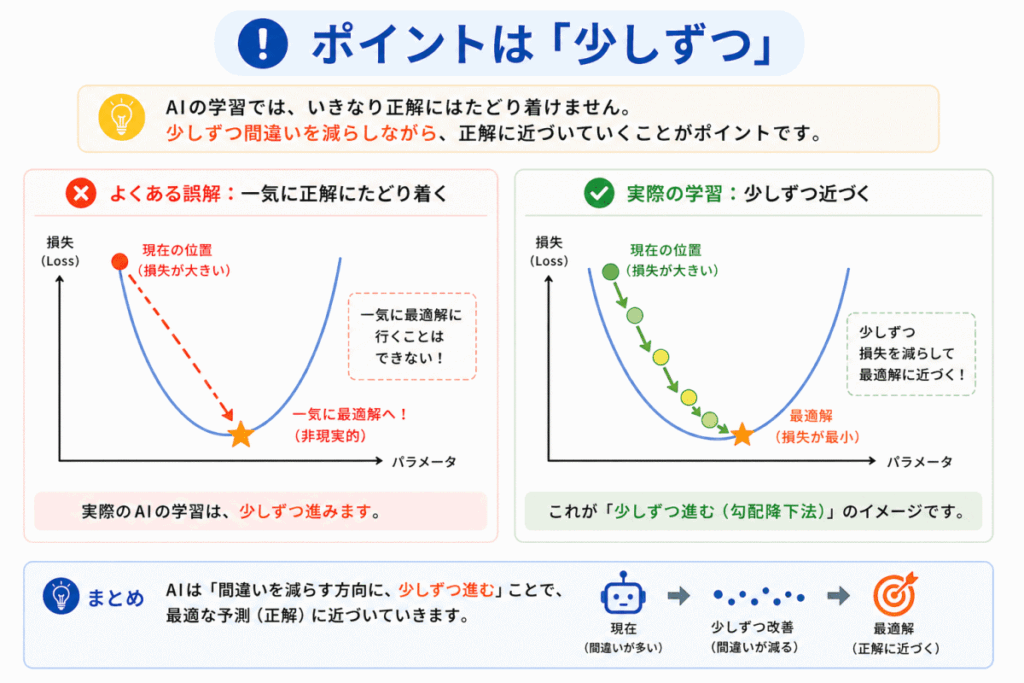

ポイントは「少しずつ」

よくある誤解は

一気に正解にたどり着く

一気に正解にたどり着く

ではなく、実際は

少しずつ正解に近づいていく

少しずつ正解に近づいていく

です。

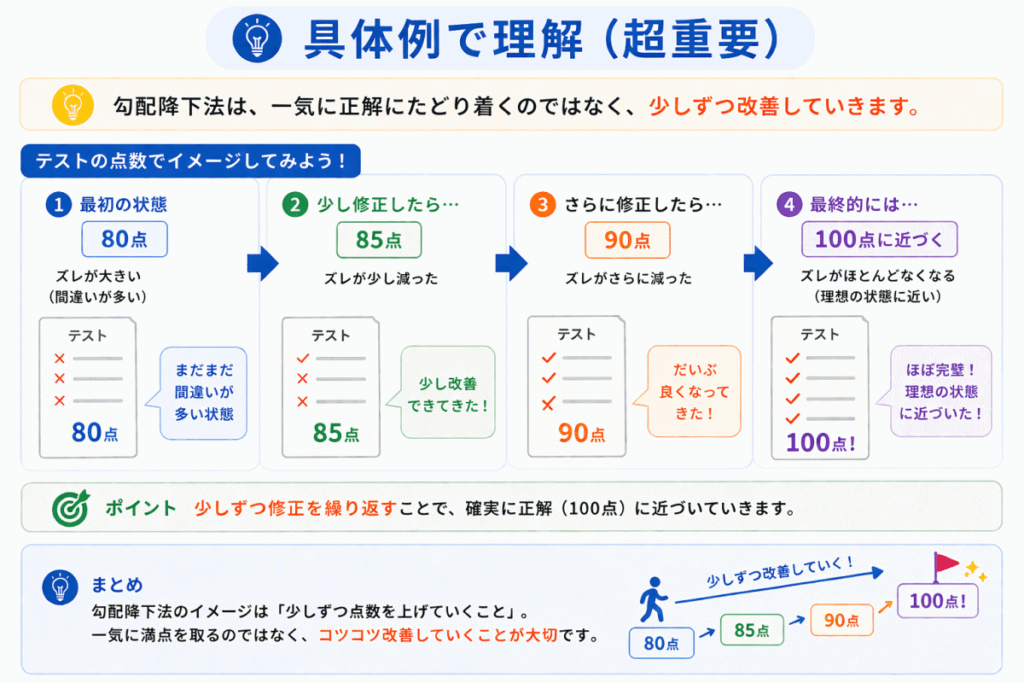

具体例で理解(超重要)

テストで考えてみてください。

最初:80点(ズレが大きい)

修正:85点

修正:90点

最終:100点に近づく

一気に満点ではなく、少しずつ改善していく

一気に満点ではなく、少しずつ改善していく

テスト勉強と同じです。少しずつレベルアップしていく。

これが勾配降下法のイメージです。

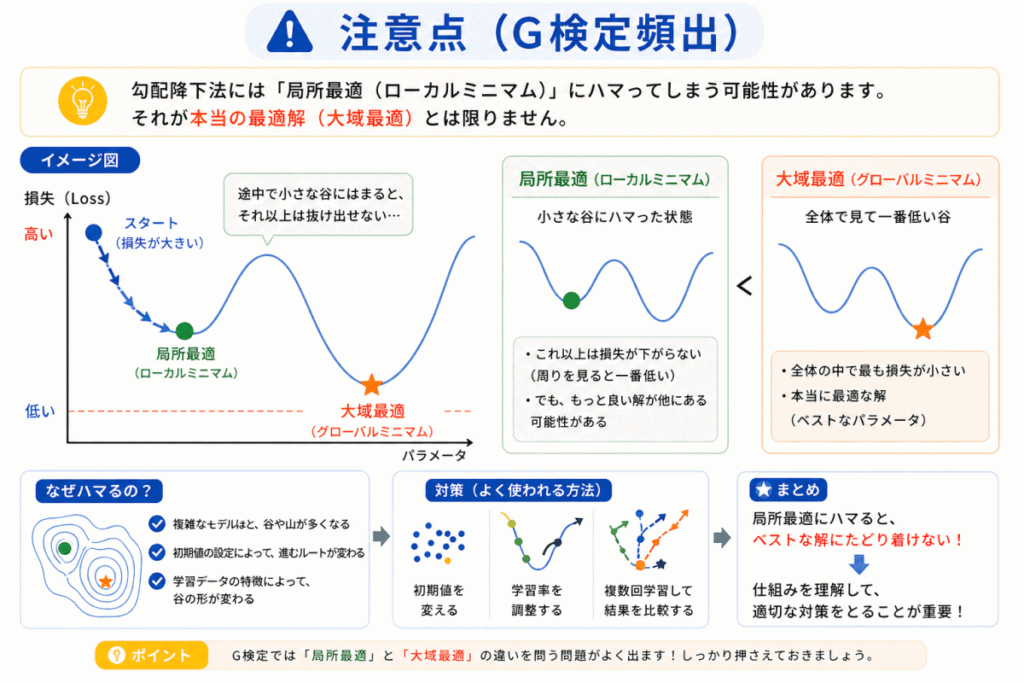

注意点(G検定頻出)

勾配降下法は「今いる場所から下る」方法のため必ずしも一番良い解にたどり着くとは限りません。

途中の小さな谷(局所最適)で止まってしまうことがあり、スタート地点(初期値)や動く大きさ(学習率)によって結果が変わります。

これを

局所最適(ローカルミニマム)

局所最適(ローカルミニマム)

と言います。

G検定ではどう問われる?

G検定では勾配降下法の「基本概念」と「注意点」を結びつける問題がよく出ます。

- 損失を最小化する → 勾配降下法

- 傾きで方向を決める → 勾配

- 最適とは限らない → 局所最適

まとめ

勾配降下法とは

損失(間違い)を小さくするために進む方向を決める方法

損失(間違い)を小さくするために進む方向を決める方法

です。

AIは一度で正解にたどり着くのではなく、少しずつズレを修正しながら正解に近づいていきます。

AIは「正解を丸暗記している」のではなく ズレ(誤差)を減らすように少しずつ改善しているだけ です。

公式テキスト

Amazonで確認

楽天市場で確認

合格時に使用した問題集

Amazonで確認

楽天市場で確認

関連記事・おすすめ記事

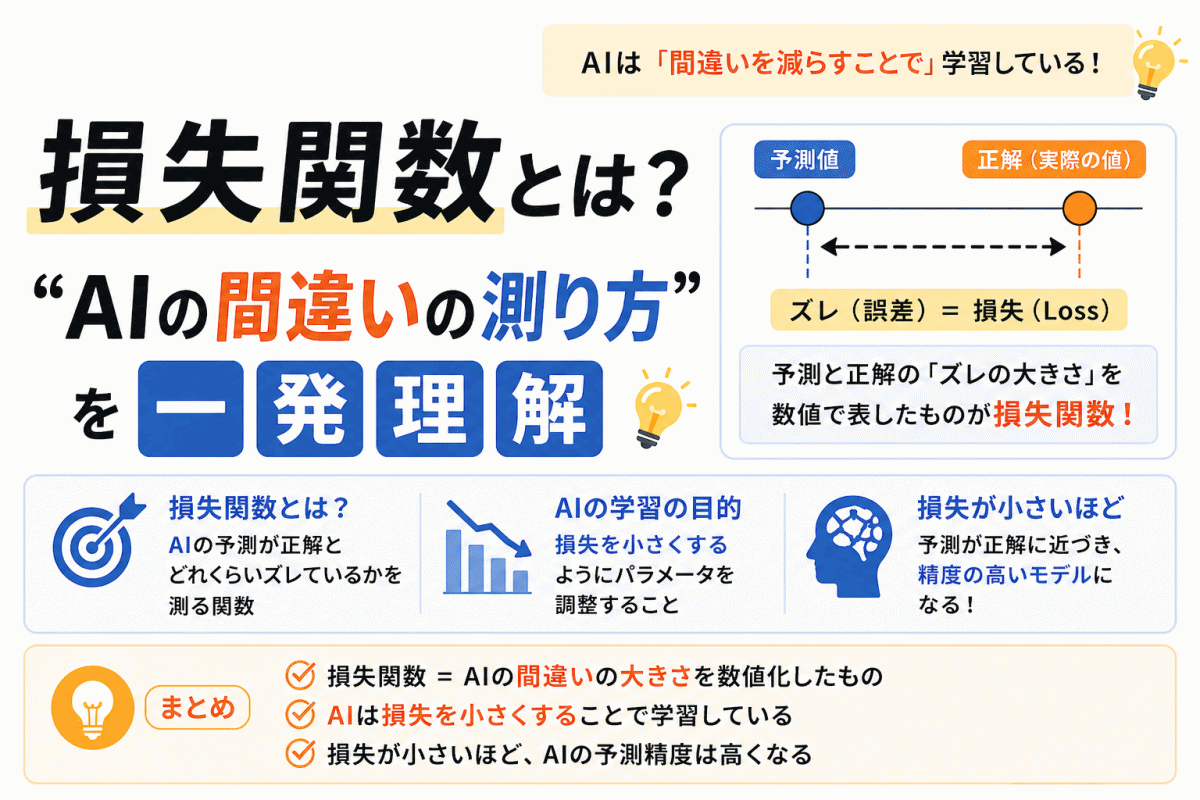

損失関数について整理しました。

過学習について整理しました。

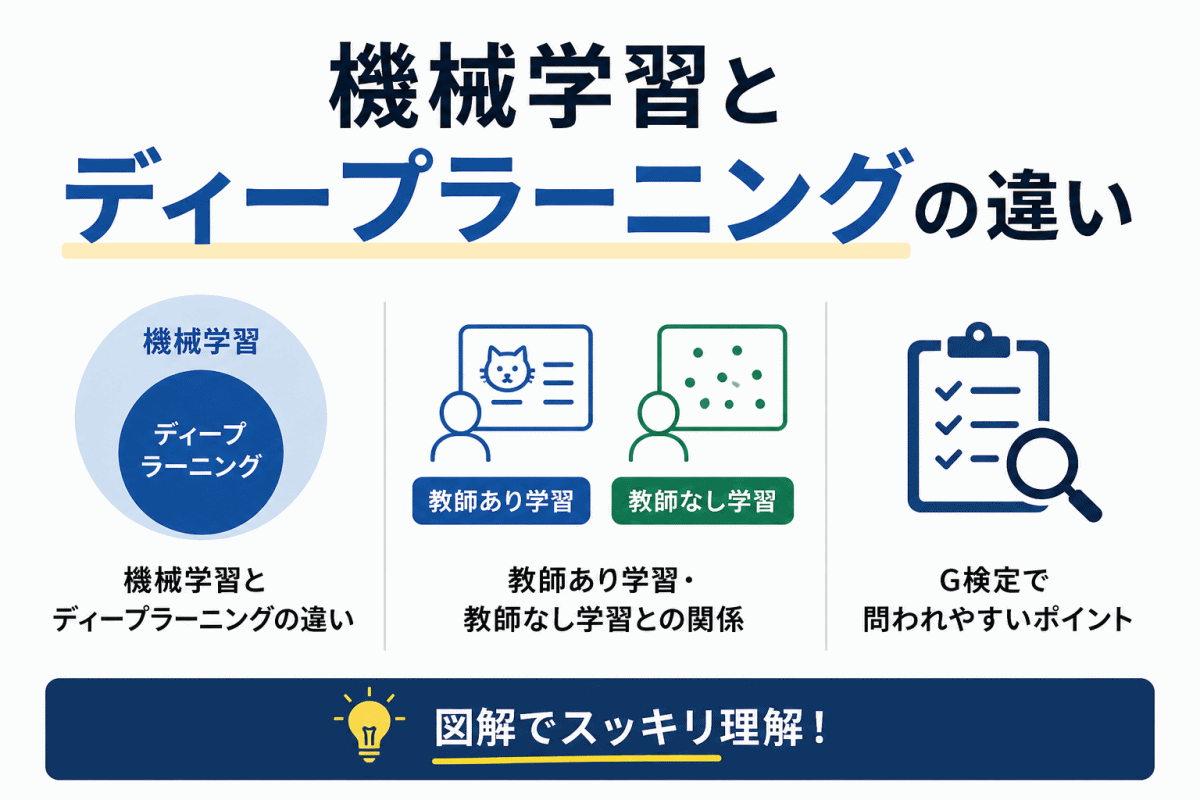

機械学習とディープラーニングの違いを整理しました。

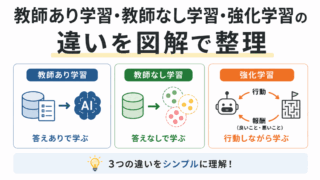

教師あり学習・教師なし学習・強化学習の違いを整理しました。

CNN・RNN・Transformerの違いを整理しました。

どの分野から出題されるか予想しました。

G検定 合格体験談です。2回目の受験で何とか合格できました。